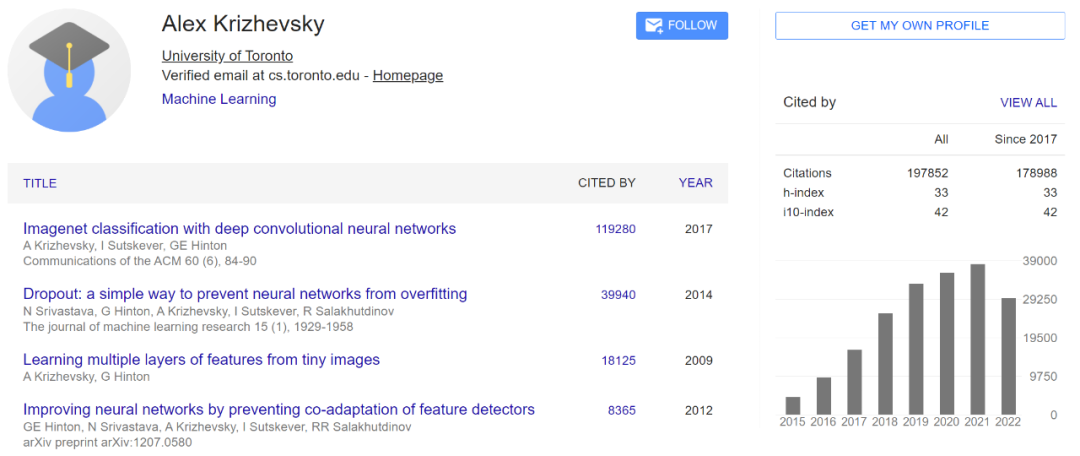

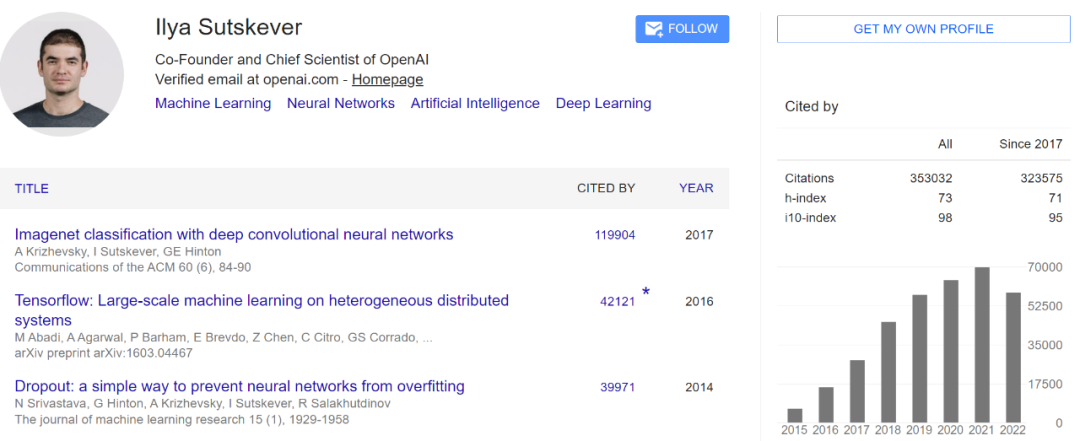

NeurIPS 2022杰出论文奖项公布!AlexNet获时间检验奖

转载机器之心

距离会议召开还有一周的时间,NeurIPS 2022 官方公布了各类奖项的获奖论文。

-

机构:悉尼科技大学、威斯康星大学麦迪逊分校等 -

作者:Zhen Fang、Yixuan Li、Jie Lu、 Jiahua Dong、Bo Han、Feng Liu -

论文地址:https://openreview.net/forum?id=sde_7ZzGXOE

-

机构:谷歌研究院 -

作者:Chitwan Saharia、William Chan、Saurabh Saxena等 -

论文地址:https://openreview.net/forum?id=08Yk-n5l2Al

-

机构:NVIDIA -

作者:Tero Karras、Miika Aittala、Timo Aila、Samuli Laine -

论文地址:https://openreview.net/forum?id=k7FuTOWMOc7

-

机构:艾伦人工智能研究院、华盛顿大学 -

作者:Matt Deitke、Eli VanderBilt、Alvaro Herrasti等 -

论文地址:https://openreview.net/forum?id=4-bV1bi74M

-

机构:普林斯顿大学神经科学研究所、DeepMind 等 -

作者:Sreejan Kumar、Carlos G. Correa、Ishita Dasgupta等 -

论文地址:https://openreview.net/forum?id=buXZ7nIqiwE

-

机构:微软、清华大学等 -

作者:Yujing Wang、Yingyan Hou、Haonan Wang等 -

论文地址:https://openreview.net/forum?id=fSfcEYQP_qc

-

作者:Gerard Ben Arous、Reza Gheissari、Aukosh Jagannath -

论文地址:https://arxiv.org/pdf/2206.04030.pdf

-

机构:MIT CSAIL、Meta -

作者:Kartik Chandra、Audrey Xie、Jonathan Ragan-Kelley等 -

论文地址:https://openreview.net/pdf?id=-Qp-3L-5ZdI

-

机构:巴黎文理研究大学、牛津大学 -

作者:Valentin De Bortoli、 Emile Mathieu、Michael John Hutchinson 等 -

论文地址:https://arxiv.org/pdf/2202.02763.pdf

-

机构:斯坦福大学、清华大学、 DeepMind 等 -

作者:Jiaxin Shi、Yuhao Zhou、Jessica Hwang 等 -

论文地址:https://openreview.net/pdf?id=I1mkUkaguP

-

机构:DeepMind -

作者:Jordan Hoffmann、Sebastian Borgeaud、Arthur Mensch 等 -

论文地址:https://www.deepmind.com/publications/an-empirical-analysis-of-compute-optimal-large-language-model-training

-

机构:斯坦福大学、图宾根大学、Meta AI -

作者:Ben Sorscher、Robert Geirhos、Shashank Shekhar 等 -

论文地址:https://openreview.net/pdf?id=UmvSlP-PyV

-

机构:Berkeley -

作者:Nika Haghtalab、Michael Jordan、Eric Zhao -

论文地址:https://openreview.net/pdf?id=FR289LMkmxZ

-

机构:LAION 、UC 伯克利等 -

作者:Christoph Schuhmann 、 Romain Beaumont 、 Richard Vencu 等 -

论文地址:https://openreview.net/pdf?id=M3Y74vmsMcY

-

机构:英伟达、加州理工学院、斯坦福大学等 -

作者:Linxi Fan、Guanzhi Wang、Yunfan Jiang 等 -

论文地址:https://arxiv.org/pdf/2206.08853.pdf

便捷下载,请关注专知人工智能公众号(点击上方关注)

点击“发消息” 回复 “NIPS22” 就可以获取《NeurIPS 2022论文合集》专知下载链接

登录查看更多

相关内容

Arxiv

0+阅读 · 2023年1月21日