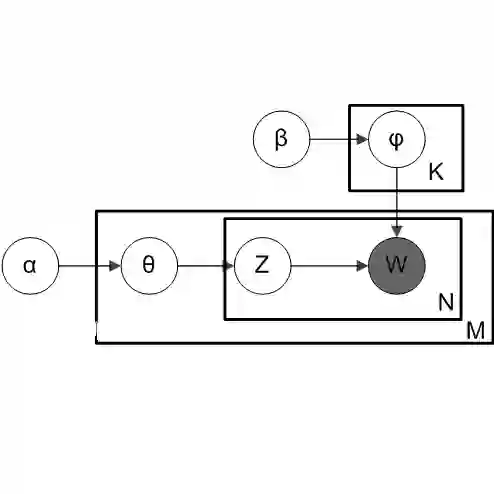

NeurIPS 2021奖项出炉:微软谷歌等6 篇论文获得杰出论文奖,在线LDA获得时间检验奖

NeurIPS 2021 奖项公布,6 篇论文获得杰出论文奖,1 篇获得时间检验奖,此外,今年新增数据集和基准 Track 最佳论文奖,分别由加州大学洛杉矶分校、斯坦福大学的研究者摘得。

作者:Sebastien Bubeck, Mark Sellke

机构:微软研究院、斯坦福大学

论文地址:

https://www.zhuanzhi.ai/paper/aadc2f7b29405275bf7f8384b688f8ce

作者:David Abel、Will Dabney 、Anna Harutyunyan、Mark K. Ho、Michael L. Littman、Doina Precup、Satinder Singh

机构:DeepMind 、普林斯顿大学、布朗大学

论文地址:

https://www.zhuanzhi.ai/paper/f2910875339ba82dbf90f900f952c2fb

作者:Rishabh Agarwal、Max Schwarzer、Pablo Samuel Castro、Aaron Courville、Marc G. Bellemare

机构:谷歌、蒙特利尔大学

论文地址:https://www.zhuanzhi.ai/paper/fe925429d02b535fead31a76b72a4897

作者:Krishna Pillutla、Swabha Swayamdipta、Rowan Zellers、John Thickstun、Sean Welleck、Yejin Choi、 Zaid Harchaoui

机构:华盛顿大学 、艾伦人工智能研究院、斯坦福大学

论文地址:

https://www.zhuanzhi.ai/paper/d151c6a9a896d95b186fa980619ad296

作者:Mathieu Even、Raphaël Berthier、Francis Bach、Nicolas Flammarion、Pierre Gaillard、Hadrien Hendrikx、Laurent Massoulié、Adrien Taylor

机构:巴黎科学艺术人文大学、洛桑联邦理工学院等

论文地址:https://www.zhuanzhi.ai/paper/6b4a67bc035c533b91589a7353e62b09

作者:Noam Rozen、Aditya Grover、Maximilian Nickel、Yaron Lipman

机构:魏茨曼科学研究所、Meta(Facebook)AI、加州大学洛杉矶分校

论文地址:https://www.zhuanzhi.ai/paper/bd6d8ae4a9f39689788ac6f952ecea69

作者:Bernard Koch、Emily Denton、Alex Hanna、Jacob Gates Foster

机构:加州大学洛杉矶分校、谷歌研究院

论文地址:https://openreview.net/pdf?id=zNQBIBKJRkd

作者:Raphael John Lamarre Townshend、Martin Vögele、Patricia Adriana Suriana、Alexander Derry、Alexander Powers、Yianni Laloudakis、Sidhika Balachandar、Bowen Jing、Brandon M. Anderson, Stephan Eismann、Risi Kondor、Russ Altman、Ron O. Dror

机构:斯坦福大学

论文地址:https://openreview.net/pdf?id=FkDZLpK1Ml2

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“NIPS2021” 就可以获取《NeurIPS 2021奖项出炉:微软谷歌等6 篇论文获得杰出论文奖,在线LDA获得时间检验奖》专知下载链接