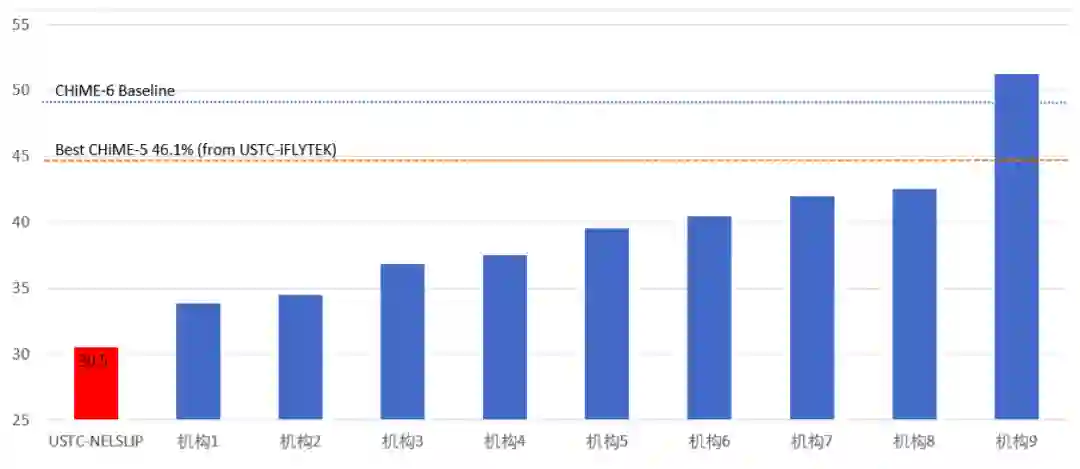

三连冠!科大讯飞夺国际多通道语音分离和识别大赛CHiME-6冠军

-

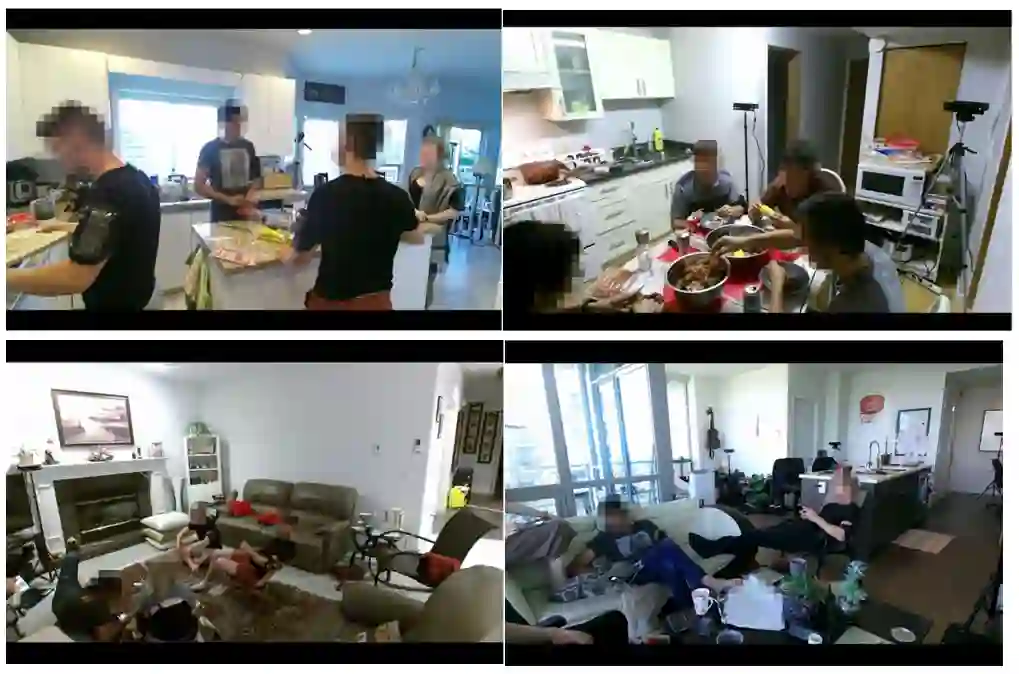

大量的语音交叠(Speech Overlap) -

远场混响和噪声干扰对录音的影响 -

对话风格非常自由、近乎随意 -

训练数据有限

登录查看更多

相关内容

专知会员服务

26+阅读 · 2020年2月16日

专知会员服务

33+阅读 · 2020年1月5日