![]()

本文约1299字,建议阅读3分钟

本文

介绍为语言的丰富常常会导致理解的歧义,对NLP研究带来了巨大的挑战,但微博为做自然语言处理的人提供了一个交流乐趣的平台。

![]()

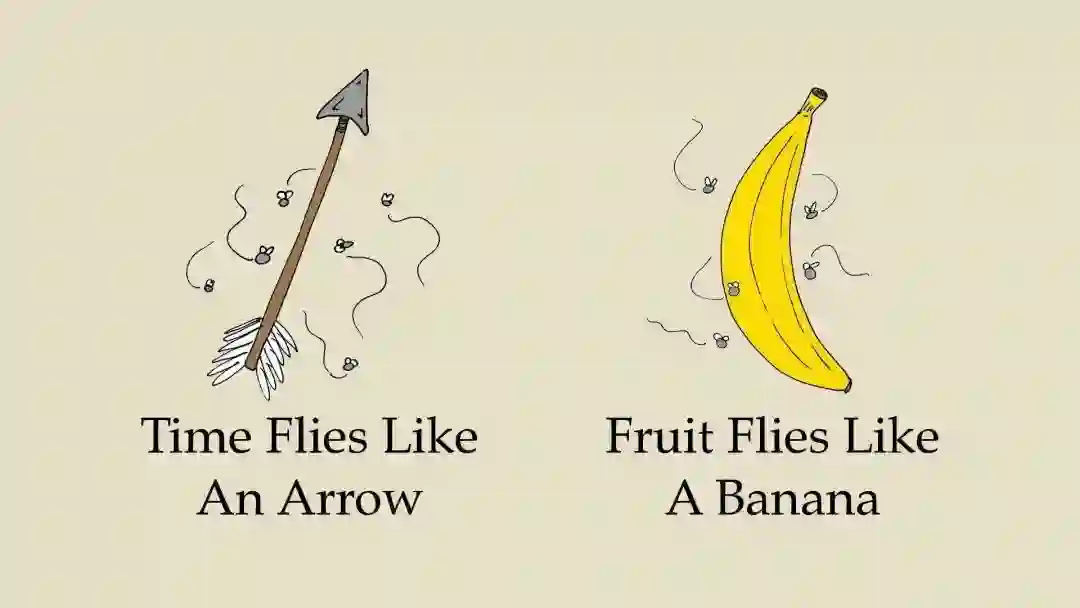

Time flies like an arrow.

时光苍蝇喜欢一支箭.

枯燥的研究中充满乐趣,对于做自然语言处理(NLP)的人来说更是如此。语言的丰富性常常会导致理解的歧义,这一方面为NLP研究带来了巨大的挑战,而同时也给这群乐在其中的NLPer 带来许多自我调侃的乐趣。

在日常生活中,这些NLPer 对于语言的敏感和“特殊癖好”常常难以向常人道,而微博则提供了一个平台,让这些共同爱好者欢快地交流彼此的乐趣。

我国著名NLP学者刘群教授(目前担任华为诺亚方舟实验室语音语义首席科学家)便是这样一位真正热爱自然语言的学者,在微博中,他与清华刘知远副教授并为#自然语言理解太难了#的两位大咖。

昨晚深夜,刘群教授在微博发了这样一个推送(如果关注他的微博会发现,这是常态)。

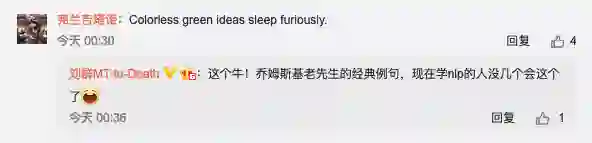

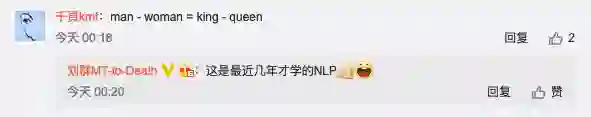

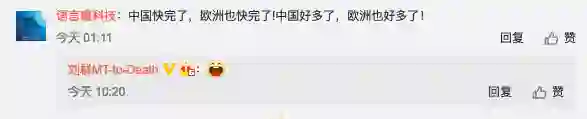

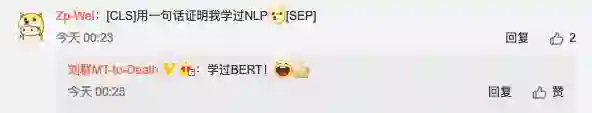

如何用一句话证明你学过 NLP?这引来大量 NLPers 的围观和自我调侃。如下截取部分:

解析:这个句子用来说明句法可以脱离语义独立存在;这个句子语法上没有任何问题,但意义上完全无法解释。(刘群)

解析:自然语言处理中最为经典的词类比:国王-男人+女人=皇后。出自2013年Tomas Mikolov发表的《Efficient estimation of word representations in vector space》。

解析:「Time flies like an arrow. Fruit flies like a banana.」是一个幽默说法,这是语言歧义的经典案例。「时间苍蝇喜欢箭,果蝇喜欢香蕉」

解析:[CLS]为BERT的第一个标志,而每句话结尾必须是[SEP]。

解析:NLP 课程上一个翻译的玩笑,how are you?怎么是你?how old are you?怎么老是你?(刘群)

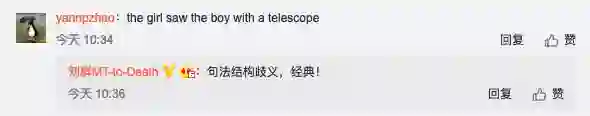

解析:这女孩用望远镜看到那个男孩 or 这个女孩看到了那个带望远镜的男孩。经典句法歧义。

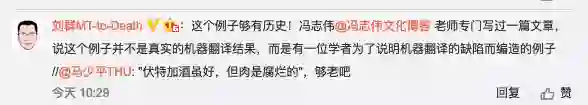

解析:在机器翻译研究的初期,人们经常举一个例子来说明机器翻译任务的艰巨性。在英语中“The spirit is willing but the flesh is weak.”,意思是“心有余而力不足”。但是当时的某个机器翻译系统将这句英文翻译到俄语,然后再翻译回英语的时候,却变成了“The Voltka is strong but the meat is rotten.”,意思是“伏特加酒是浓的,但肉却腐烂了”。从字面意义上看,“spirit”(烈性酒)与“Voltka”(伏特加)对译似无问题,而“flesh”和“meat”也都有肉的意思。那么这两句话在意义上为什么会南辕北辙呢?关键的问题就在于在翻译的过程中,机器翻译系统对于英语成语并无了解,仅仅是从字面上进行翻译,结果自然失之毫厘,差之千里。 (刘知远)

类似这样的内容,在刘群教授的微博经常会出现,他也以此为乐。

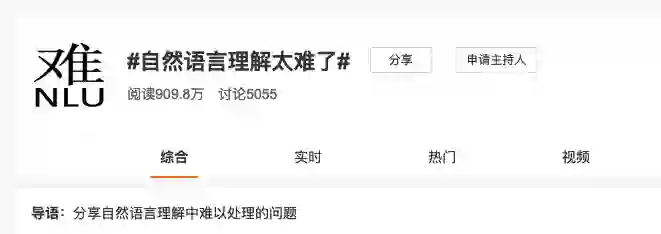

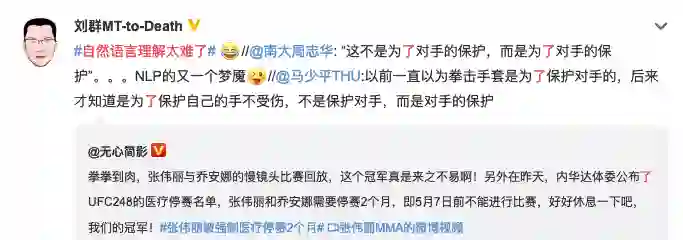

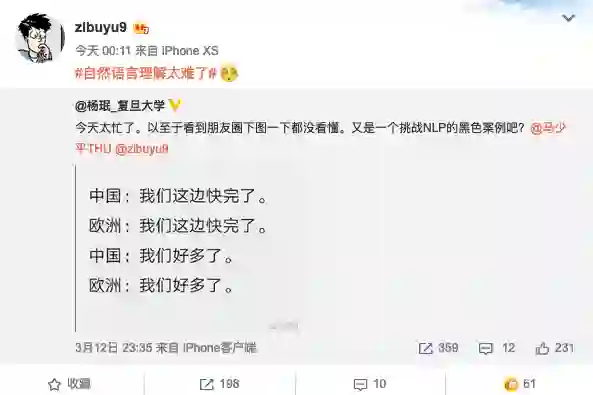

事实上,在微博上有一个最大的调侃聚集地,便是热门话题 #自然语言理解太难了#:

这里面多是一些国内知名的自然语言处理大咖,例如刘群、马少平、邱锡鹏、陈博兴、王斌、者刘知远副教授等。

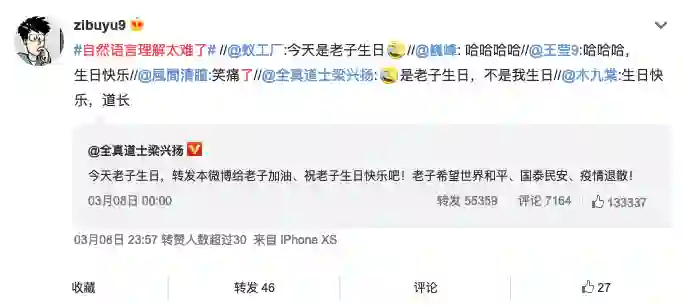

只有那些真正热爱自然语言的人才会时刻关注着生活当中语言的歧义与丰富。我们在此也列举最近几天在话题中的部分内容,可一窥这个聚集地的烧脑,

回归原题,所以,你如何用一句话证明学过 NLP 呢?

——END——

![]()

![]()