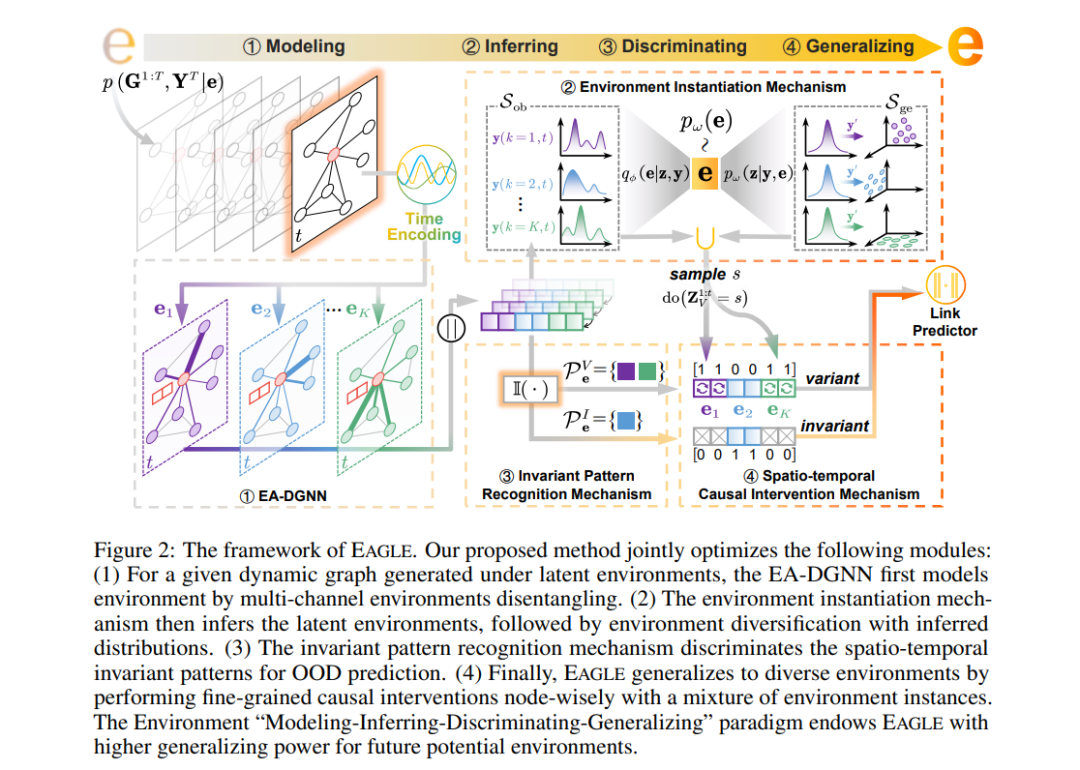

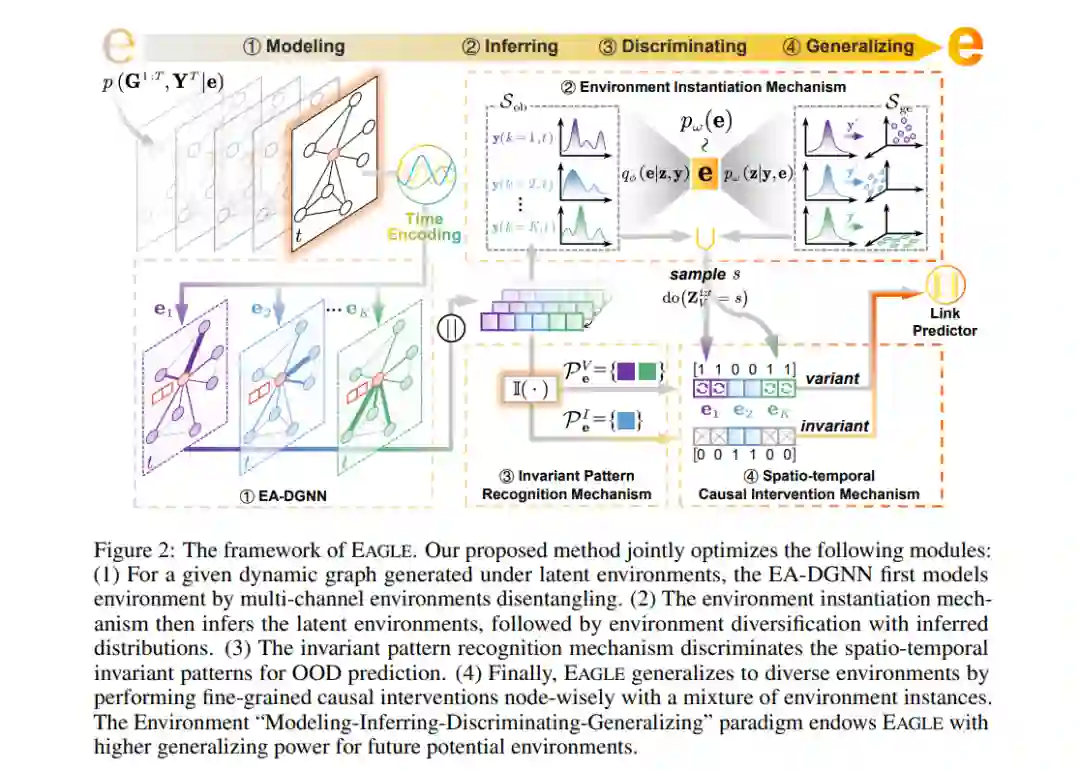

动态图神经网络(DGNNs)在利用动态图上的时空模式方面越来越普遍。然而,现有工作在分布转移下的泛化能力不足,这在现实世界场景中很常见。由于动态图的生成受潜在环境的强烈影响,调查它们对超出分布(OOD)泛化的影响至关重要。然而,面对以下两个主要挑战,这仍然是一个未探索的领域:(1)如何正确地建模和推断动态图上具有分布转移的复杂环境?(2)在推断出的时空环境下,如何发现不变模式?为了解决这些挑战,我们提出了一种新颖的环境感知动态图学习(EAGLE)框架,通过建模复杂的耦合环境和利用时空不变模式来实现OOD泛化。具体来说,我们首先设计了环境感知EADGNN,通过多通道环境解耦来建模环境。然后,我们提出了一种环境实例化机制,用于具有推断分布的环境多样化。最后,我们通过不变模式识别机制对超出分布的预测进行时空不变模式的区分,并通过混合实例化环境样本对节点进行细粒度因果干预。在真实世界和合成动态图数据集上的实验表明,我们的方法在分布转移下优于最先进的基准。据我们所知,我们是第一个从环境学习角度研究动态图上OOD泛化的团队。

成为VIP会员查看完整内容

相关内容

Arxiv

42+阅读 · 2023年4月19日

Arxiv

224+阅读 · 2023年4月7日