尽管深度神经网络在过去十年中展现出卓越性能,但其在资源受限且动态变化的现实场景(如移动医疗)中的部署仍面临重大挑战。大型模型虽精度优异,却难以满足边缘设备的实时性需求;轻量级模型虽计算高效,却常因域偏移(domain shifts)导致鲁棒性与泛化性下降。 本论文提出TempT(测试时时序一致性自适应),一种无需标注数据的测试时自适应(TTA)新范式。其核心创新包括:

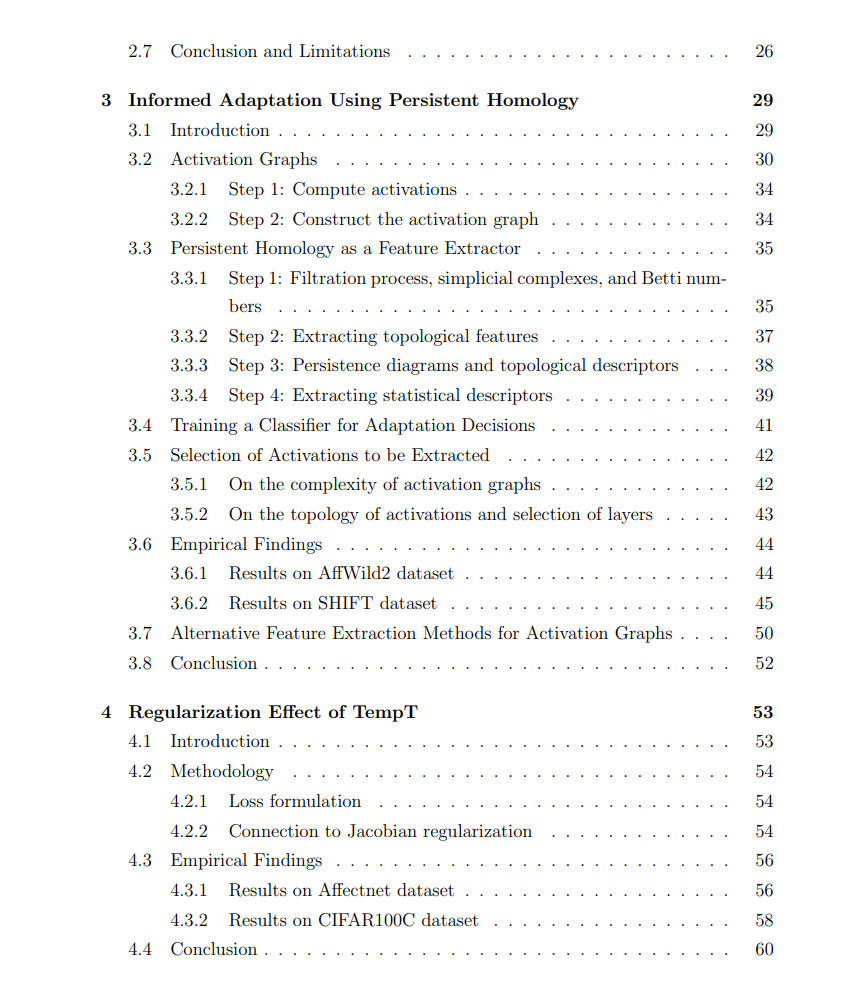

时序相干性约束 * 将输入序列的时序连贯性作为自监督信号,通过抑制预测结果的高频波动,提升模型在未知环境中的稳定性与性能(如视频表情识别、目标检测等跨帧一致性关键任务)。 1. 拓扑数据分析引导

采用持续同调(Persistent Homology)量化网络激活的拓扑特征,构建选择性自适应策略,动态判断何时调整模型参数可提升性能,何时可能引发退化。 1. 新型正则化方法

基于时序一致性设计正则项,显著增强模型对域偏移的鲁棒性。

在AffWild2、SHIFT和CIFAR100P等真实数据集上的实验表明,TempT不仅超越现有TTA方法,更使轻量模型达到媲美大型架构的性能,同时满足隐私保护与低算力需求。本研究弥合了域适应与自监督学习的鸿沟,为受限环境下的深度学习提供了可扩展解决方案。

成为VIP会员查看完整内容

相关内容

斯坦福大学(StanfordUniversity)位于加利福尼亚州,临近旧金山,占地35平方公里,是美国面积第二大的大学。它被公认为世界上最杰出的大学之一,相比美国东部的常春藤盟校,特别是哈佛大学、耶鲁大学,斯坦福大学虽然历史较短,但无论是学术水准还是其他方面都能与常春藤名校相抗衡。斯坦福大学企业管理研究所和法学院在美国是数一数二的,美国最高法院的9个大法官,有6个是从斯坦福大学的法学院毕业的。

Arxiv

204+阅读 · 2023年4月7日

Arxiv

12+阅读 · 2021年10月4日