人脸识别的优化解决方案

当人工智能的任务是视觉识别物体和面部时,它会将其网络的特定组件分配给面部识别——就像人脑一样。

概述

人的大脑似乎非常关心面孔,它专门有用于识别人脸的特定区域,那里的神经元非常擅长其工作,以至于我们大多数人都可以很容易地识别出成千上万的个体。借助人工智能,计算机现在可以以相似的效率识别人脸——麻省理工学院麦戈文脑研究所的神经科学家发现,经过训练以识别人脸和其他物体的计算网络,发现了一种令人惊讶的类似于大脑的策略来将它们全部分类。

这一发现于 3 月 16 日发表在《科学进展》杂志上,表明数百万年人脑回路进化已经优化了我们的面部识别系统。。

“人脑的解决方案是将人脸处理与物体处理分开,”Katharina Dobs 解释说,“这与我们假设任何经过训练以识别面部和对物体进行分类的系统都会找到的解决方案相同,”她补充道。

“这两个完全不同的系统已经找到了一个好的解决方案”,Kanwisher 说。

特定功能的大脑区域

20 多年前,Kanwisher 和她的同事在大脑颞叶中发现了一个对面部有特殊反应的小点。这个被他们命名为梭形面部的区域是 Kanwisher 和其他人发现的大脑区域之一,这些区域专门用于特定任务,例如检测书面文字、感知声乐和理解语言。

Kanwisher 说,当她探索人类大脑的组织方式时,她一直对这种组织方式的原因感到好奇。大脑真的需要特殊的机制来进行面部识别吗?通过一种称为深度神经网络的复杂机器学习,她的团队至少可以找出不同的系统如何处理类似的任务。

Dobs 现在是德国 Justus Liebig 大学 Giessen 的研究小组负责人,他组装了数十万张图像,用于训练深度神经网络进行人脸和物体识别。该系列包括 1,700 多个不同人的面孔和数百种不同的物品,从椅子到芝士汉堡。所有这些都呈现给网络,没有进行标注。“我们从未告诉系统其中一些是面孔,而其中一些是物体。所以这基本上只是一项大任务,”Dobs 说。“它需要识别面部身份,以及自行车或钢笔。”

当该程序学会识别物体和面部时,它将自己组织成一个信息处理网络,其中包括专门用于面部识别的单元。像大脑一样,这种发生在图像处理的后期阶段。在大脑和人工网络中,面部识别的早期步骤涉及更通用的视觉处理机器,最后阶段依赖于面部专用组件。

目前尚不清楚人脸处理机制是如何在大脑中产生的,但根据他们的发现,网络不一定需要先天的人脸处理机制来获得这种专业化。“我们没有在我们的网络中建立任何面孔,”Kanwisher 说。“这些网络设法在没有得到针对特定面孔的推动情况下将自己隔离开 Kanwisher 说,看到深度神经网络将自己分离成不同的部分以进行人脸和物体识别,这令人兴奋。“这就是我们在大脑中观察了 20 多年的东西,”她说。“为什么我们在大脑中有一个单独的人脸识别系统?这告诉我这是因为这就是优化解决方案的样子。”

现在,她渴望使用深度神经网络来提出类似的问题,即为什么其他大脑功能会以这种方式组织起来。她说:“我们有一种新的方式来询问为什么大脑是这样组织的。” “我们在人类大脑中看到的多少结构会通过训练网络来完成类似任务而自发产生?”

论文

摘要

人类大脑包含多个区域,它们具有不同的、通常高度专门化的功能,从识别人脸到理解语言,再到思考别人在想什么。然而,目前还不清楚为什么大脑皮层首先表现出这种高度的专门化功能。在这里,我们考虑使用人工神经网络,以人脸感知为例,来测试大脑中人脸识别的功能分离,反映了对人脸和其他视觉类别更广泛的视觉识别问题的计算优化假设。我们发现,经过物体识别训练的网络在人脸识别上表现得很差,反之亦然,而在这两项任务上都得到优化的网络会自发地将自己划分为人脸和物体的独立系统。然后,我们展示了其他视觉类别在不同程度上的功能隔离,揭示了一种普遍的优化趋势(没有内置的特定任务的归纳偏见),从而导致机器(我们推测也包括大脑)的功能专业化。

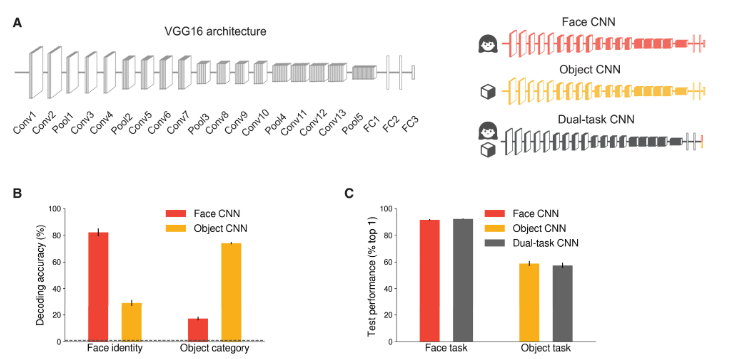

图1:单独训练的 CNN 中的人脸和物体表现不同,而双任务 CNN 表现良好。(A) 优化了三个具有 VGG16 架构的网络(左),一个用于人脸识别分类(红色的人脸 CNN),一个用于物体分类(物体CNN 为橙色),一个同时处理两个任务(双任务 CNN 为灰色)。(B) 使用从 Face CNN 和 Object CNN 的倒数第二层 [即 (A) 中的 FC2] 提取的激活模式,对保留的人脸识别和保留的物体类别进行解码的准确性。Face CNN 在人脸解码方面优于 Object CNN,在物体解码方面反之亦然。因此,为每个任务优化的表示并不自然地支持另一个。灰色虚线表示机会水平 (1%)。误差线表示跨分类折叠的 SEM。(C) 双任务 CNN 对执行的任务和单一网络进行了优化。误差线表示跨类和刺激自举的 95% 置信区间 (CI)。