本材料基于美空军研究实验室(AFRL)与国防高级研究计划局(DARPA)资助的研究撰写。CHANNA项目开发了开源机器学习加速器生成器(名为Gemmini),支持集成至完整片上系统(SoC)设计中。团队还完成了对生成加速器运行各类机器学习(ML)工作负载的评估;验证了该生成器可为广泛ML任务生成具备竞争力的加速器;并开发了新型加速器虚拟化机制AuRORA,为"多加速器-多应用系统"实现虚拟化与解聚式加速器集成。

CHANNA项目旨在开发支持集成至完整SoC设计且具备全软件支持的开源机器学习加速器生成器(Gemmini)。以下为RTML计划期间的关键成果:

● 成功向社区发布多个Gemmini框架版本,该框架现已被多个研究组广泛采用。Gemmini论文发表于DAC’2021并获当年"最佳论文奖"(Best Paper Award)。

● 完成对生成加速器运行各类ML工作负载的评估,包括多个变体的硅基实现(计划期间完成两次流片,第三次将于2023年11月流片)。

● 验证该生成器可为广泛ML任务(含Gemmini初始开发后兴起的基于Transformer的ML任务)生成具备竞争力的加速器。

● 开发自动化Gemmini库开发的软件流程Exo。Exo发表于PLDI’2022,已开源并被产业合作方采用。

● 利用Gemmini评估多加速器系统,并开发新型动态内存资源管理机制MoCA(发表于HPCA’2023)。MoCA软硬件实现已公开。

● 开发新型加速器虚拟化机制AuRORA,为"多加速器-多应用系统"实现虚拟化与解聚式加速器集成。AuRORA发表于MICRO’2023并已开源。

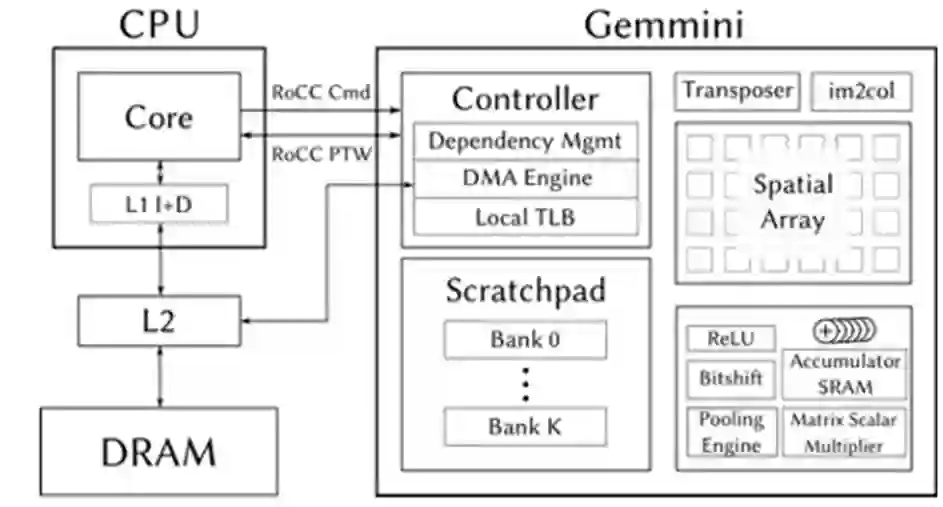

Gemmini是面向深度神经网络(DNN)工作负载的开源全栈加速器生成器,支持对快速演进的DNN工作负载定制硬件加速器系统进行端到端全栈实现与评估。其硬件模板与参数化设计允许用户在性能、效率与可扩展性等多维度调优硬件配置。不同于现有聚焦独立加速器的DNN生成器,Gemmini更提供覆盖软硬件栈的完整解决方案,以及兼容RISC-V生态系统的全片上系统(SoC)集成方案。此外,Gemmini实现多级软件栈:通过易用编程接口支持多样化编程需求,并与支持Linux的SoC深度集成以执行任意软件。开源仓库地址:github.com/ucb-bar/gemmini。相关论文发表于2021年设计自动化会议(DAC)并获当年"最佳论文奖"(Best Paper Award)。

图1:Gemmini硬件架构模板概览