![]() 机器学习领域中,归纳偏差的研究是最为全面的主题之一。归纳偏差不仅定义了学习的效率和速度,还定义了特定机器学习系统最终能学到什么。现代机器学习的历史与心理学、认知科学和神经科学紧密相连,因此许多最有影响力的归纳偏差直接来源于这些领域。例子包括卷积神经网络,其灵感来自于自然视觉系统的组织结构,以及旨在模拟理想化抽象神经回路的人工神经网络本身。然而,鉴于近年来机器学习的巨大成功,人们更多地关注了扩展机器学习系统所面临的工程挑战,而对其归纳偏差的关注较少。本论文将尝试采取相反的方向。为此,我们将覆盖自然相关的学习算法,以及神经表示中固有的自然结构。我们将构建模仿这些自然属性的人工系统,并将展示它们如何有利于计算,并可能帮助我们更好地理解自然智能本身。

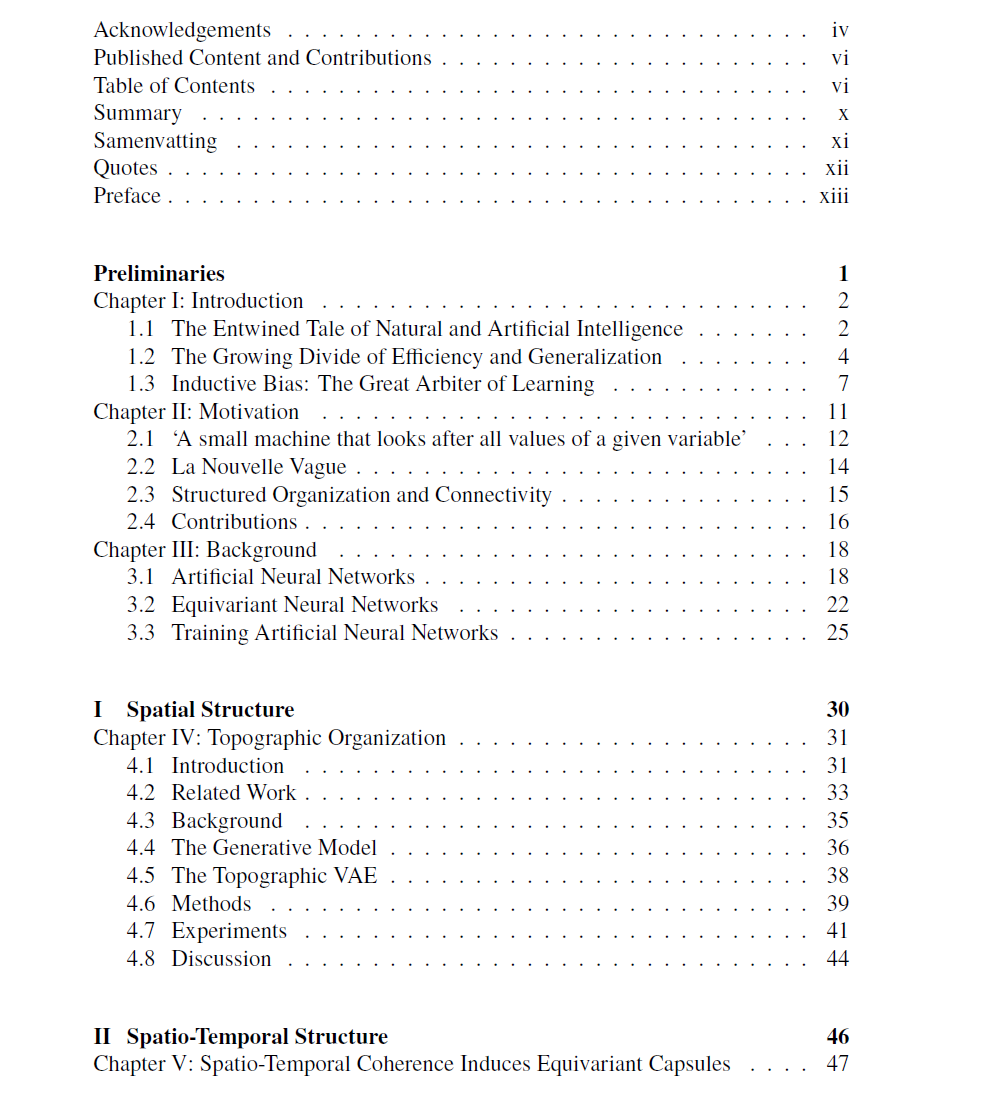

机器学习领域中,归纳偏差的研究是最为全面的主题之一。归纳偏差不仅定义了学习的效率和速度,还定义了特定机器学习系统最终能学到什么。现代机器学习的历史与心理学、认知科学和神经科学紧密相连,因此许多最有影响力的归纳偏差直接来源于这些领域。例子包括卷积神经网络,其灵感来自于自然视觉系统的组织结构,以及旨在模拟理想化抽象神经回路的人工神经网络本身。然而,鉴于近年来机器学习的巨大成功,人们更多地关注了扩展机器学习系统所面临的工程挑战,而对其归纳偏差的关注较少。本论文将尝试采取相反的方向。为此,我们将覆盖自然相关的学习算法,以及神经表示中固有的自然结构。我们将构建模仿这些自然属性的人工系统,并将展示它们如何有利于计算,并可能帮助我们更好地理解自然智能本身。

![]()

![]()