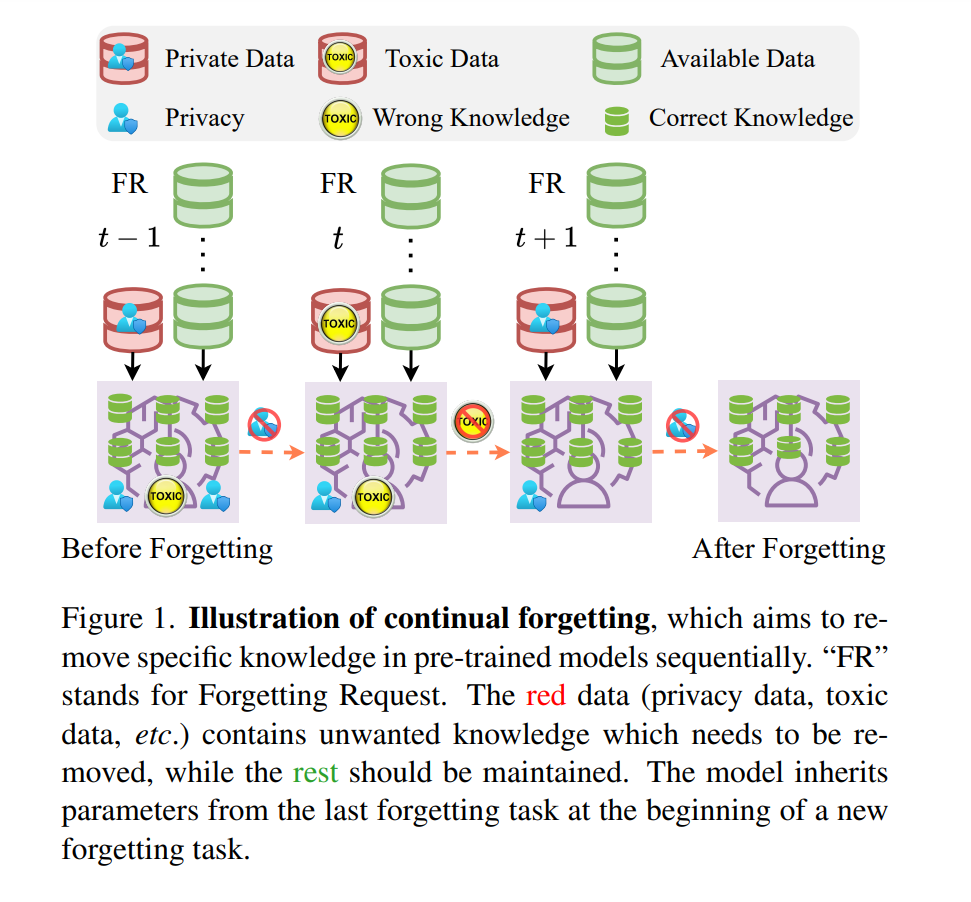

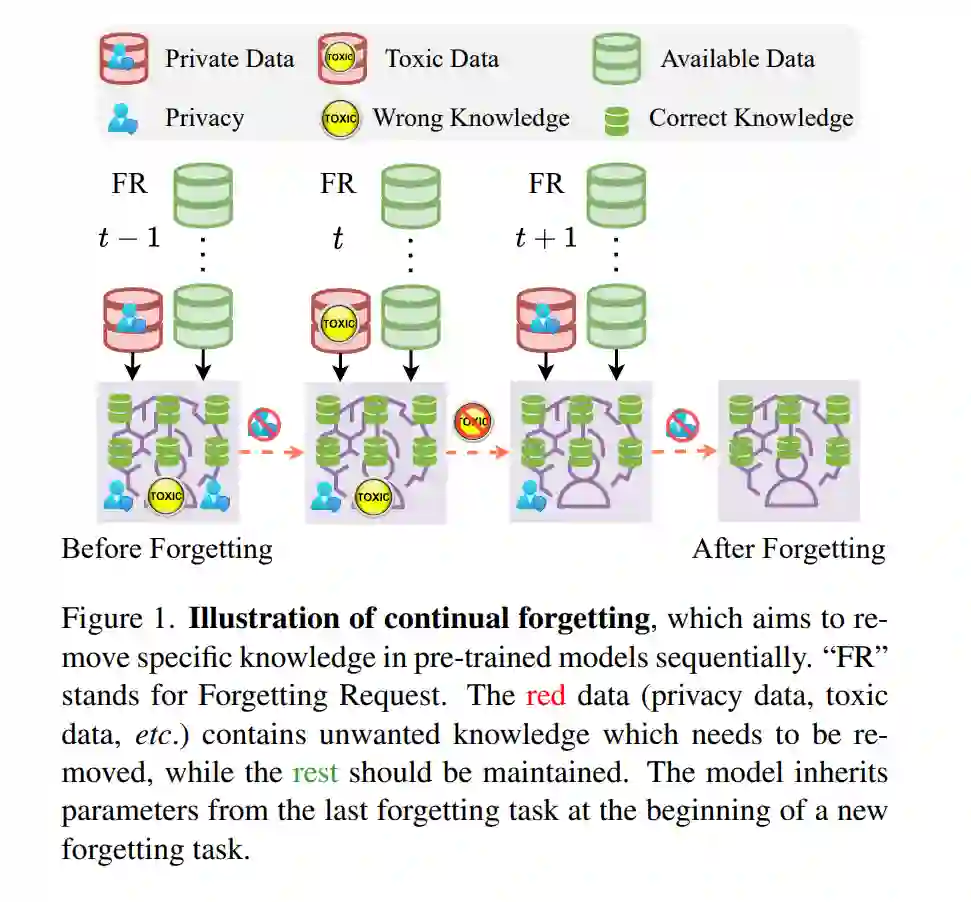

出于隐私和安全考虑,如今变得越来越明显的是,需要从预训练的视觉模型中擦除不需要的信息。在现实世界场景中,用户和模型拥有者可以随时提出擦除请求。这些请求通常形成一个序列。因此,在这样的设置下,期望从预训练模型中连续移除选定信息,同时保留其余信息。我们将这个问题定义为持续遗忘,并确定了两个关键挑战。(i) 对于不需要的知识,有效且高效的删除至关重要。(ii) 对于剩余的知识,遗忘过程带来的影响应尽可能小。为了解决这些问题,我们提出了群稀疏LoRA(GS-LoRA)。具体来说,针对(i),我们使用LoRA模块独立地对Transformer块中的FFN层进行微调,以应对每个遗忘任务,并针对(ii),采用了简单的群稀疏正则化,实现了特定LoRA群组的自动选择并将其他群组归零。GS-LoRA有效、参数高效、数据高效且易于实现。我们在面部识别、对象检测和图像分类上进行了广泛实验,并展示了GS-LoRA能够在对其他类别影响最小的情况下忘记特定类别。代码将在 https://github.com/bjzhb666/GS-LoRA 上发布。

成为VIP会员查看完整内容

相关内容

Arxiv

42+阅读 · 2023年4月19日