本文将介绍华为诺亚推荐与搜索实验室和上海交通大学APEX实验室的联合研究成果,关于深度点击率预估模型的综述。本论文是第一篇系统性介绍深度点击率预估模型的综述,且被IJCAI 2021 Survey Track收录。

论文:Deep Learningfor Click-Through Rate Estimation, https://arxiv.org/abs/2104.10584 (点击底部左下角“阅读原文”可直接进入)

点击率预估问题背景

点击率预估 (CTR estimation) 是在线信息系统的核心模块之一,广泛应用于推荐系统、付费广告、搜索引擎等产品和业务中。随着深度学习的广泛应用,深度点击率预估模型被广泛用于工业界的线上系统中,并取得了显著的业务效果提升。

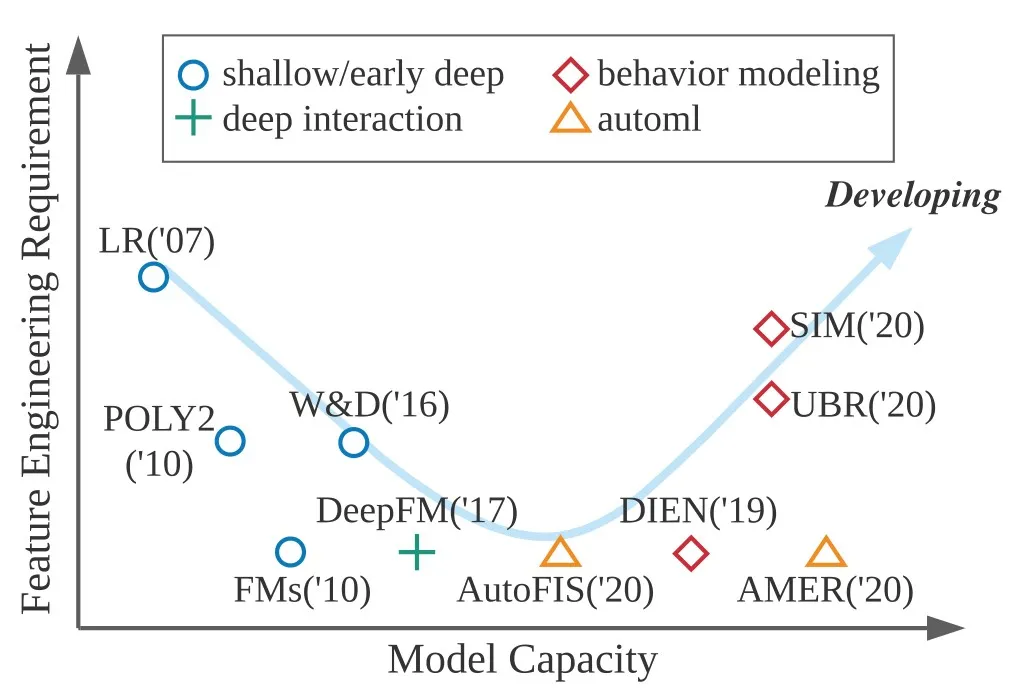

本文首先回顾浅层模型到深度CTR模型的演化过程,之后重点介绍近年来深度CTR模型发展主要集中的三个方面:深度特征交互模型、深度行为模型和AutoML在深度CTR模型中的应用。我们从模型capacity和对特征工程的需求程度这两个维度总结了CTR模型的发展脉络,如图1。一方面,从浅层模型到深度模型,由于模型建模能力的增强,对于特征工程的需求在下降,不再需要对特征工程进行过多的人工干预。而另一方面,随着模型复杂度的增加以及设计更复杂模型带来的边际收益减小,开始有工作重新将注意力集中到如何设计和抽取更有效的特征,并通过可学习的方式自动进行特征工程。将复杂模型与更好的特征工程融合是目前深度CTR模型发展的重要趋势。

图1:CTR预测模型发展趋势

从浅层CTR模型到早期深度CTR模型

早期的浅层模型以LR为起点,通过线性函数建模特征。POLY2 [1]在一阶特征之外引入二阶特征,但无法较好地处理二阶特征稀疏性带来的问题。FM[2]及其各种变体(如FFM、HOFM、FwFM等)在POLY2的基础上将交互特征建模为低维的稠密向量的乘积,较好地解决了高阶特征交互稀疏的问题。

随着深度学习的兴起,DNN开始被应用于CTR任务中。早期的深度CTR模型将稀疏特征表达为低维稠密向量(feature embedding)并在拼接后直接输入DNN。Wide&Deep [3]、DeepCross [4]等模型为这个时期的代表工作。虽然这些工作取得了显著的效果提升,但是一些研究工作[5, 6]发现DNN并不能很好地学习到特征交互的模式。因此,我们在第三章讨论深度特征交互模型,第四章讨论深度行为模型,第五章讨论自动网络搜索模型。这三类模型的关系为:(1) 特征交互的学习主要聚焦于在同一条样本的特征之间挖掘交互模式,(2) 用户行为建模探索同一个用户不同样本之间的依赖关系,(3) 而自动网络搜索模型尝试去自动化地设计上述两类模型结构。

深度特征交互模型

特征交互建模对CTR模型的预测能力至关重要,但是仅仅依靠DNN很难有效学习复杂的特征交互 [5, 6]。因此很多工作探索DNN结合不同的算子显式建模特征交互来提升DNN的建模能力。

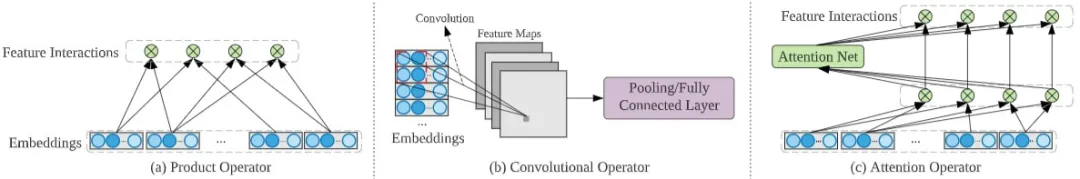

图2:三种典型的特征交互算子

典型的用于特征交互建模的算子可以分为三类:乘积算子,卷积算子和注意力算子,如图2所示。PNN [7]、DeepFM[8]等工作采用乘积算子如內积、外积等来显式建模特征交互;CCPM [9]、FGCNN [10]等工作采用欧式空间或图上的卷积来建模特征交互;AFM [11]、FiBiNET [12]则聚焦于采用注意力算子给特征交互赋予不同的注意力权重以提升推荐性能。

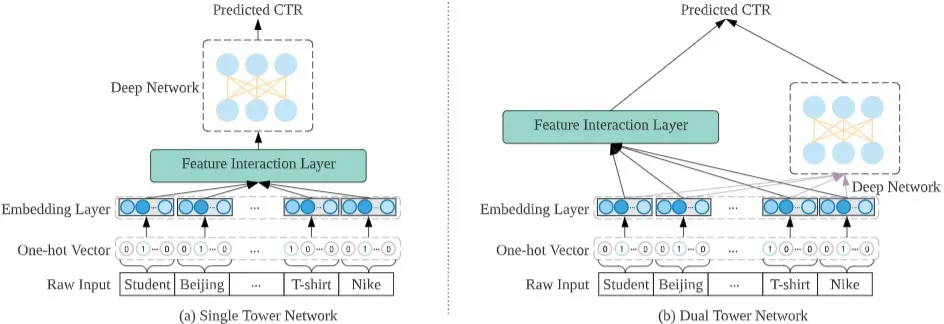

特征交互的算子除了类型的不同之外,它们和DNN的结合模式也得到了大量的研究。根据结合方式的不同,已有的工作可以分为两类:单塔网络和双塔网络,如图3所示。单塔网络将特征交互算子和DNN串行放置,双塔网络将特征交互算子和DNN并行放置。一般来说,单塔网络的模型capacity更大,但双塔网络训练更平稳,实际性能更好。

图3:单塔和双塔CTR网络结构

深度行为模型

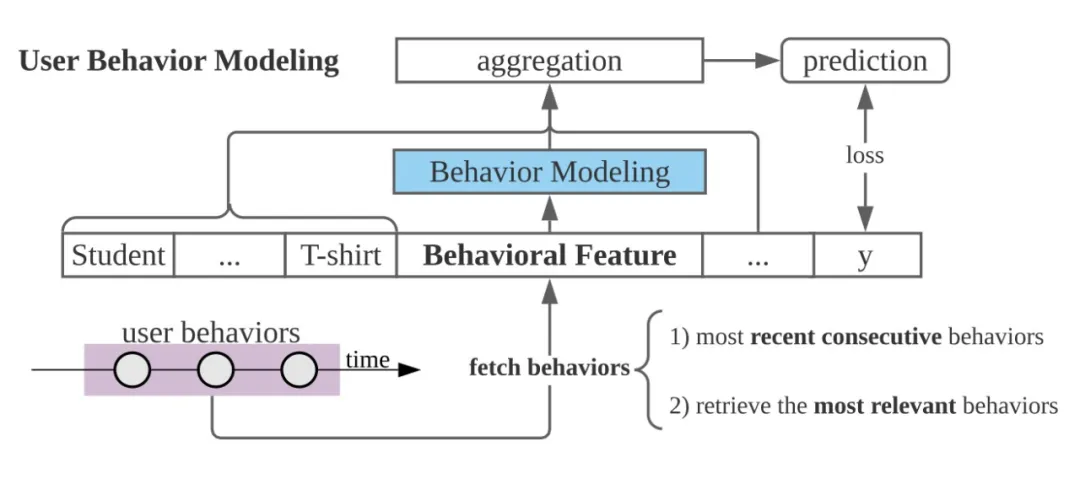

深度行为模型重点学习用户的行为模式,通过对用户历史行为的建模预测其未来的行为,捕捉用户兴趣随时间的变化。如图4所示,用户的行为特征是一个多值特征,深度行为模型通过各种不同的结构将用户行为学习为一个统一的表达并与其他特征拼接在一起进行CTR预测。

图4:用户行为模型的通用框架

对于深度行为CTR模型,按照技术路线的不同,可以大致分为三类。第一类是基于注意力机制的模型,典型代表为DIN [13]、DIEN [14]、BST、DSIN等。注意力机制主要用来对不同的用户行为赋予不同的重要性。第二类是基于记忆神经网络的模型,这类模型重点建模超长序列的用户行为,典型代表如HPMN [15],MIMN [16]等。第三类是基于检索的行为模型,这类方法根据预测目标的不同,动态地从用户长时间的历史序列中检索出合适的行为辅助CTR预测,这类模型主要包括UBR4CTR [17]与SIM [18]等。用户行为建模是深度CTR模型发展中的一个重要路线。

自动网络搜索模型

自动网络搜索模型通过AutoML技术,对深度推荐模型的各个部分进行自动化的设计。根据应用在不同分不分,这些自动网络搜索模型可以分为三类。第一类是为每个特征自动化设计feature embedding的维度。其中,有的工作 [19, 20]将这项任务建模成离散选择过程,通过强化学习 (RL) 来进行搜索;有的工作将这项任务建模成连续选择过程,通过hardselection [21, 22]或者soft selection [23, 24]方式来找到合适的embedding维度。第二类是自动化地筛选或者生成有效的特征交互。其中,AutoFIS[25]自动化地筛选有效的特征交互,SIF [26]、AutoFeature[27] 自动为不同的特征交互设计不同的交互函数,AutoGroup [28]自动化地生成有效的特征集合。第三类是对整个网络架构的自动搜索,AutoCTR [29]自动探索多种子模块之间关系以生成网络架构,AMER [30]同时自动探索有效的特征交互和有效的用户行为建模方式。

尽管深度CTR模型近年来飞速发展,取得了巨大的成功,但是这个领域依然面临一些挑战。第一,尽管许多深度CTR模型被提出,但是很少有工作研究这些模型的深度学习理论。第二,预训练技术在深度CTR模型中没有被很好的研究。第三,多模态特征在深度CTR模型中没有得到很好的应用。第四,没有将数据预处理和特征选取过程与深度CTR模型的训练结合起来。

相关文献

[1] Yin-Wen Chang, Cho-Jui Hsieh, Kai-WeiChang, Michael Ringgaard, and Chih-Jen Lin. Training and testing low-degree polynomial data mappings via linear svm. Journal of Machine Learning Research,11(4), 2010.

[2] Steffen Rendle. Factorization machines.In ICDM, 2010.

[3] Heng-Tze Cheng, Levent Koc, Jeremiah Harmsen, Tal Shaked, Tushar Chandra, Hrishi Aradhye, Glen Anderson, Greg Corrado, Wei Chai, Mustafa Ispir, et al. Wide & deep learning for recommender systems. In 1st DLRS workshop, pages 7–10, 2016.

[4] Ying Shan, T Ryan Hoens, Jian Jiao,Haijing Wang, Dong Yu, and JC Mao. Deep crossing: Webscale modeling without manually crafted combinatorial features. In KDD, pages 255–262, 2016.

[5] Yanru Qu, Bohui Fang, Weinan Zhang, Ruiming Tang, Minzhe Niu, Huifeng Guo, Yong Yu, and Xiuqiang He.Product-based neural networks for user response prediction over multi-field categorical data. TOIS, 37(1):1–35, 2018.

[6] Steffen Rendle, Walid Krichene, Li Zhang, and John Anderson. Neural collaborative filtering vs. matrix factorization revisited. In RecSys, 2020.

[7] Yanru Qu, Han Cai, Kan Ren, Weinan Zhang, Yong Yu, Ying Wen, and Jun Wang. Product-based neural networks for user response prediction. In ICDM, pages 1149–1154, 2016.

[8] Huifeng Guo, Ruiming Tang, Yunming Ye, Zhenguo Li, and Xiuqiang He. Deepfm: a factorization-machine based neural network for ctr prediction. IJCAI,2017.

[9] Qiang Liu, Feng Yu, Shu Wu, and Liang Wang. A convolutional click prediction model. In CIKM, 2015.

[10] Bin Liu, Ruiming Tang, Yingzhi Chen,Jinkai Yu, Huifeng Guo, and Yuzhou Zhang. Feature generation by convolutional neural network for click-through rate prediction. In WWW, pages 1119–1129,2019.

[11] Jun Xiao, Hao Ye, Xiangnan He,Han-wang Zhang, Fei Wu, and Tat-Seng Chua. Attentional factorization machines: Learning the weight of feature interactionsvia attention networks. IJCAI, 2017.

[12] Tongwen Huang, Zhiqi Zhang, andJun-lin Zhang. Fibinet: combining feature importance and bilinear feature interaction for click-through rate prediction. InRecSys, pages 169–177, 2019.

[13] Guorui Zhou, Xiaoqiang Zhu, ChenruSong, Ying Fan, Han Zhu, Xiao Ma, Yanghui Yan, Junqi Jin, Han Li, and Kun Gai.Deep interest network for click- through rate prediction. In KDD, 2018.

[14] Guorui Zhou, Na Mou, Ying Fan, Qi Pi,Weijie Bian, Chang Zhou, Xiaoqiang Zhu, and Kun Gai. Deep interest evolution network for click-through rate pre- diction. In AAAI, volume 33, pages5941–5948, 2019.

[15] Kan Ren, Jiarui Qin, Yuchen Fang, WeinanZhang, Lei Zheng, Weijie Bian, Guorui Zhou, Jian Xu, Yong Yu, Xiaoqiang Zhu, etal. Lifelong sequential modeling with personalized memorization for user response prediction. In SIGIR, 2019.

[16] Qi Pi, Weijie Bian, Guorui Zhou,Xiaoqiang Zhu, and Kun Gai. Practice on long sequential user behavior modeling for click-through rate prediction. In KDD, 2019.

[17] Jiarui Qin, W. Zhang, Xin Wu, Jiarui Jin, Yuchen Fang, and Y. Yu. User behavior retrieval for click- through rate prediction. In SIGIR, 2020.

[18] Pi Qi, Xiaoqiang Zhu, Guorui Zhou,Yujing Zhang, Zhe Wang, Lejian Ren, Ying Fan, and Kun Gai. Search-based user interest modeling with lifelong sequential behavior data for click-through rate prediction. In CIKM, 2020.

[19] Manas R. Joglekar, Cong Li, Mei Chen,Taibai Xu, Xiaoming Wang, Jay K. Adams, Pranav Khaitan, Jiahui Liu, and Quoc V. Le. Neural input search for large scale recommendation models. In KDD, 2020.

[20] Haochen Liu, Xiangyu Zhao, Chong Wang,Xiaobing Liu, and Jiliang Tang. Automated embedding size search in deep recommender systems. In SIGIR, pages 2307–2316, 2020.

[21] Weiyu Cheng, Yanyan Shen, and Linpeng Huang. Differentiable neural input search for recommender systems. CoRR,abs/2006.04466, 2020.

[22] Siyi Liu, Chen Gao, Yihong Chen, Depeng Jin, and Yong Li. Learnable embedding sizes for recommender systems. CoRR,abs/2101.07577, 2021.

[23] Xiangyu Zhao, Haochen Liu, Hui Liu,Jiliang Tang, Weiwei Guo, Jun Shi, Sida Wang, Huiji Gao, and Bo Long.Memory-efficient embedding for recommendations. CoRR, abs/2006.14827, 2020.

[24] Xiangyu Zhao, Chong Wang, Ming Chen,Xudong Zheng, Xiaobing Liu, and Jiliang Tang.Autoemb: Automated embedding dimensionality search in streaming recommendations. CoRR, abs/2002.11252, 2020.

[25] Bin Liu, Chenxu Zhu, Guilin Li, Weinan Zhang, Jincai Lai, Ruiming Tang, Xiuqiang He, Zhenguo Li, and Yong Yu. Autofis:Automatic feature interaction selection in factorization models for click-through rate prediction. In KDD, pages 2636–2645, 2020.

[26] Quanming Yao, Xiangning Chen, James T.Kwok, Yong Li, and Cho-Jui Hsieh. Efficient neural interaction function searchfor collaborative filtering. In WWW, pages 1660–1670, 2020.

[27] Farhan Khawar, Xu Hang, Ruiming Tang,Bin Liu, Zhenguo Li, and Xiuqiang He. Autofeature: Searching for feature interactions and their architectures for click-through rate prediction. InCIKM, 2020.

[28] Bin Liu, Niannan Xue, Huifeng Guo,Ruiming Tang, Stefanos Zafeiriou, Xiuqiang He, and Zhenguo Li. Autogroup:Automatic feature grouping for modelling explicit high-order feature interactions in ctr prediction. In SIGIR, pages 199–208, 2020.

[29] Qingquan Song, Dehua Cheng, Hanning Zhou, Jiyan Yang, Yuandong Tian, and Xia Hu. Towards automated neural interaction discovery for click-through rate prediction. In KDD, pages 945–955,2020.

[30] Pengyu Zhao, Kecheng Xiao, Yuanxing Zhang, Kaigui Bian, and Wei Yan. AMER: automatic behavior modeling and interaction exploration in recommender system. CoRR, abs/2006.05933, 2020.