论文题目: Adversarial Explanations for Understanding ImageClassification Decisions and Improved NeuralNetwork Robustness

论文摘要

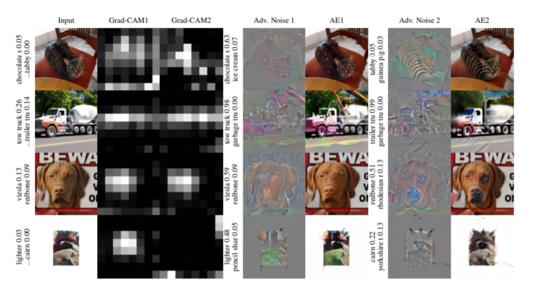

对于医学成像或欺诈检测等敏感问题,由于担心其可靠性,采用神经网络(NN)的速度一直较慢,因此出现了许多解释其决策的算法。人们还发现,网络信息系统很容易受到一系列不易察觉的攻击,这些攻击被称为“抵抗性攻击”(dadversarial),会随意改变网络的输出。在这里,我们证明了这些攻击可以使先前试图解释NNs决策的努力无效,并且在非常健壮的网络中,攻击本身可以被认为是对模型更忠实的解释。我们发现,在Lipschitz约束的启发下,引入了一种新的正则化技术以及其它的改进建议,极大地提高了神经网络对反例的抵抗力。在ImageNet分类任务中,我们展示了一个精度-鲁棒性区域(ARA)为0.0053的网络,ARA为先前技术水平的2.4倍。改善神经网络决策的机制是一个重要的方向,这不仅有助于在敏感的神经网络中建立信任,也有助于进一步了解神经网络对刺激的反应。

论文作者

Christof Teuscher在瑞士洛桑获得了瑞士联邦技术学院的理学硕士学位和博士学位。在获得博士学位时,他探讨了艾伦·图灵(Alan Turing)关于人工智能和神经网络的想法。目前为波特兰州立大学Maseeh学院教授,Teuscher的团队开发了具有破坏性的新计算范式和机器,这将在未来5-20年内带来持久的突破,并开辟新的应用领域。这一探索的动机是,随着CMOS电路的特征尺寸缩放和“摩尔定律”进一步放缓,人们的注意力正转向非冯·诺依曼、非CMOS和非布尔计算模型的计算。Teuscher的团队采用激进的跨学科方法,将计算机科学、计算机工程、物理、生物、复杂系统科学和认知科学等工具应用于下一代计算模型和架构的研究和设计。

Walt Woods是波特兰州立大学特舍尔实验室的研究生,研究兴趣为人工智能、纳米技术、神经形态计算。