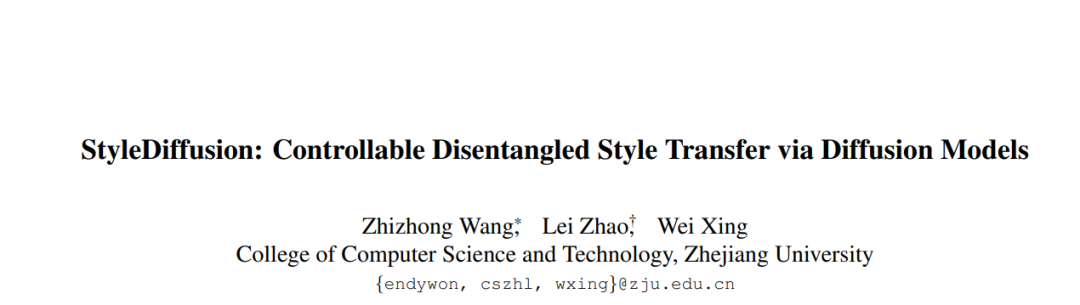

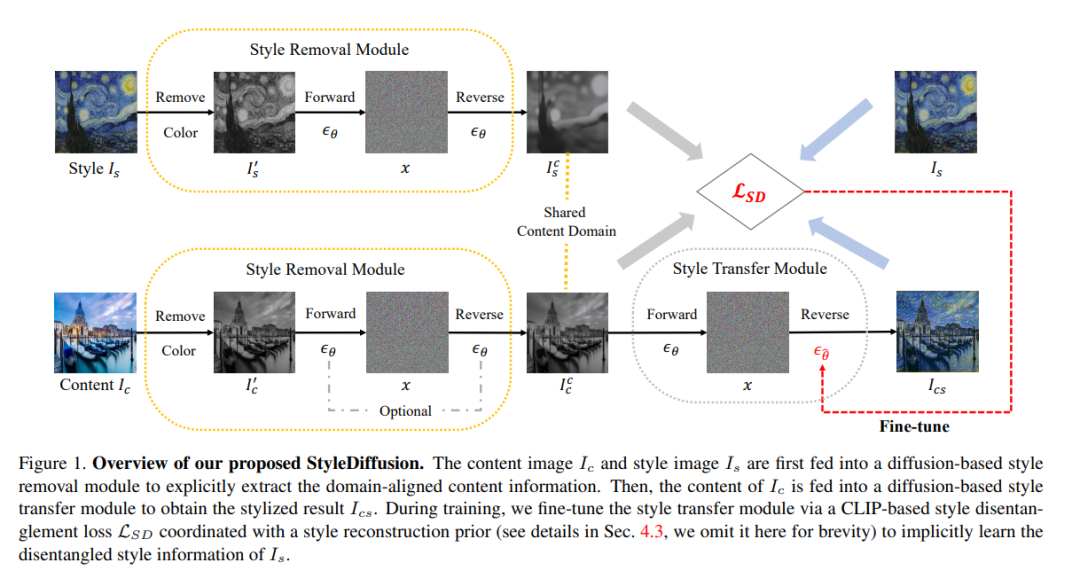

内容与风格(C-S)的解耦是风格转移中的基本问题和关键挑战。基于明确的定义(例如,Gram矩阵)或隐式学习(例如,GANs)的现有方法既不可解释也不易于控制,导致了交织的表示和不太令人满意的结果。在这篇论文中,我们提出了一种新的C-S解耦风格转移框架,不使用之前的假设。关键的洞见是明确地提取内容信息并隐式地学习互补的风格信息,从而产生可解释和可控的C-S解耦和风格转移。我们引入了一个简单而有效的基于CLIP的风格解耦损失,与风格重建先验协同工作,以在CLIP图像空间中解耦C-S。通过进一步利用扩散模型的强大风格去除和生成能力,我们的框架比现有的技术获得了更好的结果,并具有灵活的C-S解耦和权衡控制。我们的工作为风格转移中的C-S解耦提供了新的洞见,并展示了扩散模型在学习良好解耦的C-S特征方面的潜力。

https://www.zhuanzhi.ai/paper/8d378770385d06a12fb8c52a58f315f4

成为VIP会员查看完整内容

相关内容

Arxiv

42+阅读 · 2023年4月19日