题目:* Meta-Learning without Memorization

摘要:

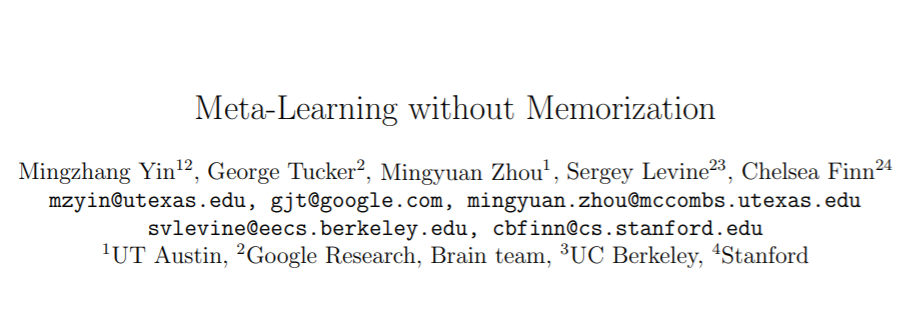

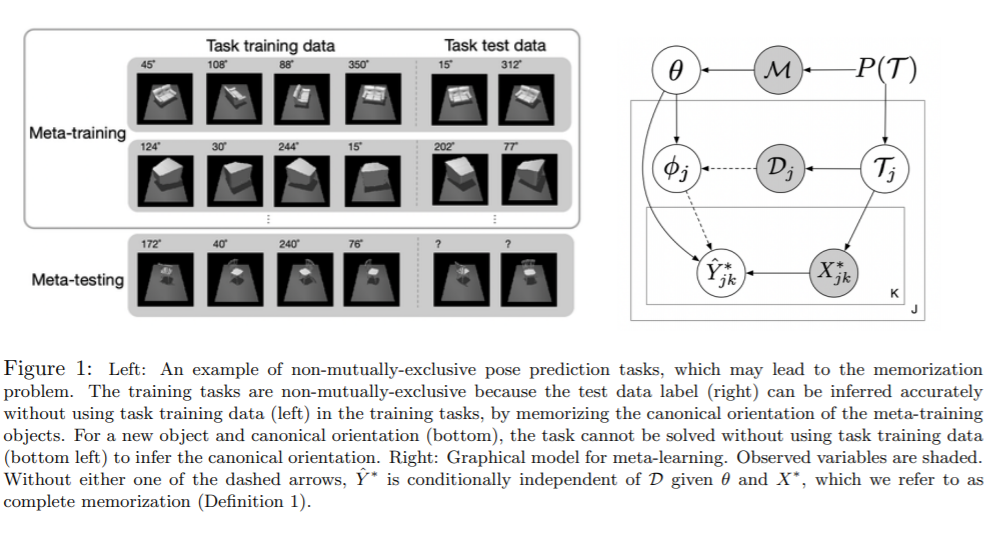

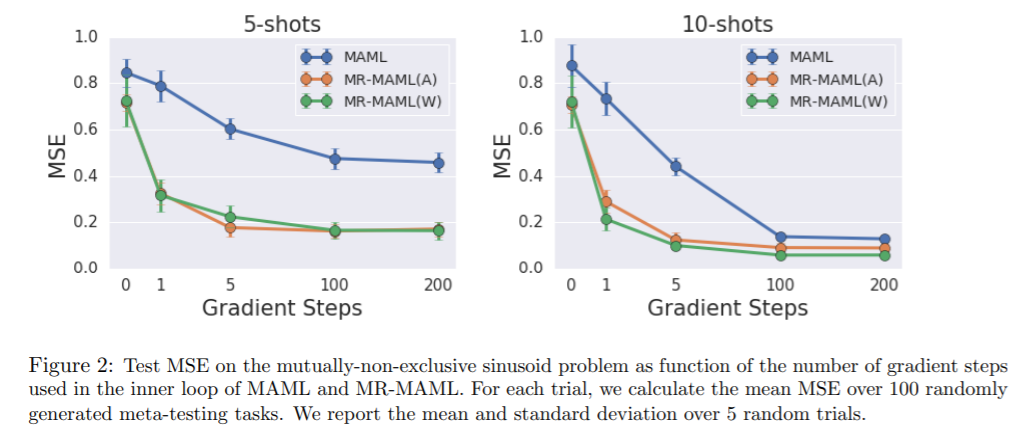

元学习已经成为一种很有前途的技术,它可以利用以前任务中的数据来高效地学习新任务。然而,大多数元学习算法都隐含地要求元训练任务是互斥的,这样就没有一个模型可以同时解决所有的任务。例如,在为少镜头图像分类创建任务时,先前的工作使用每个任务随机分配图像类到N-way分类标签。如果不这样做,元学习者可以忽略任务训练数据,学习一个模型来执行所有的元训练任务,但不能有效地适应新的图像类。这个需求意味着用户在设计任务时必须非常小心,例如通过打乱标签或从输入中删除任务标识信息。在某些领域,这使得元学习完全不适用。在这篇论文中,我们通过使用信息论设计一个元正则化目标来解决这一挑战,信息论优先考虑数据驱动的适应。这导致元学习者决定必须从任务训练数据中学习什么,以及应该从任务测试输入中推断什么。通过这样做,我们的算法可以成功地使用来自非互斥任务的数据来有效地适应新的任务。我们证明了它对上下文和基于梯度的元学习算法的适用性,并将其应用于实际环境中,在那里应用标准的元学习是困难的。在这些设置中,我们的方法大大优于标准的元学习算法。

作者简介:

Mingzhang Yin是得克萨斯大学奥斯汀分校统计与数据科学系的博士生。Mingzhang Yin对贝叶斯统计和机器学习非常感兴趣,研究范围是近似贝叶斯推理、因果推论、信息论和理论统计学、元学习、生物医学和医疗。

Mingyuan Zhou是得克萨斯大学奥斯汀分校的副教授,在麦库姆斯商学院信息、风险和运营管理(IROM)部门的统计组工作,也是自然科学学院统计与数据科学系的核心教员。于2013年获得杜克大学博士学位,2008年获得中国科学院硕士学位,2005年获得南京大学理学学士学位。研究范围是贝叶斯统计和机器学习的交叉领域,对统计理论与方法、层次模型、贝叶斯非参数、大数据统计推理、深度学习感兴趣,目前专注于用深度学习推进统计推断和用概率方法推进深度学习。