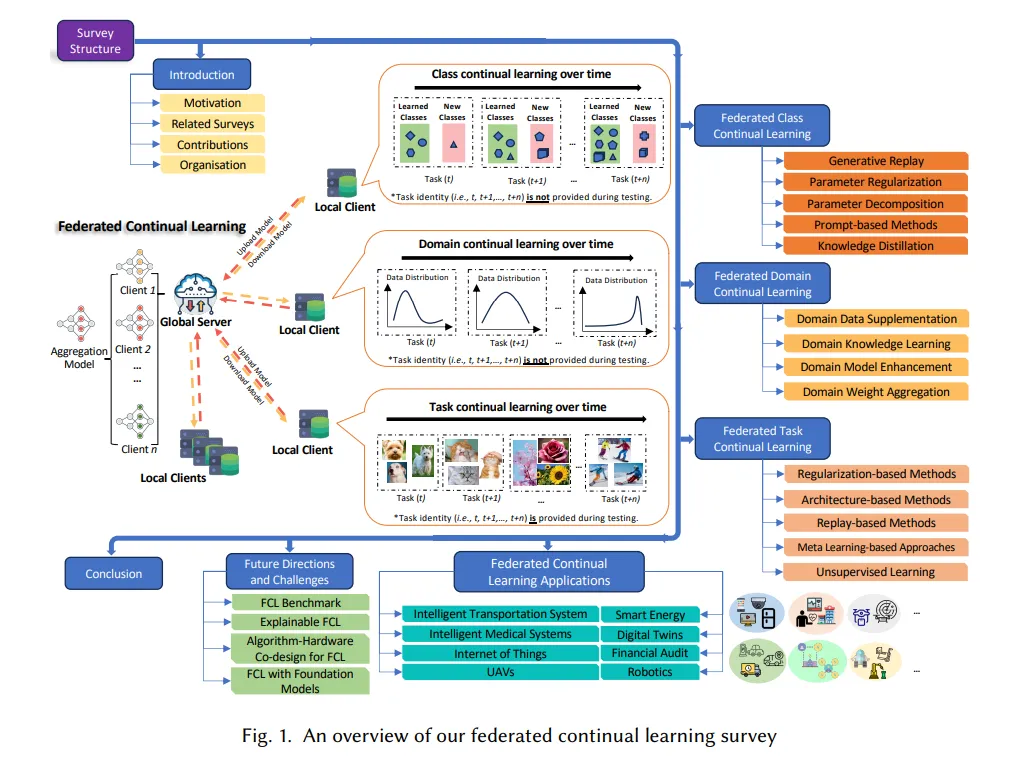

边缘人工智能(Edge-AI)是边缘计算与人工智能(AI)相融合的一种前沿范式,它能够在靠近用户的网络边缘部署先进的AI模型。联邦持续学习(Federated Continual Learning, FCL)在边缘人工智能领域中已成为一个重要框架,通过在不同客户端间融合知识,既保护了数据隐私,又在学习新任务的同时保留了对先前任务的知识。通过这种方式,FCL旨在动态且分布式的环境中确保学习模型的稳定和可靠性能。 在本综述中,我们全面回顾了最先进的相关研究,并呈现了首个关于边缘人工智能领域FCL的综合性综述。我们基于三种任务特性对FCL方法进行了分类:联邦类别持续学习(Federated Class Continual Learning)、联邦领域持续学习(Federated Domain Continual Learning)以及联邦任务持续学习(Federated Task Continual Learning)。针对每一类任务,我们对其代表性方法进行了深入分析和审查,包括背景、挑战、问题形式化、解决方案及其局限性。 此外,我们还对现有通过FCL赋能的实际应用进行了回顾,展示了FCL在不同应用领域中的最新进展和潜力。更进一步地,我们探讨并强调了FCL的若干前瞻性研究方向,例如FCL的算法与硬件协同设计以及结合基础模型的FCL。这些方向为FCL在边缘人工智能时代的未来发展和实际部署提供了重要的洞察。

1 引言

深度学习(Deep Learning, DL)已成为人工智能(AI)领域的主导方法,在计算机视觉、自然语言处理和语音识别等多个科学领域中表现出显著的效果[1]。DL通过利用包含多个隐藏层的人工神经网络来建模高级抽象,从数据中学习复杂的模式和表示[2]。近年来,DL应用的快速增长推动了多个行业的进步,例如辅助医疗诊断[3]、增强自动驾驶系统[4]以及加速基因组学研究[5]。然而,传统DL的实现方式依赖于基于云计算的集中式服务器和数据存储,这种方式在收集用户数据时可能引发隐私问题,且会导致高通信成本和服务器与客户端之间的高延迟。 为了解决这些问题,边缘计算作为一种新兴的分布式计算范式得到了广泛关注。边缘计算通过将计算和存储资源移至靠近数据源的位置,而非依赖集中式云端数据处理,显著降低了延迟和成本,使其适用于数据密集型和延迟敏感型的AI应用。因此,边缘计算与AI的结合催生了边缘人工智能(Edge-AI),旨在通过边缘计算支持实时AI应用。 在边缘人工智能中,联邦学习(Federated Learning, FL)是一种流行的分布式机器学习方法[6],它允许客户端协作训练DL模型,同时保持数据的本地化。具体来说,一个协调服务器将全局模型分发给参与的客户端,这些客户端使用其本地数据对模型进行训练。随后,通过在协调服务器上聚合来自客户端的处理参数(如梯度)而非原始数据,FL在确保全局模型训练性能和有效性的同时,符合数据安全法规[7, 8],如《通用数据保护条例》(GDPR)和《数据保护法案》(DPA),以应对AI应用中日益增长的用户隐私关注。 目前,FL研究主要集中在非独立同分布(non-IID)数据下的模型收敛[9]、模型聚合[10]、安全与隐私[11]、资源优化与激励机制[12]等方面。然而,大多数FL研究假设客户端的训练数据集是从静态数据分布中抽取的[13],并在训练开始时即完全可用[14]。但在实际场景中,数据的逐步收集、数据分布的变化、样本类别的动态性以及任务数量的变化会对模型的适应性带来显著挑战[15]。 近年来,持续学习(Continual Learning, CL),也称增量学习(Incremental Learning, IL)或终身学习(Lifelong Learning, LL),成为了一种重要的方法,用于从连续的数据流中学习和积累知识[13]。因此,将CL的概念整合到FL框架中,即联邦持续学习(Federated Continual Learning, FCL),结合了FL和CL的优势,为动态和分布式环境中的边缘人工智能奠定了坚实基础。然而,从一系列新任务中进行持续学习可能导致模型在之前任务上的性能显著下降,这种现象被称为灾难性遗忘(Catastrophic Forgetting, CF)[13]。在FCL中,由于FL允许客户端随意加入或退出学习过程,这一问题进一步加剧。此外,FL客户端的异质性导致本地模型学习了多样化的知识,在全局模型聚合时加剧了灾难性遗忘。最近的一些研究(例如,[15–18])提出了解决这些挑战的方案,推动了这一新兴研究领域的快速发展。

**1.1 相关综述

近年来,关于FL和CL的综合性综述已经分别完成[19–23]。关于联邦学习,Zhang等人[19]在物联网(IoT)领域调查了FL,并探讨了FL支持的物联网应用,如医疗保健、智能城市和自动驾驶。Ye等人[20]从统计异质性、模型异质性、通信异质性、设备异质性和其他挑战五个方面聚焦FL的异质性问题。关于持续学习,Van等人[21]综述了CL方法,并总结了三种类型的CL作为一个通用框架,用于交叉比较不同方法的性能。Lange等人[22]调查了用于任务分类的CL方法,根据任务信息的存储和使用方式,将其分为基于重放、基于正则化和基于参数隔离的方法。Masana等人[23]专注于类别增量学习,并将现有CL方法用于图像分类,分类为正则化、重放和偏差校正方法。他们还对这些方法在图像分类任务中的表现进行了广泛的实验评估。 这些综述分别聚焦于FL和CL的独立领域,尚未系统地研究FCL这一新兴范式中的挑战和解决方案,尤其是在边缘人工智能环境中。最近,Yang等人[24]从知识融合的角度对FCL进行了综述,提出了两种框架:同步FCL和异步FCL,用于解决FCL中空间-时间灾难性遗忘的挑战。与其工作不同,本综述从任务特性的角度,系统地调查并分类了边缘人工智能中现有的FCL方法,包括联邦类别持续学习、联邦领域持续学习和联邦任务持续学习。这些分类将在第2、3和4节中详细阐述。

**1.2 目标与贡献

本综述旨在全面调查FCL的最新研究进展,提供深入且系统的综述。从FCL的不同任务特性角度出发,我们详细回顾了FCL的背景、挑战和方法。此外,我们还探讨了现有FCL赋能的边缘人工智能应用。本综述对FCL领域的未来研究方向进行了深入讨论,激励研究人员解决关键的开放性挑战,并提供可能启发边缘人工智能领域未来发展的洞见。据我们所知,这是首篇关于边缘人工智能领域联邦持续学习的综合性综述。 本综述的主要贡献总结如下:

- 我们对最新FCL研究进行了全面回顾和明确分类,基于任务特性划分为联邦类别持续学习、联邦领域持续学习和联邦任务持续学习,并讨论了该快速扩展领域的大量研究论文。对这些方法的分类、定义、挑战、优缺点进行了深入探讨。

- 我们对现有FCL赋能的实际应用进行了回顾和总结,如智能交通系统、智能医疗系统、物联网和数字孪生,突出了FCL的多样性和对现实世界的影响潜力。

- 我们探讨并提出了多个开放性研究挑战,包括缺乏通用基准、可解释性、算法与硬件协同设计以及结合基础模型的FCL,并提出了未来研究方向,以激励研究社区推动FCL领域的快速发展和广泛部署。

**1.3 综述结构

本文的结构如图1所示,其余部分安排如下:第2节首先详细定义了FCL中动态添加新类别的任务特性,然后对解决该问题的四种方法进行了分类,并阐述了这些方法之间的相互关系。第3节分析了FCL中领域漂移问题的四种解决方案。第4节探讨了联邦任务持续学习的当前主流方法。第5节研究了FCL赋能的各种实际应用。第6节讨论了若干重要的开放性挑战,并指出FCL在边缘人工智能中的一些令人兴奋的未来研究方向。最后,第7节对本综述进行了总结。