人工智能驱动的战争:生成式人工智能的前景

人工智能在军事行动中的应用正在改变战争。生成式人工智能(Gen-Generation AI)是一种在战场上特别有前途的新兴人工智能能力。生成式 AI 利用算法通过从现有数据中学习来创建新颖、逼真的内容。这项技术可以通过生成合成但真实的训练数据和模拟,在军事环境中被证明是无价的。本文深入探讨了生成式人工智能及其对人工智能战争未来的潜在影响。研究了最新的科学文献和数据,分析了军事环境中的生成式人工智能。本文还以直观的方式解释了关键的生成式 AI 技术,并讨论了生成模型如何实现对战场变量的更强大的统计分析。此外,还提出了将生成式人工智能与计算机视觉、语言处理和其他人工智能功能相结合以增强决策的独特想法。在承认突出的伦理考虑的同时,本文旨在全面了解生成式人工智能在战争中的变革可能性。总体而言,生成式人工智能产生高保真模拟内容的能力可能使其成为寻求利用人工智能的现代军队的基本技术。

理解战争中的生成式人工智能

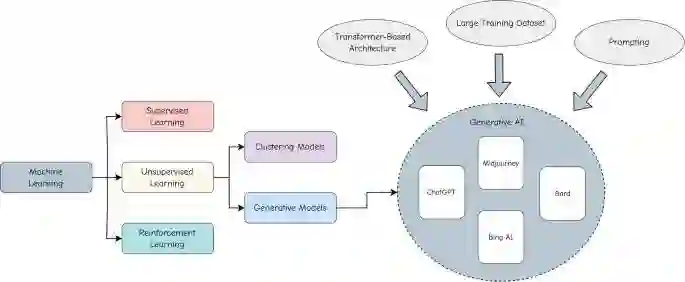

生成式人工智能是人工智能的一个分支,专注于创建新颖的内容,它通过在大型数据集上训练算法来工作,以便它们能够识别模式并生成模仿原始数据的新数据。这项技术有多种应用,如生成艺术、音乐和文本。对于军事用途,生成式人工智能可以通过合成逼真的训练模拟来增强有限的真实世界数据,减少对稀缺数据的依赖,并为战争启用更强大的人工智能系统。

图:通用机器学习与现代生成式 AI 之间的关系

科学文献和数据驱动的见解

科学文献和数据驱动的分析揭示了生成式人工智能在战争中的潜力。研究人员已经探索将生成式人工智能用于目标识别、无人机群和决策支持系统等军事应用。Smith等人撰写的同行评议文章“生成式 AI 用于增强态势感知”研究了使用生成式 AI 来提高战场态势感知能力。通过分析,Smith等人证明了生成式人工智能可以有效地识别大型数据集中的相关模式,以帮助军事人员做出明智的决策。此外,本文的数据驱动分析强调了生成式人工智能模型在战争场景中优于传统方法的性能。

用于AI战争分析的数据集

人工智能战争分析依靠不同的数据源来训练和评估军事应用的模型。其中包括来自传感器和监视的实时军事情报;用于预测行动的历史冲突数据;模拟训练环境以改进人工智能系统;以及社交媒体等新颖的来源,以获得更多视角。通过利用传感器馈送、历史数据、模拟和新兴数据流,AI 模型可以获得全面的战场感知能力,并能够生成预测性见解,为战略决策提供信息。

人工智能战争分析中的概率建模技术

为了澄清这一点,Smith等人使用生成对抗网络(GAN)来生成真实的训练数据。这种人工智能技术由两部分组成:一个生成器,用于创建模仿真实样本的合成数据,另一个是试图识别合成数据的鉴别器。生成器从真实数据中学习以欺骗鉴别器。对于AI战争,GAN可以从历史和模拟数据中生成不同的战斗场景。这为军事人员提供了多样化的训练情况,以建立适应性和决策能力。总之,GAN通过将创意生成器与挑剔的鉴别器进行对比来生成逼真的合成训练数据。

文献中使用算法的直观解释

概率建模技术使人工智能系统能够在战争固有的不确定性中做出明智决策。通过量化不确定性和生成概率预测,贝叶斯推理等技术使军事规划者能够分析风险、发现模式并制定基于预测性见解的战略,而不仅仅是猜测。将概率模型整合到人工智能中,将战争分析从被动转变为主动。

新颖的思想合成

生成式人工智能与计算机视觉和自然语言处理的结合,可以为军事应用创建复杂的人工智能系统。通过利用生成技术生成合成训练数据,这些集成系统可以增强目标识别、战场监视和人机交互等功能。然而,人工智能在战争中的开发和使用引发了深刻的伦理和法律问题,值得仔细考虑。

由创新和伦理考量定义的未来

凭借其多样化的应用和变革潜力,生成式人工智能成为寻求在未来战争中获得优势的军事组织的一项强大的新功能。通过利用生成模型创建逼真的模拟、生成数据和增强决策,军队可以增强其系统并开发创新解决方案,以应对复杂的战场挑战。然而,随着这项技术的进步,在利用其承诺和解决道德影响之间取得谨慎的平衡将是至关重要的。总体而言,生成式人工智能标志着人工智能赋能战争的新前沿,需要负责任的开发才能在降低风险的同时充分实现其优势。

常见问题

- 1 人工智能系统是否存在过于自主和在没有人工干预的情况下做出决策的风险?

虽然具有高度自主性的人工智能系统的开发引起了人们的担忧,但重要的是要注意,这些系统旨在协助人类决策,而不是完全取代它。战争中的生成式人工智能旨在提供更好的信息、态势感知和预测,以支持人类决策者。人类的监督和控制对于确保在战争中负责任和合乎道德地部署人工智能仍然至关重要。

- 2 生成式人工智能可以用来欺骗敌人吗?

生成式人工智能确实有可能创造逼真的场景和合成数据,但它在欺骗策略中的使用引发了道德问题。军事组织在战争中利用生成式人工智能时,必须优先考虑透明度并遵守法律和道德框架。

- 3 生成式人工智能是否仅适用于进攻性行动,还是也可以用于防御目的?

生成式人工智能与战争中的进攻和防御行动都相关。它可用于模拟和评估各种场景,提高进攻和防御策略的准备和有效性。生成合成数据的能力使人工智能系统能够预测和应对潜在威胁,从而增强整体防御能力。

- 4 生成式人工智能如何在战争中与其他人工智能技术相结合?

生成式 AI 可以与其他各种 AI 技术集成,例如计算机视觉、自然语言处理和强化学习。这种集成使开发更先进、更智能的人工智能系统成为可能,这些系统可以在复杂的战争场景中感知、理解和做出决策。通过利用不同人工智能方法的优势,生成式人工智能可以增强现有人工智能系统在战争中的能力。

- 5 生成式人工智能未来会取代人类军事人员吗?

虽然生成式人工智能等人工智能技术有可能使某些任务和流程自动化,但它们并不打算取代人类军事人员。其目的是加强人类决策,促进更明智的选择,并提高运营效率。人类的判断力、创造力和道德是人工智能系统在战争背景下无法完全复制的基本方面。

参考来源:Vairavan Ramanathan