人工智能(AI)是一个快速发展的领域,世界各地的政府和军队越来越多地将其纳入其技术,以创造新的能力。人工智能有可能最终超越人类的智力能力,获得超级智能。这篇论文研究了超级人工智能(ASI)的影响以及美国的对手如何利用它来获得不对称的战略优势。本文发现,人工智能在中期和可能的近期对未来的行动构成了极大的风险,并就美国防部应如何思考并将人工智能的威胁纳入战略规划提出了建议。

引言

人类最伟大的力量之一是我们利用工具的能力。纵观历史,工具使我们能够提高执行任务的效率,使我们的知识专业化,并创造机会反复改进和创造更复杂的工具。机器的发明给了人类一套工具,可以完全取代人类的劳动,而不是放大它,并在劳动的速度和质量上远远超过人类。现在,人工智能(AI)的发展正在做同样的思考。人工智能系统已经在前几代人认为机器永远无法完成的任务中超越了人类,例如:图像和目标识别,复杂的棋类游戏,如国际象棋和明显更复杂的围棋,需要实时战略思考的视频游戏,读唇语,甚至通过投资股票市场实现盈利。目前,人工智能的所有应用都是狭窄的,这意味着尽管它们在某项任务上可以超过人类的能力,但它们只能做它们被设计的那件特定的事情,而不是其他。然而,这种情况不会一直存在。

1993年,统计学家Vernor Vinge预测,人类将有能力创造出一种超人类的智能。他推测,这种创造将导致智能爆炸,因为超级智能在自身基础上不断改进,变得越来越聪明,将人类的能力远远甩在后面。这种能力将对人类生活的各个方面产生深远的影响。正如人工智能和决策理论家Eliezer Yudkowsky所说的那样。"没有困难的问题,只有对某一智能水平来说是困难的问题。向上移动最小的一点[智力水平],一些问题会突然从'不可能'变成'明显'。向上移动一个相当大的程度,所有的问题都会变得明显。" 因此,超级智能将为世界舞台上任何能够开发和控制它的行为者提供不对称的优势。

自第二次世界大战结束以来,美国一直是占主导地位的世界大国,能够通过国家权力的四个工具:外交、信息、军事和经济来扩大其影响力和追求其利益。然而,历史告诉我们,占主导地位的世界大国会因为军事革命而非常意外和迅速地失去这种地位。西方历史经历了五次这样的重大革命:现代民族国家的创建、大众政治与战争的融合、工业革命、第一次世界大战和核武器的出现。这些革命中的每一次都围绕着为首先采用这些革命的人提供的不对称优势,这使得他们能够获得突出的地位,即使只是暂时的,直到其他人也出于需要而采用新的模式。超级智能的人工智能的出现有可能创造出下一次军事革命,并使美国不再是世界上最大的国家。

默里和诺克斯指出,军事革命就其性质而言是 "不可控的、不可预测的和不可预见的。"但这是一个观点问题。纳西姆-塔勒布将这些类型的事件称为黑天鹅,并对其有三个标准:它们是罕见的,有极端的影响,并且是可追溯的。然而,他表明,某件事之所以成为黑天鹅,特别是因为没有认真对待这种可能性,而不是没有人想到它。举例来说,如果有人在9-11事件之前就认为恐怖主义是一种合理的威胁,并要求在飞机舱门上加锁,那么被劫持的飞机成为武器的黑天鹅事件就不会发生。推动这一变革的人甚至可能会因为他们的假设不正确而受到批评。如果没有这个事件的发生,就没有证据表明所实施的变革具有防止恐怖主义的预期效果。

对未来的正确预测在被认真对待时一般是不可能被验证的,因为他们成功地防止了他们预测的结果。因此,被认为不值得适当考虑或规划的想法成为决定性的。"看到一个事件的发生正是因为它不应该发生,这不是很奇怪吗?" 如果美国希望在一个正在迅速发展并变得越来越复杂的世界舞台上保持主导地位,它就必须对可能的和不可能的事情进行思考。正如参议院军事委员会前参谋长克里斯蒂安-布罗斯在其《杀戮链》一书的结论中所说,"问题是想象力的失败"。

问题陈述

技术正在以指数级的速度发展,并将在某一时刻导致下一次范式转变和军事革命。人工超级智能(ASI)有可能在国际行为者挥舞国家权力工具的能力方面创造不对称优势,并导致这样一场军事革命。从历史上看,军事革命的结果往往是,谁最先发挥新革命的不对称优势,谁就能推翻当时的世界霸主。下一次革命也会如此,美国可能会发现自己被剥夺了世界主导地位,除非它能预测并为即将到来的事情做好准备。仅仅为今天挑战美国主导地位的差距寻求解决方案是不够的,因为今天的问题在下一次范式转变后将变得无关紧要。因此,如果下一次军事革命以超级人工智能为中心,美国防部如何确定可能被利用的漏洞?

研究目的

美国防部在超级智能方面的文献有一个明显的空白。这次探索的目的是填补文献空白,确定这种技术所带来的风险程度,并确定对手可能利用ASI攻击美国的潜在漏洞。这将为国防界的决策者提供关于该主题的相关观点,并告知在规划和预测中应考虑该技术的程度。通过额外的研究,如果对手率先获得ASI,可以减轻已确定的漏洞以防止其被利用。最终,本研究的目的是防止ASI军事革命的出现成为一个黑天鹅事件,使美国失去其世界主导地位。

研究问题

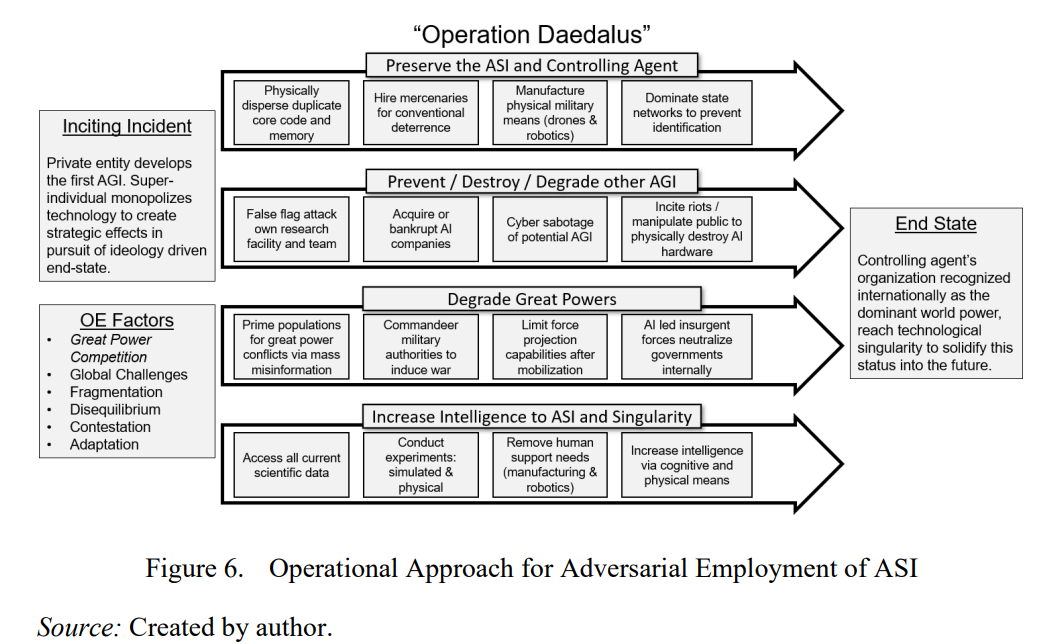

本论文试图回答的主要研究问题是:对手如何利用ASI来取代美国作为世界主导力量的地位?为了回答这个问题并达到研究的目的,还需要回答几个问题。 1.ASI有什么独特的能力,使它能够影响国家权力的信息和军事要素? 2.对美国有敌意的行为者如何利用ASI的能力来实现作战和战略效果? 3.在信息和军事领域有哪些弱点可以被拥有ASI的美国对手所利用?

假设

作为对一项理论技术如何在未来作战环境中使用的探索,必须对该未来环境的状态做出若干假设。因为本论文的目的是确定脆弱性和评估风险,所以对该环境的假设是那些被认为有可能造成最大风险的假设。这些关键的假设在文献回顾中都有更深入的阐述。

1.通用人工智能(AGI)将在2035年之前初步开发,并在2040年之前推进到人工智能。

2.美国的一个对手将是第一个开发AGI/ASI的人,并且该技术不会在他们的控制范围之外被分享或扩散。

3.一个发达的人工智能是可控的,不具备独立于其控制者的驱动力和动机,并作为其控制者意志的延伸而发挥作用。

4.2040年的作战环境将如国家情报委员会2040年报告中描述的竞争性共存情景,主要特点是美国和中国之间的竞争。

研究的意义

虽然近年来国防界的成员们在文献中充斥着关于人工智能的著作,但从国防的角度来看,关于超级智能主题的文献存在着明显的空白。虽然人工智能本身有可能在军事和民用领域产生变革,但本研究将开始填补有关人工智能的未来及其创造军事革命的潜力的知识空白。此外,这项研究还试图确定潜在的弱点,这些弱点可能被控制人工智能的对手所利用,以废止或取代美国作为世界主导力量的地位。这项研究的结果将为预测未来部队需求的战略计划者提供洞察力。识别弱点是缓解的第一步;然而,还需要更多的研究来为识别的弱点找到解决方案。矛盾的是,本研究的真正意义只有在其预测没有实现的情况下才能实现;也许表明它在防止所设想的负面情况的发生方面发挥了作用。