来源:腾讯研究院 时间:2024-01-31 15:22:53 作者: 日前,腾讯发布了大模型安全白皮书《大模型安全与伦理研究报告2024:以负责任AI引领大模型创新》。该报告由腾讯朱雀实验室、腾讯研究院、腾讯混元大模型、清华大学深圳国际研究生院、浙江大学区块链与数据安全全国重点实验室联合研究撰写,对大模型发展中的安全机遇与挑战、大模型安全框架和实践做法、AI伦理和价值对齐进行了系统性梳理,并展望了大模型安全与伦理未来趋势。 ** 大模型发展的技术新动向**

1、多模态解析世界的本来面貌,并实现“三生万物” 多模态是人类世界的本来样貌,AGI的发展趋势一定是朝向多模态。技术将从文本、图像、视频(2D和3D),再到声、光、电,甚至分子、原子等各类模态,而且具备跨模态迁移的特性。未来理想的框架是“多模态的对齐和融合+统一的编码器和解码器”。 比尔盖茨近日撰文:AIAgent将是下一个平台,人工智能即将彻底改变人们使用计算机的方式并颠覆软件行业。在不久的将来,任何上网的人都将能够拥有由人工智能驱动的个人助手,远超今天的技术水平。 3、端侧大模型加速部署,或将成为未来交互新入口 大模型正在向端侧转移,AI推理将在在手机、PC、耳机、音箱、XR、汽车,以及其它可穿戴式新型终端上运行。 4、AI助力科研探索,贯穿科研全过程 AI与各个科学领域结合后,正在发生一场充满潜力和挑战的科技革命。 大模型安全框架

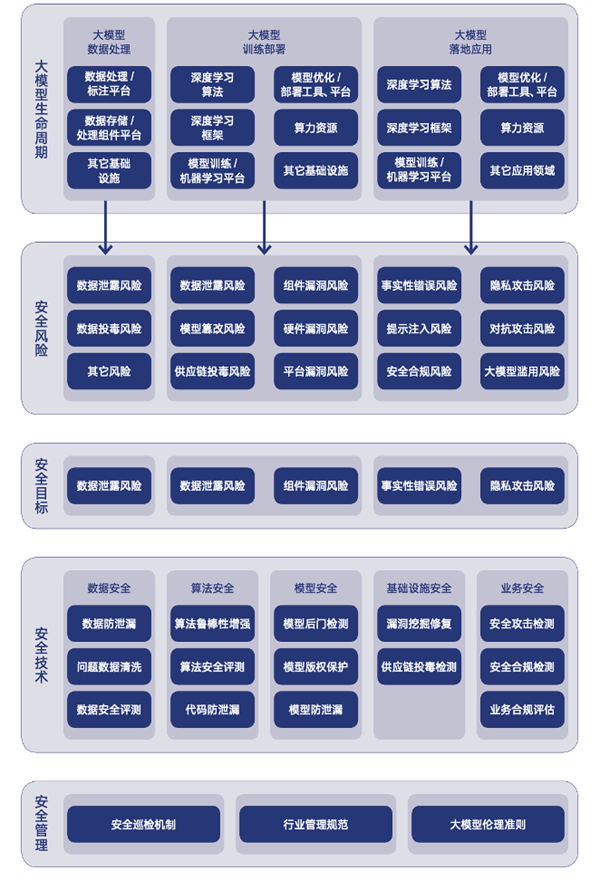

在人工智能安全领域,通用的数据安全问题和模型安全问题在大型模型中依然存在相似的风险。总的来说,大模型同样具有通用人工智能面临的安全风险问题,同时引入了一些大模型场景中特有的安全风险。因此,如何安全、可控地应用大模型相关技术尤为关键。 大模型安全框架首先从大模型生产研发的角度,将大模型的生命周期进行拆解,划分为数据处理、大模型训练部署、大模型应用三个不同阶段,并且对这三个阶段可能涉及的资产进行了梳理。接着,大模型安全框架围绕大模型的安全生命周期,从全局视角剖析了在大模型安全研发应用流程中存在的安全风险问题,以及如何应用这类安全风险的可能解决方案。

大模型安全框架的设计旨在具备全局性、实用性和前瞻性: ·全局性 大模型的研发应用是集数据、模型、算法、应用于一体的有机体,经历了数据处理、模型训练、模型评估、模型部署等多个阶段。大模型安全应用框架面向大模型研发应用的所有关键基础组件,覆盖大模型全生命周期,提出全面且有针对性的安全建议。 ·实用性 目前面对新出现的大模型安全风险,目前行业内还未形成成熟完善的解决方案。大模型安全应用框架旨在提供大模型生命中周期中实用的、可操作的、有针对性的安全建议。 ·前瞻性 目前行业内已经暴露出诸多大模型安全风险,然而目前大模型安全仍然属于一个新兴的安全领域,许多安全攻防理论和技术仍然处于建设阶段。因此,大模型安全应用框架的设计,不局限于当前已发现的安全风险的解决,而是立足于保障大模型技术安全应用这一目标,同样关注未来可能出现的安全风险问题,提出能有效应对新风险的大模型安全框架。 ** 大模型安全与伦理未来趋势**

AI安全和伦理已经成为了AI领域不可或缺的组成部分,对于大模型而言,其安全、伦理、人机对齐等问题之应对和解决,将需要政府、业界、学界等利益相关方进行持续的探索。 其一,数据安全、隐私泄露、抗攻击能力提升等问题是现有大模型应用面临的真实挑战,解决这些问题的技术手段还存在一定的局限性。对抗性人工智能技术与防御策略之间的竞赛将加剧,为了应对对抗性攻击和操纵等恶意行为,模型需要被设计为更加具有鲁棒性。 其二,从整体上对AI大模型的安全风险进行建模,系统化地构建安全评估系统是大模型安全领域的未来发展方向。这将最大程度地确保大模型应用是在符合社会价值与应用价值方面同步进行。 其三,增强模型透明度和可解释性。研究模型的可解释性,提高模型的透明度既是未来AI的发展方向,也能帮助提升AI模型的安全性。未来的人工智能模型可能会融入更先进的XAI技术。 其四,人机价值对齐和伦理嵌入设计(ethicsbydesign)的理念将变得越来越重要。无论是AI价值对齐还是伦理嵌入设计,都需要人们发展新的更加务实的AI伦理框架及其实践指南。 其五,人工智能监管立法和国际治理合作将得到进一步推进。未来立法和监管措施将给大模型安全和伦理的研究和实践提供更进一步的指导。 最后,在大模型安全和伦理研究中,跨学科合作是一个重要趋势。未来大模型安全和伦理研究需要吸收多领域的知识和技术,形成跨学科的研究团队,共同解决不断升级的复杂安全和伦理问题,确保负责任的、安全可控的AI发展应用。 具体内容如下: