主题: Mathematics of Deep Learning

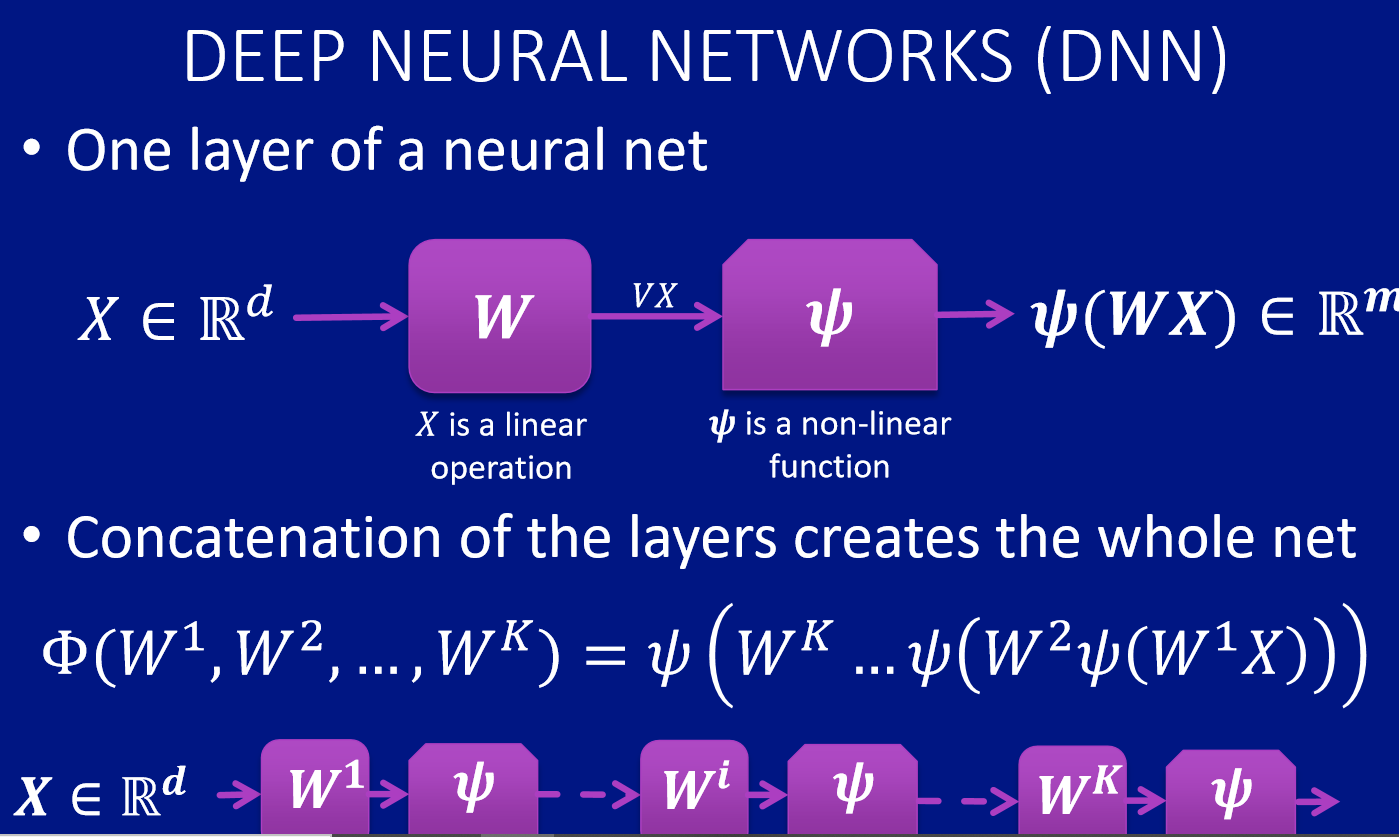

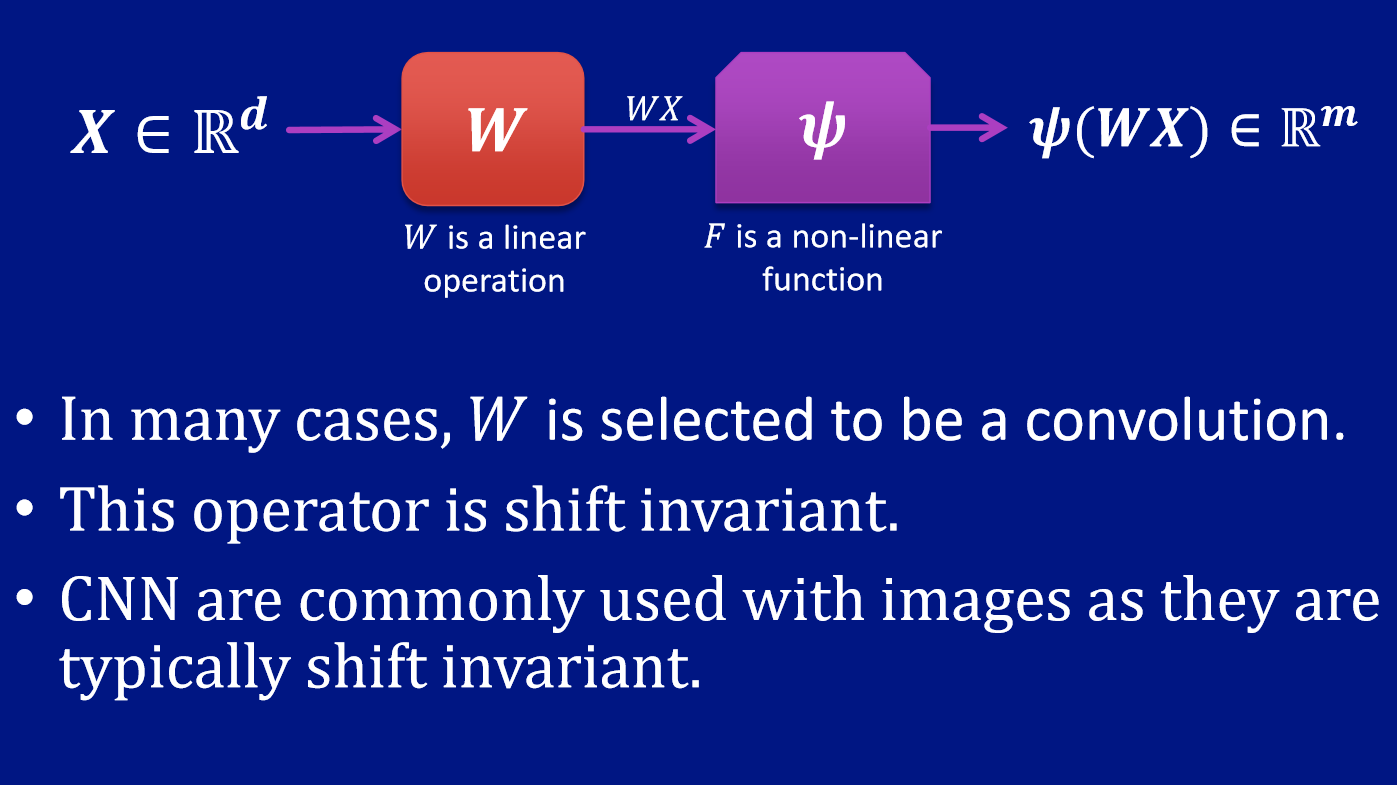

摘要: 本教程将介绍一些深神经网络的理论结果,其目的是为属性提供数学证明,如逼近能力、收敛性、全局最优性、不变性、学习表征的稳定性、泛化误差等。讨论了该理论在神经网络训练中的应用。本教程将从90年代早期的神经网络理论(包括著名的Hornik等人的研究成果)开始。还有Cybenko)。接下来,我们将讨论过去五年中为深度学习而建立的最新理论成果。文中还将讨论该理论所遵循的实际考虑。

邀请嘉宾: Raja Giryes,是特拉维夫大学电气工程学院的助理教授。他获得了海拉以色列理工学院计算机科学系理学学士(2007)、理学硕士(M.Elad教授和Y.C.Eldar教授监督,2009)和博士(M.Elad教授监督,2014)学位。Raja是Technion(2013年11月至2014年7月)计算机科学系和杜克大学G.Sapiro教授实验室(2014年7月和2015年8月)的博士后。他的研究兴趣在于信号和图像处理与机器学习的交叉点,特别是在深度学习、反问题、稀疏表示和信号和图像建模方面。Raja获得了EURASIP最佳博士奖、ERC StG奖、Maof优秀青年教师奖(2016-2019)、VATAT优秀博士后奖学金(2014-2015)、英特尔研究与卓越奖(2005、2013),德克萨斯仪器公司(2008)颁发的信号处理卓越奖(ESPA),是Azrieli研究员计划(2010-2013)的一部分。

下载链接: 链接:https://pan.baidu.com/s/1tHvvi7codVe4kdb1quZB1w 提取码:99fm

成为VIP会员查看完整内容

相关内容

特拉维夫大学电气工程学院的助理教授。他获得了海拉以色列理工学院计算机科学系理学学士(2007)、理学硕士(M.Elad教授和Y.C.Eldar教授监督,2009)和博士(M.Elad教授监督,2014)学位。Raja是Technion(2013年11月至2014年7月)计算机科学系和杜克大学G.Sapiro教授实验室(2014年7月和2015年8月)的博士后。他的研究兴趣在于信号和图像处理与机器学习的交叉点,特别是在深度学习、反问题、稀疏表示和信号和图像建模方面。Raja获得了EURASIP最佳博士奖、ERC StG奖、Maof优秀青年教师奖(2016-2019)、VATAT优秀博士后奖学金(2014-2015)、英特尔研究与卓越奖(2005、2013),德克萨斯仪器公司(2008)颁发的信号处理卓越奖(ESPA),是Azrieli研究员计划(2010-2013)的一部分。

专知会员服务

54+阅读 · 2019年10月25日