强化学习(RL)是一种通过环境交互产生的奖励或惩罚信号驱动智能体决策的框架。深度强化学习整合深度学习与强化学习,利用深度神经网络处理高维复杂数据。依托该框架,机器学习研究界在长时序决策领域取得突破性进展,包括雅达利游戏超人类表现[Mnih et al., 2015]、围棋人机大战胜利[Silver et al., 2017]、以及鲁棒推荐系统构建[GomezUribe and Hunt, 2015, Singh et al., 2021]。本研究聚焦深度强化学习环境中的核心挑战,优化智能体策略以提升性能、样本效率与泛化能力。

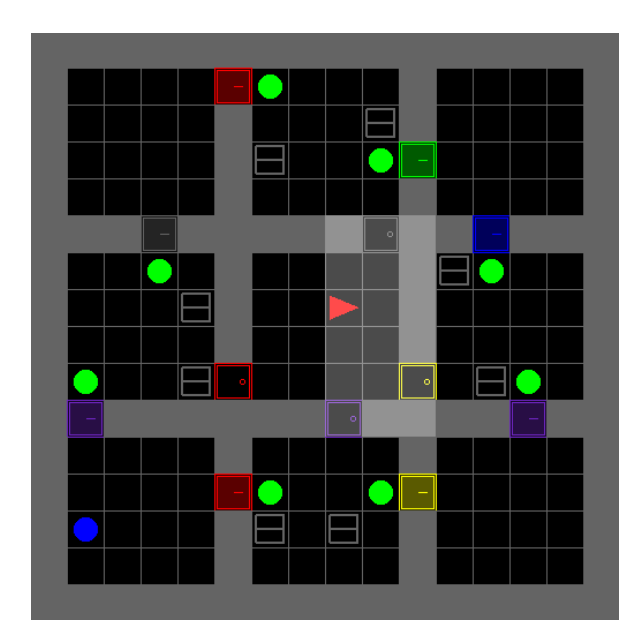

论文第一部分针对单智能体稀疏奖励环境下的探索难题展开研究。当智能体仅在任务完成时获得反馈,传统方法常因探索不足而无法获取关键奖励,导致策略欠优。本文提出语义驱动探索新范式,显著提升稀疏奖励任务的样本效率与策略性能。第二部分延伸至协作式多智能体强化学习(MARL)领域,探究多智能体协同完成共享任务时的学习困境。在需严格协调且协调失误惩罚严苛的场景中,现有MARL方法常陷于次优均衡态;同时,智能体联合动作空间的维度爆炸式增长加剧探索难度。为此,本文创新提出通用价值探索框架与可扩展角色学习机制,有效促进智能体协调效率,加速联合动作空间探索,并赋予跨环境任务零样本泛化能力。此外,针对协作MARL中独立策略学习方法(各智能体视他者为环境要素)的研究表明,该方法在主流多智能体基准测试中性能优于现有联合学习范式。

本研究通过系统性创新,显著推进深度(多智能体)强化学习的前沿水平。所开发智能体具备高效环境探索能力,可攻克复杂多智能体协调任务,并在多任务场景展现卓越泛化性能。

成为VIP会员查看完整内容

相关内容

Arxiv

203+阅读 · 2023年4月7日

Arxiv

12+阅读 · 2021年10月4日