近期,清华大学朱文武、王鑫等学者在图基础模型方向取得重要突破。团队从自动图机器学习角度出发,提出了“自适应图神经架构搜索”自动图基础模型AutoGFM,显著提升图基础模型在多任务、多领域场景下的性能与泛化能力。该成果已被ICML 2025会议接收并评为Oral论文(Top 1%,共120篇/12,107篇总投稿量)。

图基础模型(Graph Foundation Model, GFM)旨在实现跨领域与多任务的图知识共享,是构建图大模型的重要前提,已成为推动图大模型发展的关键研究方向。近年来,基于图神经网络(Graph Neural network,GNN)的图基础模型展现出广阔的应用前景,其通过统一的图表征能力,使得单一模型能够泛化到不同场景下的节点级、边级与图级任务。

现有图基础模型依赖人工设计的网络架构

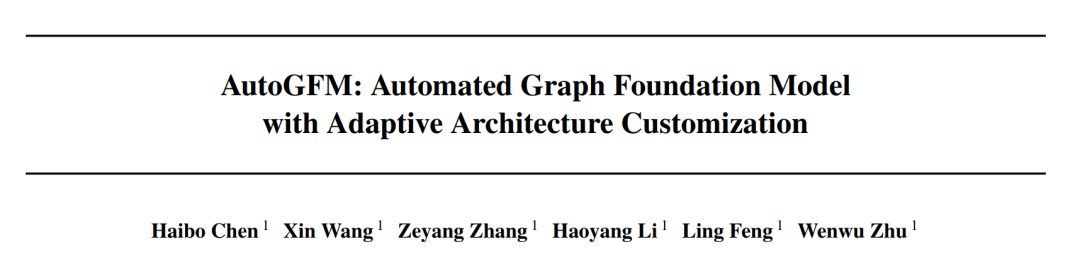

然而,现有的图基础模型普遍依赖人工设计且固定的GNN架构,缺乏对具体任务和领域的灵活适应能力,难以在多样化的图结构中实现最优性能。来自不同任务和领域的图数据在结构特征与分布模式上差异显著,往往需要差异化的图神经网络架构才能实现最优性能。为验证这一问题,团队首先在图基础模型框架下,对多种典型GNN架构(如 GCN、GAT 等)在多个任务与领域的数据集上进行了系统实验(结果如图1所示),发现不同任务和领域确实对应不同的最优架构。进一步地,以典型的可微分图神经网络架构搜索方法 DARTS 为例进行理论分析。结果表明,在存在架构不一致性的多任务图场景中,此类方法易产生架构搜索冲突,难以有效协调不同任务对架构的差异化需求,最终导致搜索结果次优,限制了模型的泛化能力。

AutoGFM:自适应架构的图基础模型

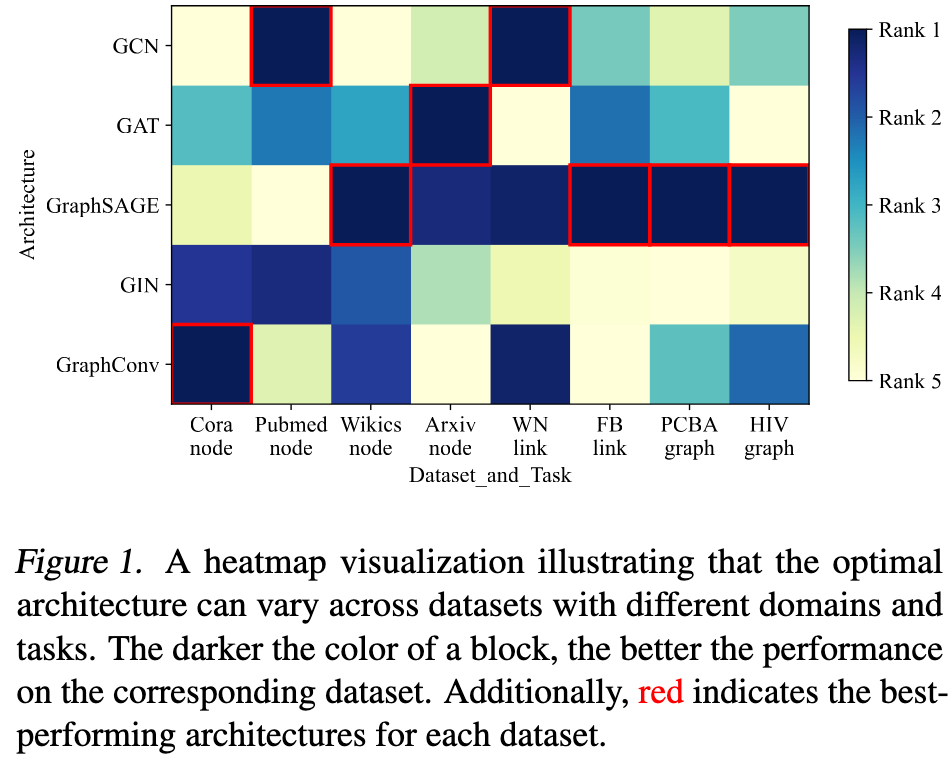

AutoGFM流程框图如图2所示。首先,AutoGFM提出了解耦对比图编码器,其中设计了一种子图级别的判别式对比学习方法,用于从多样的图数据中捕捉不变模式和变化模式。其次,AutoGFM提出了一种基于不变模式引导的架构定制方法,以便为多样化数据量身定制图神经网络架构。AutoGFM鼓励不变模式在面对变化模式干扰时仍保持定制架构的能力,旨在消除变化模式带来的影响。最后,AutoGFM提出了一种基于课程学习的架构定制约束,以缓解某些特定数据在搜索过程中主导架构搜索的现象。

小结与展望

团队提出的 AutoGFM 实现了图基础模型在多任务、多领域环境下的自适应架构定制,显著提升了模型在多样化图数据上的表现与泛化能力。通过引入不变模式引导和课程学习机制,有效破解了传统图架构搜索在任务与领域异构性下的适应性难题。其应用前景广泛,可用于学术网络中的科研合作关系挖掘与知识传播分析、知识图谱的实体与关系建模,还能在生物制药领域辅助药物分子性质预测,为跨学科图智能的应用与发展提供坚实支撑。未来,团队将持续推进图基础模型在跨模态融合、开放任务适应和大规模高效训练等方向的发展,构建更强大、更通用的图智能基础能力。