推理,作为复杂问题解决的关键能力,在各种现实世界场景中扮演着核心角色,如谈判、医学诊断和刑事侦查。它是人工通用智能(AGI)领域的一种基本方法。随着基础模型的持续发展,例如大型语言模型(LLMs),人们越来越感兴趣于探索它们在推理任务中的能力。在这篇论文中,我们介绍了为推理提出或适应的开创性基础模型,突出了在各种推理任务、方法和基准测试方面的最新进展。接着,我们深入探讨了基础模型中推理能力出现的潜在未来方向。我们还讨论了多模态学习、自主代理和超级对齐在推理背景下的相关性。通过讨论这些未来的研究方向,我们希望激发研究人员在这一领域的探索,促进基础模型推理的进一步发展,并为人工通用智能的发展做出贡献。

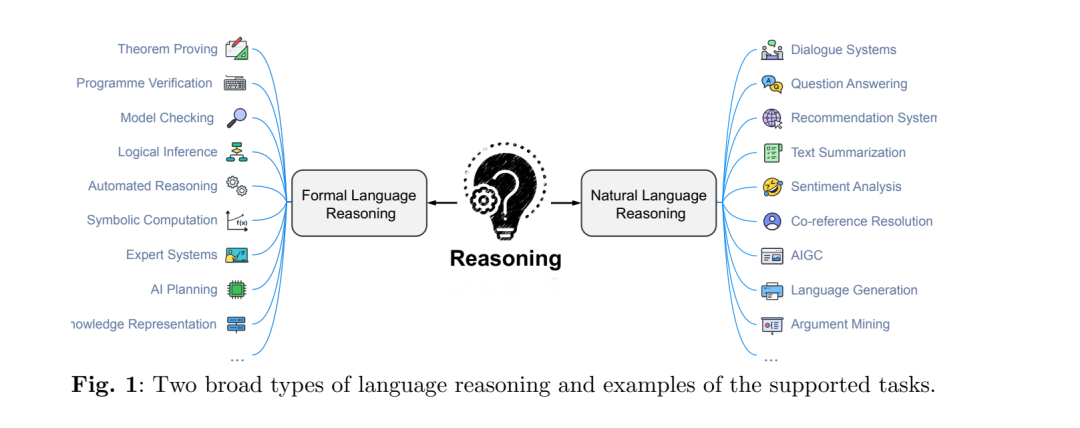

推理是人工智能的一个重要方面,应用范围广泛,涉及问题解决、定理证明、决策制定和机器人技术等领域(Manning, 2022)。《快思慢想》(Daniel, 2017)阐述了人类思维的双系统框架,包括“系统1”和“系统2”两种思维模式。“系统1”运作迅速,依赖于本能、情感、直觉和无意识过程。相反,“系统2”运作较慢,涉及有意识的思考,如算法推理、逻辑分析和数学能力。推理作为“系统2”的关键功能之一发挥着至关重要的作用(Bengio, 2017; Weston and Sukhbaatar, 2023)。推理可以分为两大类:形式语言推理和自然语言推理(Reiter, 1975; Berzonsky, 1978; Teig and Scherer, 2016; Yu et al., 2023a; Zhao et al., 2023b; Li et al., 2023u)。一方面,如图1所示,形式语言推理通常用于软件和硬件系统的形式验证、定理证明和自动推理等领域(Reiter, 1975; Berzonsky, 1978)。另一方面,自然语言推理使人机交互更加直观,并支持诸如问答(Shao et al., 2023; Jiang et al., 2021c)、信息检索(Zhu et al., 2023d; Ai et al., 2023)、文本摘要(Liu et al., 2023n)和情感分析(Yu et al., 2023a; Araci, 2019; Barbieri et al., 2021)等任务。

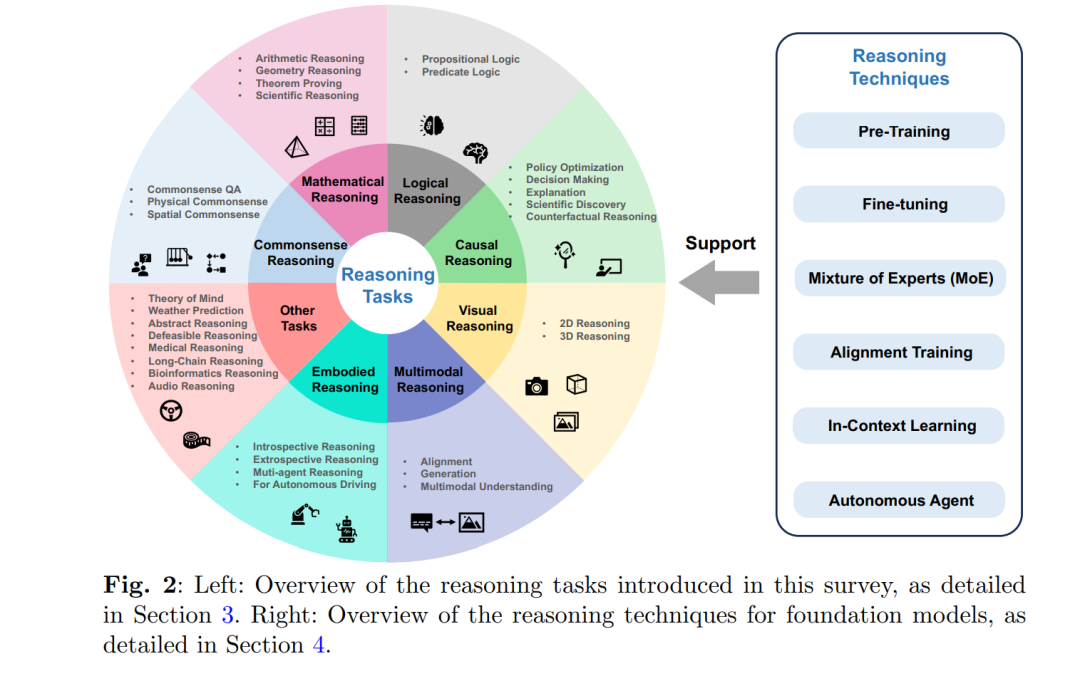

自从基础模型(Bommasani et al., 2021)问世以来,它们在自然语言处理(Qiao et al., 2022)、计算机视觉(Wang et al., 2023h)和多模态任务(Li, 2023)等各个领域展现出了显著的效能。然而,对通用人工智能的浓厚兴趣激起了关于基础模型是否能展现类似人类的推理能力的激烈讨论。因此,对基础模型的推理能力的研究兴趣激增。尽管之前的综述已经从不同角度探讨了基础模型的应用潜力(Gu et al., 2023a; Wang et al., 2023h; Yin et al., 2023b; Zong et al., 2023; Lou et al., 2023; Charalambous et al., 2023; Wang et al., 2023v,y,j),但仍然需要一个系统全面的综述,专门关注最近在多模态和交互式推理方面的进展,这些推理风格更接近人类的推理方式。图2展示了本文将讨论的与推理相关的任务和技术的概览。

基础模型通常包含数十亿参数,并通过自监督学习(Jain et al., 2023)在广泛数据集上进行(预)训练(Bommasani et al., 2021)。一旦(预)训练完成,基础模型可以通过任务特定的微调、线性探测或提示工程来适应多种下游任务,展示出非凡的泛化能力和令人印象深刻的准确性(Bommasani et al., 2021; Qiu et al., 2023a)。与传统Transformer中使用的软注意力机制不同,System 2 Attention (S2A) 利用大型语言模型(LLMs)的能力来促进语言推理。这种方法提高了长篇内容生成的事实性和客观性。通过将逻辑规则和原则整合到学习过程中(Mao et al., 2023b),这些模型可以执行复杂的任务,如演绎和推理。这使它们能够基于显性知识(Mao et al., 2023b)和逻辑推理做出决策,而不仅仅依赖于统计模式(Yang et al., 2023f)。作为人工智能研究中快速发展的领域,基于基础模型的推理旨在开发能够以更类似于人类的方式理解和交互复杂信息的模型。这些模型建立在逻辑推理和知识表示的基础上,使其能够对抽象概念进行推理,并基于逻辑规则做出决策。

首先,基于基础模型的推理能够应用先验知识和领域专业知识。逻辑规则可以从专家知识中得出,或从现有本体论或知识图谱中形式化。通过利用这些先验知识,模型可以更好地理解问题领域,并做出更明智的决策。其次,基于基础模型的推理可以增强模型的稳健性和泛化能力。通过整合大量数据中包含的信息,模型可以更好地处理面对有限数据或在部署过程中遇到未见情景的情况。这使得模型在稳健的真实世界应用中更为可靠和坚固。

与目前主要关注基础模型特定方面的综述相比,如提示(Qiao et al., 2022)、幻觉(Rawte et al., 2023)、演绎推理(Huang and Chang, 2022)、逻辑推理(Friedman, 2023a; Yang et al., 2023f)、因果推理(Kıcıman et al., 2023; Stolfo et al., 2022)、健康信息学(Qiu et al., 2023a)或AI代理(Xi et al., 2023),本文采取了更广泛的视角,旨在以连贯和有组织的方式连接这一领域的各种研究工作。如图2所示,我们提供了各种推理任务的简洁概述,包括常识推理、数学推理、逻辑推理、因果推理、视觉推理、音频推理、多模态推理、具身推理、可反驳推理等。通过这样做,我们提供了一个全面的概览,突出显示不同领域间的相互联系和关系,以激发更多研究工作积极参与并推进基于基础模型的推理。

总结来说,我们对过去两年的650多篇关于基础模型的论文进行了综述。我们讨论了这些模型中使用的不同任务、方法、技术和基准。我们还探讨了各种应用领域,这些领域可以从基于基础模型的推理中受益,如问答、自动推理和知识表示。我们还讨论了目前基于基础模型推理的挑战和局限性,以及未来研究的潜在方向。通过了解这一领域的进展和挑战,研究人员可以探索开发能够以更类似于人类和可解释的方式推理和做出决策的智能系统的新途径。总的来说,本文旨在提供对基于基础模型推理的全面理解,包括其当前状态和未来可能性。

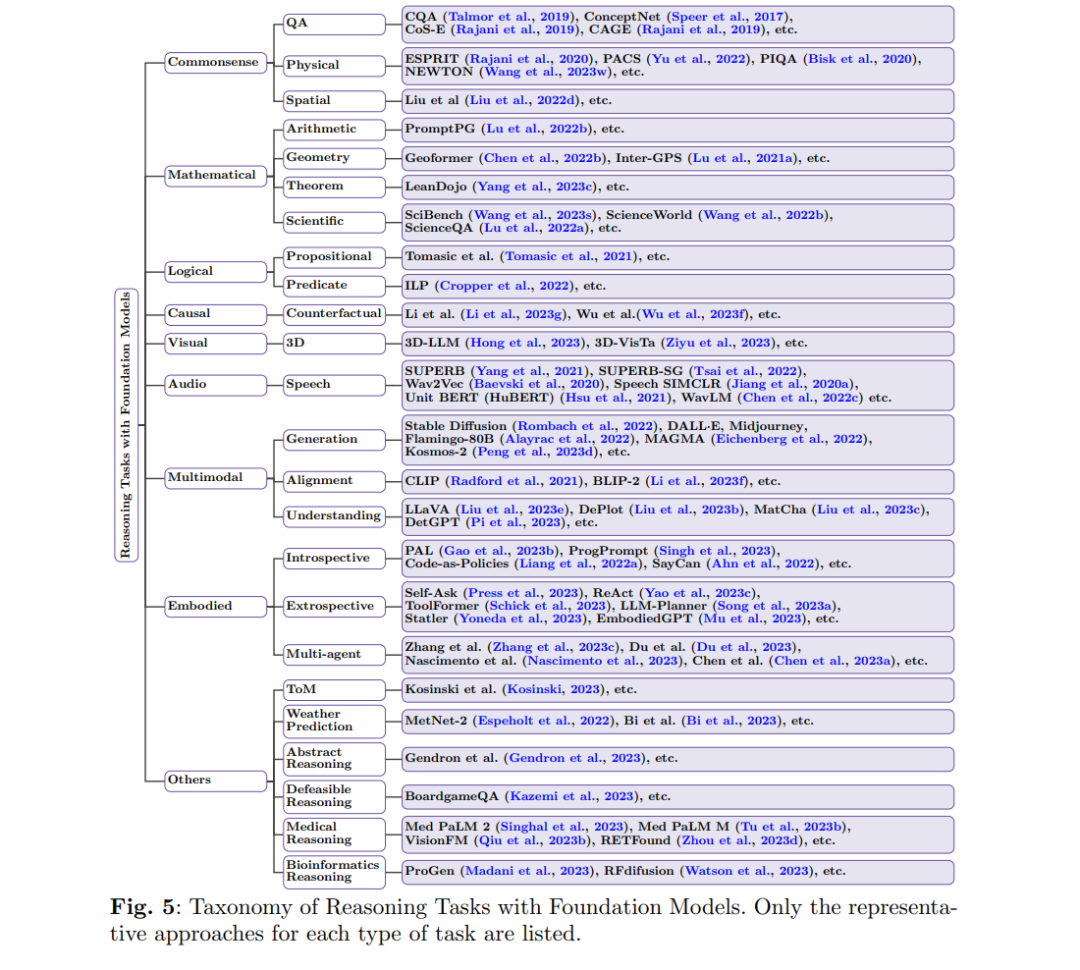

在这一部分中,我们提供了各种推理任务的简明概述,如图2所示。在这里,我们呈现了不同类别的推理方法和任务: * 常识推理(第3.1节):探索推断和应用日常直觉知识的能力。 * 数学推理(第3.2节):专注于解决数学问题和得出逻辑结论的能力。 * 逻辑推理(第3.3节):检验基于形式逻辑进行推理和做出决策的过程。 * 因果推理(第3.4节):调查理解因果关系及其影响的能力。 * 多模态推理(第3.7节):涉及跨多种数据模态(如文本、图像和感官信息)的推理。 * 视觉推理(第3.5节):专注于需要解释和操作视觉数据的任务。 * 实体推理(第3.8节):探索与环境互动的实体代理的推理背景。 * 其他推理任务(第3.9节):推理的讨论跨越各种背景,包括概念框架,如抽象推理3.9.7,可反驳推理3.9.8,以及应用领域,如医学推理3.9.3,生物信息学推理3.9.4等。

我们还强调了长链推理在研究人员探索应用方面的巨大效用3.9.6。 这一全面的概述提供了对领域内各种推理任务和方法的多样化景观的洞见。每个推理部门的开创性工作摘要可以在图5中找到。

这份综述阐明了基础模型在推理领域的演化路径,展示了从最初阶段到当前进展的复杂性和有效性的明显进步。虽然我们承认在数据驱动思维方面取得了显著的进步,但客观地认识到大型模型的优势和局限性对我们来说至关重要。在这种情况下,强调提高其可解释性和安全性的重要性变得迫切。我们还注意到,尽管本工作调研了所有论文,但关于如何推动基础模型的推理能力持续达到超人水平(例如获得国际数学奥林匹克竞赛奖牌或甚至解决开放性数学问题)尚未达成共识。

总之,虽然基础模型在推理任务中提供了令人兴奋的可能性,但以批判的视角来处理它们的发展和应用是至关重要的。承认与基于大型语言模型的推理相关的挑战、局限性和风险至关重要。通过这样做,我们可以促进这一领域负责任和深思熟虑的发展,确保构建出健壮可靠的推理系统。