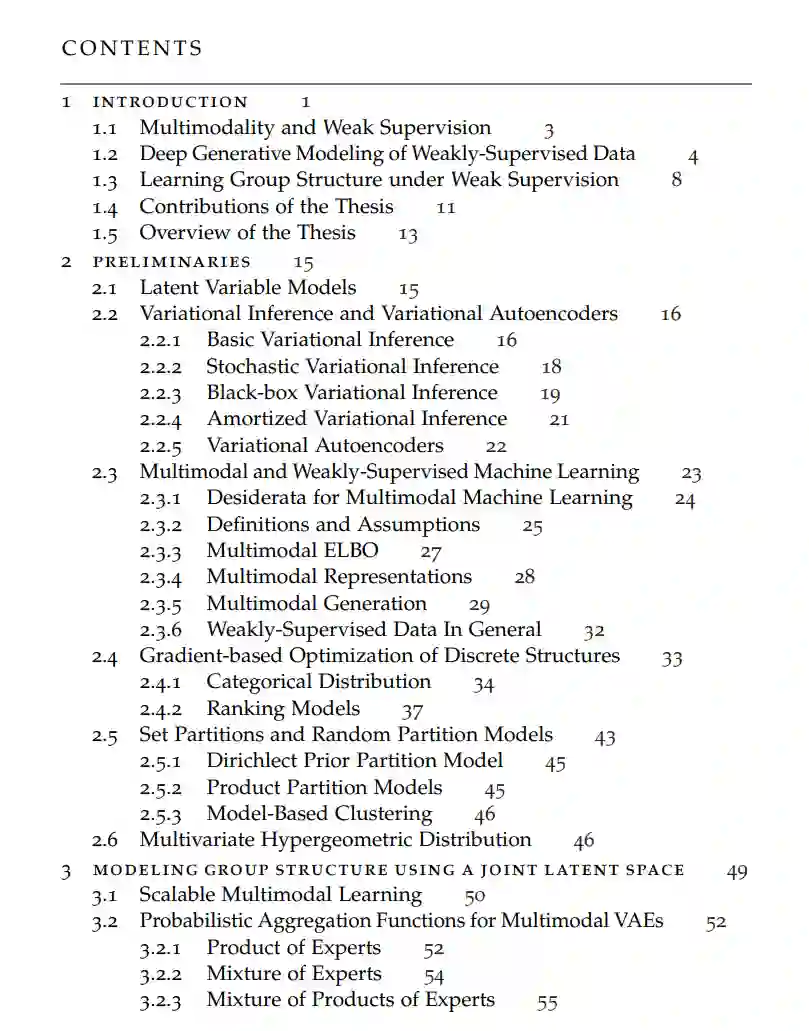

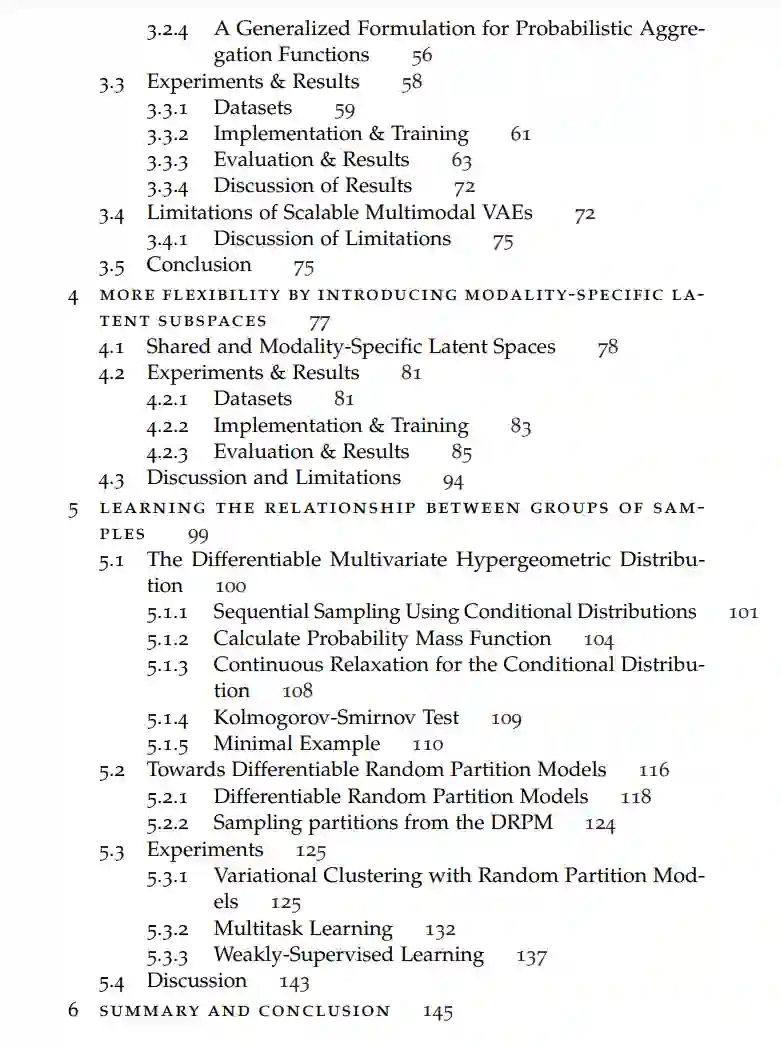

人类自然地整合各种感觉来理解我们的周围环境,使我们能够补偿部分缺失的感官输入。相反,机器学习模型擅长利用大量数据集,但在有效处理缺失数据方面面临挑战。虽然利用多种数据类型提供了更全面的视角,但也增加了遇到缺失值的可能性,从而强调了在机器学习技术中适当管理缺失数据的重要性。 在这篇论文中,我们主张开发模拟人类合并多种感觉输入到统一表示法的机器学习模型,展示在面对缺失输入源时的韧性。为多种数据类型生成标签是费时且通常成本高昂的,导致完全注释的多模态数据集稀缺。另一方面,多模态数据自然地具有一种弱监督形式。我们知道这些样本描述了同一事件,并假设某些基本生成因子在群组成员之间是共享的,提供了一种弱引导。 我们的论文重点研究由弱监督特征的数据学习,深入探讨群组成员之间的相互关系。 我们首先探索能够处理多模态输入并有效处理缺失数据的机器学习模型的新技术。

我们的重点是使用变分自编码器(VAE)从弱监督数据中学习。我们引入了一种概率聚合函数的泛化公式,旨在克服以前方法的局限性,我们展示了这种泛化公式与性能提升的关联。 在更高的层次上,我们研究了关于群体结构的隐含假设对模型学习行为和效果的影响。 我们发现,对于生成连贯和高质量的样本,假设一个共享的潜在空间过于严格。为了克服这一局限性,我们在多模态VAEs中引入了模态特定的潜在子空间,反映了更为灵活的建模方法。 虽然我们观察到,在建模假设上的更大灵活性,或与实际数据生成过程一致的假设,都会导致性能的提高,但我们仍然依赖于关于一组多模态或弱监督样本的关系的先验知识。随着群体成员的增长,他们之间的基本关系可能变得更为复杂,增加了过于严格假设的风险。 因此,在最后一节中,我们将重点转向在学习弱监督数据时最小化所需的假设,并同时在学习过程中推导出群体结构。在这种情境下,我们引入了一个可微分的随机分区模型的新公式,该模型遵循两阶段过程。在第一步,我们使用新提出的超几何分布的可微分公式估计元素的数量。在第二步,我们将适当数量的元素分配给每个子集。我们可以证明,我们的可微分随机分区模型可以在弱监督设置中学习共享和独立的生成因子。 我们希望这篇论文及其贡献能够增强多模态机器学习的未来应用,并减少一般情况下从弱监督数据中学习所需的假设。

https://www.research-collection.ethz.ch/handle/20.500.11850/634822