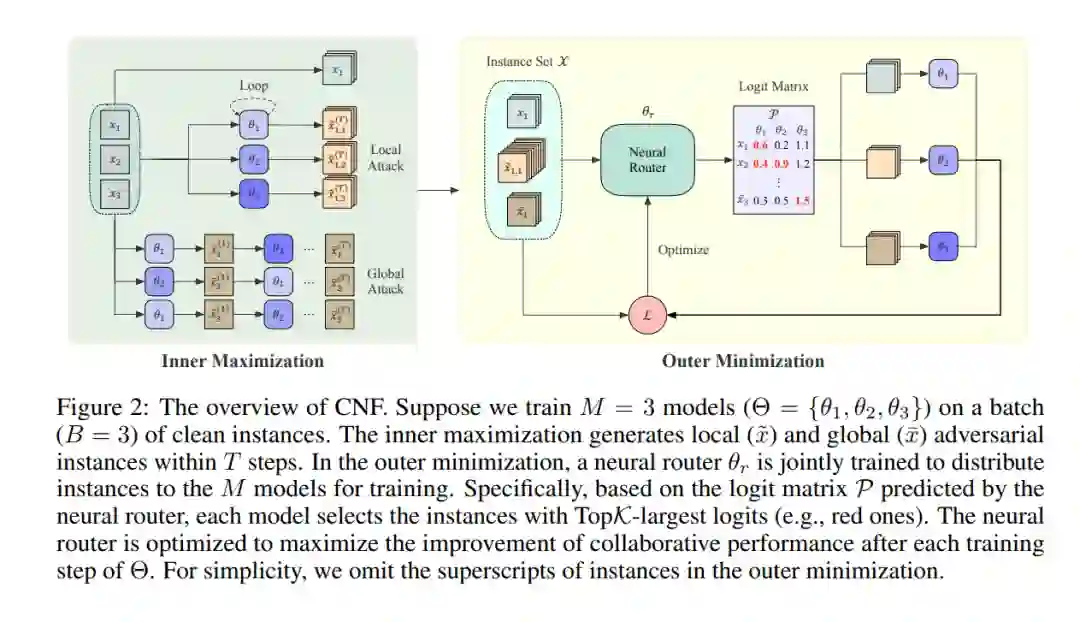

尽管现有的神经网络方法在求解车辆路径问题(VRP)时表现出良好的效率,并减少了对领域专业知识的依赖,但它们在鲁棒性方面存在严重问题——其性能在面对带有精心设计扰动的干净实例时显著下降。为提升鲁棒性,我们提出了一种基于集成的协作神经框架(CNF),用于防御神经VRP方法,这一方向在文献中尚未得到充分探讨。对于给定的神经VRP方法,我们以对抗性训练的方式,让多个模型协作,以协同提升对抗攻击的鲁棒性,同时在干净实例上提升标准泛化能力。我们设计了一个神经路由器,可以灵活地在各个模型之间分配训练实例,从而增强整体的负载平衡和协作效果。大量实验证实,CNF在防御不同神经VRP方法下的各种攻击方面具有出色的效果和通用性。值得注意的是,该方法在基准实例上也表现出了显著的分布外泛化能力。

成为VIP会员查看完整内容

相关内容

Arxiv

42+阅读 · 2023年4月19日

Arxiv

224+阅读 · 2023年4月7日