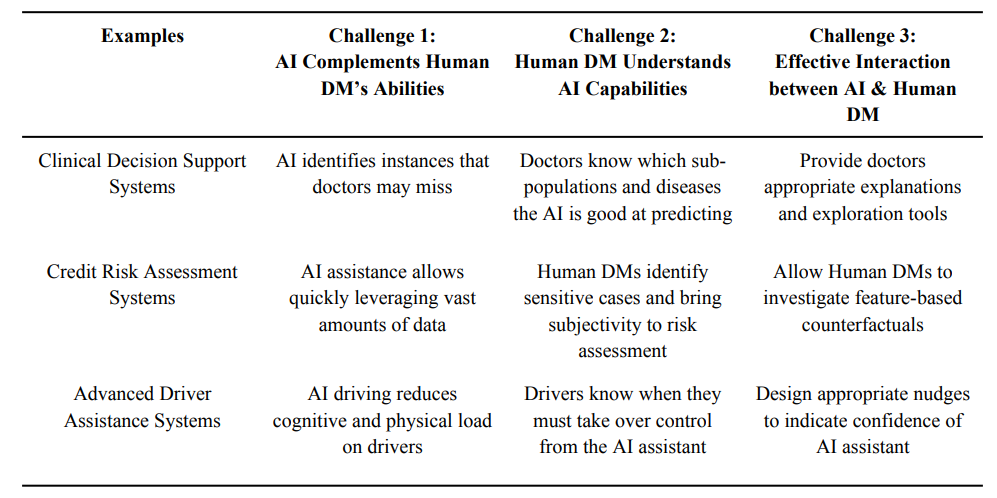

人工智能(AI)通过提供决策建议和与问题相关的信息来协助人类决策者,具有改善人类决策的潜力。然而,要充分发挥人类与人工智能合作的潜力,仍然面临着一些挑战。首先,我们必须了解支持互补性的条件,即人类在人工智能辅助下的表现超过无辅助的人类或单独的人工智能的情况。这项任务要求人类能够识别在哪些情况下应该利用人工智能,以及开发新的人工智能系统,使其能够学习如何与人类决策者互补。其次,我们需要准确评估人类对人工智能的心理模型,其中既包括对人工智能的期望,也包括依赖策略。第三,我们需要了解不同的人机交互设计选择所产生的影响,包括人工智能辅助的时机以及应该向人类决策者展示的模型信息量,以避免认知超载和无效的依赖策略。针对这三大挑战,我们将基于最新的经验和理论研究成果提出跨学科观点,并讨论新的研究方向。

成为VIP会员查看完整内容

相关内容

Arxiv

224+阅读 · 2023年4月7日

Arxiv

152+阅读 · 2023年3月29日

Arxiv

85+阅读 · 2023年3月21日