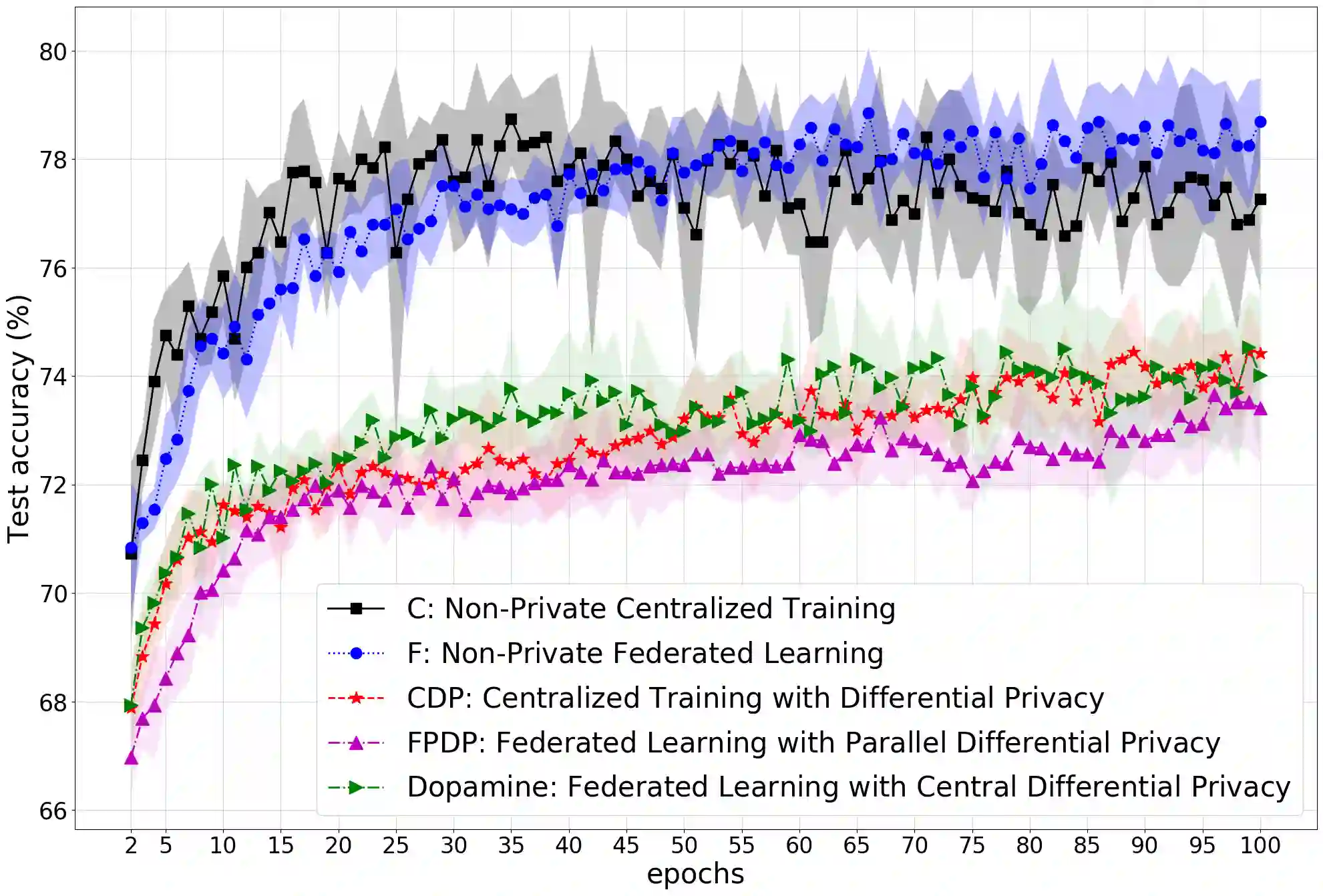

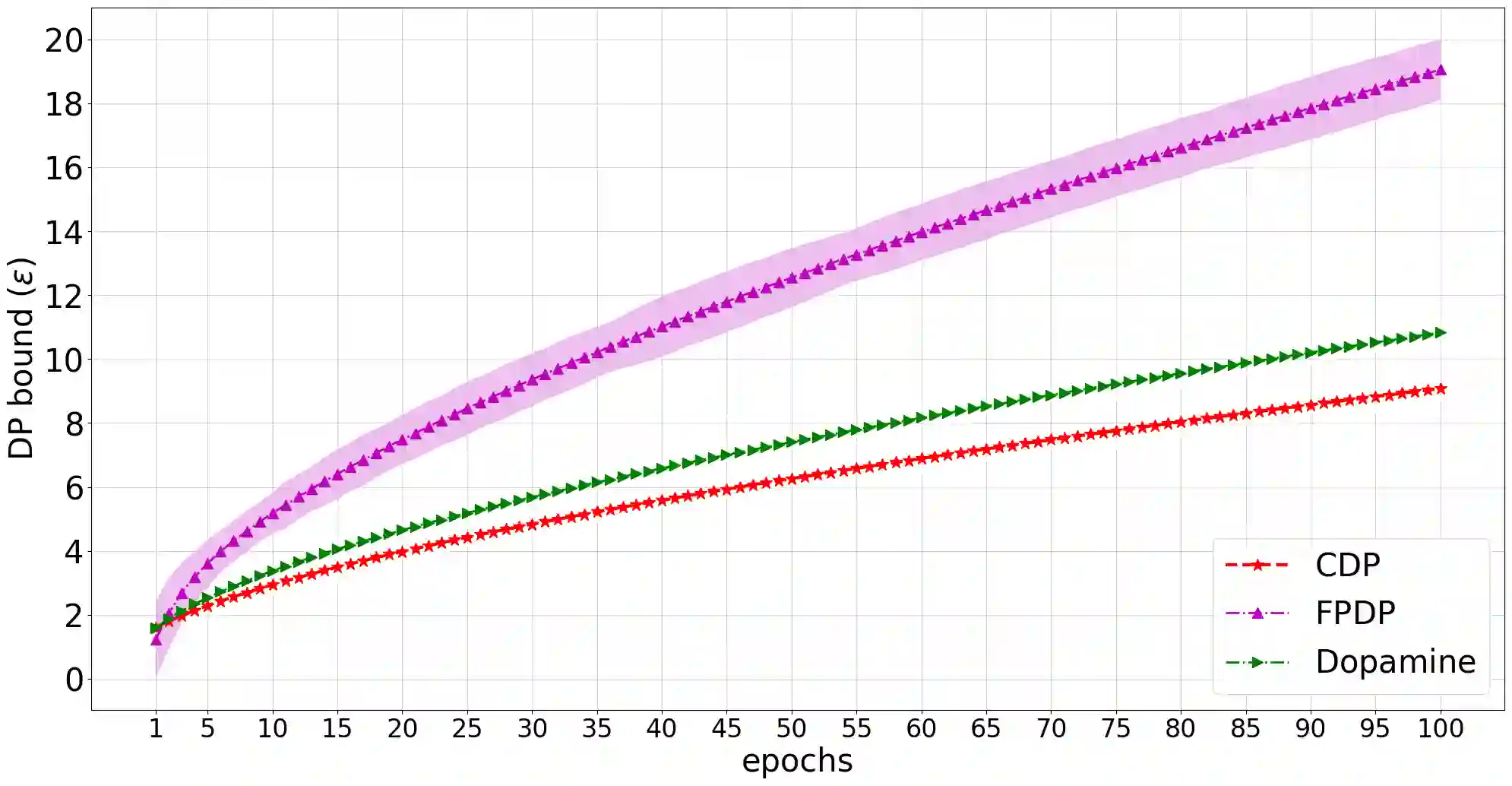

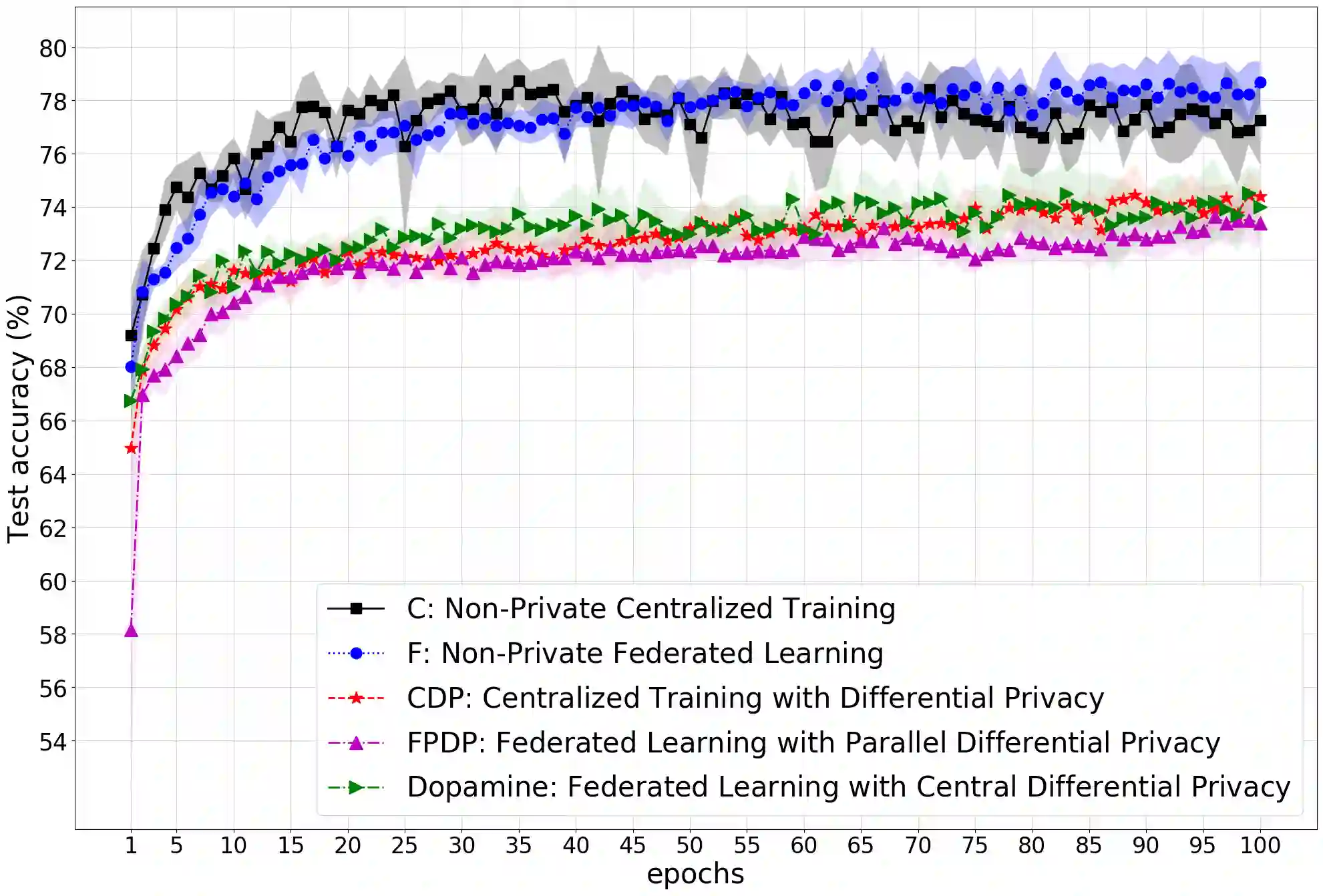

While rich medical datasets are hosted in hospitals distributed across the world, concerns on patients' privacy is a barrier against using such data to train deep neural networks (DNNs) for medical diagnostics. We propose Dopamine, a system to train DNNs on distributed datasets, which employs federated learning (FL) with differentially-private stochastic gradient descent (DPSGD), and, in combination with secure aggregation, can establish a better trade-off between differential privacy (DP) guarantee and DNN's accuracy than other approaches. Results on a diabetic retinopathy~(DR) task show that Dopamine provides a DP guarantee close to the centralized training counterpart, while achieving a better classification accuracy than FL with parallel DP where DPSGD is applied without coordination. Code is available at https://github.com/ipc-lab/private-ml-for-health.

翻译:虽然分布在世界各地的医院拥有丰富的医疗数据集,但患者隐私问题阻碍了使用这类数据来培训深神经网络进行医疗诊断,我们提议多帕胺,这是一个在分布数据集方面培训DNN的系统,该系统采用有差别的私人学习梯度(DPSGD),结合安全的汇总,可以在不同的隐私保障(DP)和DNN的准确性之间比其他方法建立更好的权衡。糖尿病复方疗法(DR)任务的结果显示,多帕胺提供了接近集中培训对应方的DP保证,同时在没有协调的情况下使用DPSGD平行的DP实现比FL更好的分类准确性。可在https://github./ com-ipc-lab/perty-ml-for-healhealth上查阅《守则》。