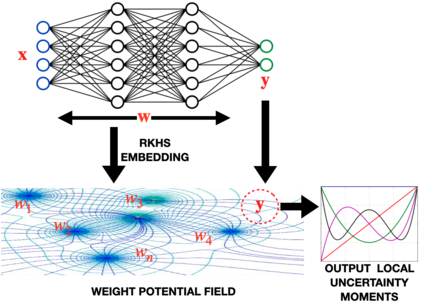

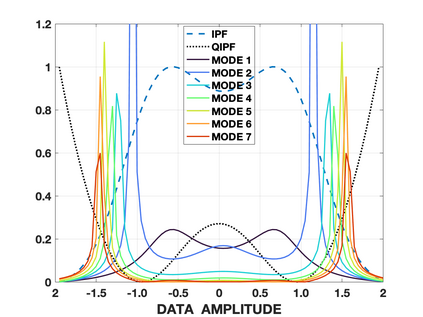

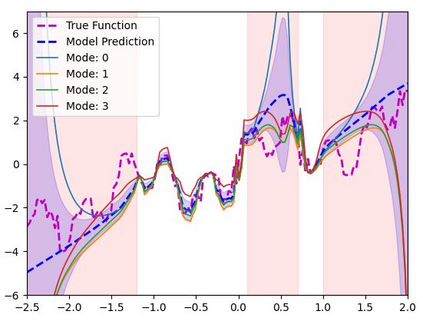

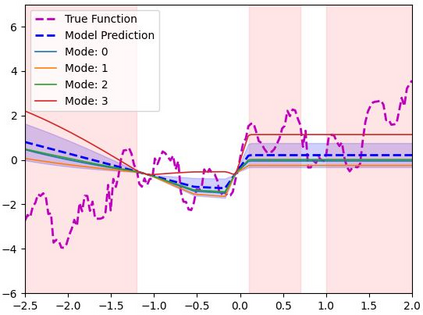

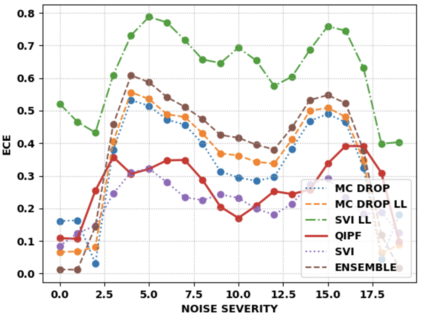

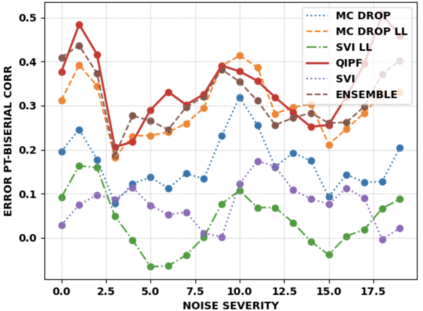

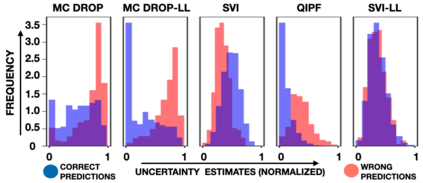

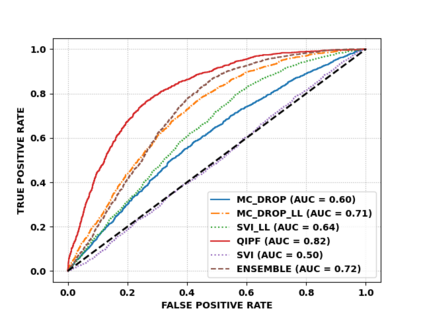

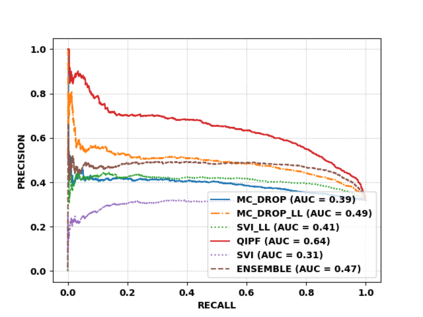

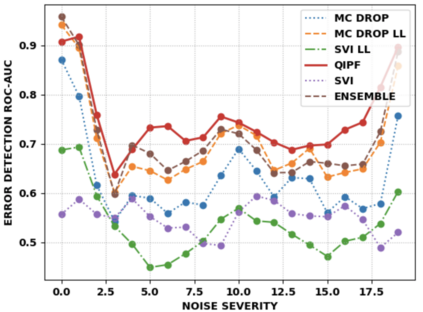

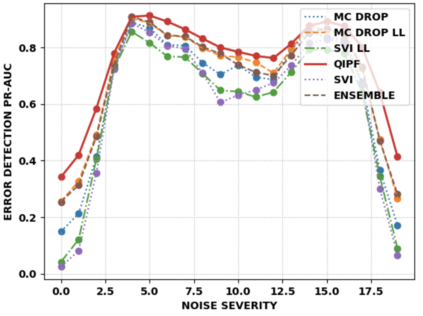

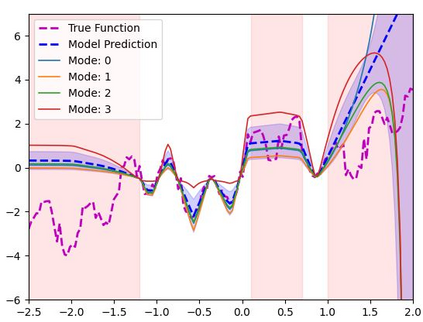

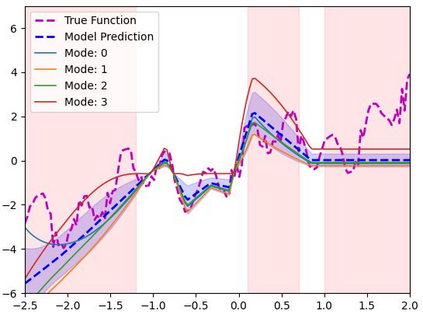

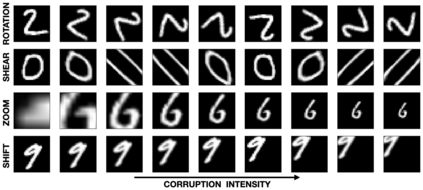

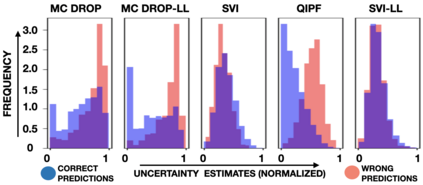

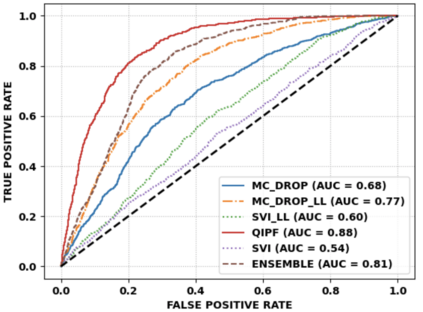

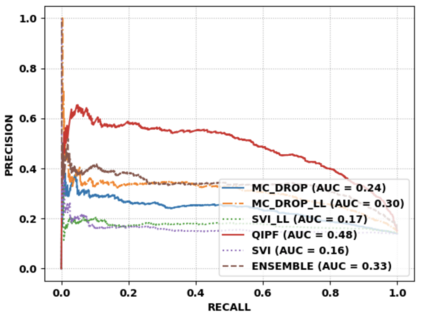

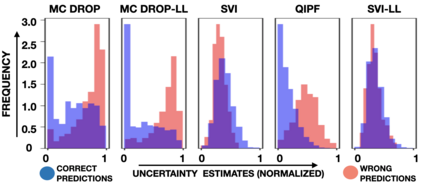

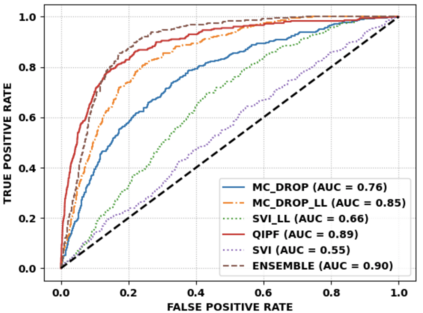

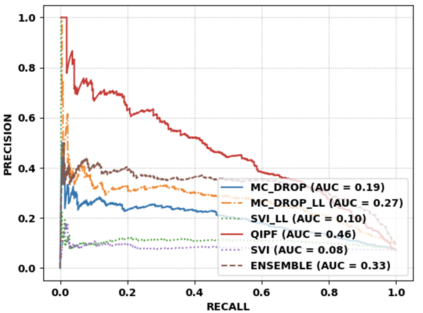

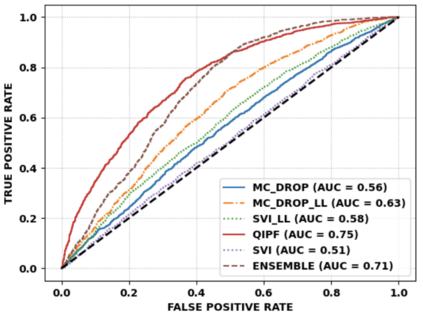

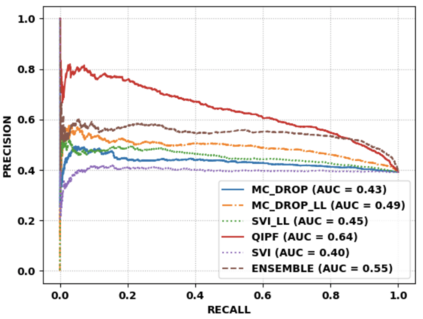

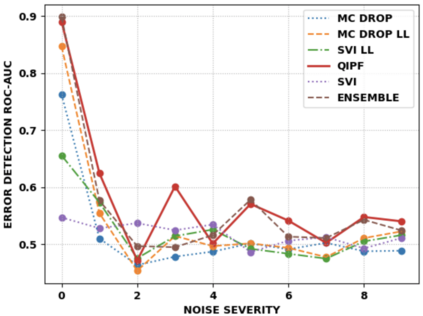

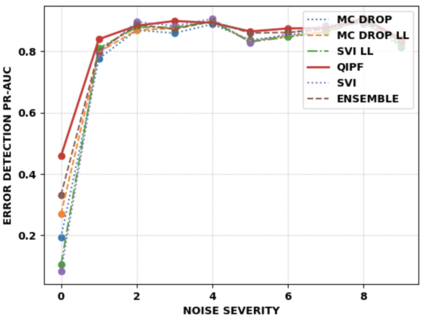

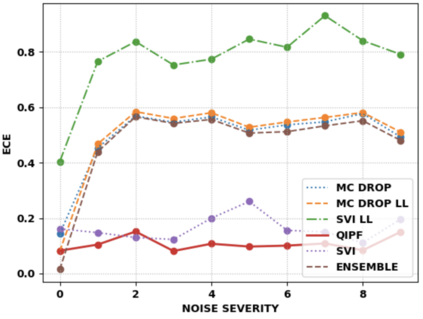

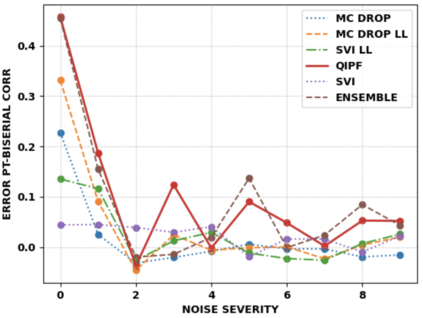

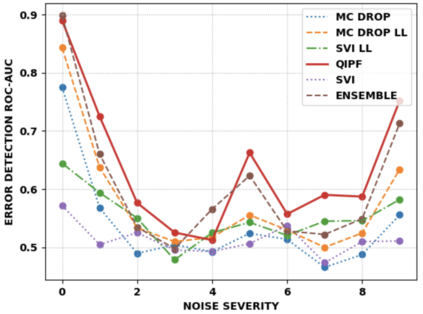

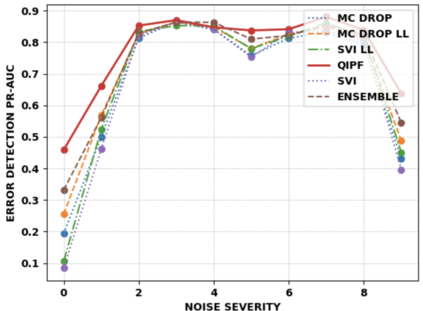

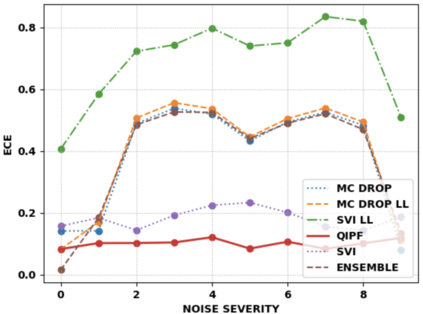

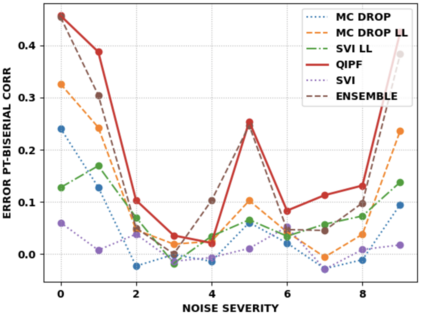

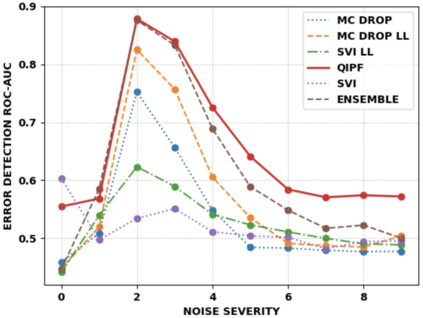

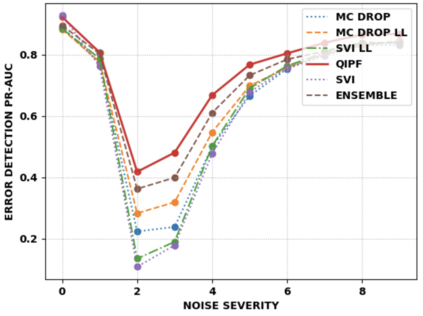

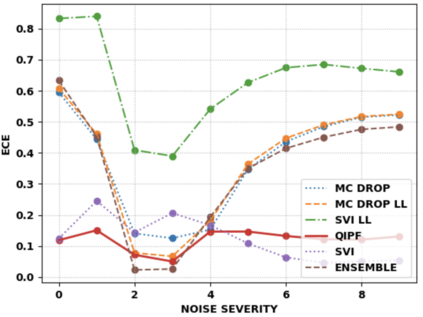

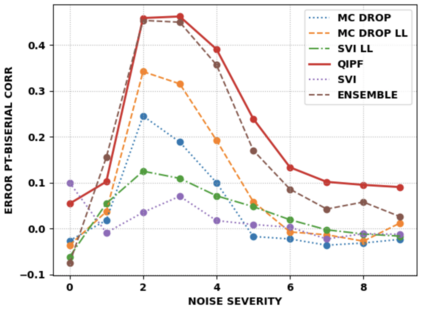

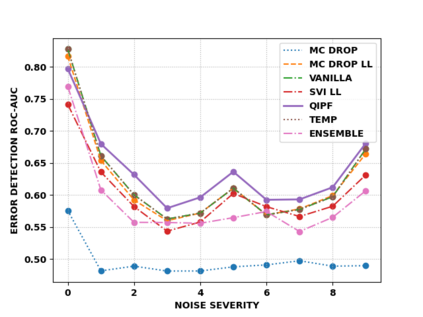

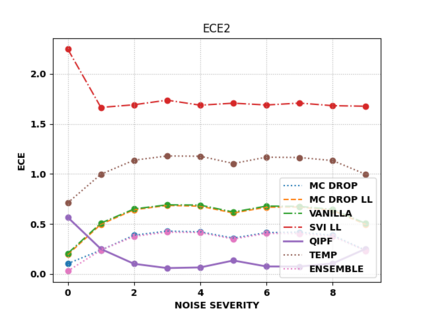

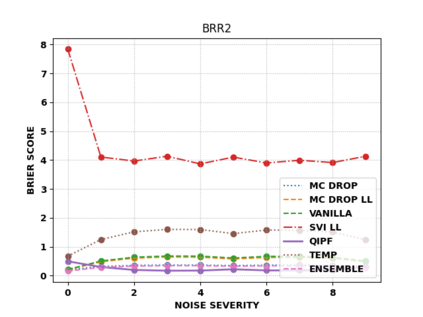

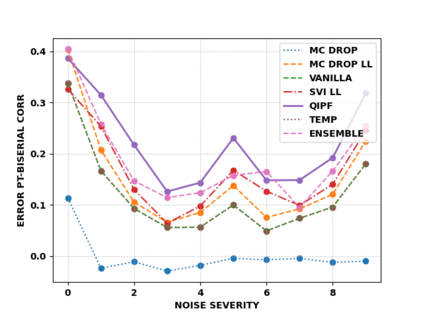

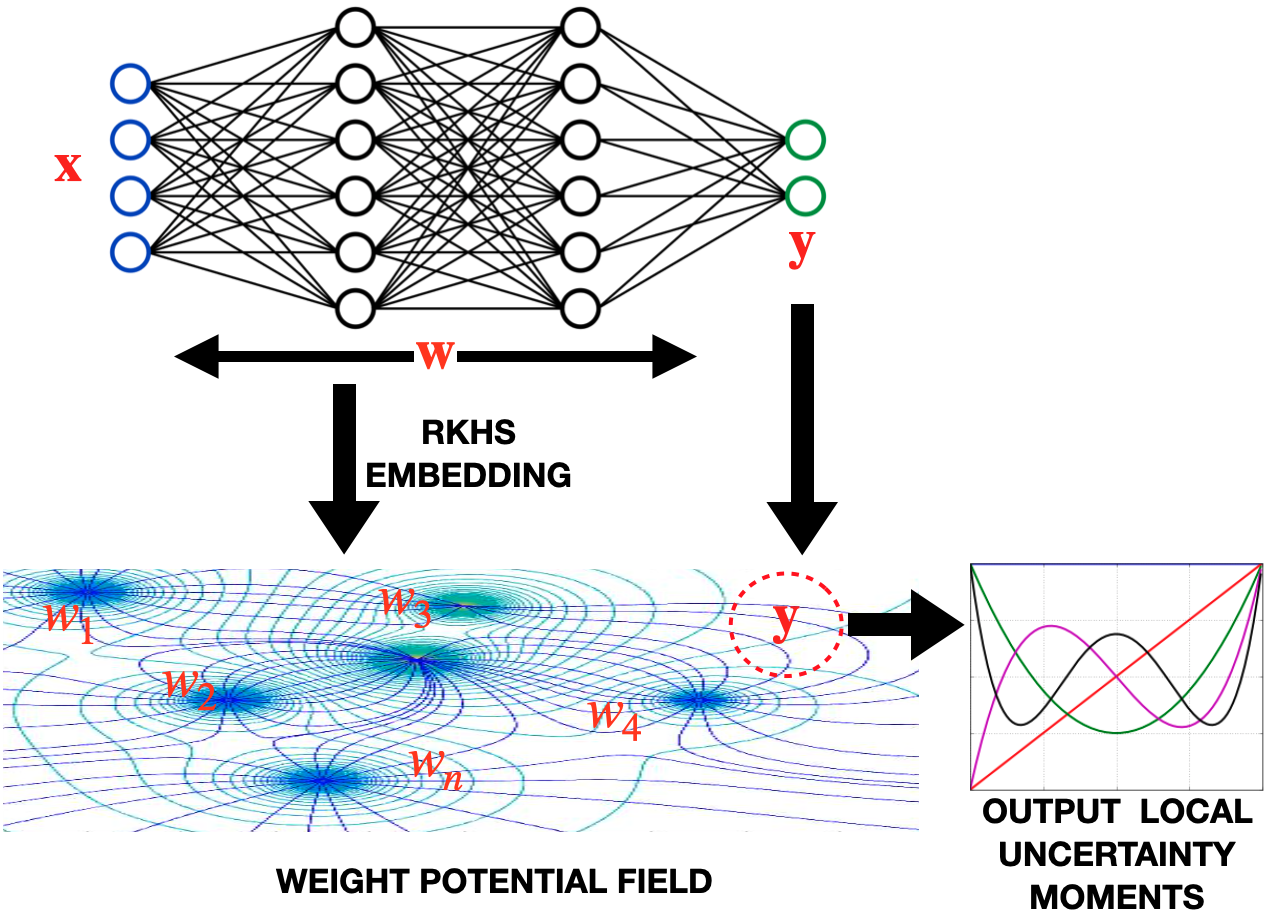

We propose a framework for predictive uncertainty quantification of a neural network that replaces the conventional Bayesian notion of weight probability density function (PDF) with a physics based potential field representation of the model weights in a Gaussian reproducing kernel Hilbert space (RKHS) embedding. This allows us to use perturbation theory from quantum physics to formulate a moment decomposition problem over the model weight-output relationship. The extracted moments reveal successive degrees of regularization of the weight potential field around the local neighborhood of the model output. Such localized moments represent well the PDF tails and provide significantly greater accuracy of the model's predictive uncertainty than the central moments characterized by Bayesian and ensemble methods or their variants. We show that this consequently leads to a better ability to detect false model predictions of test data that has undergone a covariate shift away from the training PDF learned by the model. We evaluate our approach against baseline uncertainty quantification methods on several benchmark datasets that are corrupted using common distortion techniques. Our approach provides fast model predictive uncertainty estimates with much greater precision and calibration.

翻译:我们提出一个神经网络预测不确定性量化框架,以基于物理的潜在外表形式取代传统的巴伊西亚体重概率密度功能概念(PDF),以物理为基础的模型重量在高森复制内核循环的希尔伯特空间(RKHS)嵌入中的潜在外表。这使我们能够利用量子物理的扰动理论来形成一个瞬间分解问题,而不是模型重量-输出关系的模型。提取的瞬间揭示出在模型输出的当地周围对重量潜力领域的连续调整程度。这种局部时点代表了PDF尾部的很好表现,并且提供了模型预测不确定性的准确性大大高于Bayesian 和 entible 方法或其变异体所描述的中心时段。我们表明,这因此导致我们更有能力检测试验数据的假模型预测,这种数据已经从模型所学的PDF培训中相异变。我们对照一些基准数据集的基线不确定性量化方法评估了我们的方法,这些基准数据集使用通用的扭曲技术被损坏。我们的方法提供了快速的预测不确定性预测模型,其精确度和校准性要大得多。