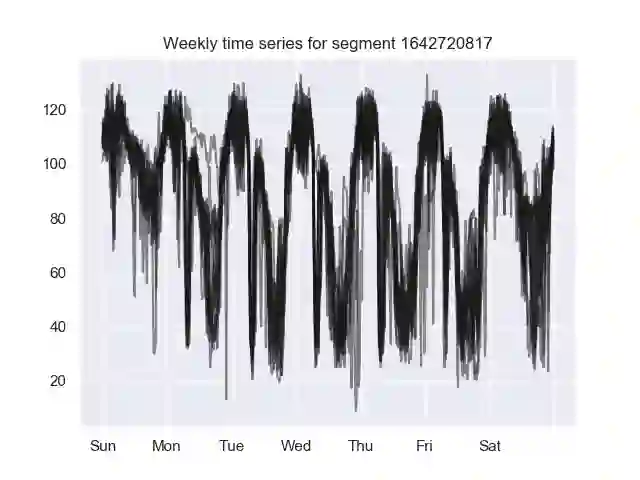

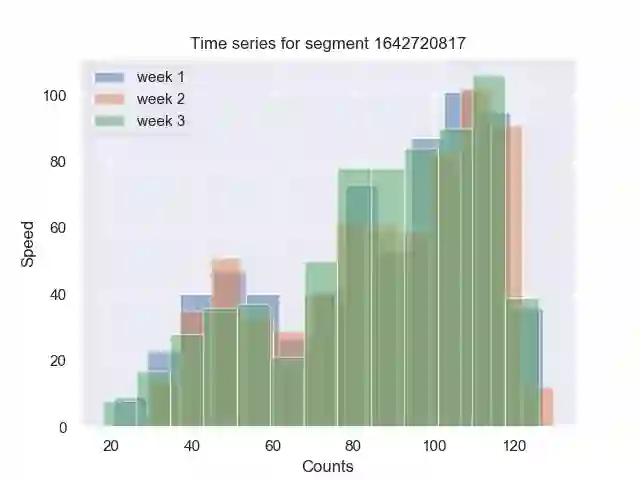

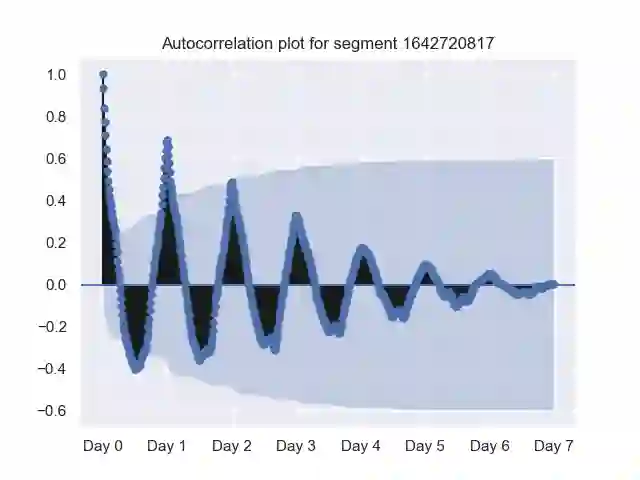

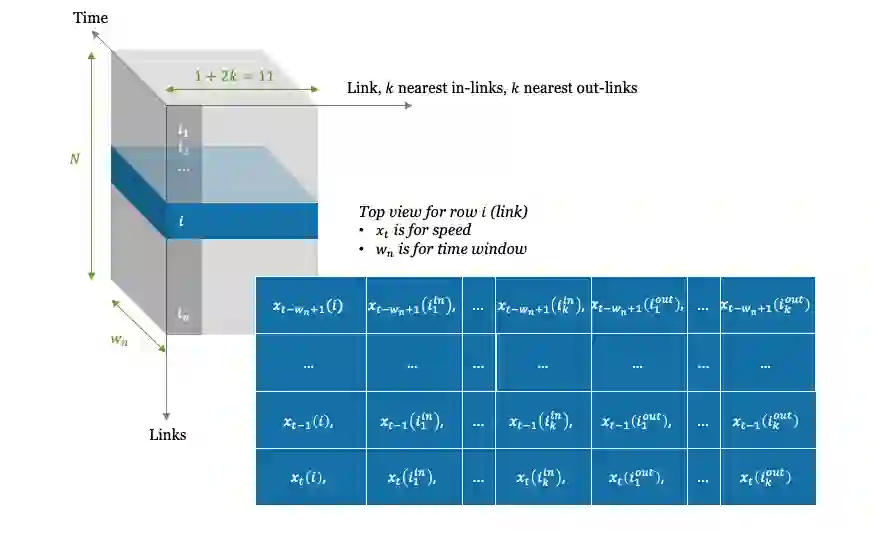

The transport literature is dense regarding short-term traffic predictions, up to the scale of 1 hour, yet less dense for long-term traffic predictions. The transport literature is also sparse when it comes to city-scale traffic predictions, mainly because of low data availability. In this work, we report an effort to investigate whether deep learning models can be useful for the long-term large-scale traffic prediction task, while focusing on the scalability of the models. We investigate a city-scale traffic dataset with 14 weeks of speed observations collected every 15 minutes over 1098 segments in the hypercenter of Los Angeles, California. We look at a variety of state-of-the-art machine learning and deep learning predictors for link-based predictions, and investigate how such predictors can scale up to larger areas with clustering, and graph convolutional approaches. We discuss that modelling temporal and spatial features into deep learning predictors can be helpful for long-term predictions, while simpler, not deep learning-based predictors, achieve very satisfactory performance for link-based and short-term forecasting. The trade-off is discussed not only in terms of prediction accuracy vs prediction horizon but also in terms of training time and model sizing.

翻译:交通文献大量涉及短期交通预测,其规模高达1小时,但对于长期交通预测而言则不那么密集。交通文献在城市规模交通预测方面也很稀少,这主要是因为数据可得性低。在这项工作中,我们报告努力调查深学习模型是否对长期大规模交通预测任务有用,同时侧重于模型的可缩放性。我们调查了一个城市规模交通数据集,每15分钟在加利福尼亚州洛杉矶最高中心每1098个区段收集14周的速度观测,每15分钟收集一次,但对于长期交通预测而言则不那么密集。我们研究各种最先进的机器学习和深度学习预测器,以进行基于链接的预测,并调查这些预测器如何通过集群和图示革命方法向更大的地区扩展。我们讨论将时间和空间特征建模成深学习预测器可有助于长期预测,同时简单、不深学习的预测器则为基于链接和短期预测取得非常令人满意的业绩。我们不仅在预测准确度方面讨论贸易交易,而且还在预测与预测时间模型方面讨论。