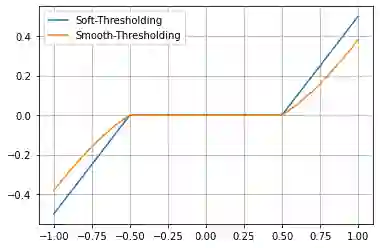

In this paper, we propose a novel layer based on fast Walsh-Hadamard transform (WHT) and smooth-thresholding to replace $1\times 1$ convolution layers in deep neural networks. In the WHT domain, we denoise the transform domain coefficients using the new smooth-thresholding non-linearity, a smoothed version of the well-known soft-thresholding operator. We also introduce a family of multiplication-free operators from the basic 2$\times$2 Hadamard transform to implement $3\times 3$ depthwise separable convolution layers. Using these two types of layers, we replace the bottleneck layers in MobileNet-V2 to reduce the network's number of parameters with a slight loss in accuracy. For example, by replacing the final third bottleneck layers, we reduce the number of parameters from 2.270M to 540K. This reduces the accuracy from 95.21\% to 92.98\% on the CIFAR-10 dataset. Our approach significantly improves the speed of data processing. The fast Walsh-Hadamard transform has a computational complexity of $O(m\log_2 m)$. As a result, it is computationally more efficient than the $1\times1$ convolution layer. The fast Walsh-Hadamard layer processes a tensor in $\mathbb{R}^{10\times32\times32\times1024}$ about 2 times faster than $1\times1$ convolution layer on NVIDIA Jetson Nano computer board.

翻译:在本文中, 我们提出一个基于 Walsh- Hadamard 快速变换 (WHT) 和 平滑配置的新层次, 以取代深神经网络中的 1 美元 乘积层 。 在 WHT 域中, 我们使用新的平滑保持非线性, 将变异域系数缩放, 这是已知的软保持操作器的平滑版本 。 我们还引入了一个从基本 2 美元 的 2 美元 乘积速度 2 美元 2 Hadamard 变换为 3 美元 的 深度可调和层 。 我们的方法大大提高了数据处理速度 3 3 美元 的 深度 。 使用这两类层, 我们替换了 MovedNet- V2 的挂载层, 以降低网络参数数量, 准确度略微下降。 例如, 我们通过替换最后的第三层, 将参数从 2, 270 m\\\\ 平时 降为 5 21 美元 到 92.98 美元 10 。 我们的方法极大地提高了数据处理速度的速度。 。 。 快速 变换 。 将 美元 的 。