【谷歌大脑&DeepMind】联合发布"离线强化学习基准",将各种RL研究从线上转为线下

深度强化学习实验室报道

来源:新智元

编辑: DeepRL

【新智元导读】离线强化学习方法可以帮我们弥合强化学习研究与实际应用之间的差距。近日,Google和DeepMind推出的RL Unplugged使从离线数据集中学习策略成为可能,从而克服了现实世界中与在线数据收集相关的问题,包括成本,安全性等问题。

为什么需要离线强化学习

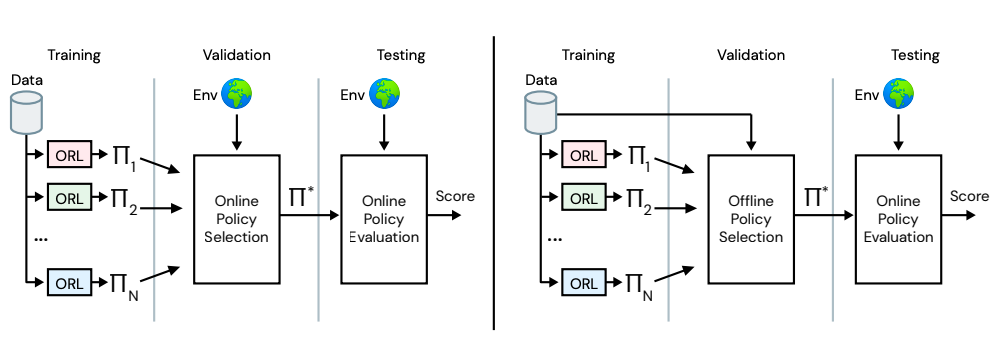

在实时 RL 中,算法在线收集学习经验

在实时 RL 中,算法在线收集学习经验

在离线 RL 中,经验都是离线收集

在离线 RL 中,经验都是离线收集

离线强化学习的难点在哪?

之前,对 RL 进行离线基准测试的方法仅限于一个场景: 数据集来自某个随机或先前训练过的策略,算法的目标是提高原策略的性能。 这种方法的问题是,现实世界的数据集不可能由单一的 RL 训练的策略产生,而且这种方法不能泛化到其他的场景。

RL Unplugged让离线强化学习成为现实

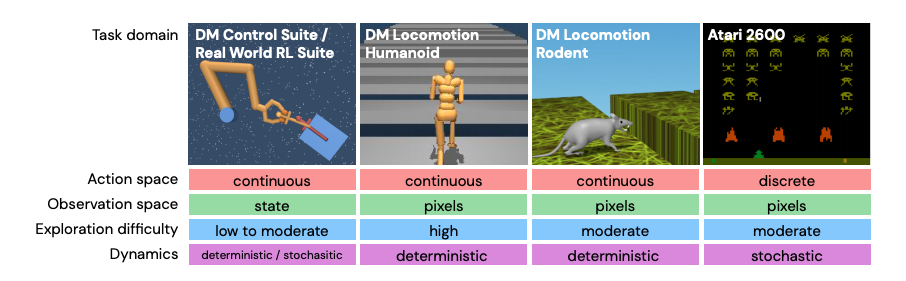

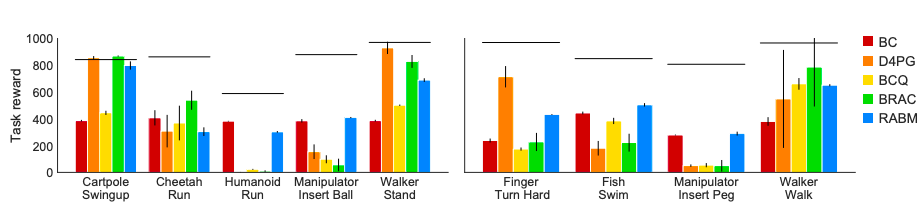

DM Control Suite,是在MuJoCo中实现的一组控制任务。

DM Locomotion,是涉及类人动物的运动任务。

Atari 2600,街机学习环境(ALE)套件,包含57套Atari 2600游戏(Atari57)。

Real-world Reinforcement Learning Suite,包括高维状态和动作空间,较大的系统延迟,系统约束,多目标,处理非平稳性和部分可观察性等任务。

完

总结3: 《强化学习导论》代码/习题答案大全

总结6: 万字总结 || 强化学习之路

完

第66篇:分布式强化学习框架Acme,并行性加强

第65篇:DQN系列(3): 优先级经验回放(PER)

第64篇:UC Berkeley开源RAD来改进强化学习算法

第61篇:David Sliver 亲自讲解AlphaGo、Zero

第59篇:Agent57在所有经典Atari 游戏中吊打人类

第58篇:清华开源「天授」强化学习平台

第57篇:Google发布"强化学习"框架"SEED RL"

第53篇:TRPO/PPO提出者John Schulman谈科研

第52篇:《强化学习》可复现性和稳健性,如何解决?

第51篇:强化学习和最优控制的《十个关键点》

第50篇:微软全球深度强化学习开源项目开放申请

第49篇:DeepMind发布强化学习库 RLax

第48篇:AlphaStar过程详解笔记

第47篇:Exploration-Exploitation难题解决方法

第45篇:DQN系列(1): Double Q-learning

第44篇:科研界最全工具汇总

第42篇:深度强化学习入门到精通资料综述

第41篇:顶会征稿 || ICAPS2020: DeepRL

第40篇:实习生招聘 || 华为诺亚方舟实验室

第39篇:滴滴实习生|| 深度强化学习方向

第37篇:Call For Papers# IJCNN2020-DeepRL

第36篇:复现"深度强化学习"论文的经验之谈

第35篇:α-Rank算法之DeepMind及Huawei改进

第34篇:从Paper到Coding, DRL挑战34类游戏

第31篇:强化学习,路在何方?

第30篇:强化学习的三种范例

第29篇:框架ES-MAML:进化策略的元学习方法

第28篇:138页“策略优化”PPT--Pieter Abbeel

第27篇:迁移学习在强化学习中的应用及最新进展

第26篇:深入理解Hindsight Experience Replay

第25篇:10项【深度强化学习】赛事汇总

第24篇:DRL实验中到底需要多少个随机种子?

第23篇:142页"ICML会议"强化学习笔记

第22篇:通过深度强化学习实现通用量子控制

第21篇:《深度强化学习》面试题汇总

第20篇:《深度强化学习》招聘汇总(13家企业)

第19篇:解决反馈稀疏问题之HER原理与代码实现

第17篇:AI Paper | 几个实用工具推荐

第16篇:AI领域:如何做优秀研究并写高水平论文?

第14期论文: 2020-02-10(8篇)

第13期论文:2020-1-21(共7篇)

第12期论文:2020-1-10(Pieter Abbeel一篇,共6篇)

第11期论文:2019-12-19(3篇,一篇OpennAI)

第10期论文:2019-12-13(8篇)

第9期论文:2019-12-3(3篇)

第8期论文:2019-11-18(5篇)

第7期论文:2019-11-15(6篇)

第6期论文:2019-11-08(2篇)

第5期论文:2019-11-07(5篇,一篇DeepMind发表)

第4期论文:2019-11-05(4篇)

第3期论文:2019-11-04(6篇)

第2期论文:2019-11-03(3篇)

第1期论文:2019-11-02(5篇)