【动态】CSIG-机器学习中的加速一阶优化算法系列讲座第六讲圆满结束

优化算法是机器学习的重要组成部分,但是传统的优化算法并不完全适用于机器学习,因为通常来说机器学习模型的参数维度很高或涉及的样本数巨大,这使得一阶优化算法在机器学习中占据主流地位。

为了在应用中推广加速一阶优化算法,中国图象图形学学会与浙江师范大学数理医学院、浙江师范大学数学与计算机科学学院、西安科技大学数学与统计学院共同主办了“CSIG-机器学习中的加速一阶优化算法系列讲座”,由中国图象图形学学会机器视觉专委会承办,主讲专家为中国图象图形学学会机器视觉专委会主任林宙辰教授。本次系列讲座分为六讲,从2022年6月17号起,每周五晚8-9点举行。

在前五次讲座取得巨大成功后。7月22号晚上8点,林宙辰教授在线上做了本次系列讲座的最后一讲,关于并行优化方法的加速,特别针对并行加速算法中颇受关注的加速异步梯度下降法和流行的分布式加速算法进行了详细地讲解。本次讲座十分受关注,讲座直播由腾讯会议和第三方蔻享直播同时进行。

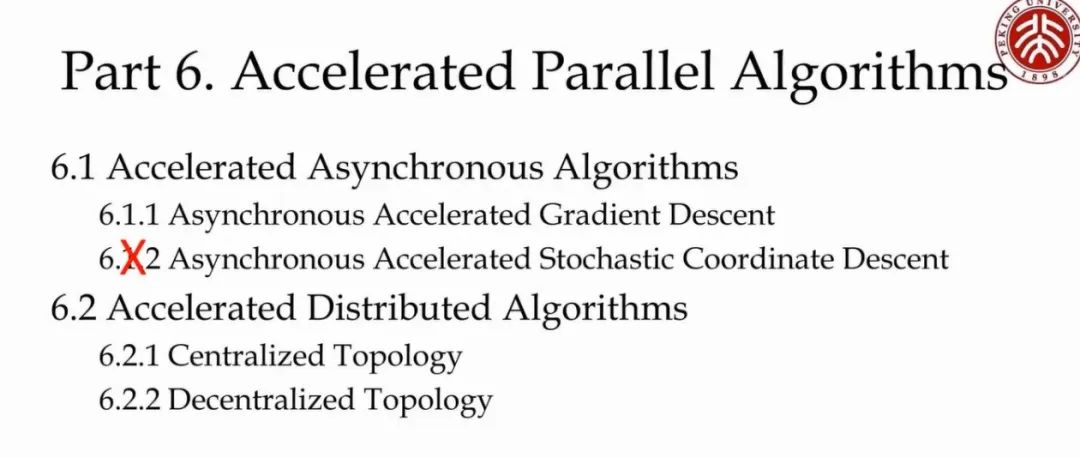

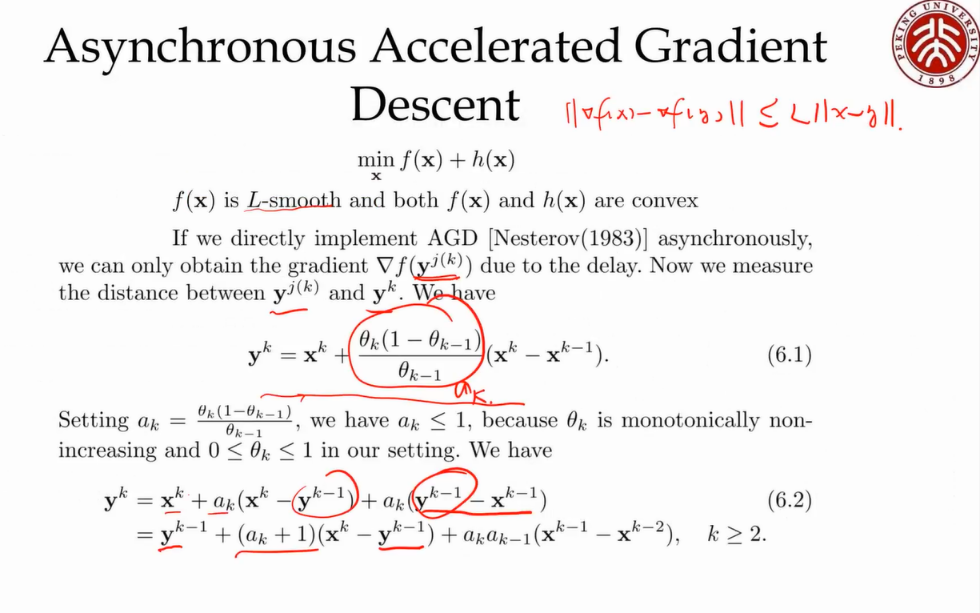

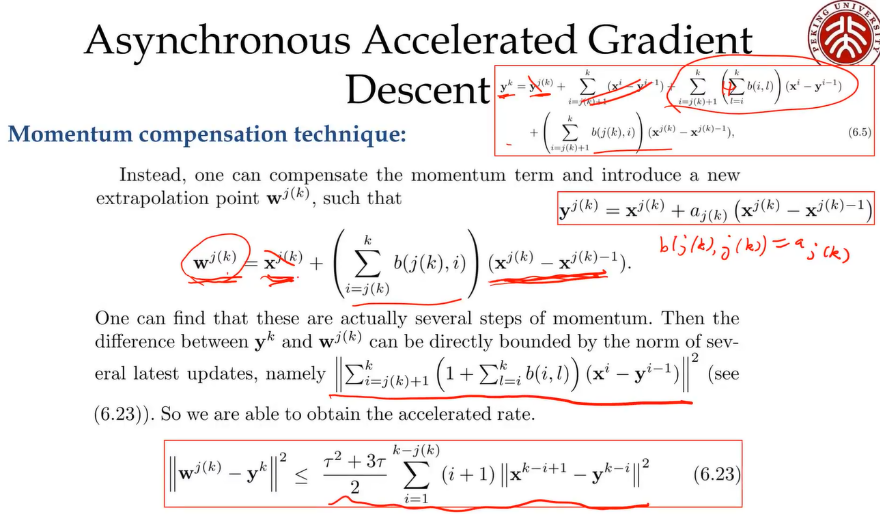

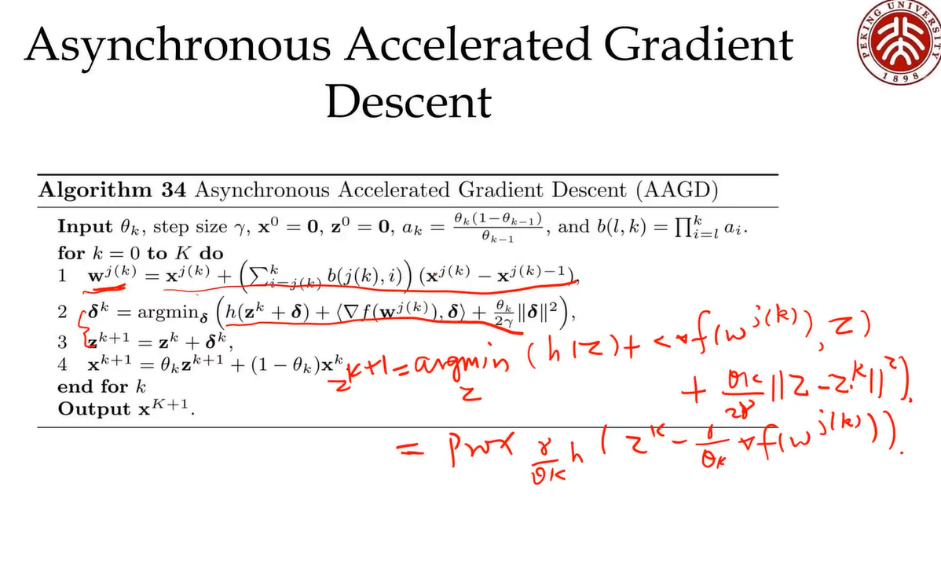

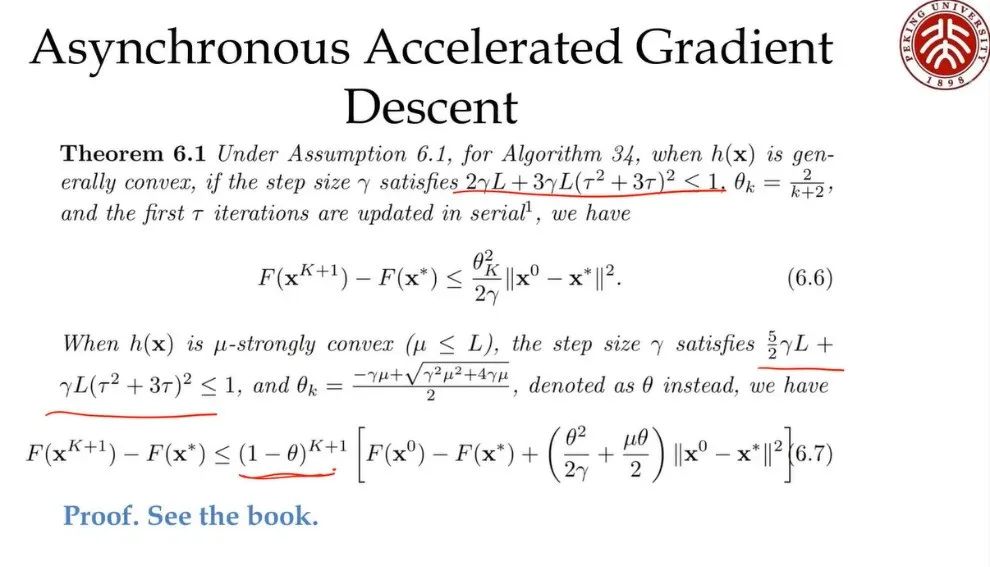

林宙辰教授首先细致介绍了异步梯度算法的应用背景和基本概念,并就atom锁定写入情况下的算法进行讲解,对加速异步算法中的冲量补偿技术和有界延迟情况下的异步加速梯度算法进行了深入浅出地讲解,并介绍了异步加速梯度算法的收敛效率。

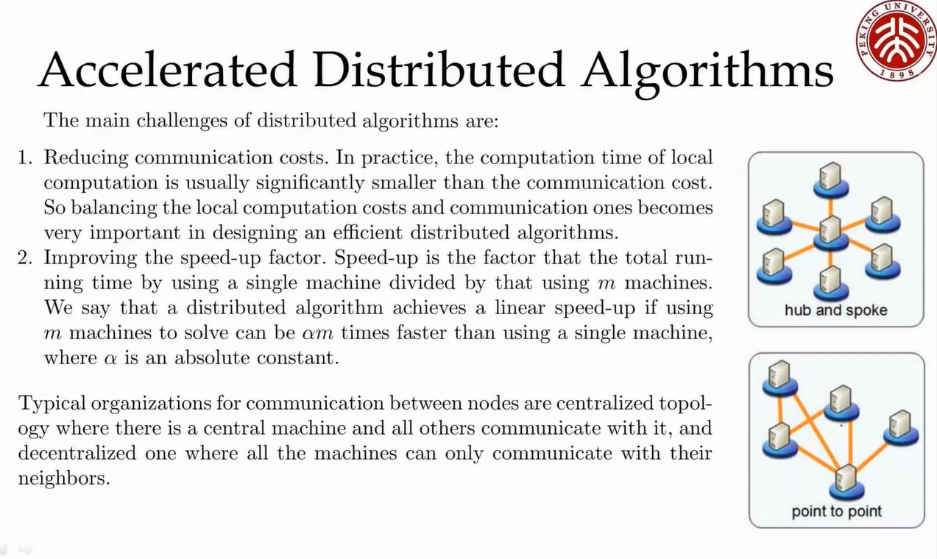

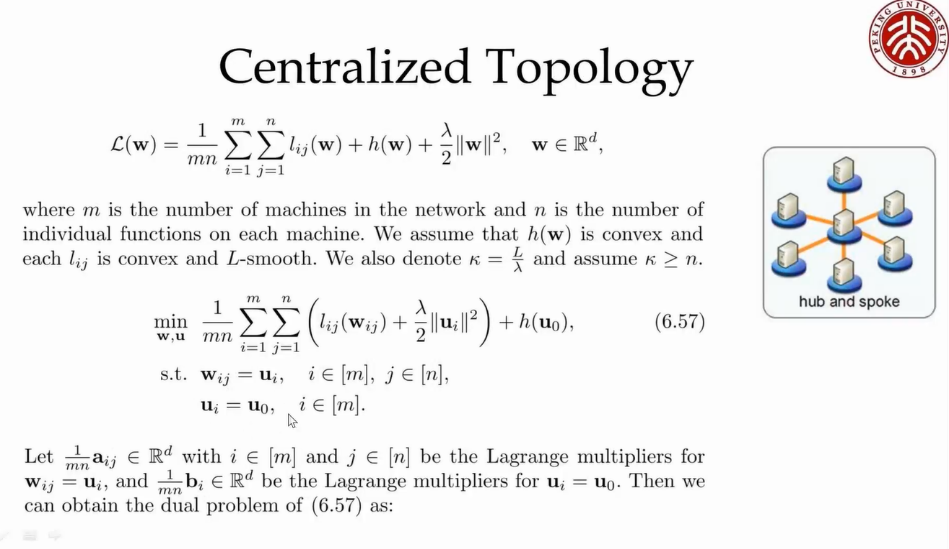

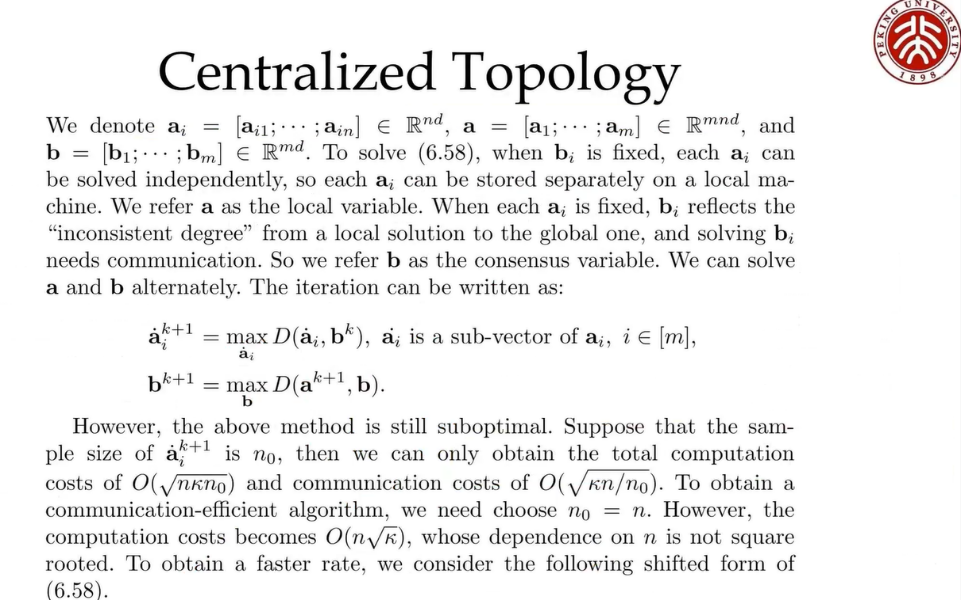

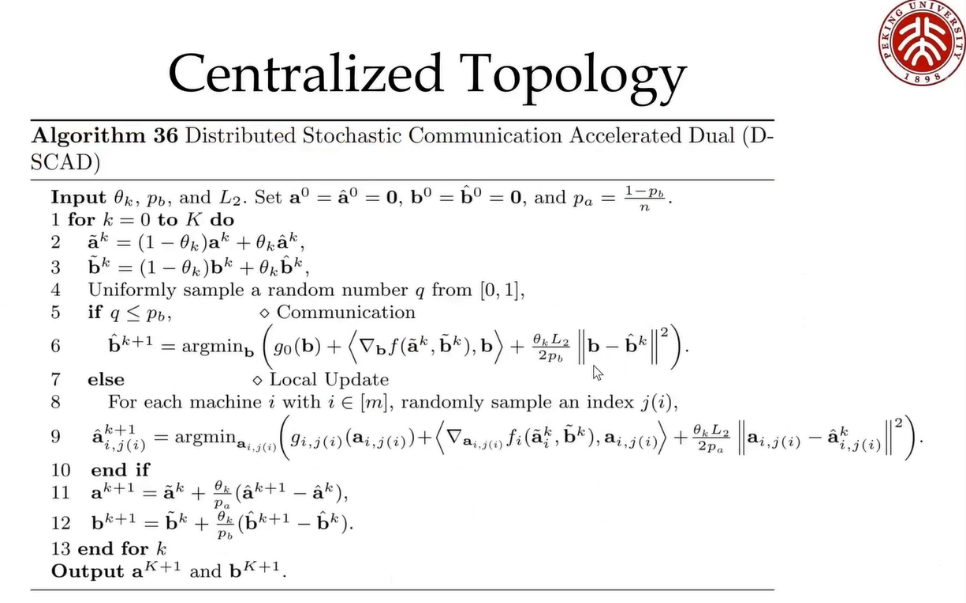

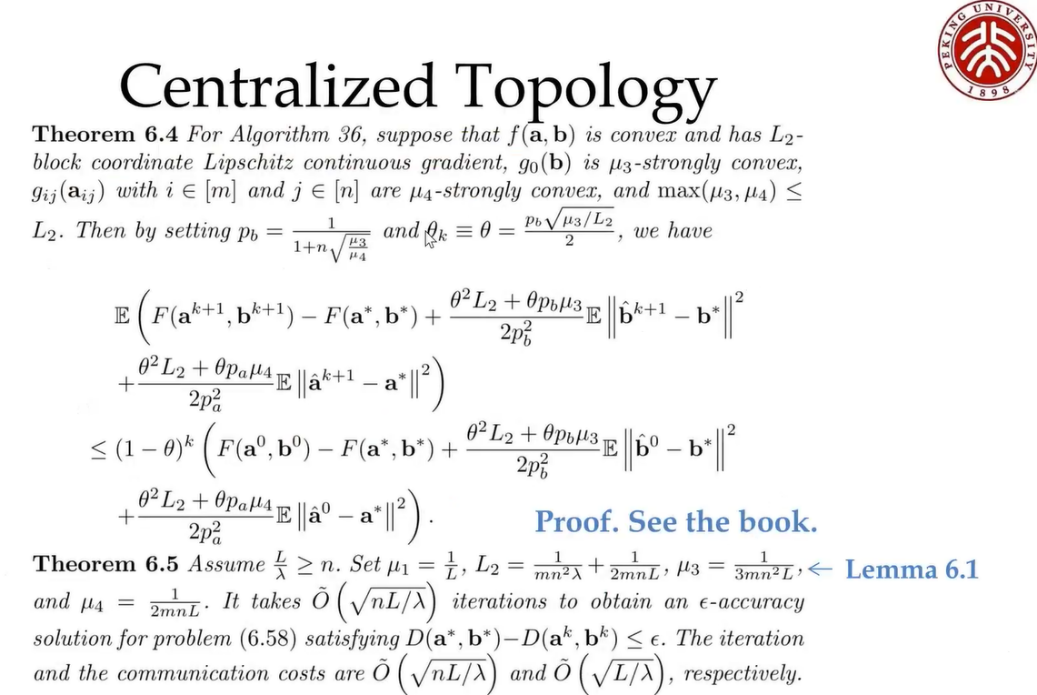

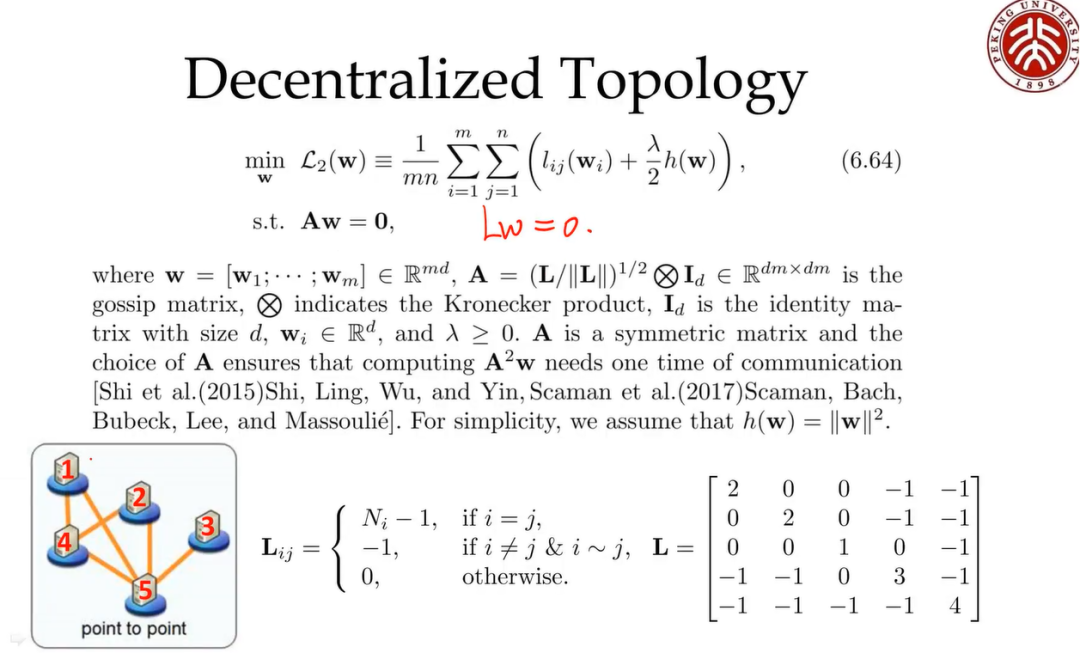

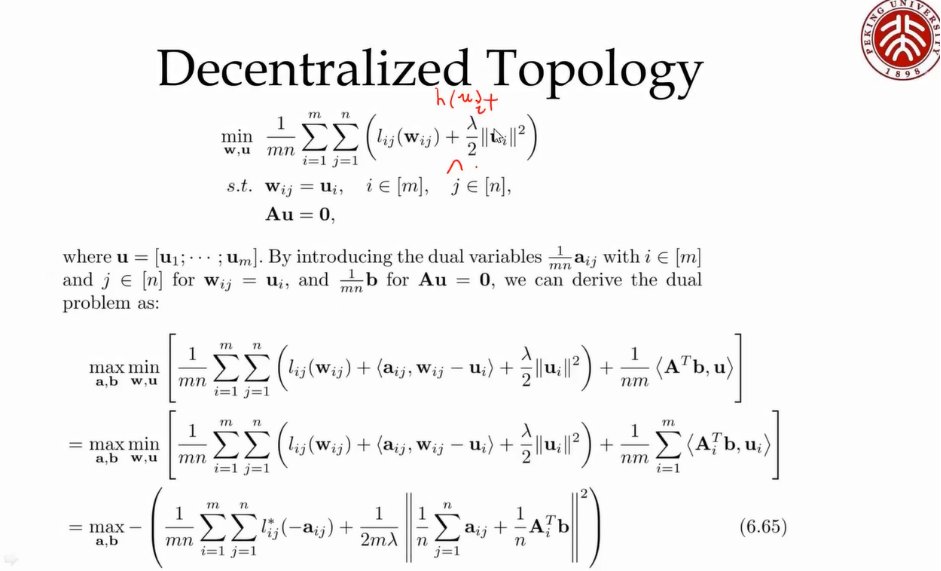

然后,林宙辰教授开始就分布式算法的中心化和去中心化两种基本实现方式,详细讲述了中心化算法实现以及随机通讯设定下的加速算法,并展示了它们的收敛性质和计算复杂度分析中的关键性步骤和引理。

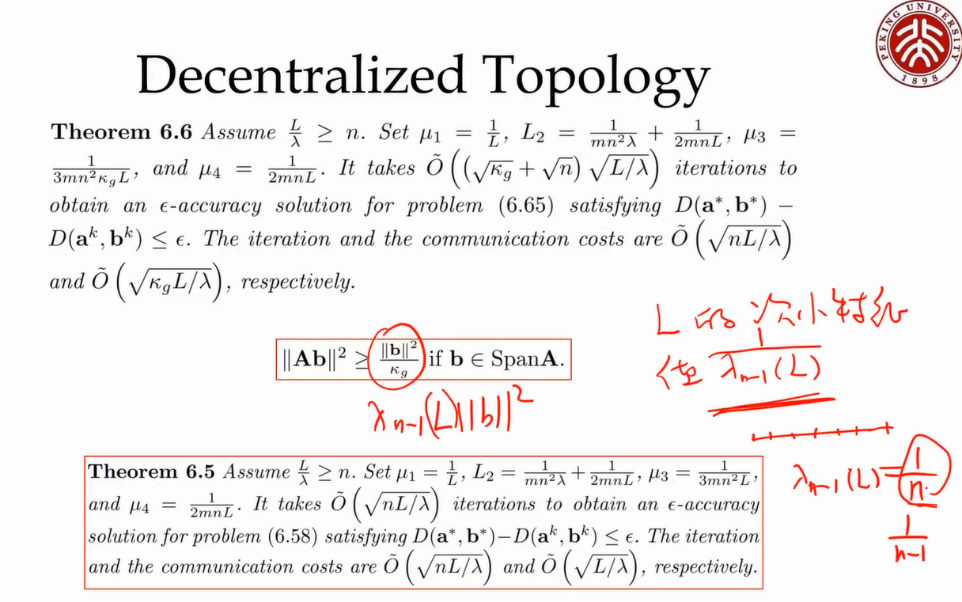

接着,林宙辰教授又进一步介绍了去中心化算法的实现方式,并概括性讲解了去中心化加速算法的收敛性质和计算复杂度分析中的两个关键性引理。

演讲结束后,林宙辰教授耐心回答了在线同学和老师的踊跃提问。整个讲座生动有趣,内容丰富,原定一个小时的讲座时间又延长到一个多小时,听众反映干货满满,收获多多。

图为林宙辰教授专著《机器学习中的加速一阶优化算法》的英文版和中文版,以及刚出版的新书《Alternating Direction Method of Multipliers for Machine Learning》

林宙辰教授本系列讲座的六次报告均已上传B站,供大家学习交流:https://space.bilibili.com/397105012/video。

来源:CSIG机器视觉专委会