【紫冬声音】从无到有!自动化所提出海量虚拟数据生成新方法

赋予机器人类水平的想象力,使之能够自主地感知环境和创造图画是人工智能领域的前沿方向。近日,中科院自动化所智能感知与计算研究中心提出一种新的人脸图像数据生成方法,能够从无到有地生产出20万张在真实世界不存在的人脸虚拟图像。该方法能够有效缓解异质人脸识别中数据采集成本高昂的问题,充分利用少量真实样本进行深度学习。科研人员借助这些生成的逼真虚拟图像,在近红外-可见光、热红外-可见光、素描-照片、侧脸-正脸、身份证-相机照片等一系列具有挑战性的人脸识别应用中都观测到了显著的识别性能提升。

目前,该论文已被NeurIPS2019大会接收为Spotlight。NeurIPS为人工智能领域国际顶级学术会议,今年共收到6743篇投稿,最终收录1428篇论文(包含36篇Oral和164篇Spotlights),Oral+Spotlights接受率仅为2.9%。

研究背景

异质人脸识别在现实生活中有着十分广泛的应用前景,却也面临着众多挑战。例如,近红外传感器对于光照变化具有很好的鲁棒性,即使在黑暗环境下也能清晰成像。因此,主流手机厂商(如苹果、华为、小米等),均采用近红外人脸识别技术。但是,由于近红外和可见光数据之间巨大的域差异以及配对异质数据的严重不足,异质人脸识别问题仍未彻底解决。

近年来兴起的高质量图像生成技术给异质人脸识别带来了新颖而经济的解决思路。然而,以往基于生成模型的方法多采用条件图像生成的方式实现不同图像域之间的转换,从而减小域差异。这类方法面临着两个主要的问题(以近红外-可见光异质数据为例):

(1) 多样性不足。给定一张近红外图像,基于条件图像生成的方法只能合成一张可见光图像。这意味着这种方式在小样本数据条件下只能合成少量数据。另外,合成的可见光图像与原始的近红外图像相比,除了光谱信息变化外,其他属性(例如姿态和表情)都保持不变。这导致生成数据和原始的近红外数据之间的类内多样性有限。

(2) 身份信息难以保持。基于条件图像生成的方法要求生成的可见光图像与原始输入的近红外图像保持完全相同的身份。然而,由于缺乏对类内和类间距离的有效约束,在实际算法中,身份信息很难充分保持。

方法简述

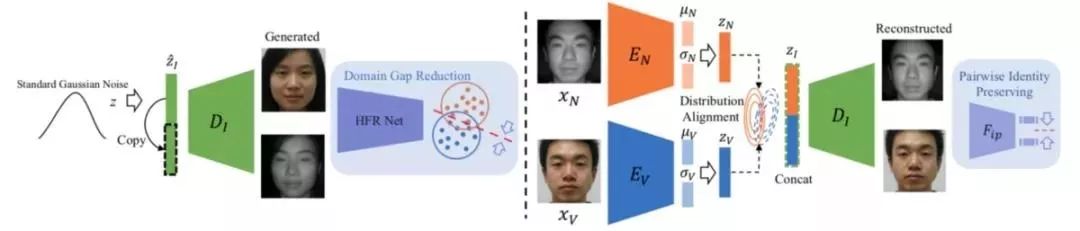

图1. 对偶图像生成方法框架图

图1的左半部分显示了我们提出的对偶生成模型(Dual Variational Generation, DVG)的目的。对偶生成模型属于无条件生成模型,通过从噪声中生成大规模的配对虚拟数据作为数据增广,减小异质人脸识别网络中的域差异。为了实现这一目的,我们精心设计了一个对偶变分自编码器,如图1的右半部分所示。给定一对具有相同身份的配对异质人脸数据,对偶变分自编码器在隐空间中学习配对异质数据的联合分布。为了保证生成的配对异质数据的身份一致性,我们分别在隐空间和像素空间中施加了分布对齐损失和成对身份保持损失。

通过这种方式,我们赋予机器一定程度的想象力。如图2所示,生成的配对异质数据在姿态、表情等属性上都具有一定的差异,因此生成的虚拟数据具有丰富的类内多样性。此外,不同于基于条件图像生成的方法,对偶生成模型不再要求生成的数据属于具体的某个类别,只约束生成的配对异质数据之间的身份一致性。

应用

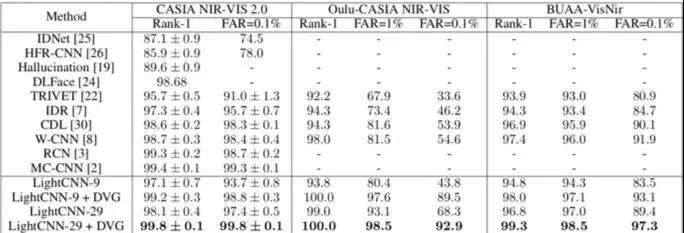

我们在CASIA NIR-VIS 2.0、Oulu-CASIA NIR-VIS和BUAA-VisNir三个NIR-VIS数据库上验证对偶生成模型的有效性。图2显示出我们生成的高质量虚拟数据具有丰富的类内多样性,如姿态表情等。表1的量化结果显示,使用生成的虚拟数据后,识别性能大幅度提升(‘+DVG’表示使用生成的虚拟数据)。例如在Oulu-CASIA NIR-VIS数据库上,VR@FAR=0.1%提升了24.6%(DVG 92.9% - LightCNN-29 68.3%)。我们的方法在三个NIR-VIS数据库上都取得了当前最好的识别性能。

图2. 对偶生成结果(生成现实世界中不存在的配对人脸图像)

表1. 量化结果对比

2.热红外-可见光(Thermal-VIS)

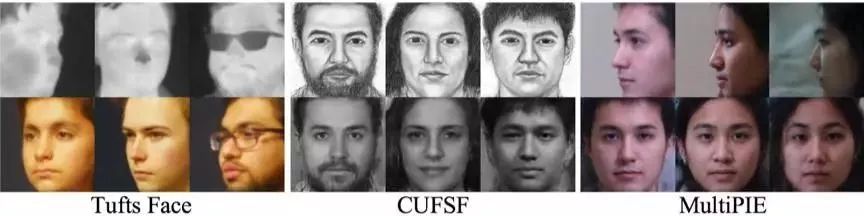

由于热成像仪可以捕捉人体发出的热辐射,在低光或黑暗环境下成像,因此被广泛部署于可穿戴设备、瞭望塔、检查站中。包括美国陆军实验室在内的众多研究机构都在积极探索如何提高热红外人脸的识别精度。在Tufts Face人脸数据库上,我们利用对偶生成模型进行数据增广(如图3所示),将Rank-1精度提升了17%(DVG 54% - Baseline 37%)。

图3. 三个异质数据库上的对偶生成结果(生成现实世界中不存在的配对人脸图像)

3. 素描-照片(Sketch-Photo)

素描和照片识别广泛应用于刑事侦查,可以依据目击证人的描述绘制出嫌疑人的素描图,并用之协助锁定罪犯。考虑到采集素描图像费时费力,我们利用在CUFSF数据库上预训练的对偶生成模型产生大量的虚拟图片。在使用如图3所示的虚拟图片后,将VR@FAR=1%提升了16.82%(DVG 97.86% - Baseline 81.04%)。

4. 侧脸-正脸(Profile-Frontal Photo)

现实场景中往往存在很多极端侧脸图像,由于这些图像已经丢失了大量有效信息,给识别系统带来了巨大的挑战。对偶生成模型通过生成大规模的配对侧脸-正脸照片,减小类内差异,提升识别系统的类内鲁棒性。在MultiPIE数据库上的可视化结果如图3的所示。利用生成的虚拟数据,我们将正负90度人脸下的Rank-1精度提升了18.5%(DVG 83.9% - Baseline 65.4%)。

5. 身份证-相机照片(ID-Camera)

在安检身份认证系统中,利用证件照片确认旅客身份是一种必要的手段。但由于证件上的照片分辨率较低,与现场相机采集的高分辨率照片之间存在较大差异。在NJU-ID 数据库上,使用生成的虚拟数据,我们将VR@FAR=1%提升了6.2%(DVG 96.7% - Baseline 90.5%)。

以上实验表明,对偶生成模型可以广泛应用于各类异质人脸识别任务。我们将在今后的工作中继续探索更多的应用方向。

【重要通知】关于开展2019年度中国自动化学会会士候选人提名工作的通知

【重要通知】关于2019年度CAA科学技术奖励推荐工作的通知

【重要通知】关于开展2019年度中国自动化与人工智能创新团队奖推荐工作的通知

【CAA】中国自动化学会选举产生第十一届理事会领导机构(内附名单)

热烈祝贺中国自动化学会常务理事、火箭军工程大学教授胡昌华荣获中共中央军委通令记功

地址:北京市海淀区中关村东路95号

邮编:100190

电话:010-82544542(综合)

010-62522472(会员)

010-62522248(学术活动)

010-62624980(财务)

传真:010-62522248

邮箱:caa@ia.ac.cn

官方微信公众号(英文)

名称:CAA OFFICIAL

微信号:caaofficial

会员微信公众号

名称:CAA会员服务

微信号:caa-member