南大周志华团队开源深度森林软件包DF21:训练效率高、超参数少,普通设备就能跑

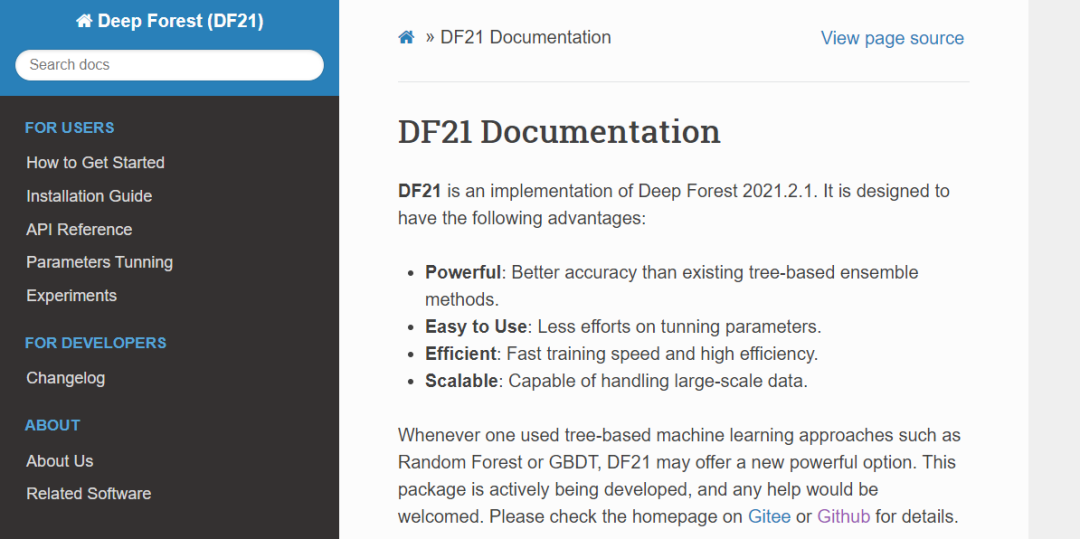

深度森林,是探索神经网络以外 AI 领域重要的研究方向之一,在表格数据建模任务中已初现锋芒。但是,由于基于决策树的集成模型在具体实现当中,经常会遇到内存不足,硬件效率不如神经网络等问题,是推动其大规模应用的主要瓶颈之一。

2021年2月1日,南大教授周志华微博宣布,他们团队新的深度森林软件包DF21在 GitHub与开源中国同时开源了。该软件包尝试解决了这一方向在上述实际应用过程中所遇到的关键问题,未来在各类在数据建模过程中,大家啊也可以便捷地使用深度森林了。据介绍,该项目目前主要由南大徐轶轩进行开发和维护,在正式发布之前它已经在南大机器学习与数据挖掘研究所(LAMDA)内部经过测试和使用。

项目地址:http://www.lamda.nju.edu.cn/deep-forest/

Gitee 地址:https://gitee.com/lamda-nju/deep-forest

Github 地址:https://github.com/LAMDA-NJU/Deep-Forest

深度森林参与者之一冯霁博士提到,深度森林在表格数据建模上,相对传统算法效果显著,但是之前开源的代码主要用于算法验证,以及辅助其他科研工作者进行深度森林算法相关的研究,代码本身对内存和服务器性能要求较高。徐同学开源的这一版更为简单易用,做了很好的封装,同时进行了高性能优化,大幅降低了内存依赖,对于科研和实际落地应用都是很好的工具。

徐轶轩提到,这个模型的全名是:DF21: A Practical Deep Forest for Tabular Datasets,内存消耗是DF21主要解决的问题。此前的gcForest在处理百万级别的表格型数据集上,占用的内存可能会达到上百 GB。但在新版本中,在千万级别的表格型数据集上进行训练,占用的内存约为原来的十分之一左右。

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“DF21” 可以获取《南大周志华团队开源深度森林软件包DF21:训练效率高、超参数少,普通设备就能跑》专知下载链接索引