【干货】人人都能看懂的GRU

目 录

1 什么是GRU

2 GRU浅析

2.1 GRU的输入输出结构

2.2 GRU的内部结构

3 LSTM与GRU的关系

4 总结

阅读时间

5min - 8min

GRU(Gate Recurrent Unit)是循环神经网络(Recurrent Neural Network, RNN)的一种。和LSTM(Long-Short Term Memory)一样,也是为了解决长期记忆和反向传播中的梯度等问题而提出来的。

GRU和LSTM在很多情况下实际表现上相差无几,那么为什么我们要使用新人GRU(2014年提出)而不是相对经受了更多考验的LSTM(1997提出)呢。

下图1-1引用论文中的一段话来说明GRU的优势所在。

图1-1 R-NET: MACHINE READING COMPREHENSION WITH SELF-MATCHING NETWORKS(2017)

简单译文:我们在我们的实验中选择GRU是因为它的实验效果与LSTM相似,但是更易于计算。

简单来说就是贫穷限制了我们的计算能力...

相比LSTM,使用GRU能够达到相当的效果,并且相比之下更容易进行训练,能够很大程度上提高训练效率,因此很多时候会更倾向于使用GRU。

OK,那么为什么说GRU更容易进行训练呢,下面开始介绍一下GRU的内部结构。

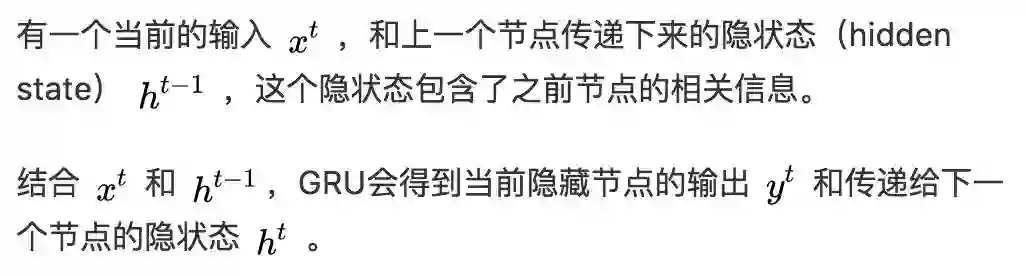

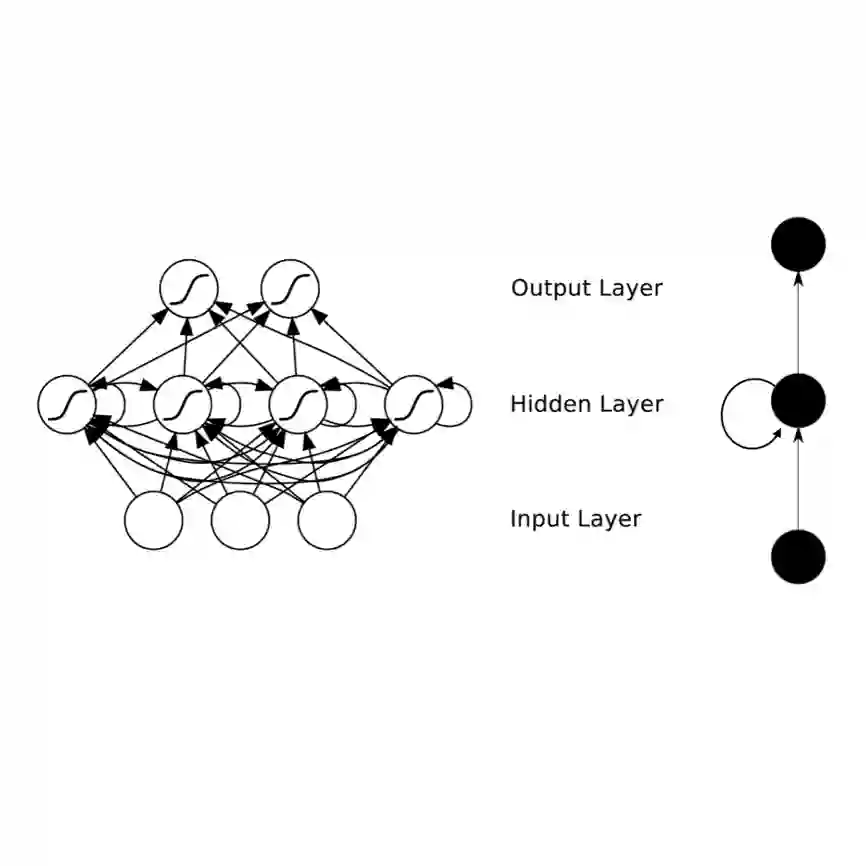

GRU的输入输出结构与普通的RNN是一样的。

图2-1 GRU的输入输出结构

那么,GRU到底有什么特别之处呢?下面来对它的内部结构进行分析!

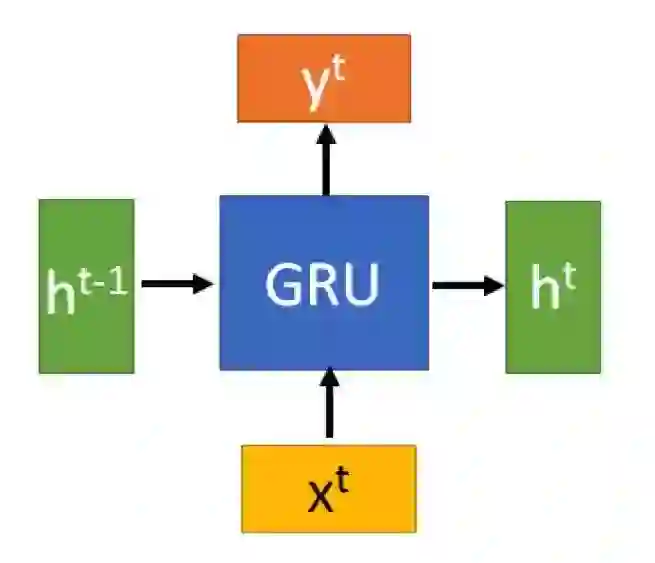

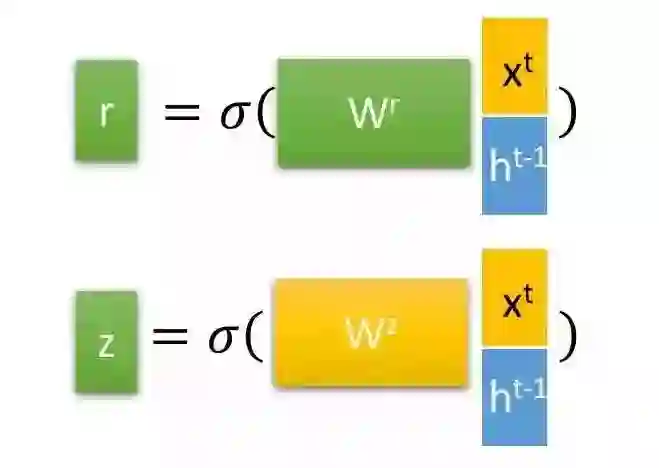

图2-2 r,z门控

与LSTM分明的层次结构不同,下面将对GRU进行一气呵成的介绍~~~ 请大家屏住呼吸,不要眨眼。

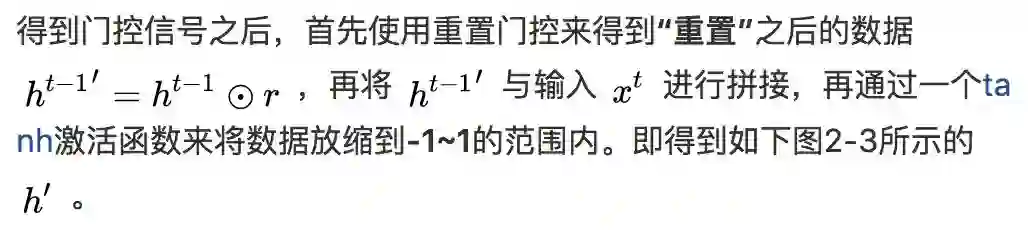

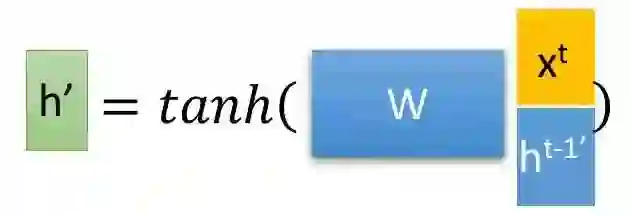

图2-3 包含当前输入数据的h'

这里的h' 主要是包含了当前输入的xt 数据。有针对性地对 h' 添加到当前的隐藏状态,相当于“记忆了当前时刻的状态”,类似于LSTM的选择记忆阶段。

转自:机器学习算法与自然语言处理

完整内容请点击“阅读原文”