何恺明团队新作!深度学习网络架构新视角:通过相关图表达理解神经网络

新智元推荐

新智元推荐

作者:Happy

编辑:舒婷

【新智元导读】恺明大神出品,必属精品。Facebook的研究员从一个新奇的角度对神经网络的表示与设计进行探索,提出了一种新颖的相关图表示方式。它有助于对现有网络架构进行更深层次的分析与性能评价。这种相关图的表示方式、实验发现等确实挺有意思,也与现有网络结构设计有一定相通之处,故推荐各位同学。

论文摘要

relational graph

(相关图)的图表示方式,神经网络的层沿图像结构进行多次信息交互。基于这种图表示方式,作者发现:

-

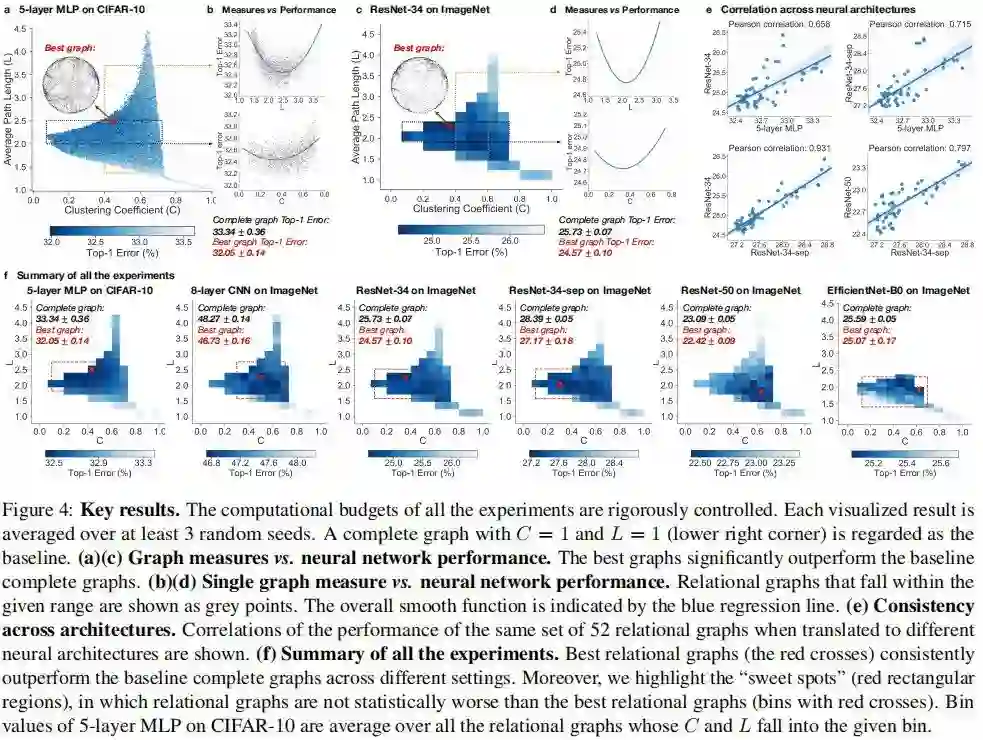

相关图的靶点(sweet spot)可以促使神经网络的性能极大提升; -

神经网络的性能与聚类系数、平均路径长度成平滑函数关系; -

该发现具有跨数据集、跨任务一致性; -

优秀的神经网络结构与真实生物神经网络具有惊人的相似性。 -

该文为神经网络架构设计与理解提供了一种新方向。

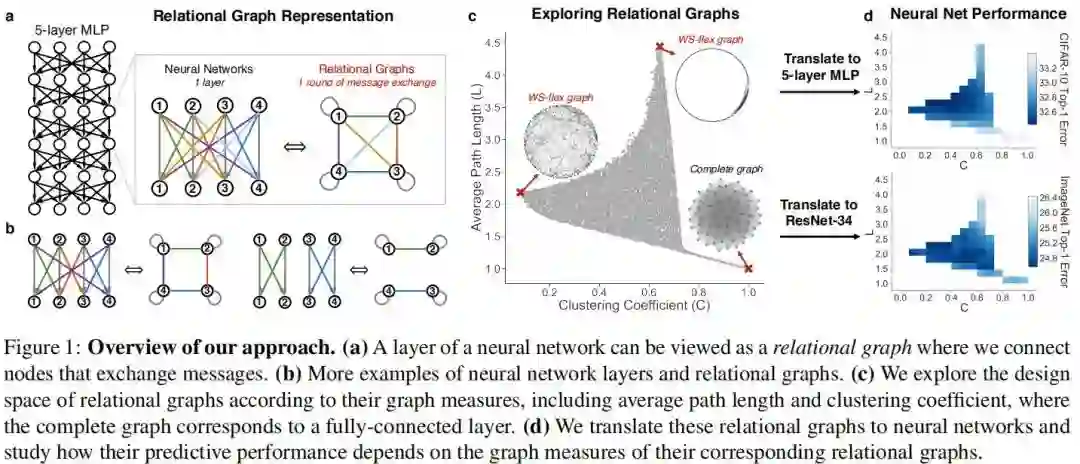

将神经网络映射为图

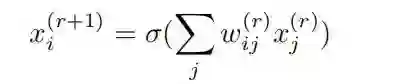

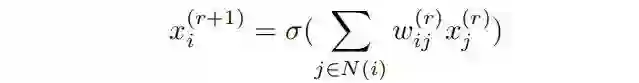

神经网络可以通过计算图方式进行表示,神经元可以表示为节点,不同层神经网络之间的连接可以通过有向边表示。这种图表示方式说明了神经网络如何进行信息传递。

相关图的靶点(sweet spot)可以促使神经网络的性能极大提升;

神经网络的性能与聚类系数、平均路径长度成平滑函数关系;

该发现具有跨数据集、跨任务一致性;

相关图的靶点可以进行高效辨别,仅需要少量的相关图与少量训练;

优秀的神经网络结构与真实生物神经网络具有惊人的相似性。

相关图

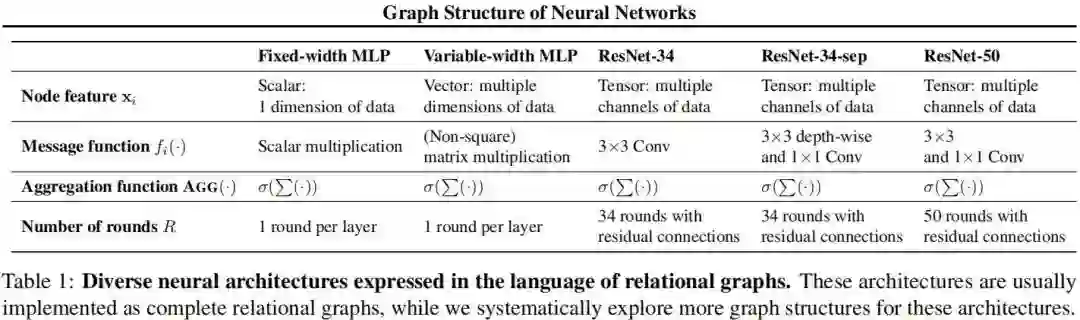

更好的探索神经网络的图结构,我们首先介绍一下相关图的概念,并说明相关图如何灵活表示不同的神经网络架构。

Message Exchange over Graph

Fixed-width MLPs as Relational Graph

complete relational graph

),它的每个节点

与其他所有节点

相关联。定长全连接MLP具有特殊的信息交互定义,

General Neural Networks as Relational Graph

-

Variable-width MLP. 变长MLP是一种更通用的形式,无论在MLP中还是在CNN中,特征维度通常是变长的。作者提出通过Concat方式将特征扩展为特征向量,同时将信息函数扩展为矩阵形式,此时的变换过程描述为:

-

CNN as relational graph. 我们进一步将相关图应用到CNN,它的输入为张量 ,信息函数同样进行类似扩展,此时的变换过程可以描述为:

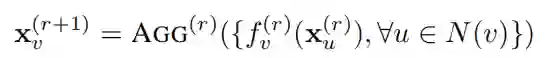

前述Table1给出了更详细的节点特征、信息函数以及汇聚函数在不同网络中的表现形式。

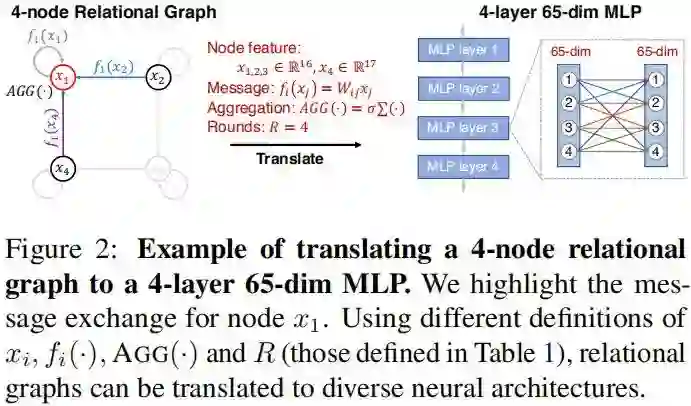

探索相关图空间

在该部分内容中,我们将描述如何设计与探索相关图空间以更好的研究神经网络结构与其性能之间的关联性。需要从三个维度进行考虑:

-

Graph Measures; -

Graph Generators; -

Control Computational Budget

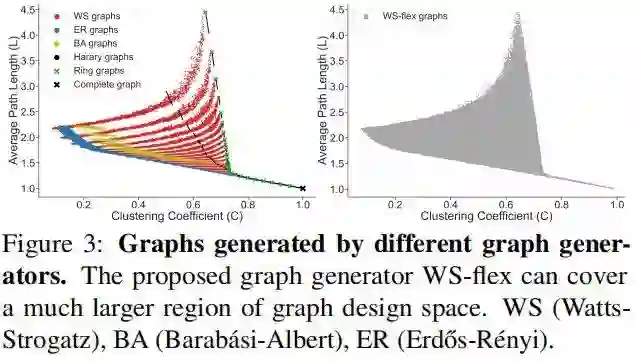

Selection of Graph Measure

GraphMeasures

将用于对图属性进行描述。该文主要聚焦于一个全局图度量(average path length)与一个局部图度量(clustering coefficient)。注:这两个度量方式已被广泛应用与神经科学领域。更详细定义如下:

-

Average path length measure the average shortest path distance between any pairs of nodes; -

clustering coefficient measure the proportion of edges between the nodes within a given node's neighborhood, divided by the number of edges that could possibly exist between them, averaged over all the nodes.

Design of Graph Generators

Controlling Computational Budget

为更好的对不同图表示的神经网络进行比较,我们需要确保所有的网络具有相同的复杂度,从而确保了其性能差异仅源自结构的差异。作者提出采用FLOPS作为度量准则,首先计算baseline网络的FLOPS,然后将其作为参考调节不同的网络以匹配该复杂度(容差0.5%)。

实验设置

在CIFAR10实验过程中,作者采用具有5层512隐层神经元的MLP作为baseline,输入为3072维,每个MLP层具有ReLU激活与BatchNorm。Batch=128,合计训练200epoch,初始学习率为0.1,学习率衰减机制为cosine。采用不同种子点训练5次取平均。

-

将上图a中的3942图下采样为52个粗粒度的区域,每个区域记录了对应区域图的性能; -

记录具有最佳平均性能的粗粒度区域; -

与此同时记录下与最佳平均性能相关的其他区域; -

覆盖上述区域的最小面积框即为靶点。CIFAR10数据集上的对于5层MLP而言,它的靶点区域为 。

全文到此结束,更多实验结果建议去查看原文。作者在文中进行了大量的消融实验、关联性讨论、实现探讨以及神经网络与GNN的关联性。为避免误导各位同学,这里就不对实验部分进行过多介绍,前面主要针对核心实验结果进行了说明。更多的实验分析建议各位同学去查看原文,以更好的理解作者想要表达的意思,上文仅为笔者的一点点记录,难免有理解错误之处,还望担待。该文提出了一种新的视角:采用相关图表达分析理解神经网络。

结论

该文为传统计算架构到图架构研究提供了一种信息过渡。与此同时,其他科学领域的的优秀图结构与方法可以为深度神经网络的理解与设计提供帮助,该文所提方法有助于深度学习网络架构的理解与设计,为未来高效而轻量的网络设计提供了一种引导。