「AI世界」还缺点啥?牛津大学教授:现实世界

![]()

新智元报道

新智元报道

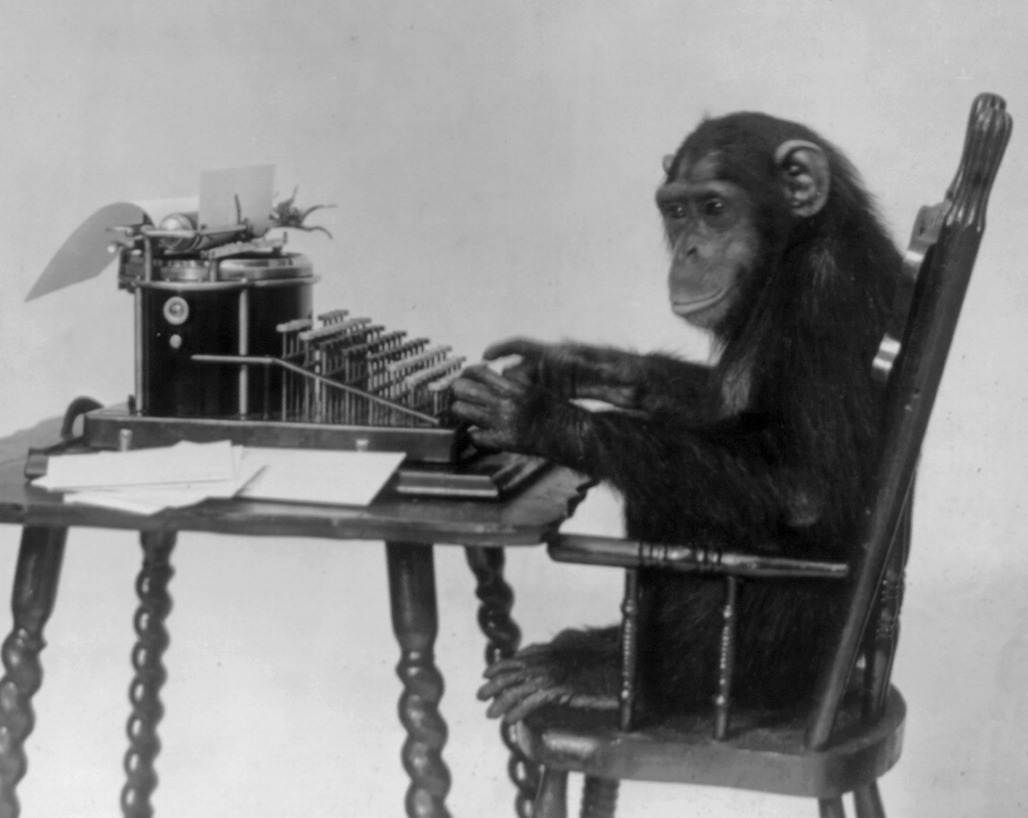

【新智元导读】无限猴子定理认为,让一只猴子在打字机上随机地按键,当按键时间达到无穷时,几乎必然能够打出任何给定的文字,比如莎士比亚的全套著作。

然而,Wooldridge 也强调,缺乏现实物理世界知识并不能说明 AI 模型无用,也不会阻止某一 AI 模型成为某一领域的经验专家,但在诸如理解等问题上,如果认为 AI 模型具备与人类相同能力的可能性,确实令人怀疑。

相关研究论文以「What Is Missing from Contemporary AI? The World」为题,已发表在《智能计算》(Intelligent Computing)杂志上。

在当前的 AI 创新浪潮中,数据和算力已经成为 AI 系统成功的基础:AI 模型的能力直接与其规模、用于训练它们的资源以及训练数据的规模成正比。

对于这一现象,DeepMind 研究科学家 Richard S. Sutton 此前就曾表示,AI 的「惨痛教训」是,它的进步主要是使用越来越大的数据集和越来越多的计算资源。

在 Wooldridge 看来,大多数 ML 模型都是在电子游戏等虚拟世界中构建的,它们可以在海量数据集上进行训练,一旦涉及到物理世界的应用,它们就会丢失重要信息,它们只是脱离实体的 AI 系统。

以支持自动驾驶汽车的人工智能为例。让自动驾驶汽车在道路上自行学习是不太现实的,出于这个和其他原因,研究人员们往往选择在虚拟世界中构建他们的模型。

「但它们根本没有能力在所有最重要的环境(即我们的世界)中运行,」Wooldridge 说道。

「这些基础模型展示了自然语言生成方面前所未有的能力,可以生成比较自然的文本片段,似乎也获得了一些常识性推理能力,这是过去 60 年中 AI 研究的重大事件之一。」

这些 AI 模型需要海量参数的输入,并通过训练来理解它们。例如,GPT-3 使用互联网上千亿级的英语文本进行训练。大量的训练数据与强大的计算能力相结合,使得这些 AI 模型表现得类似于人类的大脑,可以越过狭窄的任务,开始识别模式,并建立起与主要任务似乎无关的联系。

「符号人工智能(symbolic AI)是基于‘智能主要是知识问题’的假设,而基础模型是基于‘智能主要是数据问题’的假设,在大模型中输入足够的训练数据,就被认为有希望提高模型的能力。」

Wooldridge 认为,为了产生更智能的 AI,这种「可能即正确」(might is right)的方法将 AI 模型的规模不断扩大,但忽略了真正推进 AI 所需的现实物理世界知识。

「公平地说,有一些迹象表明这种情况正在改变,」 Wooldridge说。今年 5 月,DeepMind 宣布了基于大型语言集和机器人数据的基础模型 Gato,该模型可以在简单的物理环境中运行。

「很高兴看到基础模型迈出了进入物理世界的第一步,但只是一小步:要让 AI 在我们的世界中工作,需要克服的挑战至少和让 AI 在模拟环境中工作所面临的挑战一样大,甚至可能更大。」

在论文的最后,Wooldridge 这样写道:「我们并不是在寻找 AI 道路的尽头,但我们可能已经走到了道路起点的尽头。」

对此,你怎么看?欢迎在评论区留言。

https://spj.sciencemag.org/journals/icomputing/2022/9847630/

https://www.eurekalert.org/news-releases/966063

登录查看更多