百篇论文分类整理看数据增广最新研究进展

当前数据增广技术正不断应用于各个场景中,我们梳理近年来各大顶会上的百余篇数据增广论文并详细进行分类整理介绍,希望帮助大家更好地认识该方向的最新研究进展。文章也同步发布在 AI Box 知乎专栏(知乎搜索 AI Box 专栏),欢迎大家在知乎专栏的文章下方评论留言,交流探讨!

01

文本表示&句子建模

Good-Enough Compositional Data Augmentation. [ACL 2020]

提出一种基于规则组合的数据增广的方法用于文本序列建模中

Data manipulation: Towards effective instance learning for neural dialogue generation via learning to augment and reweight. [ACL 2020]

设计词级别和句子级别增广,考虑instance weighting降低不置信的数据,用于对话生成

MixText: Linguistically-informed interpolation of hidden space for semi-supervised text classification. [ACL 2020]

将文本插入到表示空间中,构建了大量的增强训练样本。同时数据增强的方法为无标签数据估计低熵标签。通过混合标签数据、无标签数据和增强数据

Sequence-level mixed sample data augmentation. [EMNLP 2020]

通过软合成的方式对输入/输出序列来创建新的合成样例

Nonlinear mixup: Out-of manifold data augmentation for text classification. [AAAI 2020]

利用非线性混合插值对文本分类进行数据增强

It’s all in the name: Mitigating gender bias with name-based counterfactual data substitution. [EMNLP 2019]

提出解决词嵌入中潜在的性别偏见,采用反事实数据替换对可能有偏见的文本被随机替换以避免重复

Adversarial example generation with syntactically controlled paraphrase networks. [ACL 2018]

具有句法控制的释义网络的对抗性样本生成

Certified robustness to adversarial word substitutions. [EMNLP 2019]

对抗性词替换的鲁棒性验证

Parallel data augmentation for formality style transfer. [ACL 2020]

针对 formal 风格迁移任务提出了三种数据增强方法,来获得更多有用的句子对

Contextual augmentation: Data augmentation by words with paradigmatic relations. [ACL 2018]

针对上下文的增强:通过具有范式关系的单词进行数据增强

Submodular optimization-based diverse paraphrasing and its effectiveness in data augmentation. [NAACL 2019]

基于子模块优化的多样化释义及其在数据增强中的有效性验证

Data boost: Text data augmentation through reinforcement learning guided conditional generation. [EMNLP 2020]

通过强化学习引导条件生成来增强文本数据

Improving robustness by augmenting training sentences with predicate-argument structures. [arXiv]

通过使用谓词-参数结构增加训练句子来提高鲁棒性

Textual data augmentation for efficient active learning on tiny datasets. [EMNLP 2020]

文本数据增强用于小数据集上有效的主动学习

EDA: Easy data augmentation techniques for boosting performance on text classification task. [EMNLP 2019]

基于启发式编辑策略数据增广应用于文本分类任务

Data augmentation via dependency tree morphing for lowresource languages. [ACL 2018]

通过依赖树变换对低资源语言进行数据增广

Substructure Substitution: Structured Data Augmentation for NLP. [ACL 2021]

基于NLP的结构化数据增强

Xlda: Cross-lingual data augmentation for natural language inference and question answering. [arXiv]

提出用于自然语言推理和问答的跨语言数据增强方法

Augmented sbert: Data augmentation method for improving bi-encoders for pairwise sentence scoring tasks. [NAACL 2021]

本文提出了一种简单而有效的数据增强策略针对句子评分任务,称为增强SBERT,其中使用Cross-encoders来标记一组数据更多的输入对,以增强Bi-encoders的训练数据

Counterfactual Data Augmentation for Mitigating Gender Stereotypes in Languages with Rich Morphology. [ACL 2019]

缓解具有丰富修饰的语言中的性别刻板印象的反事实数据增强

02

机器翻译

Lexical-constraint-aware neural machine translation via data augmentation. [IJCAI 2020]

用于词法约束感知机器翻译的数据增广方法,以构建约束感知的合成训练数据

AdvAug: Robust adversarial augmentation for neural machine translation. [ACL 2020]

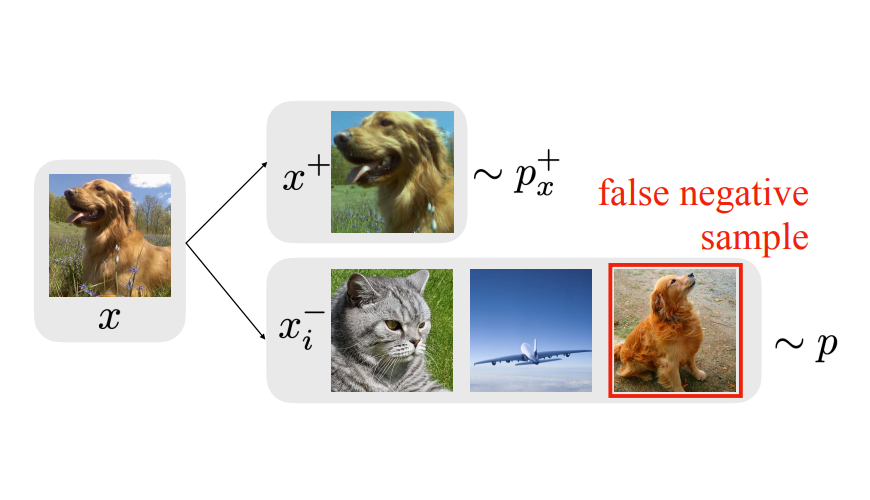

针对神经机器翻译提出一种对抗增强方法。借鉴图像中对抗数据增广技术,从邻近分布中采样对抗样本并利用它们的表示进行增广,绕过生成实际的文本对抗样本

Soft contextual data augmentation for neural machine translation. [ACL 2019]

针对机器翻译,采用基于上下文的软增广

Generalizing back-translation in neural machine translation. [ACL 2019]

在 NMT 模型的交叉熵优化范围内重新设计反向翻译,阐明了其潜在的数学假设和超出其启发式用法的近似值。涵盖了更广泛的合成数据生成方案,包括从目标到源 NMT 模型的采样

Sentence boundary augmentation for neural machine translation robustness. [arXiv]

用于神经机器翻译鲁棒性的句子边界增广

A diverse data augmentation strategy for low-resource neural machine translation. [arXiv]

用于低资源神经机器翻译的多样化数据增强策略

Data diversification: A simple strategy for neural machine translation. [NeurIPS 2020]

数据多样化:神经机器翻译的简单策略

Dictionary-based data augmentation for cross-domain neural machine translation. [arXiv]

基于字典的跨域神经机器翻译数据增强

Generalized Data Augmentation for Low-Resource Translation. [ACL 2019]

用于低资源翻译的通用数据增广

SwitchOut: an Efficient Data Augmentation Algorithm for Neural Machine Translation. [EMNLP 2018]

研究基于文本的任务(例如神经机器翻译)的数据增强方法。我们将具有所需属性的数据增强策略的设计制定为优化问题,并推导出通用分析解决方案

03

自动数据增广

Faster autoaugment: Learning augmentation strategies using backpropagation. [ECCV 2020]

使用反向传播学习增广策略

DADA: differentiable automatic data augmentation. [arXiv]

基于可微的数据增广

Fast autoaugment. [NeruIPS 2019]

提出了Fast AutoAugment 的算法,该算法通过基于密度匹配的更有效的搜索策略来找到有效的增强策略

Text AutoAugment: Learning Compositional Augmentation Policy for Text Classification. [EMNLP 2021]

基于文本分类的组合增广策略学习

Autoaugment: Learning augmentation policies from data. [CVPR 2018]

Randaugment: Practical automated data augmentation with a reduced search space. [CVPR 2020]

Population based augmentation: Efficient learning of augmentation policy schedules. [ICML 2019]

基于种群的自动数据增广

Rotom: A meta-learned data augmentation framework for entity matching, data cleaning, text classification, and beyond. [SIGMOD 2021]

用于实体匹配、数据清理、文本分类等的元学习数据增强框架

基于数据驱动的增广策略学习

基于搜索空间约束的自动数据增广

04

推荐系统

Contrastive Pre-training for Sequential Recommendation. [arXiv]

设计序列推荐下的对比学习,借鉴NLP中的启发式的增广策略对序列数据进行增广

Contrastive Learning for Representation Degeneration Problem in Sequential Recommendation. [WSDM 2022]

提出基于dropout的序列推荐数据增广以缓解表征退化问题

Contrastive Self-supervised Sequential Recommendation with Robust Augmentation. [arXiv]

具有鲁棒增强的对比自监督序列推荐

Memory Augmented Multi-Instance Contrastive Predictive Coding for Sequential Recommendation. [ICDM 2021]

用于序列推荐的记忆增强的多实例对比预测编码

Counterfactual Data-Augmented Sequential Recommendation. [SIGIR 2021]

基于反事实的序列推荐数据增广

CauseRec: Counterfactual User Sequence Synthesis for Sequential Recommendation. [SIGIR 2021]

基于反事实的用户序列合成

Contrastive Curriculum Learning for Sequential User Behavior Modeling via Data Augmentation. [CIKM 2021]

基于数据增广的对比课程学习

Augmenting Sequential Recommendation with Pseudo-Prior Items via Reversely Pre-training Transformer. [SIGIR 2021]

通过逆向预训练 Transformer 用伪先验项增强序列推荐

Sequential Recommendation with Bidirectional Chronological Augmentation of Transformer. [AAAI 2022]

基于双向时序增强的Transformer序列推荐

05

视觉&多模态

-

On adversarial mixup resynthesis. [NeurIPS 2019] 利用GAN和MixUp的技术来对两个图像进行混合,生成新的图像 -

Data augmentation by pairing samples for images classification. [arXiv] 图像分类中的数据增强,从训练集随机抽取的两幅图像叠加合成一个新的样本(像素取平均值),使用第一幅图像的标签作为合成图像的实际标注 -

Data augmentation techniques for the video question answering task. [arXiv] 采用多种基于图像的数据增广策略解决VQA任务 -

On Interaction Between Augmentations and Corruptions in Natural Corruption Robustness. [NeurIPS 2021] 针对数据增广用于图像变换的特征空间,在这个空间中使用一种新的度量在增强和损坏之间,以证明相似性和性能之间的强相关性 -

Counterexample-guided data augmentation. [IJCAI 2018] 提出了一个基于反例指导的数据增广框架. -

Learning data manipulation for augmentation and weighting. [NeurIPS 2019] 学习用于增强和加权的数据操作 -

Multimodal continuous emotion recognition with data augmentation using recurrent neural networks. [AVEC 2018] 使用循环神经网络进行数据增强的多模态情感识别 -

Data augmentation for visual question answering. [ACL 2017] 使用视觉问答(VQA)的两种数据增强方法。第一个使用现有的语义注释来生成新问题。第二种方法是使用循环神经网络。 -

Multi-Modal Data Augmentation for End-to-end ASR. [INTERSPEECH 2018] 提出了一种用于自动语音识别 (ASR) 的新端到端架构,除了传统的声学输入之外,它还可以使用符号输入进行训练。该架构使用两个独立的编码器:一个用于声学输入,另一个用于符号输入,两者共享注意力和解码器参数 -

Semantic equivalent adversarial data augmentation for visual question answering. [ECCV 2020] 用于视觉问答的语义等价对抗的数据增广 -

Cutmix: Regularization strategy to train strong classifiers with localizable features. [IEEE/CVE 2019] 将Mixup和Cutout结合起来,切割一块patch并且粘贴上另外一张训练图片相同地方的patch,对应的label也按照patch大小的比例进行混合 -

mixup: Beyond empirical risk minimization. [ICLR 2017] 提出一种新的数据扩展方式,即使用线性插值的方法得到新的扩展数据 -

SimCSE: Simple Contrastive Learning of Sentence Embeddings. [ACL 2021] 通过dropout当作数据增广利用自监督学习提升句子表征能力 -

Learning to compose domain-specific transformations for data augmentation. [NeruIPS 2017] 提出了一种不需要特定领域知识的数据扩增的方法,能够生成大量标记样本,并且不损失类别信息

06

命名实体识别

-

DAGA: Data augmentation with a generation approach forLow-resource tagging tasks. [EMNLP 2020] 提出适配于NER的数据增广,通过将原始的序列标注标签与句子token进行混合 -

An analysis of simple data augmentation for named entity recognition. [COLING 2020] 本文借鉴sentence-level的传统数据增强方法,探究了不同的数据增强方法对NER任务的影响,发现:在低资源条件下,数据增强效果增益比较明显,而在充分数据条件下,数据增强可能会带来噪声,导致指标下降 -

Named entity recognition for social media texts with semantic augmentation. [EMNLP 2020] 基于语义增强的社交文本命名实体识别 -

SeqMix: Augmenting Active Sequence Labeling via Sequence Mixup. [EMNLP 2020] 通过序列混合增强主动序列标注

07

基于预训练的数据增广

-

Do Not Have Enough Data? Deep Learning to the Rescue. [AAAI 2020] 利用GPT这些因果语言模型来生成训练数据来做数据增强。使用训练好的模型来确定有标签训练数据集合 -

ELECTRA: Pretraining text encoders as discriminators rather than generators. [ICLR 2020] 提出一种更具样本效率的预训练任务——替换token检测(RTD)。RTD不对输入进行遮蔽,而是从生成网络中采样得到可信的tokens,再替换掉原始输入上的tokens -

How effective is task-agnostic data augmentation for pretrained transformers? [arXiv] 研究对预训练Transformer模型,任务无关的数据增广的效果 -

G-daug: Generative data augmentation for commonsense reasoning. [EMNLP 2020] 使用预训练的语言模型生成合成样本,并选择信息量最大和多样化的样本进行数据增强 -

Data augmentation using pre-trained transformer models. [ACL 2020] 使用预训练Transformer模型进行数据增广

08

对话&问答&文本生成

-

Logic-Guided Data Augmentation and Regularization for Consistent Question Answering. [ACL 2020] 提出了通过集成逻辑规则和神经网络模型来提高对比较问题的回答的准确性和一致性,同时使用基于一致性的正则化器来训练模型。通过提高全局预测的一致性,本文的方法在各种QA任务 -

GenAug: Data augmentation for finetuning text generators. [ACL 2020] 采用多类基于启发式的增广策略对文本生成任务做增广 -

Keep calm and switch on! Preserving sentiment and fluency in semantic text exchange. [EMNLP 2019] 针对聊天机器人或对话场景,在保持情感和流畅性的同时结合了实体替换、相似性屏蔽和文本填充在语义上进行文本交换的数据增广策略。 -

Paraphrase augmented task-oriented dialog generation. [ACL 2020] 提出了一个段落增强的回复生成(PARG)框架,还设计了一种基于对话状态和对话行为标签自动构建段落训练数据集的方法。 -

Sequence-to-sequence data augmentation for dialogue language understanding. [COLING 2018] 研究面向任务的对话系统中语言理解的数据增强问题 -

Simple is better! lightweight data augmentation for low resource slot filling and intent classification. [ACL 2020] 用于低资源槽填充和意图分类的轻量级数据增强 -

Effective data augmentation approaches to end-to-end task-oriented dialogue. [IALP 2019] 基于端到端的面向任务型对话的有效数据增强方法 -

Synthetic Data Augmentation for Zero-Shot CrossLingual Question Answering. [EMNLP 2021] 我们提出了一种提高跨语言问答效果的数据增广方法,无需额外的数据,利用问题生成模型以跨语言方式生成合成样本。 -

Data Augmentation for Copy-Mechanism in Dialogue State Tracking. [ACL 2020] 基于copy机制的数据增广在对话状态跟踪中的应用

09

数据增广理论性分析

-

A bayesian data augmentation approach for learning deep models. [NeurIPS 2017] 利用贝叶斯方法的视角分析数据增广策略 -

Does data augmentation lead to positive margin? [ICML 2019] 尽管数据增广被广泛使用,但其可证明提高鲁棒性的能力尚不清楚。在这项工作中,我们通过量化数据增广对经验风险最小化器施加的边际来分析 DA 产生的稳健性。 -

A kernel theory of modern data augmentation. [ICML 2019] 分析数据增广对核分类器的影响并提出了相关的理论证明。 -

Data augmentation revisited: Rethinking the distribution gap between clean and augmented data. [arXiv] 从分析的角度重新审视了增广数据和原始数据差异这个问题,为此本文提出用相关的指标估计预期风险的上限,即经验风险和泛化误差,可以将数据增广理解为正则化 -

Learning the difference that makes a difference with counterfactually-augmented data. [ICLR 2020] 学习对反事实数据增广产生影响的差异 -

Data augmentation instead of explicit regularization. [arXiv] 从理论和实验的角度分析对比数据增广与使用显式的正则化技术在模型性能和鲁棒性的差异。 -

Explaining the efficacy of counterfactually augmented data. [ICLR 2021] 解释反事实增强数据的效用 -

SSMBA: Self-supervised manifold based data augmentation for improving out-of-domain robustness. [EMNLP 2020] 基于自监督流形的数据增强用于提高域外鲁棒性 -

Data augmentation with manifold exploring geometric transformations for increased performance and robustness. [arXiv] 探索几何变换的数据增广以提高性能和鲁棒性 -

Tradeoffs in data augmentation: An empirical study. [ICLR 2020] 通过观察性的研究以量化数据增强如何提高模型的泛化能力。引入了两种可解释且易于计算的度量指标:相关性和多样性。最终结论发现增广的性能不是单独仅通过其中任何一个而是通过联合优化这两者提升的 -

What Makes for Good Views for Contrastive Learning? [NeurIPS 2020] 在本文中,我们使用理论和实证分析来更好地理解视图选择的重要性,并认为我们应该减少视图之间的互信息(MI),同时保持任务相关信息的完整性

10

新技术结合

A simple framework for contrastive learning of visual representations. [ICML 2020]

提出了视觉表征的对比学习框架。其中在数据增广部分,单一的某种数据增强并没有很大效果,通过组合表现突出。并设计临近块的特征对比,全局与局部的对比

Learning to Compose Domain-Specific Transformations for Data Augmentation. [NeurIPS 2017]

提出了一种不需要特定领域知识的数据扩增的方法,能够生成大量标记样本,并且不损失类别信息

δ-encoder: an effective sample synthesis method for few-shot object recognition. [NeurIPS 2018]

提出一种基于数据增广的小样本学习算法,利用一个自动编码器用于寻找同类别不同样本之间的变换

Negative data augmentation. [ICLR 2021]

为了实现更广泛的增强,探索了创建分布外样本的负数据增广策略。

Text augmentation in a multi-task view. [EACL 2021]

基于多任务视图的数据增强—其中主要任务在原始样本上进行训练,辅助任务在增强样本上进行训练。

Unsupervised data augmentation for consistency training. [NeurIPS 2020]

基于一致性训练的无监督数据增强

Data Augmentation for BERT Fine-Tuning in Open-Domain Question Answering. [arXiv]

提出了一种使用远程监督的数据增强技术应用在正例和负例。采用分阶段方法在多个数据集上微调 BERT

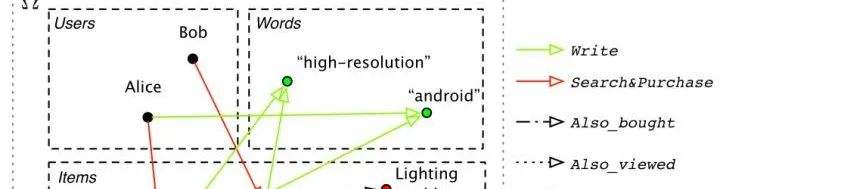

Graph Contrastive Learning with Augmentations. [NeurIPS 2020]

提出了一种图对比学习(GraphCL)框架,用于学习图数据的无监督表示。设计了结合各种先验的四种类型的图增强

Graph Contrastive Learning with Adaptive Augmentation. [WWW 2021]

提出了一种新颖的图对比表示学习方法,该方法具有自适应增强功能,该方法结合了图的拓扑和语义方面的各种先验

ConSERT: A Contrastive Framework for Self-Supervised Sentence Representation Transfer. [ACL 2020]

本文主要创新点利用数据增强如对抗攻击、打乱词序、裁剪、dropout等等。通过一个数据增强模块,作用于Embedding层,为同一个句子生成两个不同的增强版本,作为正样本,一个batch内的其他样本作为负样本应用于对比学习

更多推荐

对比学习在NLP和多模态领域的应用

Learning to Learn: 点击率预测模型与网络结构搜索相结合的研究进展

个性化商品搜索相关研究梳理