【AAAI2021 Tutorial】工业界负责任的人工智能,262页ppt

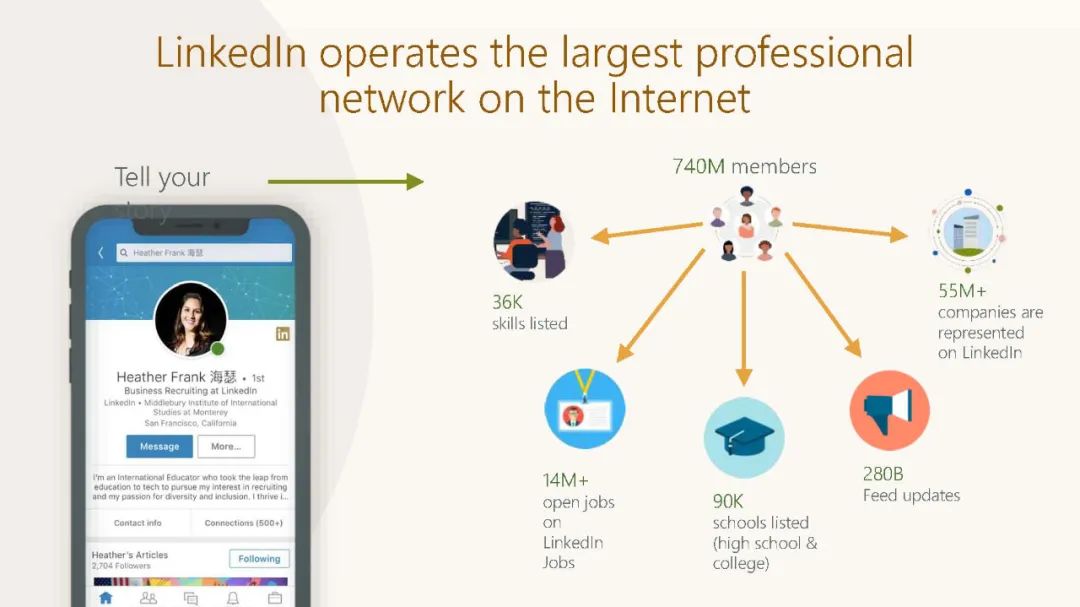

人工智能(AI)在决定我们日常体验方面扮演着越来越重要的角色。人工智能的应用越来越多地不再局限于搜索和推荐系统,如网络搜索、电影和产品推荐,但人工智能也被用于对个人、企业和社会至关重要的决策和流程。在招聘、借贷、刑事司法、医疗保健和教育等领域,基于web的人工智能解决方案对个人和专业的影响是深远的。

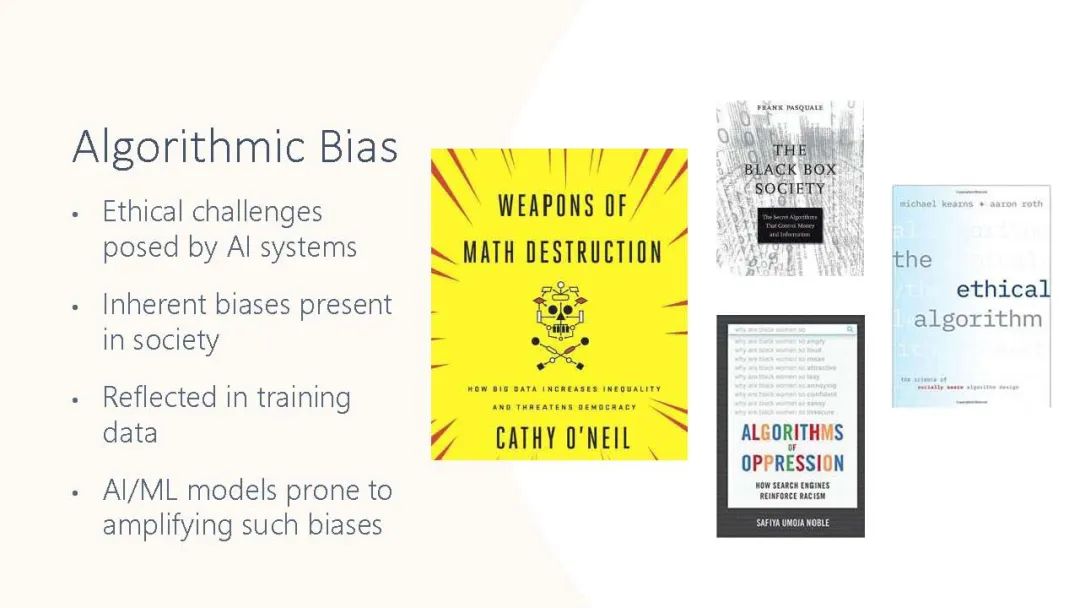

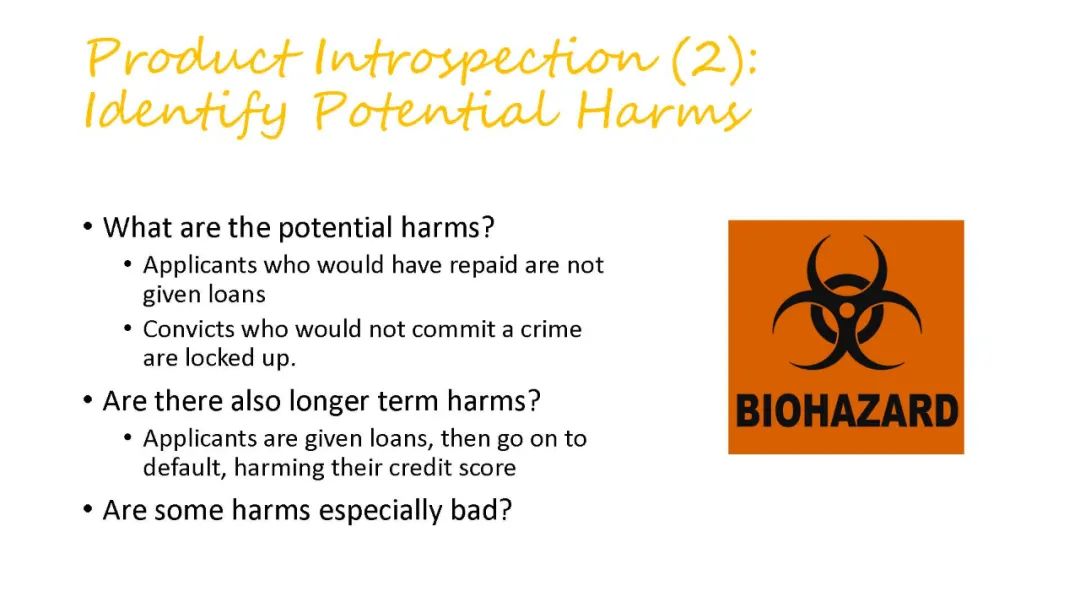

在人工智能系统的开发和部署中,有许多因素发挥着作用,它们可能会表现出不同的、有时是有害的行为。例如,训练数据往往来自社会和现实世界,因此它可能反映了社会对少数民族和弱势群体的偏见和歧视。例如,少数族裔与多数族裔在类似行为上面临更高的逮捕率,所以在没有补偿的情况下构建一个人工智能系统可能只会加剧这种偏见。

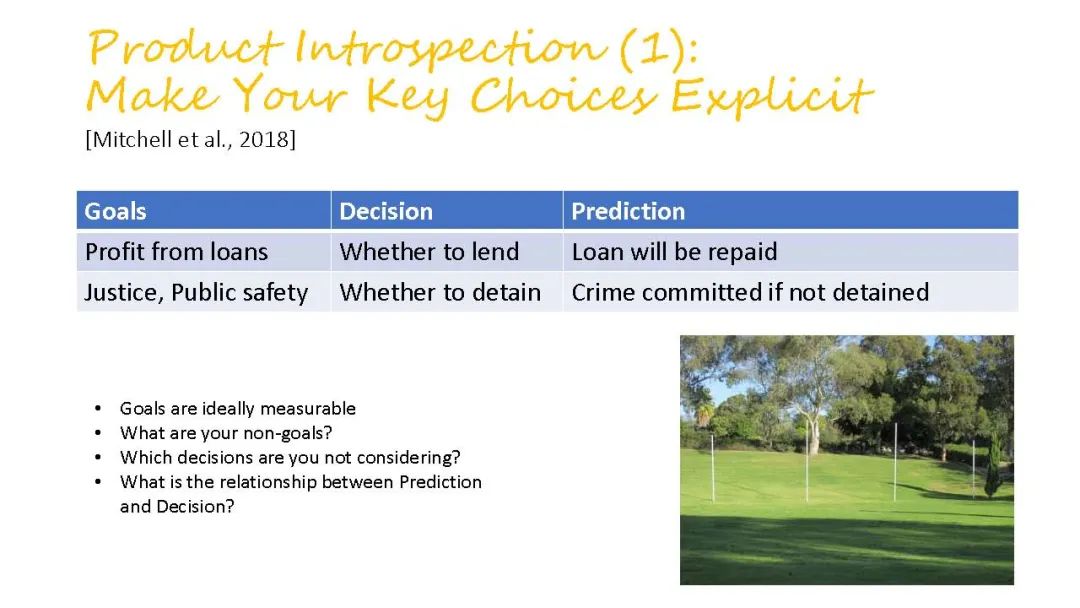

上述问题凸显出需要监管、最佳实践和实用工具,以帮助数据科学家和ML开发人员构建安全、隐私保护、透明、可解释、公平和负责的人工智能系统,以避免可能对个人、企业和社会有害的意外后果和合规挑战。

在这些原则中,模型的透明度和可解释性是在需要可靠性和安全性的高风险领域(如医疗保健和自动化运输)建立信任和采用人工智能系统的先决条件,以及具有重大经济影响的关键工业应用(如预测性维护、自然资源勘探和气候变化建模)。除了可解释性,越来越多的利益相关者质疑他们的人工智能系统的公平性,因为有很多例子可以说明不考虑公平性的后果,从人脸识别对白人男性的效果明显优于有色女性,到歧视特定群体的自动招聘系统。通过整合工具来确保模型的透明度和公平性,可以让数据科学家、工程师和模型用户更容易调试模型,并实现确保AI系统的公平性、可靠性和安全性等重要目标。

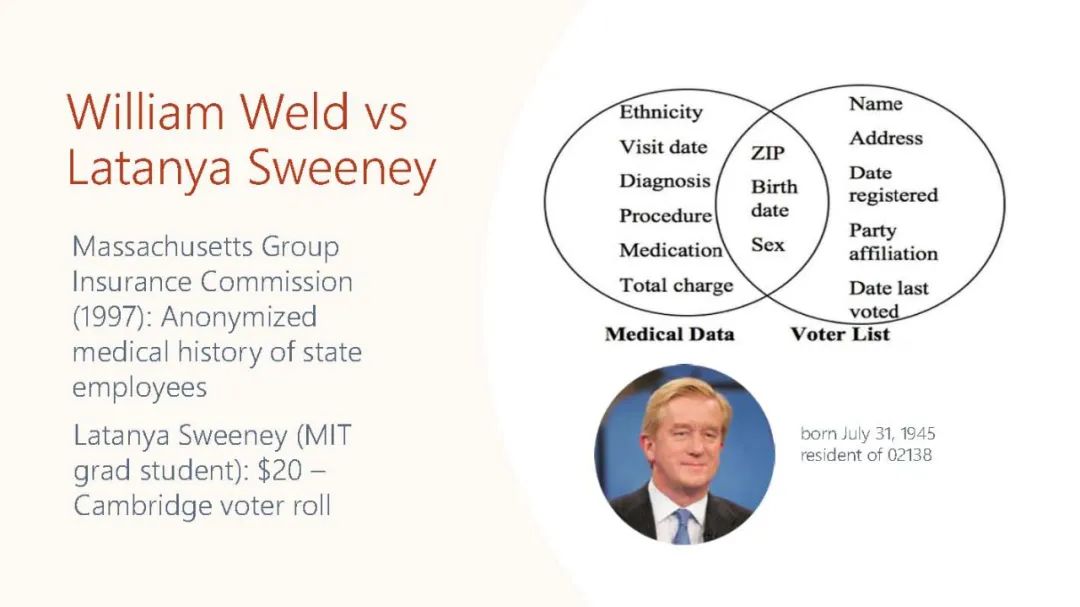

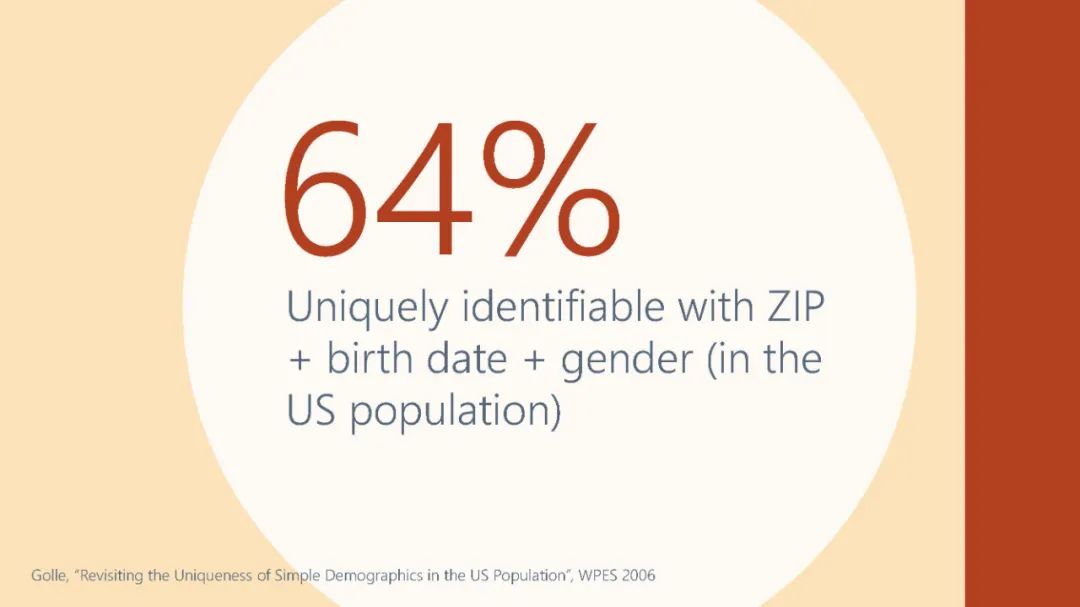

最后,人工智能产品通常由ML模型驱动,这些模型根据敏感用户数据进行训练。给定足够的复杂性——无论是从参数的数量[例如。或者用户级个性化——,该模型可以对用户的私人信息进行编码。此外,通常需要在ML生命周期的不同阶段确保用户隐私,并保护不同类型的不良行为者和威胁场景,需要隐私保护AI方法。

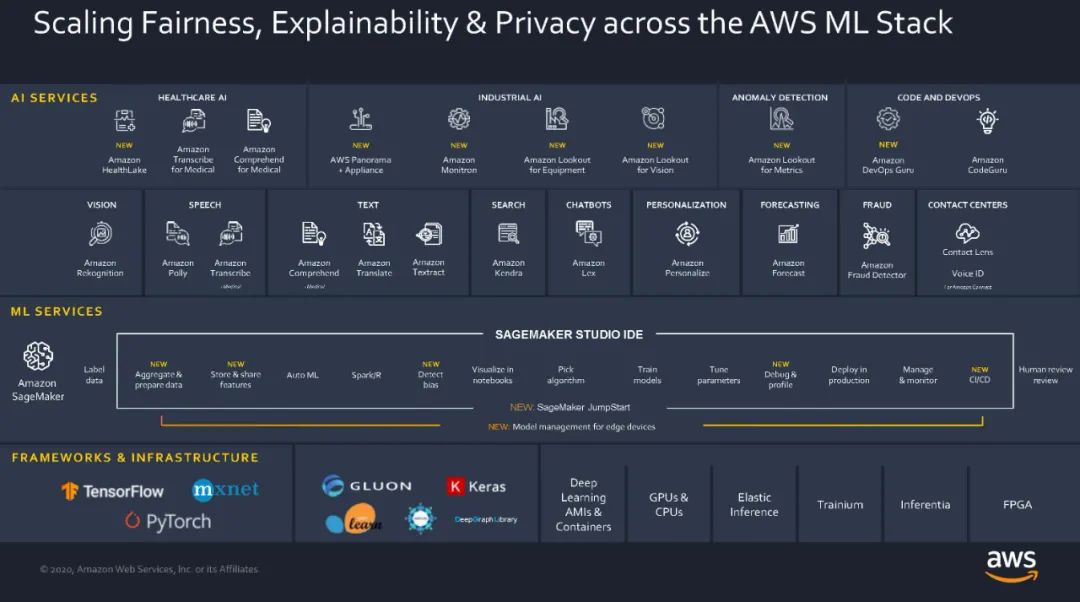

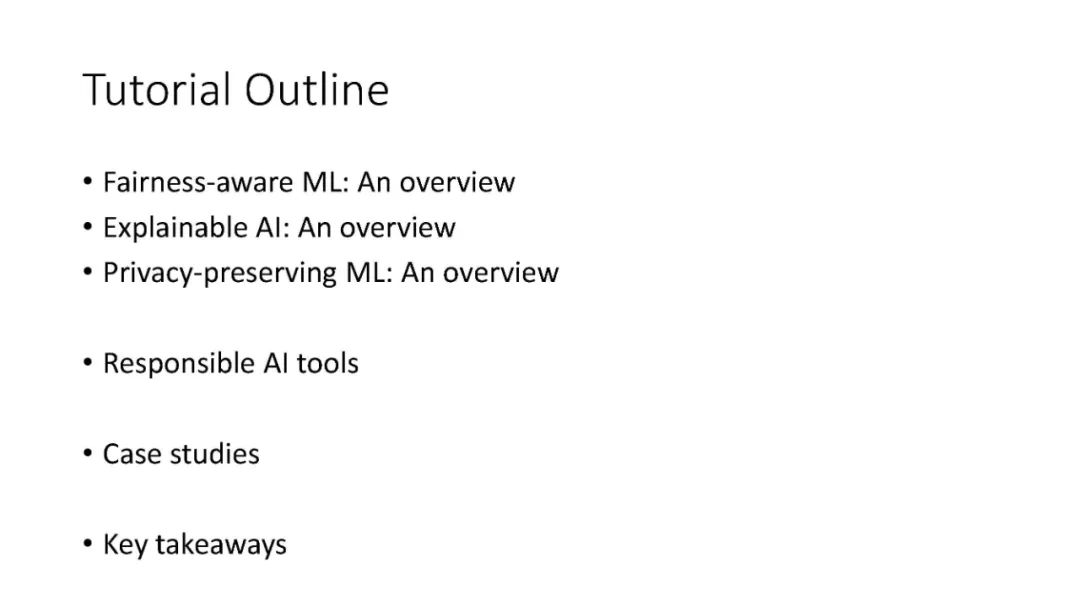

在本教程中,我们将概述负责任的人工智能,强调人工智能中模型的可解释性、公平性和隐私性,关键的法规/法律,以及提供关于基于web的人工智能/ML系统的理解的技术/工具。然后,我们将关注可解释性、公平评估/不公平缓解和隐私技术在行业中的应用,其中我们提出了有效使用这些技术的实际挑战/指导方针,以及从部署几个web规模的机器学习和数据挖掘应用模型中获得的经验教训。我们将介绍不同公司的案例研究,包括搜索和推荐系统、招聘、销售、借贷和欺诈检测等应用领域。我们将强调,与负责任的人工智能相关的主题是社会技术的,也就是说,它们是社会和技术交叉的主题。潜在的挑战不能由技术人员单独解决;我们需要与所有关键的利益相关者一起工作——比如技术的客户、受技术影响的人,以及具有道德和相关学科背景的人——并在设计这些系统时考虑他们的输入。最后,基于我们在行业中的经验,我们将为数据挖掘/机器学习社区确定开放的问题和研究方向。

https://sites.google.com/view/ResponsibleAITutorial

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“RAI” 可以获取《【AAAI2021 Tutorial】工业界负责任的人工智能,262页ppt》专知下载链接索引