关于自然语言对话的技术挑战和应用前景,来自这六大厂的一线技术负责人聊了聊

作者 | 丛末

编辑 | 唐里

对话作为人类最基本、最重要的交流方式,自然语言对话技术自然也成为了自然语言处理领域离人类最近的技术之一,这一领域乃至整个人工智能领域要想走向理想状态,势必要解决自然语言对话所面临的一系列问题和挑战。

而所有技术的问题和挑战在实践应用中是最容易体现出来的,因而对此最具有发言权的莫过于实现技术落地的企业一线技术人员。

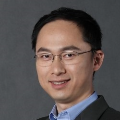

近日,华为诺亚方舟实验室语音语义首席科学家刘群就在 CNCC2019 上主办了一场主题为「自然语言对话:技术挑战和应用前景」的技术论坛,邀请了来自微软、阿里、百度、小米、京东以及华为这几家在自然语言处理领域涉猎较深的大厂一线技术负责人——周明、陈海青、孙珂、王刚、何晓冬以及蒋欣来对这一主题进行探讨,几位演讲嘉宾既从宏观的技术视角阐述了自己对于该研究领域的看法和观点,也从应用案例的角度分享了自然语言对话的技术实践。

从左至右依次为:陈海青、何晓冬、孙珂、周明、王刚、蒋欣、刘群

我们一一来看他们在本场技术论坛的分享内容。

微软周明:面向深度理解的聊天机器人

来自微软亚洲研究院的周明,首先从宏观、全局的视角分享了聊天机器人的整个技术演化进程。他指出,聊天机器人技术有从检索式回复到生成式回复再到集成式回复的三个发展阶段。

其中检索式回复利用文本匹配技术选出相似的对话以此输出对应的回复,而生成式回复则是利用文本生成技术得到相应的回复,二者相比各有优缺,前者的优势在于可读性好、语言流程,多样性强以及易于分析、可解释性强,缺点则在于强依赖于检索数据,输出的回复有时在相关性方面并不好;后者在相关性方面表现较好,易于进行端到端实现并且灵活性强、不太依赖于检索数据,然而在多样性方面较差,同时输出的回复往往比较短,没有太多信息量。

集成式回复生成则采用检索式系统提供候选原型回复、生成式系统对原型加以修改的方式,既能够继承检索模型回复的多样性,又能够继承生成模型的灵活性,对二者扬长避短。

与此同时,周明指出,虽然回复技术取得了一定进展,包括基于神经网络的 S2S 模型一定程度上改进了生成的回复流畅度,预训练模型让检索式回复技术一定程度上增强了上下文理解能力等,但目前聊天机器人依旧距离理想的状态很远,具体而言体现在:

-

第一,在多轮对话中,机器人依旧无法真正理解对话历史中的复杂句间关系; -

第二,对话风格与内容的解耦仍然不佳,即便风格符合,内容往往在改写中出错; -

第三,对话很难保持时间、空间和逻辑一致性,容易出现前后矛盾的情况; -

第四,缺乏人类先验知识; -

第五,聊天机器人「健忘」,无法记忆用户所说的内容。

对此,未来聊天机器人需要采用面向深度理解的回复机制,努力的方向包括:让聊天机器人融入常识和知识、 精准理解对话历史、强化记忆机制从而提高上下文的一致性,并且能够实现定制回复生成的风格(包括词汇量、情感、句式和正规性等),而为了实现这些目标,社区还需要建立更加精准的评测,包括数据集和评测指标等。

阿里陈海青:阿里小蜜智能人机交互技术实践

阿里巴巴集团达摩院智能服务事业部资深算法专家陈海青则从更加应用的角度,基于阿里的人机交互产品——阿里小蜜介绍了阿里 NLP 核心技术及人机交互技术实践、面临的挑战及未来的发展方向。

简单介绍阿里小蜜平台的生态圈和应用后,陈海青介绍了其背后的核心 NLP 支撑技术:

-

自然语言处理板块的分层梳理流程,主要包括分层领域的框架设计,基于不同业务场景的意图和模型设计与积累,以及通过模型沉淀框架并进行平台化积累,能够完成 QA Bot、Task Bot、Predict Bot 以及 Chit Chat 四项任务的能力。 -

围绕数据、算法、服务、应用四个层面的 NLU 架构体系,则包括数据的沉淀以及业务标注的训练平台体系构建、基于平台化算法框架的意图识别和实体识别能力搭建以及基于规则、降级模型以及深度模型的 NLU 工程能力平台搭建。

而当前 NLU 还是以意图识别和实体识别为核心能力,其面临的核心挑战是意图的平台化扩展效率和小样本场景的冷启动,就 NLU 的效率和效果而言,主要涉及的问题是如何构建数据、算法和服务。

最后,陈海青指出,未来智能服务机器人将以多模态的方式,不仅提供自动服务模式,同时提供更好的人机协同模式,为用户和客服人员提供更复杂问题的解决能力和决策支持能力,而持续探索的技术方向有生成模型、强化模型、迁移学习、机器阅读理解、情感分析等。

百度孙珂:可定制对话系统的挑战与设计

百度自然语言处理部主任研发工程师、UNIT 平台技术负责人孙珂基于百度的智能对话定制和服务平台 UNIT 分享了目前可定制对话系统的挑战与设计。

一开始,孙珂先抛出了对话技术在面对产业定制需求时所面临的一些挑战:

-

在消费互联网中,对话服务的关键任务是提供最好的产品服务从而尽可能扩大用户规模,要求工程师结合使用算法实现效果最佳化、能够定向挖掘海量资源以及部署方案具备高吞吐能力的定制对话技术; -

然而到了产业互联网,对话服务的关键任务则是在实现较好效果的前提下降低定制的边际成本,要求工程师结合应用算法的综合优化成本低廉、获取资源和词典低成本以及部署方案能够灵活适应环境的可迁移对话技术。

而将可迁移对话技术的目标进行拆解来看,设计思路便是用高学习效率的模型和自动发现模型缺陷板块来提高单位数据对提高对话效果的帮助,而使用知识辅助构建和预置知识来降低单位数据的获取成本。

整体基于这一思路设计的 UNIT,核心对话技术包括任务式对话和问答式对话,具体设计思路分别如下:

-

针对任务式对话,UNIT 在高效率的学习模型上采用的是核心理解引擎为启发式对话理解、基于深度学习的对话理解以及多引擎结果融合,成分分析为领域或通用关键词分析的多引擎融合对话理解模型;在自动发现模型缺陷板块和高效率知识构建工具方面,则采用 DataKit 以及 15 套对话式理解范式,可自动修复理解异常问题,从而提高对话效果理解。 -

针对问答式对话,UNIT 的设计思路则是不定义任务、不梳理知识,而是直接用原始业务数据直接生成回复;其核心技术是引入外部知识的阅读理解模型——文本表示和知识表示融合的阅读理解模型 KT-NET。

小米王刚:语音交互带给人机交互的变化

与前两位基于自家产品进行技术解析不同,小米人工智能部副总经理、小爱团队负责人王刚从语音交互给人机交互带来的变化出发,阐述了自身对于语音交互未来发展方向的看法。

他认为未来的语音交互有三个发展趋势:无所不在、更自然的交互以及更懂你。而背后的技术可具体拆解为唤醒、识别、理解、满足与合成几大板块,针对这几大板块目前所存在的几大问题,王刚分别介绍了这些问题面临的挑战、当前的解决方案以及未来的潜在解决方案:

-

第一个问题是 ASR 错误率高,其面临的挑战主要为同音错别字、多字少字、中英文混杂、口音及方言,当前的解决方案为「NLP 帮 ASR」、「ASR 帮 NLP」,而未来可以尝试往语音、语义一体化的方向尝试; -

第二个问题是 Query 意图理解难,其面临的挑战主要为领域和常识知识积累少、信息量少以及表达方式多样化,当前的解决方案为垂域持续建设以及增强中控能力等,而未来则会逐渐走向涵盖知识能力、算法能力、数据能力和用户反馈闭环的综合能力的建设。 -

第三个问题是全领域全双工连续对话,目前面临的挑战为技术链路长,当前解决方案为在前端进行回声消除,采用上下文继承方法来实现垂直域、跨垂域多轮对话,以及无效音拒识(语音拒识、语义拒识、声纹识别)、节奏控制(回复打断、主动响应以及 Query 预测)以及结合应用图形交互界面和语音交互界面等方法; -

第四个问题是单领域复杂任务对话,目前面临的挑战为当遇到领域特有词时,ASR 的错误率上升,另外面对歧义表达需要领域知识消歧和驱动对话等,当前的解决方法为:1)提高表示能力,包括领域知识的本体表示、对话表示以及本体表示到对话表示的转移能力等;2)提高任务式对话能力,包括在 NLU 上,基于对话建模抽取槽位信息而非槽位标注方案以提高鲁棒性;在 DST 上,基于对话表述和 NLU 输出更新对话状态;在 Policy 方面,基于对话状态进行对话引导。 -

第五个问题是主动感知和推荐问题,目前的解决方法主要从主动交互、场景理解以及用户画像等层面来解决此问题。

京东何晓冬:任务导向型大规模对话系统及应用

京东人工智能研究院常务副院长、深度学习及语音和语言实验室主任何晓冬在演讲中强调了人机对话对于人机交互未来发展的重要性及其当前面临的几大技术难点,基于此,他也对对话系统下一步的发展方向阐述了自己的观点。

他指出,多轮人机对话是人工智能的起点及圣杯,而作为人类最基本、最重要的交流方式,对话也是人机交互技术未来的期望所在,然而虽然目前出现了很多应用于特定领域的对话系统并且领域内也在尝试针对开放领域以及高复杂、可靠性要求高的任务的对话系统,但是目前尚无系统能够真正通过图灵测试。

在典型应用上,以京东大规模的复杂客服场景为例,对话系统需要覆盖售前、售中、售后以及物流,涉及到智能调度、智能导航、智能摘要、实时辅助应答、智能质检以及智能创事件等具体任务。基于在大规模任务导向场景中的积累,京东还联合北京智源研究院发布了智源—京东大规模任务导向性对话数据集。

从技术难点来看,何晓冬进一步指出,对话技术目前主要面临五大难点:

-

一是多轮对话状态跟踪不充分,对话系统缺乏有效的全局优化机制,评估准则欠缺; -

二是基于上下文历史信息的精确语义理解还有待提高,缺乏对用户意图的精确理解; -

三是缺乏大量的领域知识及基础常识的支撑,目前还不能执行深度的推理与决策; -

四是对话生成机制还待探索,缺乏可控性、可解释性,难以产生有对用户有同理心的回复; -

五是包括视觉、语音、语言的跨模态的对话与交互技术还有待深入研究;

对此,何晓冬表示,对话系统下一步必然走向全方位多模态的交互方式,通过视觉、语音、语言、知识等统一,使得人与机器的交流变成无限制的交流。基于这一目标,京东 AI 研究院也在不断推进多模态对话智能基础研究。

华为蒋欣:对话系统中的若干技术探索

来自华为诺亚方舟实验室的蒋欣则从对话数据的收集和增强以及对话深度语义理解两个维度来分享对话系统中的一些技术探索。

作为构建对话系统的基石,对话数据的收集面临着不少困难,例如用户隐私、领域强相关、标注复杂性以及动态交互和评估等都是其面临的问题,对此学术界提出了人-人对话、人-机器对话以及机器-机器对话等三种数据收集方法。

其中人-人对话(Wizard-of-Oz)虽然较为贴近真实对话场景,然而人工标注和校验成本高,并且对交互行为的覆盖率低;机器-机器对话(Self-Play)虽然在覆盖率和多样性方面更佳,标注也相对容易,然而对话数据质量依赖于模拟用户机器人和系统机器人,因而在实践中往往会结合 Wizard-of-Oz 和 Self-Play 两种方式分别生成对话数据,再使用数据训练对话系统的 NLU、DST、Policy 以及 NLG 模块,通常可以在受限领域的对话中达到较高的成功率。

对话数据增强方面,一个比较通用的方法则是复述生成,华为诺亚在近期的工作中提出基于 Seq2Seq 神经网络生成相同语义的不同表达,具备更好的可解释性、可控性和可迁移性;此外,在对话状态跟踪任务上,提出基于 Contextual Bandits 对增强的数据进行选择,最后并联合训练数据增强模块和状态跟踪模块。

对话深度语义理解上,目前最好的模型是预训练语言模型:

-

预训练语言模型作为语义理解新范式,具体指在大规模文本语料上训练语言模型,之后在下游任务上微调训练,以中文预训练语言模型「哪吒」为例,目前基于 BERT 已在华为云上实现了多机多卡数据并行训练并尝试了混合精度训练、全词覆盖等一系列训练技术; -

TinyBERT 模型则是专为 Transformer 模型设计的知识蒸馏方法,是以 BERT 作为「老师」蒸馏出的一个小型化模型,以适应不同边缘设备上的计算需求。它的参数量为 BERT 的 1/7,预测速度是后者的 9 倍,并且在 GLUE 评测上相比 BERT 仅下降了 3 个百分点。

演讲结束后,在刘群的主持下,周明、陈海青、孙珂、王刚、何晓冬以及蒋欣六位嘉宾还基于本场技术论坛的主题「「自然语言对话:技术挑战和应用前景」,展开了一场 Panel 讨论,就「在开发对话系统的实践中遇到的难点」、「自然语言对话的数据和评价问题」、「强化学习在自然语言对话的实际应用中所存在的问题」以及「未来对话技术将会在哪些方面会取得突破,应用上是否会有杀手级的场景出现」等问题发表了自己的观点并展开了深度交流。