引用次数在 19000 次+的,都是什么神仙论文?

Word2vec:Efficient Estimation of Word Representations in Vector Space。

目前已经引用了19220次。Word2vec是自然语言处理领域最著名的模型之一

为什么到2021年,还要和大家推荐Word2vec呢?

首先,如果你去面试 NLP 相关职位,被问到 Word2vec一定不感到意外。

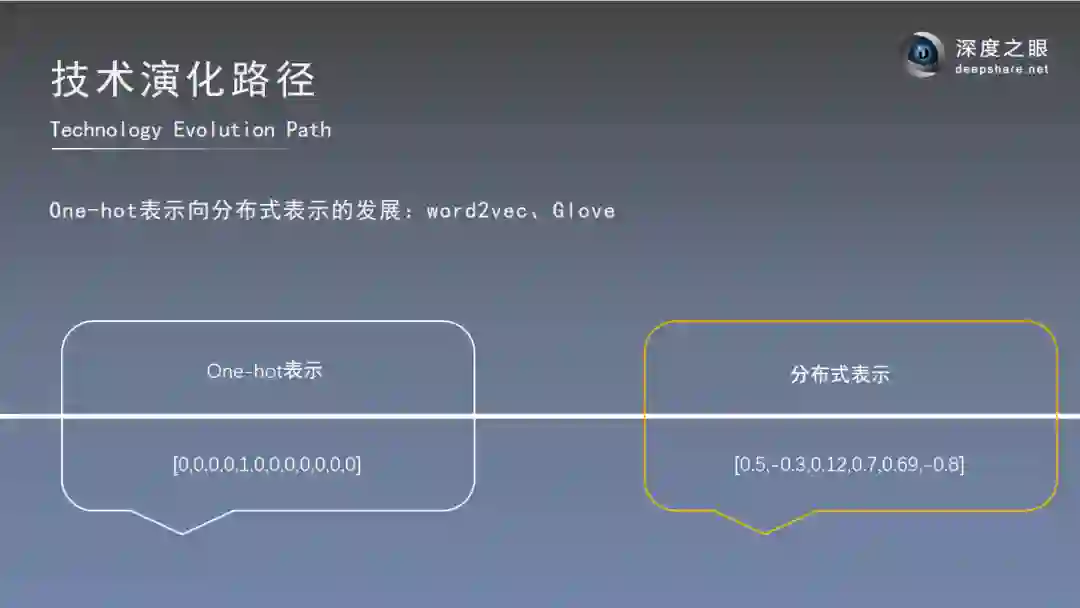

其次,Word2vec作为万物皆可Embedding开山之作,可谓是里程碑式的经典必读论文。它的出现改变了OneHot的高维稀疏的困境,自此之后各种xxx2vec如雨后春笋般冒了出来,用来解决各种嵌入式编码,包括后来的各种Embedding方式其实很多本质上都是Word2vec的延伸和优化。

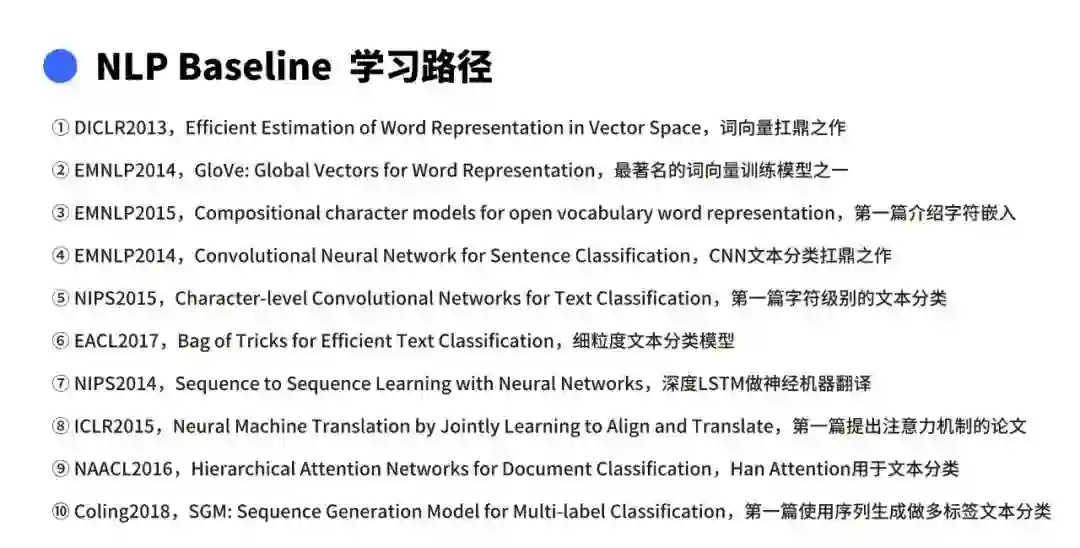

如果你想搞定NLP词向量:LSA、Glove、FastText、ELMo、BERT,可以Word2vec为切入点。

那最传统的方式,还是读论文。

虽然网上有很多解读Word2vec的文章和视频,及复现讲解。但自己复现总是会碰到很多的问题,如果跟随资深的NLP算法工程师,手把手教你一起复现,可以事半功倍。

这里推荐深度之眼 的《 Word2vec 复现班 》:

↓ 扫描上方二维码加班主任 ↓

↓回复:NLP 免费参加 ↓

深度之眼好评度超高的ALBEAT导师 结合自己工作及学习经验,并配合深度之眼教研团的打磨,总结出一条NLP基石论文 的 学习路径:

Step1:系统了解 NLP技术演化路径及发展历史

Step2:精讲NLP开山之作 —Word2vec

Word2vec是自然语言处理领域最著名的模型之一,即能生成更好的词向量, 还能大幅度提高词向量训练的速度, Word2vec提出之后,基于深度学习的自然语言处理任务得到了高速的发展。

1套系统的方法论:2步走教你啃透Word2vec

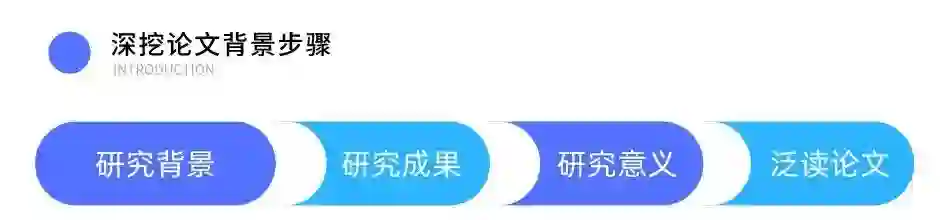

Step1:深挖研究背景

提纲挚领,从4大维度介绍论文,深入讲解论文发表的研究背景、成果及意义,介绍论文中取得的核心成果,对比解决同一问题,已有解决方法和论文中提出的新的解决方法的优缺点,熟悉论文的整体思路和框架,建立对本篇论文的一个概貌性认识。

Step2:死磕算法模型

老师会重点讲解论文中的模型原理,深入拆解模型结构,对关键公式逐步推导,让你了解算法每一个因子是如何对结果产生影响的,掌握实验手段及结果,老师会帮你拎出论文中的关键点、创新点和启发点,节约你自己摸索的时间。

· 3天高质量社群服务,导师全程陪伴

· 实时直播+录播,带你学习正确论文精读方法论

· 100+学员同群交流,学习经验up up⬆⬆⬆

· 助教24小时答疑,再也不怕debug

· 专属班主任私信督学,治疗学习拖延症

重点是,如果你不知道怎么学习,购买课程后,班主任1v1给你制定学习计划!

为了激励大家完成学习,我们还准备了价值298元的算法工程师面试锦囊。只要完成全部课程的学习,你就能私信班主任获取!

这一次,我为粉丝们申请了20个免费福利名额:

3天带你复现Word2vec

购买即赠《效率提升3倍的Paper阅读方法》

↓ 扫描上方二维码加班主任 ↓

↓回复:NLP 免费参与 ↓

如果你不知道怎么读论文、不知道如何正确复现论文,一定要跟着这门课程学习一次,因为正确的方法可以节约你10倍的阅读时间。