哈工大SCIR车万翔、刘挺 | 自然语言处理新范式:基于预训练模型的方法

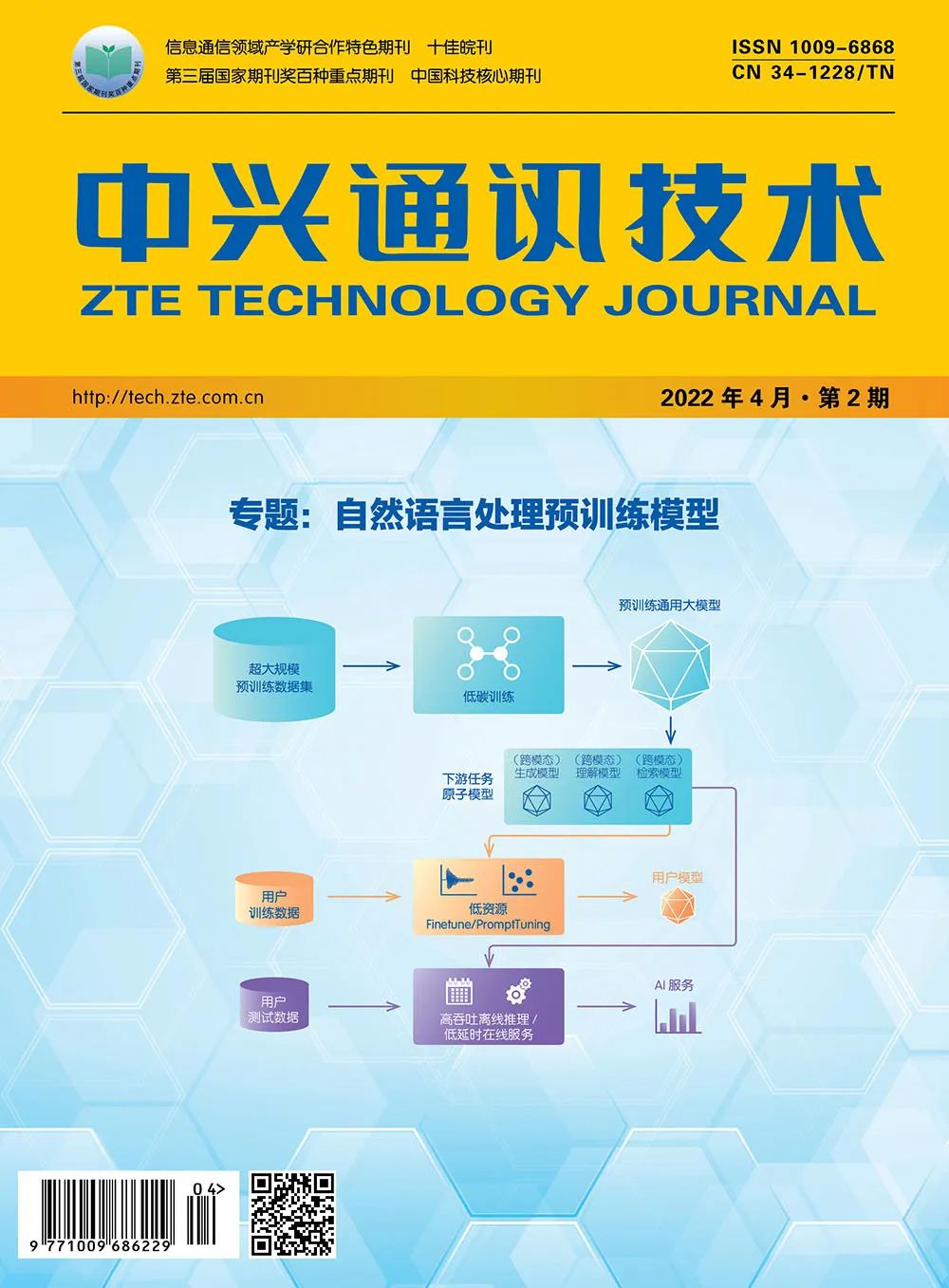

近日,《中兴通讯技术》2022年第2期(总第163期)专题——《自然语言处理预训练模型》正式发表(https://www.zte.com.cn/china/about/magazine/zte-communications/2022/cn202202 )。受本期专题策划人,清华大学计算机系教授、中国工程院院士郑纬民邀请,哈工大社会计算与信息检索研究中心车万翔、刘挺教授撰文,介绍了《自然语言处理新范式:基于预训练模型的方法》。

近年来,以BERT、GPT为代表的、基于超大规模文本数据的预训练语言模型能够充分利用大模型、大数据和大计算,使几乎所有自然语言处理任务性能都得到显著提升,在一些数据集上达到甚至超过人类水平,已成为自然语言处理的新范式。本文首先介绍了自然语言处理技术的演化过程,接着介绍了几种典型的预训练语言模型,最后对自然语言处理领域今后的发展趋势进行了展望。本文认为,未来自然语言处理,乃至整个人工智能领域,将继续沿着“同质化”和“规模化”的道路继续前进,并将融入多模态、具身行为、社会交互等更多的“知识”源,从而为实现真正的通用人工智能铺平道路。

点击阅读原文即可查看《自然语言处理新范式:基于预训练模型的方法》全文

《中兴通讯技术》是一本学术和技术相结合的公开刊物,现为中国科技核心期刊、中国百种重点期刊。

关于自然语言处理中预训练模型的更多介绍,欢迎阅读车万翔等人编写的《[自然语言处理:基于预训练模型的方法](https://item.jd.com/13344628.html)》一书(电子工业出版社,2021年7月)。

本期责任编辑:赵森栋

理解语言,认知社会

以中文技术,助民族复兴

登录查看更多

相关内容

车万翔,博士,哈尔滨工业大学计算机学院教授,博士生导师,斯坦福大学访问学者,合作导师Christopher Manning教授。现任中国中文信息学会计算语言学专业委员会委员、青年工作委员会副主任;中国计算机学会高级会员、曾任YOCSEF哈尔滨主席(2016-2017年度)。在ACL、EMNLP、AAAI、IJCAI等国内外高水平期刊和会议上发表学术论文50余篇,其中AAAI 2013年的文章获得了最佳论文提名奖,论文累计被引用2,100余次(Google Scholar数据),H-index值为26。出版教材 2 部,译著 2 部。承担国家自然科学基金、973等多项科研项目。负责研发的语言技术平台(LTP)已被600余家单位共享,提供的在线“语言云”服务已有用户1万余人,并授权给百度、腾讯、华为等公司使用。2018年,获CoNLL多语种句法分析国际评测第1名。2015-16年,连续两年获Google Focused Research Award(谷歌专注研究奖);2016年,获黑龙江省科技进步一等奖(排名第2);2012年,获黑龙江省技术发明奖二等奖(排名第2);2010年获中国中文信息学会“钱伟长”中文信息处理科学技术奖一等奖(排名第2)、首届汉王青年创新奖(个人)等多项奖励。2017年,所主讲的《高级语言程序设计(Python)》课程获国家精品在线开放课程。

Arxiv

0+阅读 · 2022年6月24日

Arxiv

16+阅读 · 2019年12月16日

Arxiv

16+阅读 · 2019年5月24日