IBM研究员Varshney新书《可信赖机器学习》,294页pdf讲述可信赖ML系统性知识

【导读】当下人工智能已经渗透到各行各业,在很多高风险领域,需要可靠可信赖的模型,即所谓可信赖机器学习。本书来自Kush R. Varshney撰写的《可信赖机器学习》讲述可信赖机器学习系统性知识,非常值得关注。

教育评估、信贷、就业、医疗保健和刑事司法等高风险应用的决策越来越受到数据驱动,并由机器学习模型支持。机器学习模型也使关键的信息物理系统,如自动驾驶汽车和机器人手术成为可能。在过去的几年里,机器学习领域取得了惊人的进展。然而,即使这些技术越来越多地融入我们的生活,记者、活动家和学者仍发现了一些侵蚀这些系统可信度的特征。例如,据报道,一个支持法官审前拘留决定的机器学习模型对黑人被告存在偏见。同样,据报道,一个支持在一家大型科技公司进行简历筛选的模型也对女性有偏见。研究表明,用于胸部x光片疾病计算机辅助诊断的机器学习模型更重视图像中的标记,而不是患者的解剖细节。自动驾驶汽车的死亡事故发生在不同寻常的条件下,根本的机器学习算法没有经过训练。简而言之,虽然每天都有机器学习算法在某些任务上取得超人成绩的新故事,但这些惊人的结果只是在一般情况下。我们在所有情况下信任这些算法所需要的可靠性、安全性和透明度仍然是难以捉摸的。因此,越来越多的人希望在这些系统中拥有更多的公平性、健壮性、可解释性和透明度。

http://www.trustworthymachinelearning.com/

机器学习的当前状态是什么,我们如何让它更值得信任? 天然成分、卫生制剂和防篡改包装的类似物是什么?机器学习的透明容器、工厂参观和食品标签是什么?机器学习在造福社会方面的作用是什么?

这本书的目的是回答这些问题,并提出一个可靠的机器学习的统一观点。有几本从不同角度介绍机器学习的优秀书籍。也开始出现一些关于值得信赖的机器学习的个别主题的优秀文本,如公平性和可解释性然而,据我所知,没有一个独立的资源可以定义值得信赖的机器学习,并带领读者了解它所涉及的所有不同方面。如果我是一个在高风险领域工作的高级技术专家,不回避一些应用数学,我就会写一本我想读的书。其目标是传授一种将安全性、开放性和包容性视为头等大事的机器学习系统整合起来的思维方式。我们将开发一个概念性的基础,会给你信心和起点,深入研究的话题。

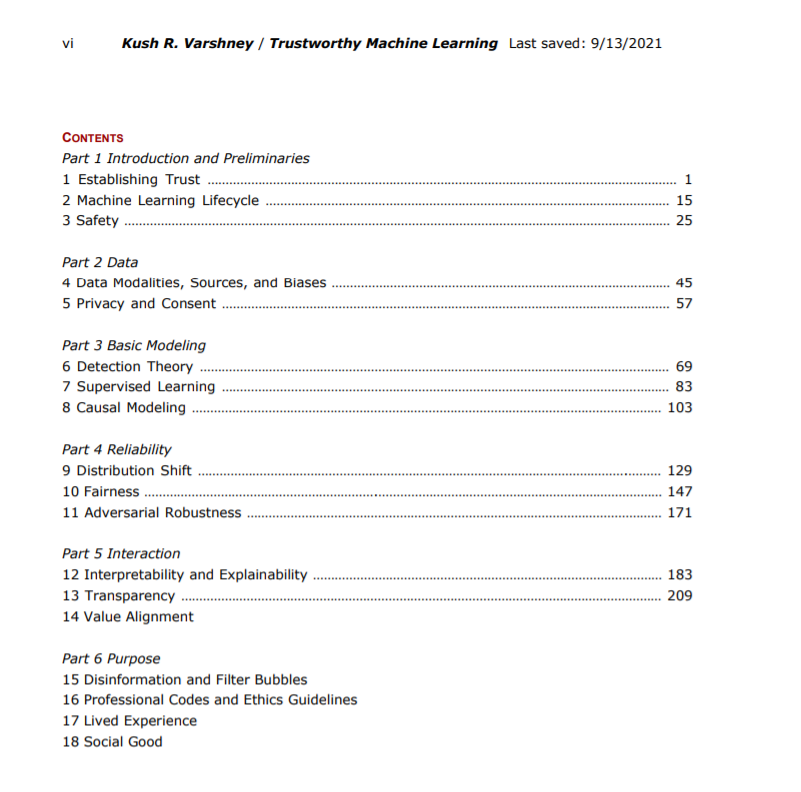

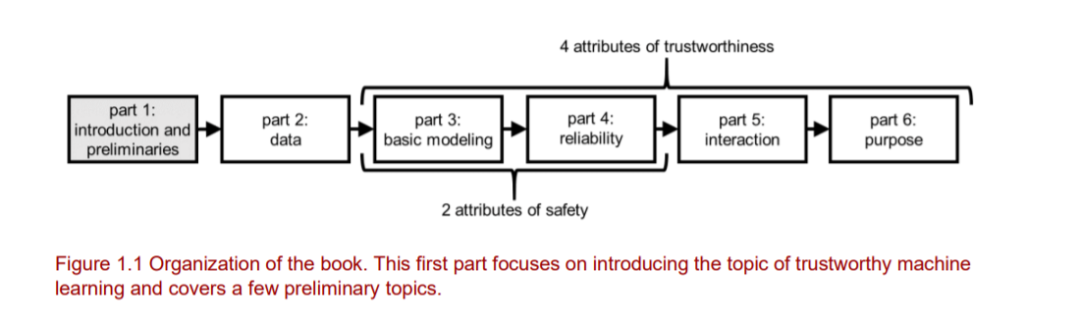

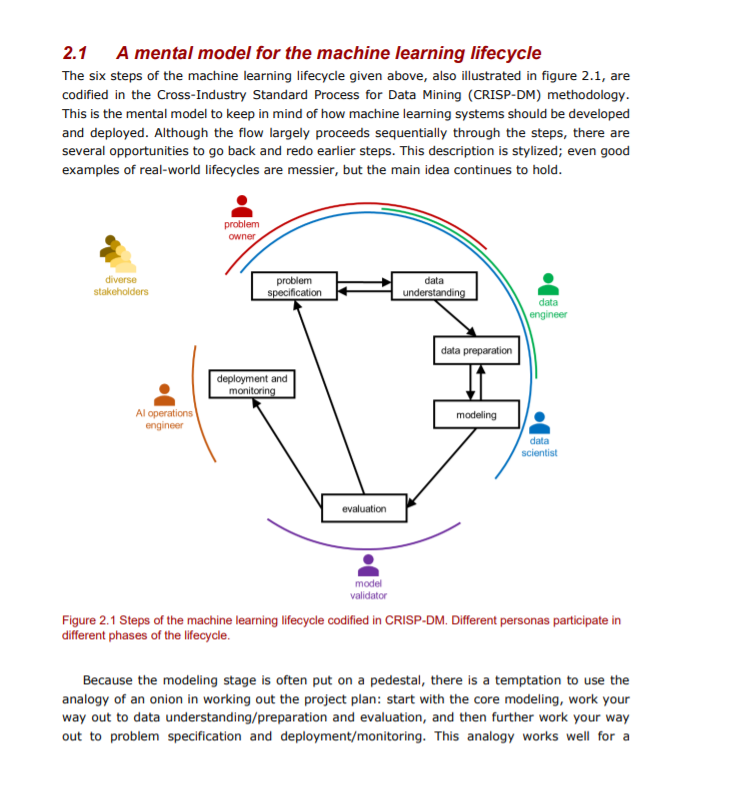

在图1.1中突出显示,第1部分的剩余部分讨论了本书的局限性,并讨论了几个对理解可靠机器学习概念很重要的初步主题: 在实践中开发机器学习系统的角色和生命周期,以及在不确定性方面量化安全概念。

第2部分是关于数据的讨论,数据是进行机器学习的前提。除了提供不同数据模式和来源的简短概述外,该部分还涉及与可信机器学习相关的三个主题: 偏见、同意和隐私。第3部分涉及到值得信赖的机器学习的第一个属性: 基本性能。它描述了最优检测理论和不同的有监督机器学习公式。它教授几种不同的学习算法,如判别分析、naïve贝叶斯、k-最近邻、决策树和森林、逻辑回归、支持向量机和神经网络。最后总结了因果发现和因果推理的方法。第四部分是值得信赖的机器学习的第二个属性:可靠性。这个属性通过三个特定的主题来讨论: 分布偏移、公平性和对抗鲁棒性。这些主题的描述不仅定义了问题,而且还提供了检测和缓解问题的解决方案。

第5部分是关于第三个属性:人类与机器学习系统在两个方向上的交互——理解系统并给它指令。第一部分从模型的可解释性和可解释性开始。它转向了测试和记录机器学习算法各个方面的方法,然后可以通过公平性、问责制和透明度表(FAccTsheets)进行透明报告。本部分的最后一个主题是机器引出人们和社会的政策和价值观来管理它的行为。第六部分讨论了第四个属性: 人们和社会的价值可能是什么。它首先讨论了机器学习在虚假信息中的恶意使用,以及机器学习在创建过滤气泡时不必要的含义。接下来,它描述了在机器学习和人工智能中编码期望值和应用的不同专业指南。最后,本文讨论了如何将具有不同生活经验的机器学习系统创造者纳入其中,从而扩大机器学习的价值、目标和应用,在某些情况下,通过技术追求社会公益。

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“TML” 就可以获取《机器学习如何可靠?IBM研究员Varshney新书《可信赖机器学习》,294页pdf讲述可信赖ML系统性知识》专知下载链接