AITech 深圳召开,企业领军人齐聚首,五位 IEEE Fellow 现场带来主题演讲

文 | 思颖

来自雷锋网(leiphone-sz)的报道

雷锋网按,3 月 30 日,AITech(2018 国际智能科技峰会) 于深圳隆重召开。本次峰会由深圳市人民政府指导,深圳市龙岗区人民政府、中关村视听产业技术创新联盟、新一代人工智能产业技术创新战略联盟主办,深圳龙岗智能视听研究院承办,雷锋网作为独家战略合作媒体带来现场报导。

在智能技术与标准及 IEEE Fellow 分论坛上,迎来海信、思必驰、华为的三位产业领导以及南方科技大学、香港中文大学深圳分校、南京大学等五所高校(科研机构)的学术明星。三位企业代表从多个方面阐述了各自行业目前面临的机遇、挑战以及相应应对措施,五位学术界明星或幽默、或严谨地报告了目前自己的学术研究。

海信、思必驰、华为的三位产业领导齐聚首

首先出场的是海信公共安全事业部总经理孙论强,他的演讲主题是《从视频接力到精准跟踪一一跨媒体智能领航安防行业》。

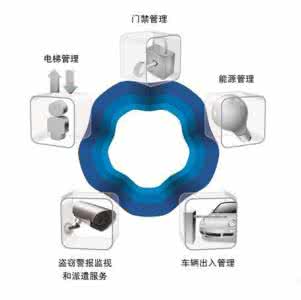

演讲伊始,他提出安防行业迎来新的机遇与挑战。目前,人工智能广泛应用于安防领域,如人脸识别、车辆识别、目标检测等,但将传统 AI 技术应用于安防行业有如下三点不足:场景适应能力不强,需求多样性无法满足,智慧化程度不高。他进一步引出了即将重点描述的部分——跨媒体智能。

孙论强表示,跨媒体智能技术突破之后,可实现各种异构数据的融合,充分发挥机器学习、数据分析与挖掘等的优势,比如多种媒体的融合应用、多元异构数据分析、多维智能主动预警。

他接下来谈到,目前我们需要从视频接力到精准追踪。「以往的视频接力追踪过程依靠经验,并且需要人工判断,比较耗时费力。而精准追踪对安全风险的管控提出更高要求,需要实现目标的精准识别、定位、轨迹刻画、属性判断和行为分析。」在实现的过程中,运用了很多关键技术,比如跨媒体时空分析,流式视频大数据,跨媒体多元数据融合,而针对每一关键技术,他也提到了具体的模型、算法以及整体架构。

谈到应用案例,他举了青岛的一个例子,当市民的小孩走失报警之后,启动前面提到的精准追踪技术,通过目标结构化及特征提取、跨媒体多元数据融合等,能够快速追捕到嫌疑人。

之后,孙论强展示了海信在跨媒体智能安防上的成果,他表示,海信除了电视和冰箱,还关注数字多媒体技术、智能信息系统等多个技术,目前,他们的跨媒体安防技术的产品有狼王视频安全接入网关、狼眼视频结构化系统、战狼公安实战平台等。

在演讲的最后,他表示,智能安防行业任重道远,他们将坚持技术创新,深入研究跨媒体智能安防应用,引领行业发展,开创智能安防行业新时代。

第二位演讲的嘉宾是思必驰联合创始人、首席科学家俞凯,他的演讲主题是对话智能。

他表示,时代不断变革,从 PC 互联时代的文本搜索,到移动互联网的语音、文本对话,再到现在的硬件物联网时代的自然口语对话,数据出现了指数级的增长。「可以看到,我们从 PC 互联迈入智能设备互联的时代,例如亚马逊推出 Echo,微软推出 Cortana Button,谷歌推出 Google Home 等。我们目前需要对话智能系统,能进行语音识别、语义理解等。」

他谈到目前的智能行业主要有三个层次,一是基础支撑层,二是智能交互层,三是系统应用层。他们正在做的就是第二层,其核心技术是感知、认知和表达。

接着,俞凯提到智能行业的主要矛盾——技术提供商的定制效率和层出不穷的个性化需求之间的矛盾。「当做产品时,顾客有各种个性化需求,比如是否支持热更新、为什么不支持自定义。这时候,如何更快做得更专业化,这是一个挑战。」

而为了迎战这一挑战,他们推出思必驰大规模对话定制平台。他表示,虽然语音合成很早就可行,但他们希望在对话层面做到能像手机 apps 一样定制化,实现开放的解决方案。「我们在做的时候需要解决一系列技术问题,平台不单是技术平台,需要为产业提供真正有意义的应用。」他们提出玲珑系统(做跨平台的转接,提供云+端技能的混合定制)、天机系统(提供可视化大数据,实现用户画像和智能化推荐,给开发者详尽、可按需定制的用户任务结果数据)、青囊系统、紫薇系统等。

他表示,当不定制的时候,他们做成一个黑箱,而定制话的系统在结构上是白箱,子结构是黑箱。

之后,俞凯提到对话智能需要利用到的技术:在语义层面快速的迁移学习、深度强化学习以及自适应技术。而在演讲最后,他对对话认知智能技术路线提出自己的看法——从深度学习到迁移学习(解决数据量的问题),从数据驱动到知识嵌入(利用已有的知识),从开环学习到闭环学习(让机器具备自学习的能力)。

接下来,华为 CBG 软件工程部副总裁张宝峰带来主题为 Enabling Next Generation Mobile experience with Huawei HiAI 的报告。

演讲伊始,张宝峰表示,如何让 AI 走下神坛,是我们要思考的问题。而其中重要的一点是开放。他表示,他们希望用开放性的 HiAI 平台,让更多人参与进来,让用户更快享受 AI 带来的变革。

为什么要开放呢,他解释道,目前进行 AI 研究存在许多问题,比如门槛高、效率低、能力碎、提升难,他们希望把芯、端、云侧的计算力开放出来,比如将实践中集成好的各种 AI 模型开放给开发者。

他说道,华为 HiAI 生态主要有四大优势助力开发者,一是 AI 能力加速,二是 AI 能力提供,三是完备的工具支持,四是成熟的服务生态。

他也举了一些例子。他们与一家公司合作将照片进行风格转换时,在端侧执行模型,可以将效率提升 300%。他补充道,很多人脸识别、物体识别,当在端侧计算时,不仅可以提升效率,还可以提升用户体验。为了能让应用开发更快,他们做了很广泛的调研。目前,他们有成熟的服务生态,希望能给用户便捷的体验。

最后,他表示,HiAI IDE 与 Android studio 完美集成,可以不改变开发者习惯,快速集成 AI 模型,快速开发出极具想象力和全新体验的 AI 应用。他表示,通过这样一个开放的生态,会促进整个产业链共赢。

五位 IEEE Fellow 带来精彩主题报告

在张宝峰的演讲结束之后,迎来五位 IEEE Fellow 的主题报告,首先出场的是南方科技大学计算机科学与工程系主任、IEEE Fellow、千人计划专家姚新,他的演讲主题是 Evolving Intelligence(演化智能)。

他首先谈到目前火热的人工智能,他表示,教育部、科技部等各类文件都提到人工智能,目前人工智能可能应用在自动驾驶车、对话系统等诸多领域,背后的技术有深度学习等。

他表示,目前,图像识别的精准度不断提升,甚至超过了人类。而完成这一个阶段的突破之后,有人认为图像识别不好玩,又开始提出类脑计算,要做一个真正的「电」脑,最早先从欧美开始,后来中国也提出「中国脑计划」,一是认识脑,二是模拟脑。他表示,先从人工智能 2.0 到工业 4.0,接下来从模拟脑 8.0 ,在未来,又可能会出现某某 16.0。

他表示,人工智能和脑启发计算都不是新学科,需要发掘新的人工智能问题,找到人工智能缺少的部分。这引出演化智能。「所有的脑都是演化而来的,没有任何的生物脑是上帝造出来的。如果我们真的想认识脑和模拟脑,演化的过程不可忽略。如果我们真想理解一个系统,不能忽略系统产生的过程。」

他接下来举了自己之前做的研究,他们做了一个非常规范的神经网络,然后考虑让演化过程自动发现神经网络。通过对比,可以看到演化的神经网络比人工做的更紧凑,演化的网络层数很多,占用的资源少,效率也更高。

他表示,把演化的过程考虑进去,会出现一些意想不到的东西。而他接下来也举了教育学生以及玩游戏的例子来推广到演化智能。他表示,演化计算的深入研究将对人工智能产生重大影响。

接下来出场的是香港中文大学深圳分校理工学院院长、IEEE Fellow、千人计划专家陈长汶,他的演讲主题是《Scenario-Aware Intelligent Media Delivery in 5G Mobile Networks》。

陈长汶教授说道,前面大家讲了很多人工智能相关的东西,他想讲一点点比较特别的,即 5G 的智能化。他表示,自己也做过很多与人工智能相关的研究,人工智能虽然很红火,但现在还是任重道远。接下来他回归正题。

首先,他从从第一代移动通信讲到到马上实现的第五代。他表示,目前网络越来越复杂,功能越来越丰富。从 1G 的模拟,到 2G 的数字可以传递短信,再到 3G 的媒体(3G 的时候,中国有了自己的标准),现在步入 4G 时代的多媒体,然后即将迎来 5G 时代。

他表示,5G 不仅仅是简单的移动宽带。为了满足需求,需要有技术标准,他举了很多的技术上的数字,也提到一些技术比如 MIMO。在未来,将向超 5G 发展。之后,他表示,为了持续发展,3C 非常重要,即 communications,computing 和 cashing。

而将下一代 5G 应用起来,可以有什么不同的场景呢?他列举了三个场景:一是更宽的带宽,二是超稳定、短延时要求,三是物联网。接下来他也提到 5G 的新挑战,比如如何在多场景下选择最好的组合等。

然后是南京大学千人计划专家、 IEEE Fellow 王中风带来的演讲,他的主题是 VLSI Optimizations for Deep Neural Networks。

王中风教授对他们最近的工作做了简单介绍,其中包括很多还没发表的工作。在演讲中,他主要讲到了如下三个方面,一是模型的压缩,二是硬件架构上的设计,包括卷积网络、递归网络的架构等,三是工程化方面的进展。

他表示,深度学习在许多应用上取得突破,比如医疗、语音、自动驾驶等,而核心部分是深度神经网络,他们从硬件的角度来研究这些架构和一些瓶颈。

他提到,目前的推理平台有 CPU、GPU、ASIC、FPGA 等,现在算法的复杂度在提高,同时带来功耗的增加,从能耗来讲,CPU、GPUF、FPGA、ASIC 的效率逐渐增高。

他们在算法和硬件架构上进行了一系列优化。

在模型压缩方面,他提到量化问题,而对于深层神经网络,他们设计了一个机制,来自动/动态简化网络。「当物体很难识别时,我们使用复杂网络,而当识别很简单时,可以自动简化网络,降低功耗。」他表示,这是他们最新的工作。

之后,他也提到了递归神经网络等。他表示,他们目前的研究工作与 FPGA 2017 best paper 进行对比,他们达到了 32 倍的 size reduction,超过后者的 20 倍。之后,他讲到针对卷积神经网络做的一些研究工作以及卷积网络里可以优化的部分,比如从 3D 到 1D 的优化,存储的优化,带宽的优化等,他也对这些优化具体展开了讨论。

此外,他还提到 Energy-Quality Scalable 卷积神经网络,其中需要解决的问题以及他们的解决方法,另外还有对深度学习保密性的研究。

在演讲的最后他表示,他们基于 TSMCA 28nm 工艺的神经网络处理器芯片版图将于 6 月份流片,此外,他们还做了一个基于深度学习的视觉处理验证平台。

他总结到,对于深度学习来说,DNN 非常重要,而 VLSI 优化将会带来意想不到的效果。

之后迎来台湾清华大学、IEEE Fellow 林嘉文的演讲,他主要谈到人脸识别方面的一些研究。

演讲伊始,他谈到这是自己第一次来深圳,他表示,人脸识别在 AI 领域是一个非常重要的应用,但会遇到很多难题。

他提到人脸识别的以下挑战,一是要准确找出人脸位置,但要是人脸很小,就会很难侦测。虽然现在有办法提高分辨率,但很多时候,分辨率提高后无法提高识别效果。

此外,在很多场景下,比如光线变化,人的表情、姿势发生变化,有人戴眼镜,有人戴口罩,这也会影响识别率。

他举了几个例子,比如要侦测一张篮球场照片里的很多微小人脸,还有侦测分辨率非常低的人脸,需要怎么做呢?虽然利用 GAN 可以生成人脸,但也会误产生人脸。如何既增加人脸分辨率又提升人脸检测准确度。另外,在做超分辨率时,如何既能完成高质量的重建,又能保证身份特征。

他提出如下方法,他们使用 Siamese 网络,将这个网络跟 GAN 结合,得到 SiGAN,在实验中,他们用 LFW 等一些数据库做测试,发现 SiGAN 结果的准确度比传统网络还有 GeGAN、DeGAN 等都要高,他们还对执行时间等进行了对比,也发现效果非常好。

最后,他提到他们基于 GAN 做 Face Augmentation 和 Face Normalization,对人脸进行处理之后也可以得到较高的识别率。

最后一位上台演讲的是 New Jersey Institute of Technology、IEEE Fellow、千人计划专家周孟初,他的演讲主题为 Dendritic neuron model-based learning algorithms for classification, approximation and prediction。

在演讲中,他由人类的神经细胞讲到人工神经网络。他表示,神经网络是用非常简单的网络表示非常复杂的模型。基于之前的两个模型,他们提出 Dendritic Neuron Model,他表示,他们在其中引入了很多乘法,模型有很强的处理非线性问题的能力。

之后,他详细讲解了该模型的架构,他表示,模型有四个 layer,有 4 种 connection,他也谈到了这一模型的主要特征,他形容,DNM 相当于一棵树,树上有很多分支,分支上有很多叶子。

而接下来,他也提到了模型的实际应用,比如解决乳腺癌问题,肝脏疾病问题、金融时间序列预测、旅客到达预测等等,他们的模型在这些问题上都有不错的效果。

他也提到了目前算法的一些问题,他表示,传统经常使用的 BP 算法,会经常落入 local minima 问题,得到局部最优解,而不是全局最优解,此外还有 saddle points 问题。他提到 BBO、ES、PBIL、GA、ACO、PSO 这六种算法,他们将这六种算法进行了比较,他表示,最终 BBO+DNM 取得的结果相当不错。

至此,智能技术与标准及 IEEE Fellow 分论坛圆满结束,而在次日将迎来 3 场同样精彩的论坛,敬请期待雷锋网的现场报导。

雷锋网诚招编辑、运营、兼职、外翻等岗位

详情点击招聘启事

推荐阅读

关注雷锋网(leiphone-sz)回复 2 加读者群交个朋友