近期值得读的知识图谱论文,这里帮你总结好了

精选 5 篇来自 WSDM 2019、NAACL 2019 和 WWW 2019 的知识图谱相关工作,带你快速了解知识图谱领域最新研究进展。

本期内容选编自微信公众号「开放知识图谱」。

■ 论文解读 | 吴杨,浙江大学硕士生,知识图谱、NLP方向

动机

本文主要针对基于知识库的问题回答中的简单问题,也就是问题的答案只涉及 KG 中的一跳,此类问题在 KG 中找到对应的头实体和关系以后,获取到的尾实体即为问题的答案。

本文的思路主要是:直接将问题的文本空间向量转化到 KG 空间向量,并在预训练的(通过 TransE 之类)KG Embedding 中查找与该向量最相似的那个实体和关系,利用他们得到问题的答案。

本文的主要贡献在于:

-

提出了 KEQA 框架,能够使用 KG Embedding 查找问题的实体和关系来解决问题; -

对预训练的 KG Embedding 和文本转化来的 KG Embedding 提出了新的距离度量;

-

解释了 KEQA 的效率和鲁棒性。

方法

概述

对于一个三元组 (h, r, t) 组成的 KG,我们首先使用 KG Embedding 模型来对 KG 中的实体和关系 Embedding 进行预训练,通过使用 TransE 或者 TransH 等方法,最终的得到实体的表示

随后我们通过神经网络,将问题的单词 Embedding 作为输入,训练其输出一个关系的 Embedding 和实体的 Embedding,通过计算这两个向量与预训练的关系向量和实体向量的距离,我们取距离最小的两个,作为最终三元组的头实体和关系,来获取到答案。

转化到KG Embedding空间部分

将问题通过 Bi-LSTM 转化成为 d 维度的向量。随后经过 Attention 层并与原单词的 Embedding 做合并操作,在经过一个全连接层得到该单词映射到 KG 空间的 Embedding,将所有的向量作加权平均,最终就可以得到问题转化成为的头实体向量或者是关系向量(注意转化到头实体和转化到关系使用的是相同的神经网络架构)。

该组神经网络的训练数据来源于原始 QA 对中直接取出 Answer 的头实体预训练 Embedding 和关系预训练 Embedding。损失函数为向量的欧氏距离,涉及到的公式如下:

头实体探测

由于 KG 中的实体一般非常的多,因此有必要在 KG 中首先将不相关的实体进行剔除操作得到一个子图,然后将得到 Embedding 与子图中的实体 Embedding 进行距离度量已加快速度,在这里,我们首先通过一个神经网络来探测问题中的各单词是否是一个实体。

在得到的结果中,我们将输出值为有可能是实体的那些单词,送入 KG 做实体的字符串匹配,这样就可以拿出仅与这些单词相关的实体了。具体的模型如下:

首先,单词经过一个 Bi-LSTM 后,直接进入全连接层,再通过 SoftMax 得到一个二维的向量,其中第一维表示这个单词是一个实体的概率,第二维表示不是实体的概率。

度量部分

这一部分需要对神经网络输出的实体 Embedding 和关系 Embedding 计算其与预训练的 Embedding 之间的度量:

其中,(h, l, t) 表示候选的三元组,度量项的前三项分别为输出的头实体、关系、尾实体和预训练的头实体、关系、尾实体之间的欧氏距离。

注意,由于 QA 中一个头实体和关系可能对应有多个尾实体,因此这里不直接使用预训练的尾实体 Embedding。而是使用预训练 KG 时的 (h, l ,t) 之间的关系函数 t = f(h, l) 来表示(对于 TransE,其为 h + l = t)。

第四项和第五项分别表示头实体和关系的字符串与 (3) 部分提取出的问题中可能为实体的单词之间的相似度。至此总的 KEQA 流程结束。其算法表示如下:

实验

在各数据集的数据量

由于去解决的是简单问题,因此所用到的数据集为 Freebase,其中 Freebase 的子集 FB2M 和 FB5M 以及 FB2M 的子集 SimpleQuestions 这三个数据集的数据量以及一些其他特征见下表:

性能评测

可以看的出来,本文在简单问题上的正确率相较于当前的模型还是有一定的提升的。

如果对于使用了不同的预训练模型,比如 TransE/H/R 之间的性能区别,以及预训练的 KG Embedding 对 QA 问题的性能提升可以在下表中看出,对于 noEmbed,也就是使用随机初始化的向量值作为实体和关系的 Embedding(在距离度量时也采用该 Embedding),由于随机初始化的结果服从均匀分布,因此问题退化为一个基本的分类问题。

最后,这一张图则体现了新的距离度量函数对性能的影响,其中第一项表示只保留,第二项表示只删除,第三项则表示依次按顺序将当前的度量项目加入到度量函数中得到的新能结果。

总结

本文提出了使用预训练 KG Embedding。再使用神经网络将问题空间映射到 KG 空间的 Embedding,并将这二者进行距离度量,取出距离最小的预训练 Embedding,从而得到问题的答案头实体和关系的方法。

■ 论文解读 | 谭亦鸣,东南大学博士生,研究方向为跨语言知识图谱问答

动机

为了摆脱图谱表示学习过程需要添加的线性/层次约束,有效利用起图谱中的关系结构,作者提出一种新的 Graph Transformer 编码器。

贡献

本文贡献如下:

1. 提出了一种 Graph Transformer 编码方法用于知识图谱表示学习;

2. 提出一种将 IE 输出转换为图结构用于编码的过程;

3. 构建了一个可复用的大型“图谱-文本”对数据集。

方法

Graph Transformer

预先准备为了进行编码,作者将图谱重构为一种无标注的连接图,实体和关系都为图中的节点,下图左为一般的知识图谱三元组形式,右边为重构的图结构。可以看到,每个三元组都被替换为两个“实体->关系/关系->实体”的有向图,同时为了保留未连接实体之间的信息流(information flow),作者设置了一个全局结点 G 指向所有的实体节点。

最终得到的是一个全连接,无标注的图 G = (V, E),其中 V 表示图中所有节点的列表(实体,关系,全局节点),E 则是表示图中各条边的方向的邻接矩阵。

Transformer 模型本文模型与图注意力网络(GAT)的思路相近,利用注意力机制,将相邻节点的信息用于生成目标节点的隐状态表示。但是 GAT 模型仅考虑图谱中已出现相邻节点的信息,本文提出的全局节点设定使得模型能够利用更为全局的信息(可能存在的实体关联,但并未出现在知识子图中的潜在信息)。

下图是 graph transformer 模型的框架图,结构上与普遍使用的 transformer 模型并无明显区别,本文不再赘述。

Graph Attention 的计算由各 head 的输入加权拼接实现,过程如下:

End2End文本生成模型

End2End 文本生成整体上还是由编码和解码两个部分构成(如下图),其中,编码结果由两个编码输入整合得到,分别为图谱编码(来自 graph transformer)与主题/标题(Title)编码(来自 biRNN)。

个人理解,主题编码的目的是给多句文本的生成提供一个顺序指导,假设多句连贯文本本质上是一条一套三元组构成的路径,主题编码则是表示路径的起点,以及生成过程必须经过的某些节点。

解码部分则是由一个单向的 RNN 构成,生成序列的过程除了从词表中选词的 softmax 方式外,还添加了复制机制,这一做法可以避免低置信度文本生成(以及 OOV 情况)。

实验

数据说明

本文实验所使用的训练数据来自 AGENDA(Abstract Generation Dataset,摘要生成数据集,科技论文领域),作者利用 SciIE 信息抽取系统,将摘要中的实体/关系识别出来,作为节点构建知识图谱,过程如下图所示。

AGENDA 数据集的相关统计参数如下图所示,作者将数据集切分为 38720 规模的训练集,1000 验证集与 1000 测试集。

实验方案

作者考虑了人工评价与自动评价两种评测机制,自动评价方法选择了常见的 BLEU 与 METEOR,用于反映生成文本相对参考文本的 n 元文法相似程度,对比系统与结果如下表所示。

人工评价方面,则通过投票,对候选系统的输出结果进行投票,可以看到本文方法在 best 评价的获取数量是 Rewriter(未引入知识图谱的方法)的两倍,可以说,图谱化的知识相对非结构化文本提供了更清晰的知识结构。

思考

■ 论文解读 | 王狄烽,南京大学硕士生,研究方向为关系抽取、知识库补全

动机

现有的利用远程监督进行实体关系抽取的方法大多关注于如何对训练数据进行降噪,从而提升模型效果,而忽略了长尾关系的抽取,使得长尾关系抽取效果极差。但是长尾关系的存在是不可忽略的,在 NYT 数据集中,大约 70% 的关系属于长尾关系(即该关系训练实例数量较少,少于 1000)。如何提高模型对长尾关系抽取效果是该篇论文主要出发点。

贡献

该篇论文的主要贡献如下:

1. 提出了一种长尾关系远程监督抽取的模型;

2. 联合使用 KG embeddings 和 GCNs 来学习关系丰富的语义信息;

3. 利用 coarse-to-fine knowledge-aware mechanism 来利用关系语义信息;

4. 在 NYT 数据集上的结果表明当前模型在长尾关系的抽取上取得了 state-of-the-art 的效果。

方法

在方法整体思路上,遵从前人工作,利用语义相近的 head 关系,辅助训练长尾关系,从而缩小关系抽取时潜在的搜索空间、减少关系之间的不确定性。该思路的两个要点在于:1. 如何学习得到关系语义信息;2. 如何利用学习得到的关系语义信息。

对于如何学习得到关系语义信息,该论文首先利用现有的 KG embeddings 方法(如 TransE 等)学习得到关系的隐式语义信息,但是因为 TransE 等模型无法有效建模关系的一对多、多对多情况,从而仅仅通过 KG embedding 方法无法有效获取关系的语义信息。

因此,论文中使用图卷积网络(GCNs)从关系的层次结构中获取关系的显式语义信息。最后将关系的隐式语义信息和显式语义信息进行结合从而得到最终的关系语义信息表示。

对于如何利用学习得到的关系语义信息,该论文首先利用 CNN 将句子编码为低维向量,然后使用 coarse-to-fine knowledge-aware mechanism 从多个同实体对句子(多实例学习)加权得到最终的句子向量表示。

模型的框架图如下所示:

从模型框架图中可以看出,其方法主要包含三个部分:

1. 实例编码模块:利用 CNNs 对句子进行编码;

2. 关系知识学习模块:利用 KG embedding 和 GCNs 得到关系的语义表示;

3. Knowledge-aware 注意力模块:利用关系语义信息对同实体对的多个句子进行加权得到最终句子的语义表示。

实例编码模块

给定一个句子

1)预训练 Skip-Gram word embedding

2)position embeddings

关系知识学习模块

在关系知识学习中,综合利用 KG embedding 和 GCNs 得到关系的语义表示。对于 KG embedding 使用 TransE 对知识进行预训练从而得到关系的隐式表示。

对于如何使用 GCNs 得到关系的显示表示?论文中首先构建了关系的层次结构图,关系的层次结构图可以使用 hierarchy clustering (Johnson, 1967) or K-means 算法结构构建,也可以使用现有知识图谱中关系的层次结构。关系的层次结构图如下所示。

对于构建的关系层次结构图,底部的节点用 TransE 预训练的关系向量进行初始化,父节点初始化为子节点平均值。

使用两层 GCN,对构建的关系层次图进行迭代训练,GCN 输出层公式如下:

最终关系的语义表示为:

Knowledge-aware注意力模块

依从多实例学习,对于给定的实体对 (h,t),以及相关的多个句子

是

的子关系。

我们计算 Attention 操作在关系层次链的每一层,从而得到每一层文本相关的关系表示,具体公式如下:

考虑到不同层次的关系对最终实例表示的贡献的不同,对每一层关系表示使用 Attention 操作,其中使用作为 score-function,表示输入关系 r 和该层预测关系 r’ 之间的匹配层度,计算公式如下:

最后使用来计算

实验

数据集

实验结果

长尾关系实验结果

说明:为了体现模型在长尾关系的有效性,作者选择了实例数少于 100/200 的长尾关系,以长尾关系构建测试子集进行实验,实验结果如下。

总结

本文针对长尾关系抽取提出了一种利用 KG embedding 和 GCNs 学习关系知识以及使用注意力机制利用学习得到的关系语义信息的模型。

■ 解读 | 吕欣泽,南京大学硕士生,研究方向为知识图谱

摘要

大多数现代信息提取(IE)系统都是作为顺序标记器实现的,并且只模拟本地依赖项。然而,非顺序的上下文是改进预测效果的有价值的信息来源。

本文介绍 GraphIE,一个在图上运行的信息抽取框架。该算法通过图形卷积网络在连接的节点之间传播信息,利用来改进单词级别的预测从,而生成更丰富的表示。本文评估了三个不同的任务:文本,社交媒体和视觉信息提取,结果一致地显示 GraphIE 优于最先进的信息抽取模型。

模型介绍

概览

最现代的信息提取(IE)系统通常被实现为顺序标记器。这样的模型有效地捕捉了在上下文中的本地关系,它们利用非本地和非顺序依赖的能力有限。然而,在许多应用程序中,这种依赖性可以大大减少标记的模糊性,从而提高整体提取性能。

例如,从文档中提取实体时,各种类型的非本地情境信息,如共同引用和相同的提及可能提供有价值的线索。参见下图,其中非本地关系对于区分第二次提及的实体类型至关重要:华盛顿(即人,组织或地点)。

本文提出了 GraphIE,这是一个通过自动学习输入空间中本地和非本地依赖关系之间的交互来改进预测的框架。它将图网络和编码器-解码器集成在一起,构建了序列标记的体系结构。模型如下:

编码

一个句子表示为

被表示为一个向量

,编码公式为如下,其中

代表隐态,0 代表初始隐态为 0 向量,

代表编码器的参数。

图卷积网络过程为如下,其中

是要学习的权重,

是节点 v_i 的度,

和

组合得到第 l 层的表示

。

解码

解码时,隐态的获得如下,其中是图卷积网络的输出。

标记时使用 CRF:

标记时使用 CRF:

实验结果分析

文本信息抽取

使用 CoNLL-2003 和 CHEMDNER 数据集,实验结果如下。

社交媒体信息抽取

从 Twitter 语料库里构造了两个数据集 EDUCATION 和 JOB。实验结果如下。

视觉信息抽取

数据集来自病人病历,由于隐私原因无法公开。实验结果如下:

■ 论文解读 | 王若旭,浙江大学硕士生,研究方向为关系抽取、零样本学习

为了解决推荐系统中协同过滤方法面对的数据稀疏和冷启动的问题,很多研究者将关注点放在 user 和 item 的属性上,通过设计一些算法来探索这些辅助信息。

本篇文章基于属性之间并非独立的观点提出 Knowledge Graph Convolutional Networks (KGCN),通过挖掘 item 在 KG 属性上的关系有效地捕获 item 内部的联系。

方法

本文具体的做法如下(参考下图理解):

1. 首先,将 user-item 中的 item 和 KG 中 entity 对齐;

2. 计算 user u 和 KG 中 relation r 的得分,表示用户 u 对关系 r 的重视程度,如:一些用户更注重某部电影的导演而非演员;

3. 通过对周围 entity e 施加不同权重,计算 item v 拓扑机构表示。其中,N(v) 是 v 的邻接节点。

4. 文中提出三种聚合方法来聚合 item v 的表示和它邻接节点的表示 (S(v) 是为了保持每批次的计算模式固定且更高效,从 N(v) 中采样得到的)。

5. 论文采用 hinge loss,考虑到算法的效率,为每个样本产生 T^u 个负样本,且样本满足均匀分布。

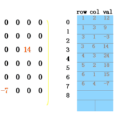

KGCN 算法流程如下:

数据集:包括 movieLens-20M,Book-Crossing,Last.FM,用 Microsoft Satori 进行对齐,丢掉了多个匹配的和没有匹配上的 item。数据集统计如下:

K: 感知的宽度,即考虑的邻居节点数量

d:u,v表示的维度

H: 感知的深度,即递归的次数

实验结果

整体结果

邻居节点数量 K,表示的维度 d,感知的深度 H 对结果的影响。

点击以下标题查看更多相关文章:

让你的论文被更多人看到

如何才能让更多的优质内容以更短路径到达读者群体,缩短读者寻找优质内容的成本呢? 答案就是:你不认识的人。

总有一些你不认识的人,知道你想知道的东西。PaperWeekly 或许可以成为一座桥梁,促使不同背景、不同方向的学者和学术灵感相互碰撞,迸发出更多的可能性。

PaperWeekly 鼓励高校实验室或个人,在我们的平台上分享各类优质内容,可以是最新论文解读,也可以是学习心得或技术干货。我们的目的只有一个,让知识真正流动起来。

📝 来稿标准:

• 稿件确系个人原创作品,来稿需注明作者个人信息(姓名+学校/工作单位+学历/职位+研究方向)

• 如果文章并非首发,请在投稿时提醒并附上所有已发布链接

• PaperWeekly 默认每篇文章都是首发,均会添加“原创”标志

📬 投稿邮箱:

• 投稿邮箱:hr@paperweekly.site

• 所有文章配图,请单独在附件中发送

• 请留下即时联系方式(微信或手机),以便我们在编辑发布时和作者沟通

🔍

现在,在「知乎」也能找到我们了

进入知乎首页搜索「PaperWeekly」

点击「关注」订阅我们的专栏吧

关于PaperWeekly

PaperWeekly 是一个推荐、解读、讨论、报道人工智能前沿论文成果的学术平台。如果你研究或从事 AI 领域,欢迎在公众号后台点击「交流群」,小助手将把你带入 PaperWeekly 的交流群里。

▽ 点击 | 阅读原文 | 获取最新论文推荐