WSDM 2020教程《深度贝叶斯数据挖掘》,附257页PPT下载

【导读】台湾交通大学的Jen-Tzung Chien教授在WSDN 2020会议上通过教程《Deep Bayesian Data Mining》介绍了深度贝叶斯数据挖掘的相关知识,涵盖了贝叶斯学习、深度序列学习、深度贝叶斯挖掘和学习等内容。

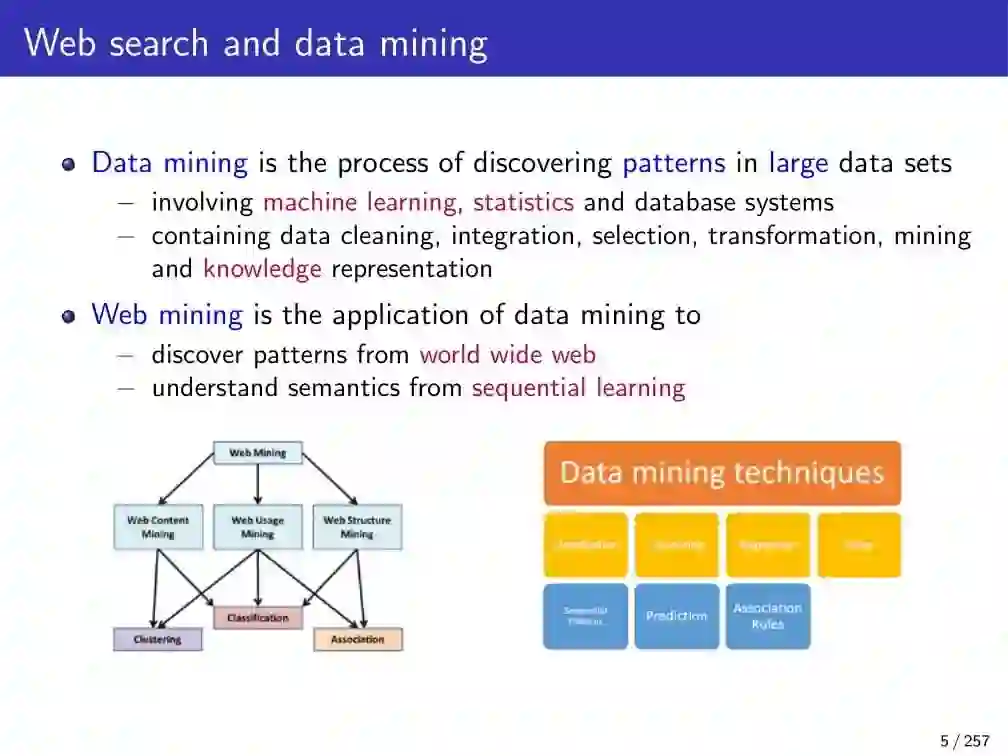

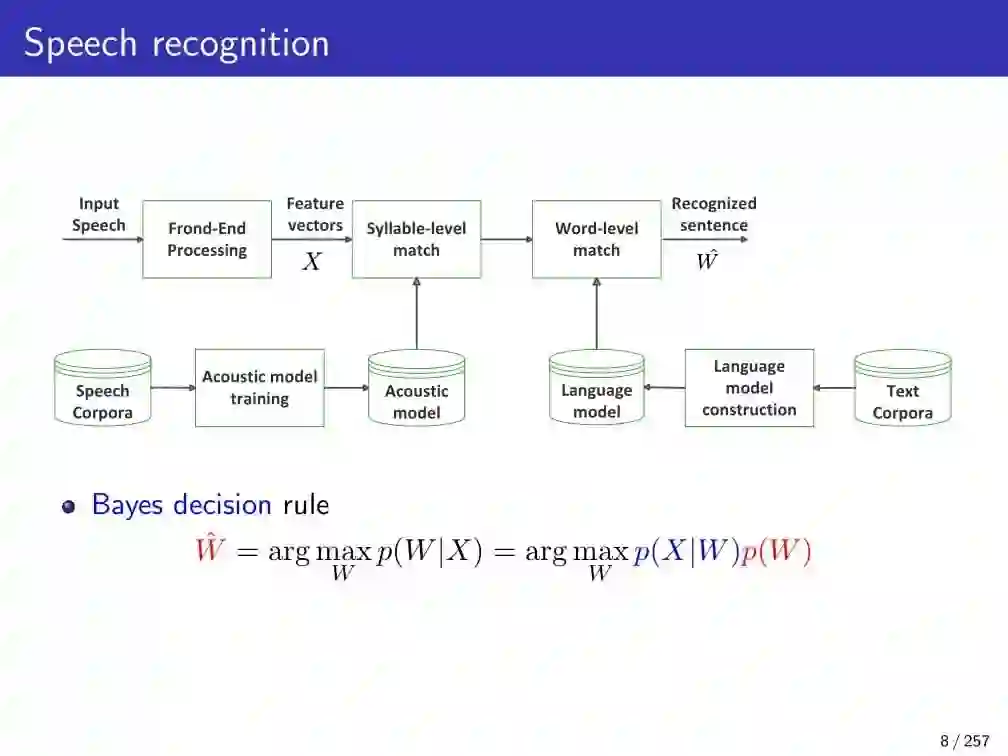

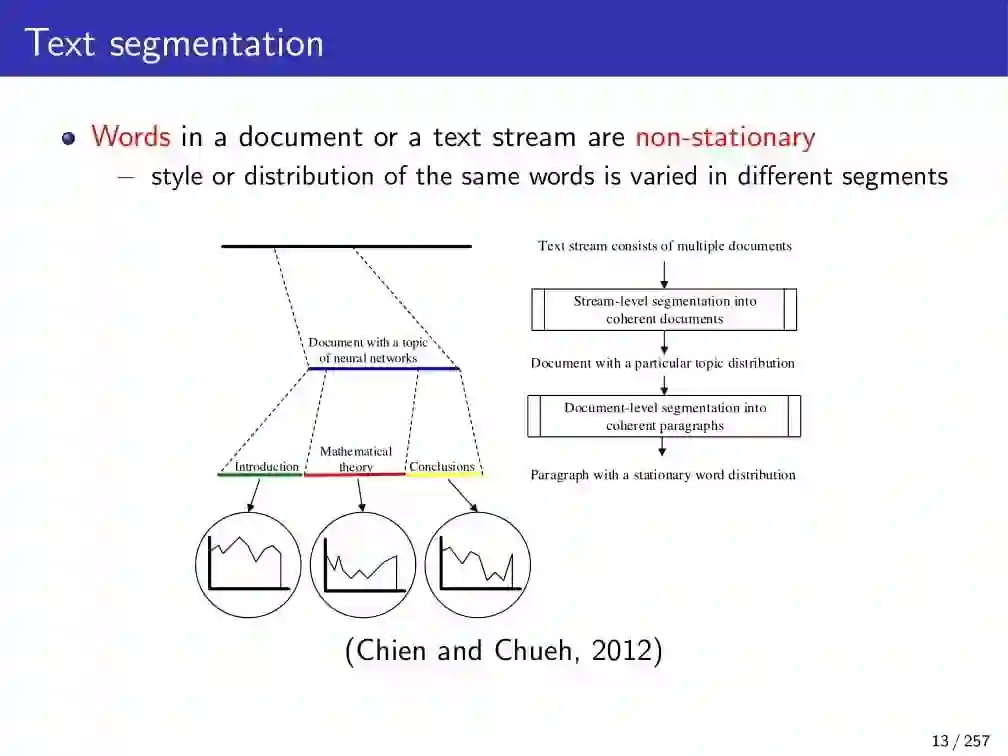

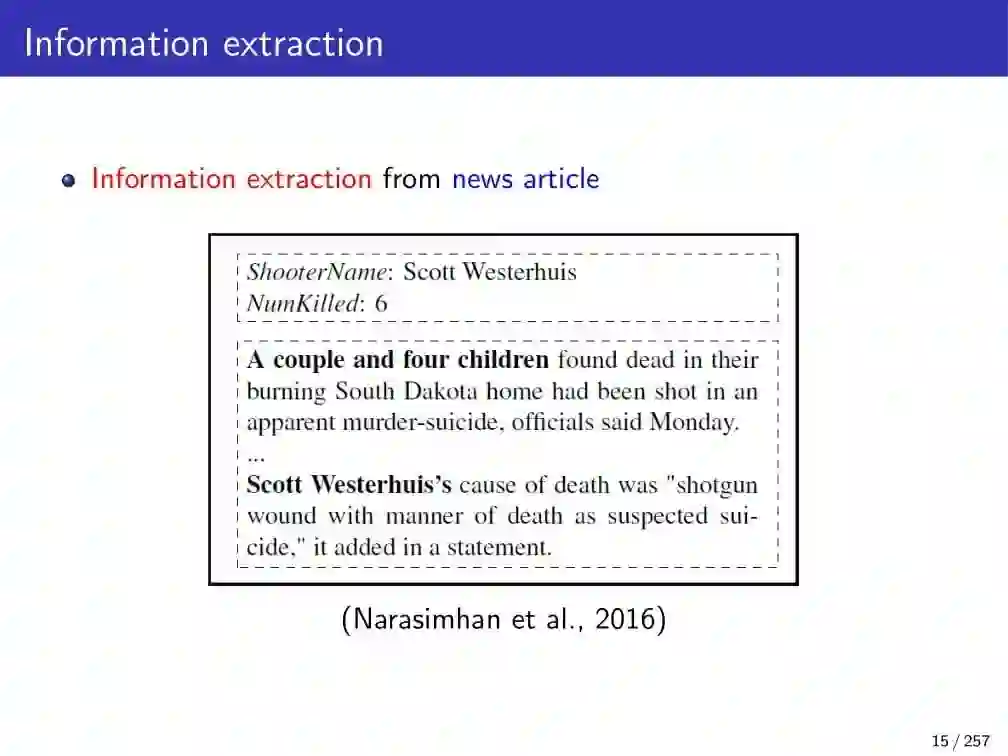

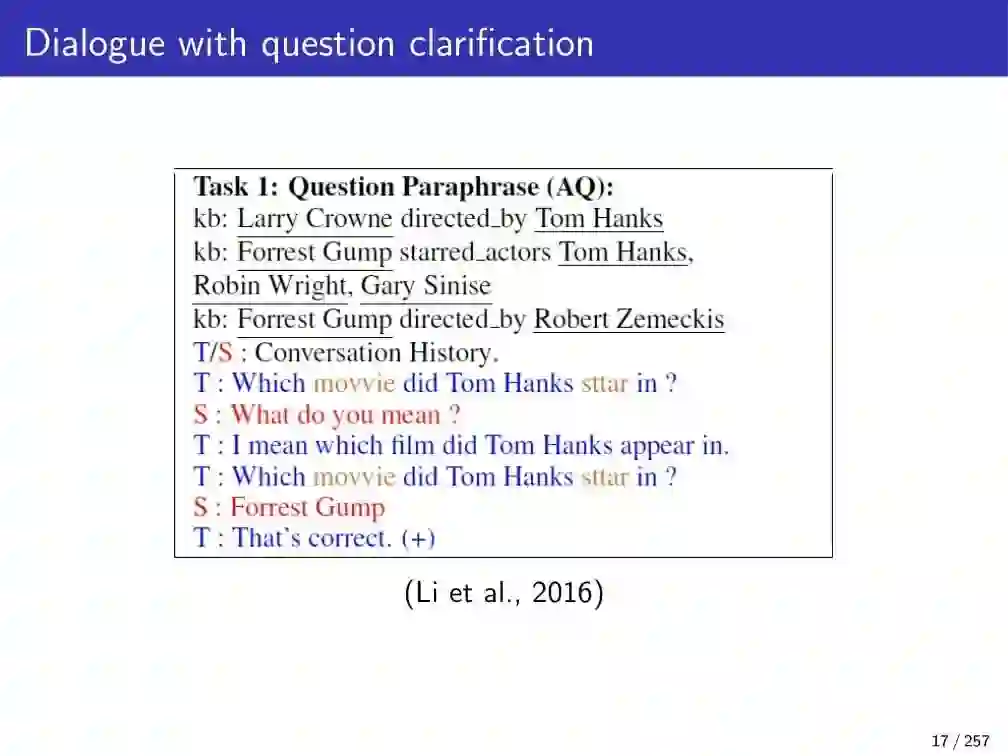

Jen-Tzung Chien教授在WSDM 2020的教程《Deep Bayesian Data Mining》(《深度贝叶斯数据挖掘》)介绍了面向自然语言的深度贝叶斯挖掘和学习,包括了它的基础知识和进展,以及它无处不在的应用,这些应用包括语音识别、文档摘要、文本分类、文本分割、信息抽取、图像描述生成、句子生成、对话控制、情感分类、推荐系统、自动问答和机器翻译等。

从传统上,“深度学习”被认为是一个学习过程,过程中的推断和优化都使用基于实数的判别模型。然而,从大量语料中提取出的词汇、句子、实体、行为和文档的“语义结构”在数学逻辑或计算机程序中可能不能很好地被这种方式表达或正确地优化。自然语言的离散或连续潜在变量模型中的“分布函数”可能不能被正确分解或估计。

该教程介绍了统计模型和神经网络的基础,并聚焦于一系列先进的贝叶斯模型和深度模型,包括层次狄利克雷过程、中国餐馆过程、递归神经网络、长短期记忆网络、序列到序列模型、变分自编码器、生成式对抗网络、策略神经网络等。教程还介绍了增强的先验/后验表示。教程展示了这些模型是如何连接的,以及它们为什么适用于自然语言中面向符号和复杂模式的各种应用程序。

变分推断和采样被提出解决解决复杂模型的优化问题。词和句子的嵌入、聚类和联合聚类被语言和语义约束合并。针对深度贝叶斯挖掘、搜索、学习和理解中的不同问题,一系列的案例研究、任务和应用被提出。最后,教程指出一些未来研究的方向和展望。教程旨在向初学者介绍深度贝叶斯学习中的主要主题,激发和解释它对数据挖掘和自然语言理解正在浮现的重要性,并提出一种结合不同的机器学习工作的新的综合方法。

教程的内容大致如下:

简介

动机和背景

概率模型

神经网络

贝叶斯学习

推断和优化

变分贝叶斯推断

蒙特卡罗马尔科夫链推断

深度序列学习

深度非展开主题模型

门递归神经网络

贝叶斯递归神经网络

记忆增强神经网络

序列到序列学习

卷积神经网络

扩增神经网络

基于Transformer的注意力网络

深度贝叶斯挖掘和学习

变分自编码器

变分递归自编码器

层次变分自编码器

随机递归神经网络

正则递归神经网络

跳跃递归神经网络

马尔科夫递归神经网络

时间差分变分自编码器

未来挑战和发展

总结和未来趋势

地址:

http://chien.cm.nctu.edu.tw/home/wsdm-tutorial/

-

后台回复“DBDM20” 就可以获取完整教程PDF的下载链接~

教程部分内容如下所示:

参考链接:

http://chien.cm.nctu.edu.tw/home/wsdm-tutorial/