Bengio和Gary Marcus隔空对谈深度学习发展现状

加入极市专业CV交流群,与6000+来自腾讯,华为,百度,北大,清华,中科院等名企名校视觉开发者互动交流!更有机会与李开复老师等大牛群内互动!

同时提供每月大咖直播分享、真实项目需求对接、干货资讯汇总,行业技术交流。关注 极市平台 公众号 ,回复 加群,立刻申请入群~

编译 | AI科技大本营编辑部 出品 | AI科技大本营(ID:rgznai100)

去年以来,由于纽约大学教授 Gary Marcus 对深度学习批评,导致他在社交媒体上与许多知名的 AI 研究人员如 Facebook 首席 AI 科学家 Yann LeCun 进行了一场论战。

不止 LeCun ,他还对另一深度学习大牛 Yoshua Bengio 的相关观点进行了反驳。近期,由于Bengio 对外强调深度学习的下一步研究方向时,Gary Marcus 同样表达了不同的观点。

10 月 11日,Yoshua Bengio 在 Facebook 予以回应,两人就 AI 和深度学习的发展现状进行了一来一回的“互怼”。

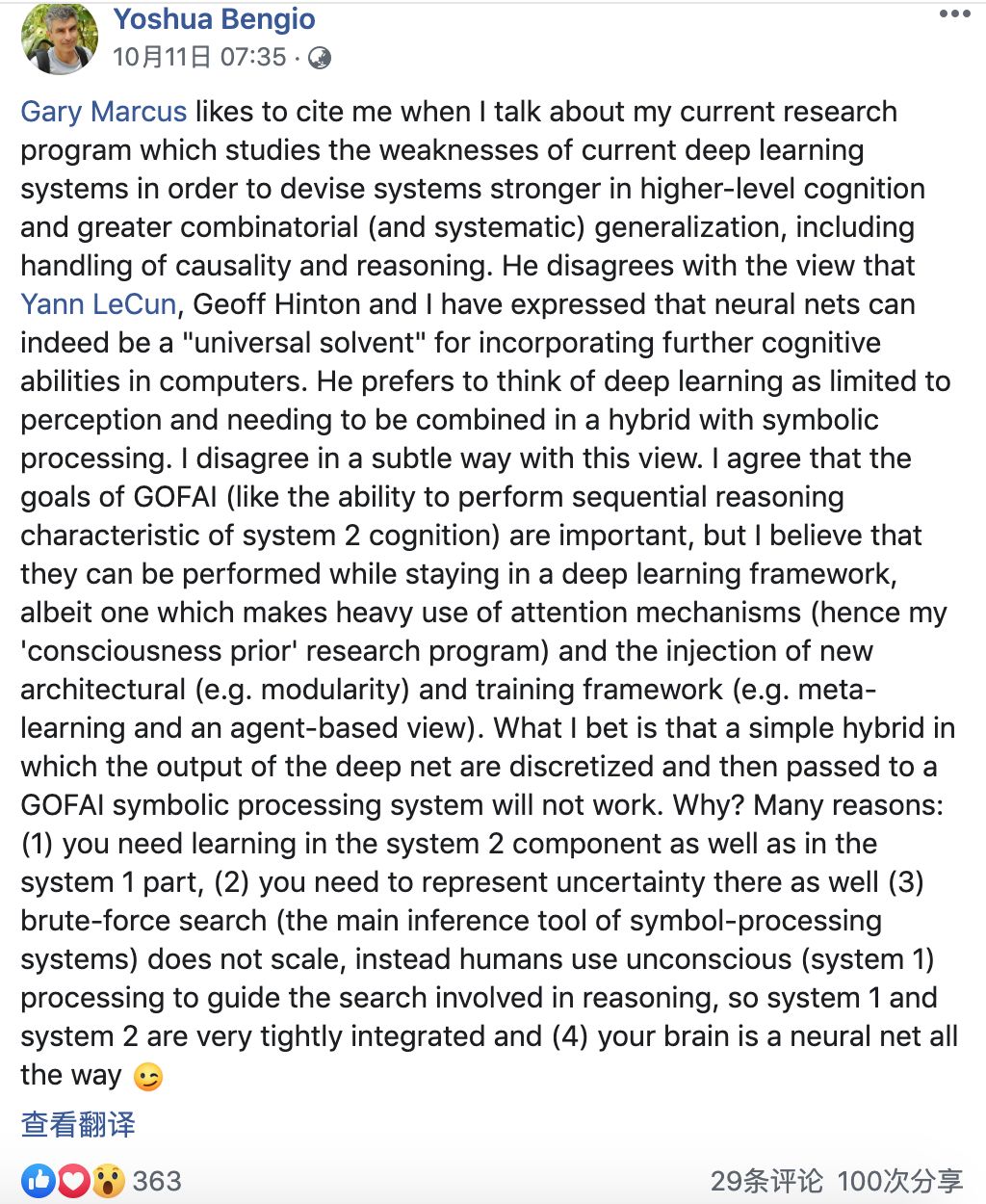

Gary Marcus喜欢在我谈论我目前的研究计划时引用我的观点,该计划谈到了研究深度学习系统的弱点, 以便在更高水平认知和更大组合(和系统)泛化中建立更强的系统, 包括处理因果关系和推理。他不同意Yann LeCun, Geofrey Hinton和我说过的观点,即神经网络确实可以成为计算机中整合更多认知能力的一个"通用溶剂(universal solvent)"。

他更喜欢把深度学习局限于感知, 并需要与符号处理相结合,我有点不同意这种观点。我同意GOFAI的目标是重要的(就像有能力执行系统2认知的顺序推理特征) ,但我相信, 他们可以在保持深度学习框架的同时完成这些目标,尽管该框架大量使用了注意力机制(我的“意识先验”研究计划)以及新架构(例如模块化)和训练框架(例如元学习)。

我敢打赌的是, 将深度网络的输出离散化然后传递到GOFAI符号处理系统的简单结合将不会奏效。为什么? 有很多原因:(1)你需要在系统2和系统1中进行学习, (2)你还需要在其中表示不确定性,(3)蛮力搜索(符号处理系统的主要推理工具)无法scale, 而是人类使用无意识(系统1)进行处理, 以指导涉及推理的搜索, 所以系统1和系统2非常紧密地集合在一起, (4)你的大脑一直是一个神经网络。

观点一致

-

就其本身而言,深度学习是一种有价值的工具,但从目前的形势来看,深度学习本身不足以使我们达到通用智能。

-

当前的深度学习技术通常会产生肤浅的结果,且泛化性较差。自1992年我首次发表文章以来,我就一直在表达这一点,并且在我 2012 年为《纽约客》写的第一篇公开评论中就对深度学习展发表了详细观点。这也是我2001年关于认知科学书籍的重点。而你近期发表在 arXiv 上的论文《A Meta-Transfer Objective for Learning to Disentangle Causal Mechanisms》的介绍也恰好与《The Algebraic Mind》的主旨相呼应,都提出这一观点:对许多常见的神经网络来说,在训练空间之外进行泛化,是一项挑战。

-

我们两人都同意纳入因果关系的重要性。数十年来,Judea Pearl 也一直在强调这个问题;2012年,我想我也许是第一个在《纽约客》的文章中针对深度学习领域强调这一问题的人。

-

对“理解如何将连续的 “第二系统”[“System II” (Kahnem’s term)]推理(我喜欢称之为审议推理[deliberative reasoning])纳入人工智能的工作流程是至关重要的”这一看法我也认同你的说法。经典 AI 提供了一种方法,但其有着显著地局限性,探索其他方法肯定是一件有趣的事情。

-

你建议结合很多技术,特别是注意力、模块化和元学习,这可能会很有帮助。我之前的公司就对元学习有很大的兴趣,我也坚信需要模块化和构建更结构化的模型,我不确定你对基于代理的视图持何看法,在我看来这是合理的。

分歧

鸿沟

你实际上并没有说出你对建立先验知识想法的看法。对我来说,这个问题绝对是核心问题,但它在最新的深度学习研究中被忽略了。 我对你的先天(innateness)知识的看法以及你是否认为向深度学习加入更多的先验知识成为向前发展的重要组成部分感到好奇。

争论

你实际上并没有说出你对建立先验知识想法的看法。对我来说,这个问题绝对是核心问题,但它在最新的深度学习研究中被忽略了。 我对你的先天(innateness)知识的看法以及你是否认为向深度学习加入更多的先验知识成为向前发展的重要组成部分感到好奇。

争论

一个简单的混合,其中的输出是离散的深度网络,然后传递到一个GOFAI符号处理系统将不会有效果。为什么?有很多原因:1、你需要在系统2和系统1进行学习,(2)你还需要表现出不确定性……”

“……手动编码机器需要知道的所有东西可能是不现实的。机器将需要自己学习很多东西。我们可能想要“手动编码”锋利的硬刀片来切割柔软的材料,但人工智能应该能够基于这一知识,学习刀、割草机和搅拌机的工作原理,但不需要对这些机器进行手动编码。”

“我们一直在讨论的那种逻辑只有一件事做得很好:它允许我们获取我们确定的知识,并使用总是有效的规则来演绎我们也确信的新知识。如果我们完全确定 Ida 拥有一部 iPhone,而且我们确定苹果生产 iPhone,那么我们就可以确定Ida拥有苹果生产的产品。但生活中有什么是绝对确定的呢?

正如罗素所说:“人类所有的知识都是不确定的、不精确的、片面的。”然而,我们人类总有办法做到。当机器最终能做同样的事情,想人类那样流畅、灵活、有力地表示和推理不确定、不准确、不完整的知识,广义的人工智能将最终出现。”

-

如你所见,我们在这类问题上的立场是一致的;在你上面的回应文章里,你批评的是一个稻草人(strawperson),而不是我们的实际立场。 -

与此同时,我认为你还没有认识到你自己的观点已经有所改变;你在2016年发表的《自然》(Nature)杂志上的论文比你目前的观点尖锐得多,也承认对深度学习的限制要少得多。

“当前的机器学习方法在需要在训练分布之外泛化时显得很弱……从与训练数据相同的分布中采样的测试集上获得良好的泛化能力是不够的”。

多层感知机不能将[某类通用量化的函数]推广到训练空间之外。在某些情况下,人类似乎可以自由地从受限制的数据中进行归纳,(在这些情况下)通过反向传播训练的某一类多层感知机是不合适的。

-End-

*延伸阅读

CV细分方向交流群

添加极市小助手微信(ID : cv-mart),备注:研究方向-姓名-学校/公司-城市(如:目标检测-小极-北大-深圳),即可申请加入目标检测、目标跟踪、人脸、工业检测、医学影像、三维&SLAM、图像分割等极市技术交流群,更有每月大咖直播分享、真实项目需求对接、干货资讯汇总,行业技术交流,一起来让思想之光照的更远吧~

△长按添加极市小助手

△长按关注极市平台

觉得有用麻烦给个在看啦~