【导读】现有的机器学习方法在很多场景下需要依赖大量的训练样本。但机器学习方法是否可以模仿人类,基于先验知识等,只基于少量的样本就可以进行学习。本文介绍34页小样本学习综述《Generalizing from a Few Examples: A Survey on Few-Shot Learning》,包含166篇参考文献,来自第四范式和香港科技大学习的研究学者。

小样本学习综述 Few-shot Learning: A Survey

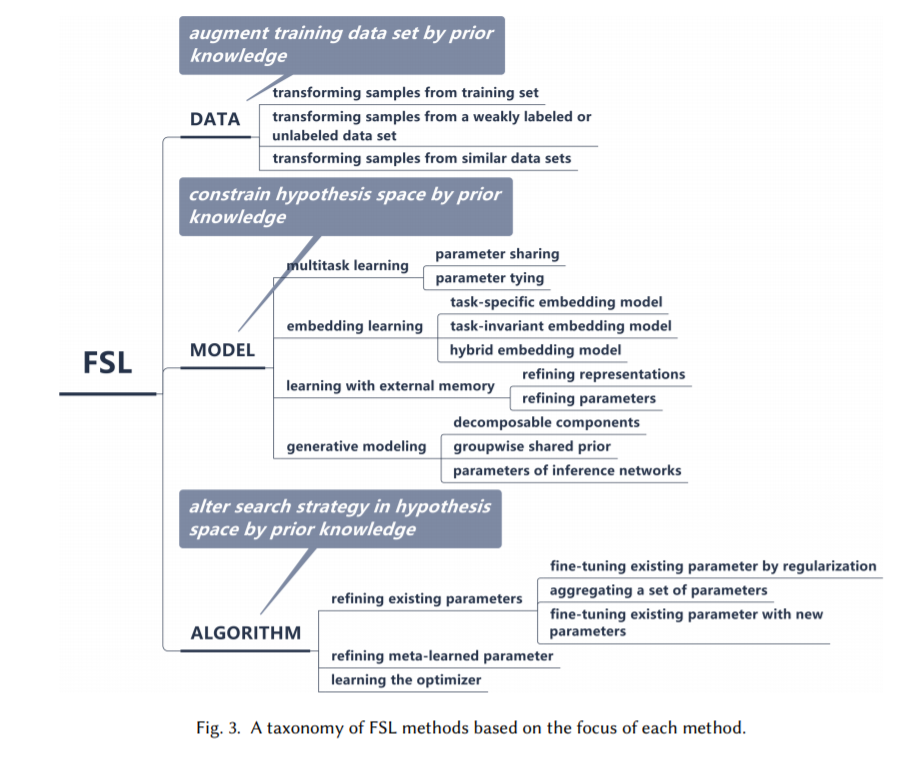

【摘要】机器学习在数据密集型应用中非常成功,但当数据集很小时,它常常受到阻碍。为了解决这一问题,近年来提出了小样本学习(FSL)。利用先验知识,FSL可以快速地泛化到只包含少量有监督信息的样本的新任务中。在这篇论文中,我们进行了一个彻底的调研,以充分了解FSL。从FSL的正式定义出发,我们将FSL与几个相关的机器学习问题区分开来。然后指出了FSL的核心问题是经验风险最小化是不可靠的。基于先验知识如何处理这一核心问题,我们从三个角度对FSL方法进行了分类: (i) 数据,它使用先验知识来增加监督经验;(二) 利用先验知识缩小假设空间大小的模型;(iii)算法,利用先验知识在给定的假设空间中改变对最佳假设的搜索。有了这种分类法,我们就可以回顾和讨论每个类别的优缺点。在FSL问题的设置、技术、应用和理论方面也提出了有前景的方向,为未来的研究提供了见解。

-

我们给出了FSL的形式化定义。它可以自然地链接到以往文献中提出的经典机器学习定义。这个定义不仅足够概括,包括所有现有的FSL -shot Learning: A Survey problems,而且足够具体,明确了什么是FSL的目标,以及我们如何解决它。这一定义有助于确定未来FSL领域的研究目标。

-

指出了基于误差分解的FSL在机器学习中的核心问题。我们发现,正是不可靠的经验风险最小化使得FSL难以学习。这可以通过满足或降低学习的样本复杂度来缓解。理解核心问题有助于根据解决核心问题的方式将不同的工作分类为数据、模型和算法。更重要的是,这为更有组织和系统地改进FSL方法提供了见解。

-

我们对从FSL诞生到最近发表的文献进行了广泛的回顾,并将它们进行了统一的分类。对不同类别的优缺点进行了深入的讨论。我们还对每个类别下的见解进行了总结。这对于初学者和有经验的研究人员都是一个很好的指导方针。

-

我们在问题设置、技术、应用和理论方面展望了FSL未来的四个发展方向。这些见解都是基于当前FSL发展的不足之处,并有可能在未来进行探索。我们希望这部分能够提供一些见解,为解决FSL问题做出贡献,为真正的AI而努力。

-

与已有的关于小样本概念学习和经验学习的FSL相关调相比,我们给出了什么是FSL,为什么FSL很难,以及FSL如何将小样本监督信息与先验知识结合起来使学习成为可能的正式定义。我们进行了广泛的文献审查的基础上提出的分类法与详细讨论的利弊,总结和见解。我们还讨论了FSL与半监督学习、不平衡学习、迁移学习和元学习等相关话题之间的联系和区别