传统的计算机视觉通常通过专门的模型独立解决每个单一任务,任务指示隐式地设计在模型架构中,这引起了两个限制:(1) 它导致了特定于任务的模型,需要多个模型来处理不同的任务,限制了来自不同任务的潜在协同作用;(2) 它导致了一个预定义的且固定的模型接口,该接口在遵循用户的任务指示时具有有限的交互性和适应性。为了解决这些问题,最近积极研究了视觉指令微调(VIT),它通过将语言作为任务指示来微调一个大型视觉模型,旨在通过语言指示描述的各种视觉任务来学习一个通用的多模态模型,该模型可以遵循任意指示,从而解决用户指定的任意任务。这项工作旨在提供视觉指令微调的系统综述,涵盖:(1) 呈现计算机视觉任务范式和VIT发展的背景;(2) 介绍VIT的基础,包括常用的网络架构、视觉指令微调框架和目标,以及评估设置和任务;(3) 视觉指令微调和评估中常用的数据集;(4) 对现有VIT方法的回顾,根据所研究的视觉任务和方法设计对它们进行分类,并强调它们的主要贡献、优势和不足;(5) 对各种指令遵循基准上的VIT方法进行比较和讨论;(6) 视觉指令微调研究中的几个挑战、开放方向和可能的未来工作。****

1 引言

计算机视觉长期以来一直是人工智能领域的一大挑战,旨在使计算机、机器或系统能够像人类一样感知、分析、理解并与视觉世界互动【1】、【2】。随着深度神经网络【3】、【4】、【5】的发展,计算机视觉研究在一系列任务中取得了巨大的成功,如判别性视觉任务(例如,图像分类和分割,目标检测等)和生成性视觉任务(例如,图像生成、图像编辑等)。 尽管如此,在这一研究领域中,每个视觉任务通常由一个专门的视觉模型独立解决,其中任务指令被隐含地考虑并设计在模型架构中,例如用于掩码预测的分割头、用于框预测的检测头、用于描述性文本生成的图像字幕头和用于生成RGB图像的图像生成解码器。这引起了两个固有的限制:(1) 它导致视觉模型是特定于任务的,这需要训练和使用多个模型来处理不同的任务,限制了不同任务间的潜在协同效应;(2) 它导致视觉模型通常具有预定义和固定的接口,导致在遵循用户任务指令时的交互性和适应性有限。 最近,指令调优在微调大型语言模型(LLMs)以构建通用语言模型方面显示出了巨大的有效性。在指令调优中,自然语言被用来显式表示各种任务指令,并指导端到端可训练的模型理解并转换到感兴趣的任务。通过这种方式,模型可以通过自然语言指令描述的广泛任务范围进行微调,最终构建出一个能够遵循任意指令并解决用户指定的任意任务的通用模型【6】、【7】、【8】。 受到自然语言处理成功的启发,提出了视觉指令调优,它通过将语言作为任务指令来微调大型视觉模型,旨在构建一个通用的多模态模型(或称为通用视觉-语言模型)。具体来说,视觉指令调优构建了一个通用接口,接受视觉和语言输入,其中语言输入作为任务指令,指导模型理解感兴趣的任务,相应处理视觉输入并返回预期输出。通过这个通用接口,模型可以通过视觉指令调优数据(即由视觉输入、语言指令输入和相应输出组成的三元组)对广泛的视觉任务进行微调,从而构建出一个可以接受任意语言指令输入和视觉输入的通用多模态模型,因此可以解决任意视觉任务。例如,给定一个自然图像作为视觉输入,如果语言指令输入要求“描述图像”、“定位图像中的物体”或“修改图像风格”,则通用多模态模型的输出可能是详细的图像描述、一组边界框或修改后的图像。 视觉指令调优的好处有三个方面:(1) 它构建了一个以语言为任务指令的通用视觉任务接口,使模型能够学习并解决广泛的视觉任务,从不同任务的协同效应中获益;(2) 它使模型能够接受用户的任意任务指令,最终形成一个具有强大交互性和适应性的智能模型,以遵循用户的意图;(3) 它在计算上高效,因为它可以利用现成的预训练大型视觉模型和大型语言模型,并将它们结合并微调,最终构建一个通用多模态模型。 尽管在构建通用多模态模型方面对视觉指令调优的兴趣显著,如图1所示的大量近期论文证明了这一点,研究界缺乏一项综合性调查,可以帮助整理现有的视觉指令调优方法、面临的挑战以及未来的研究方向。尽管如图1所示的众多近期出版物表明,研究界对构建通用多模态模型的视觉指令调优表现出了显著兴趣,但仍缺乏一项系统性的调查,可以帮助全面组织当前的视觉指令调优方法、现有的研究挑战和未来研究的潜在方向。我们通过对视觉指令调优研究进行全面调查,努力填补这一空白,调查范围涵盖从判别性图像任务(例如,图像分类和分割)到生成性图像任务(例如,图像生成和编辑)、复杂图像推理任务(例如,视觉问题回答和视觉助理)、视频任务、医疗视觉任务、3D视觉任务等。该调查从不同的角度进行,包括背景、基础、数据集、方法论、基准测试以及当前的研究挑战和开放研究方向。我们希望这项工作能够提供一个全面的概述,展示我们已经取得了哪些成就,目前面临哪些挑战,以及在视觉指令调优研究中我们还能进一步取得什么成就。 我们将这项工作的主要贡献总结为三个方面。首先,它提供了对视觉指令调优的系统性回顾。我们根据所研究的视觉任务和方法设计开发了一个分类法,并突出了现有视觉指令调优方法的主要贡献、优势和不足。与其他主要集中在NLP领域或深入研究视觉-语言预训练的文献回顾不同,我们的调查聚焦于新兴的视觉指令调优研究方向,并系统地组织了最近的方法,根据调查的视觉任务和指令调优设计进行分类,提供了这一有前途研究方向的全面概述。其次,它调查并分析了视觉指令调优的最新进展,包括对现有方法在各种指令遵循评估数据集上的全面基准测试和讨论。第三,它识别并讨论了视觉指令调优研究中的几个挑战,以及未来研究的潜在方向。 本工作的其余部分组织如下。第2节介绍计算机视觉中的任务范式、视觉指令调优的发展以及几项相关调查。第3节调查视觉指令调优的基础,包括常用的网络架构、视觉指令调优框架和目标,以及针对指令调优的通用多模态模型的评估设置和任务。第4节提供了在视觉指令调优和指令调优模型评估中广泛采用的数据集概述。第5节分类和回顾了各种视觉指令调优方法。 ** 视觉指令调优基础**

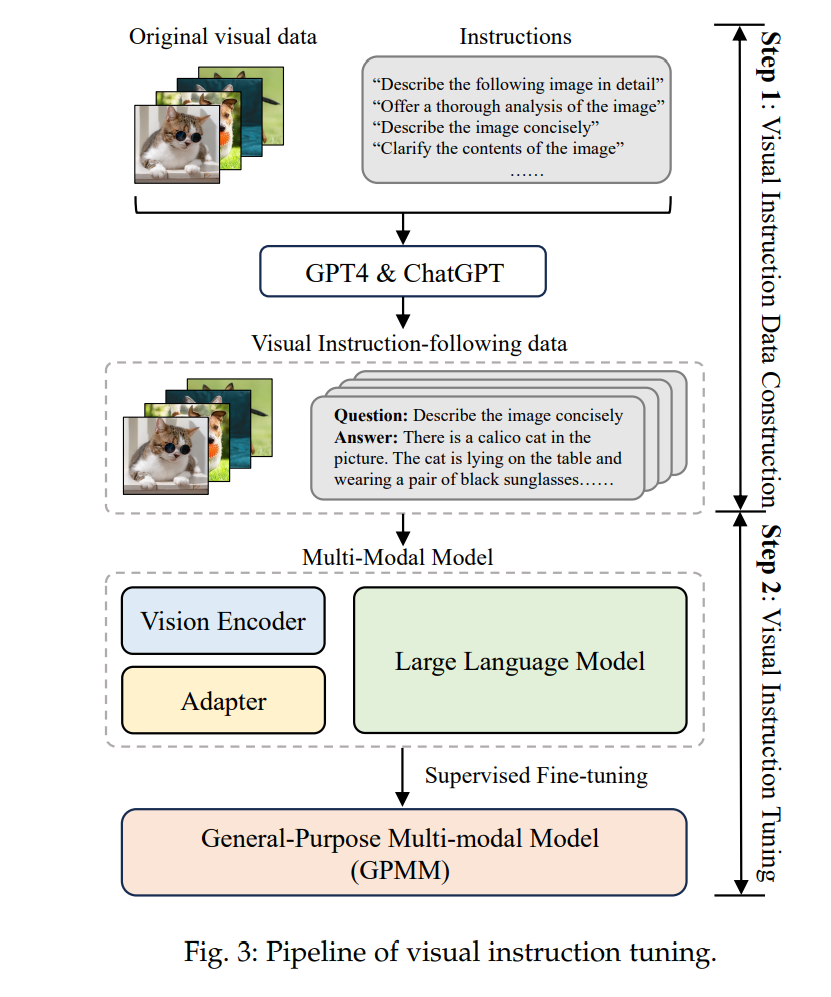

视觉指令调优【9】旨在利用视觉指令跟随数据对大型视觉模型进行微调,以构建通用多模态模型(GPMM)。视觉指令调优的流程通常包括两个阶段,即视觉指令跟随数据的构建和视觉指令调优,如图3所示。本节介绍视觉指令调优的基础,包括构建视觉指令跟随数据的常见方法、用于编码图像和文本数据的网络架构、视觉指令调优框架、目标以及用于评估的下游任务。

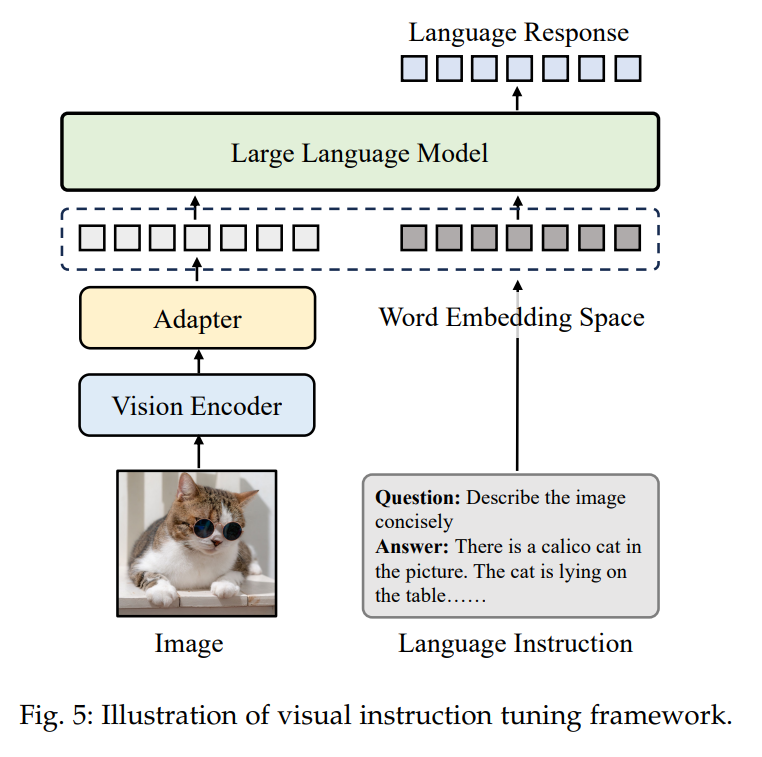

广泛采用的视觉指令调优框架如图5所示,通常包括视觉编码器、大型语言模型(LLM)和适配器。在这个框架中,视觉编码器用于从图像中提取特征。然后适配器作为桥梁,将这些图像特征转换到词嵌入空间,从而促进LLM对视觉编码器输出的解读。适配器通常被设计为轻量级且成本效益高,例如一些线性层【9】,以确保高效的多模态整合。随后,LLM处理结合了文本和图像嵌入的数据,以生成预期的语言响应。

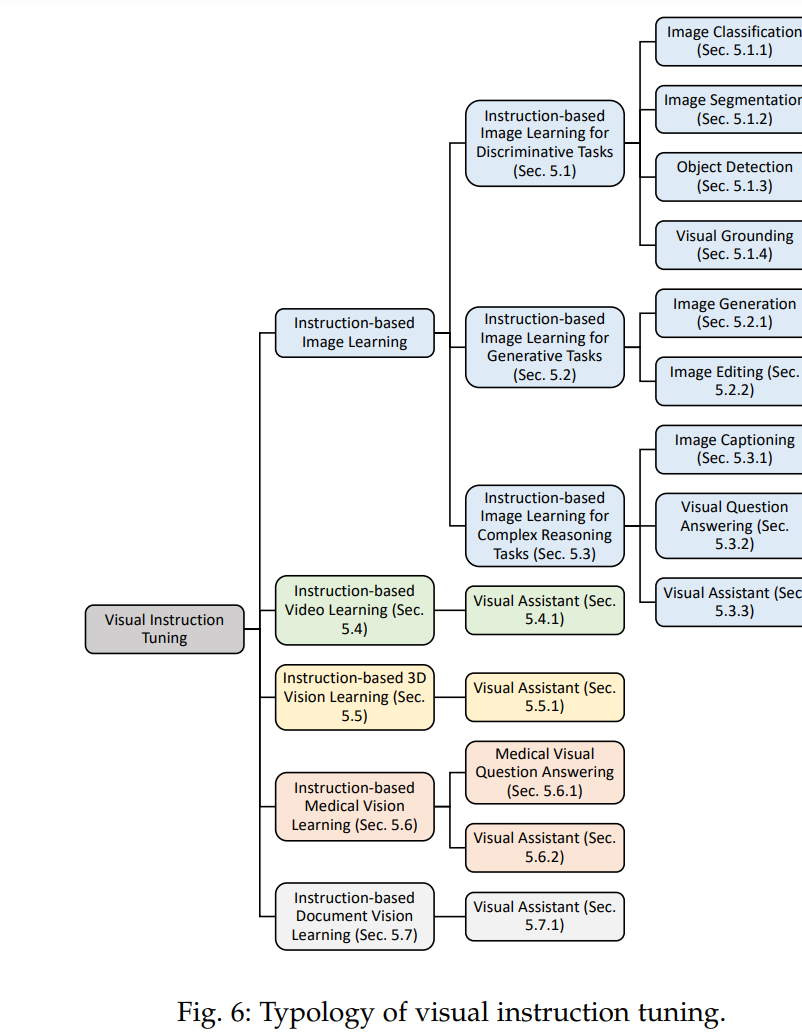

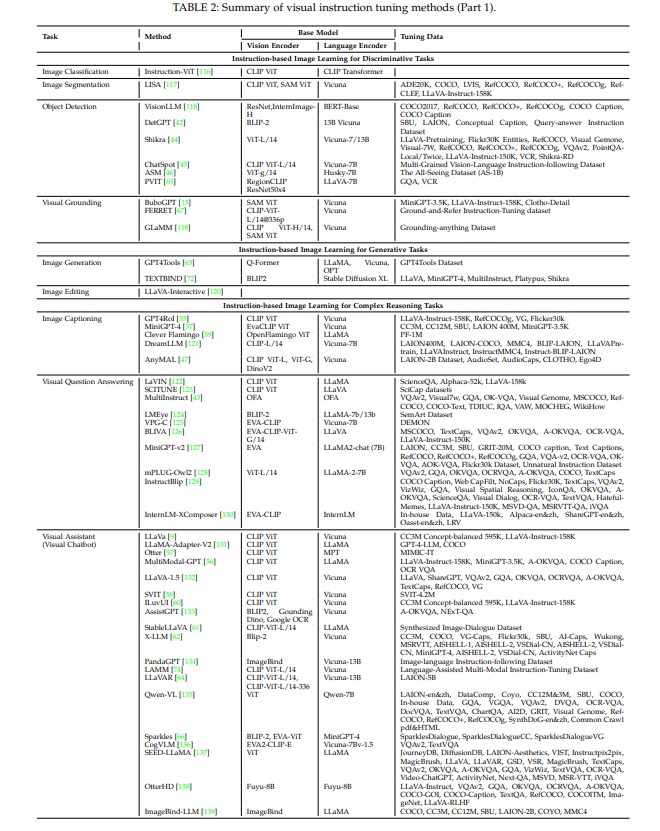

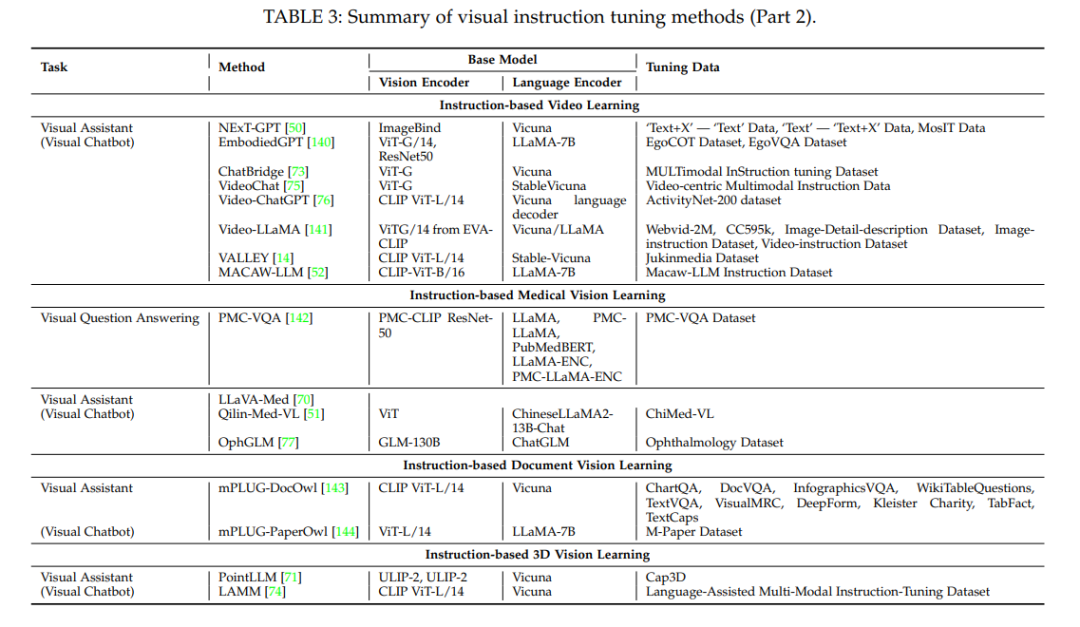

针对通用多模态模型的视觉指令调优已经被用于探索各种视觉任务,包括判别性任务、生成性任务、复杂图像推理任务、视频任务、医疗视觉任务、文档视觉任务和3D视觉任务,如表6所示。本节将根据表2和表3中列出的上述任务进行回顾。

结论

视觉指令调优通过将语言作为任务指令来微调大型视觉模型,最终从由语言指令描述的广泛视觉任务中学习,构建出一个能够遵循任意指令并因此解决用户指定的任意任务的通用多模态模型。在这项调查中,我们从不同的角度对视觉指令调优研究进行了广泛的回顾,范围从背景到基础、数据集、方法论、基准测试,以及当前的研究挑战和开放的研究方向。我们以表格形式总结了视觉指令调优的数据集、方法和表现,旨在提供一个全面的概述,展示我们已经取得了哪些成就,目前面临哪些挑战,以及在视觉指令调优研究中我们还能进一步取得什么成就。