【导读】2023年国际万维网大会The Web Conference(旧称WWW)将于2023年4月30日-5月4号日线上召开。TheWebConf是中国计算机学会(CCF)推荐的A类国际学术会议,是互联网技术领域最重要的国际会议之一,由国际万维网会议委员会(IW3C2)和主办地地方团队合作组织,每年召开一次。本次会议共计收到来自全球各地的1900篇论文投稿,最终有365篇论文成功入选,论文录用率仅为19.2%。刚刚最佳论文一系列奖项出炉了!来自麻省理工学院的推特机器人检测《 Simplistic Collection and Labeling Practices Limit the Utility of Benchmark Datasets for Twitter Bot Detection**》获得最佳论文,UCLA《A Single Vector Is Not Enough: Taxonomy Expansion via Box Embeddings》获得最佳学生论文!**

自从1989年万维网发明以来,“WWW”会议作为计算机与互联网领域的国际性顶级学术会议,不仅一直是全球互联网发展的风向标,而且也是网络业界的专家、学者、企业家们展示和讨论互联网相关研究课题、发展成果、标准设定和应用场景的主要场所。同时,“WWW”会议也被中国计算机学会(CCF)列为《中国计算机学会推荐国际学术会议和期刊目录》的A类学术会议。

详情可登陆以下会议官网查询:https://www2023.thewebconf.org/

「最佳论文奖」(Best Paper Award)

简化的收集和标记方法限制了用于推特机器人检测的基准数据集的实用性。

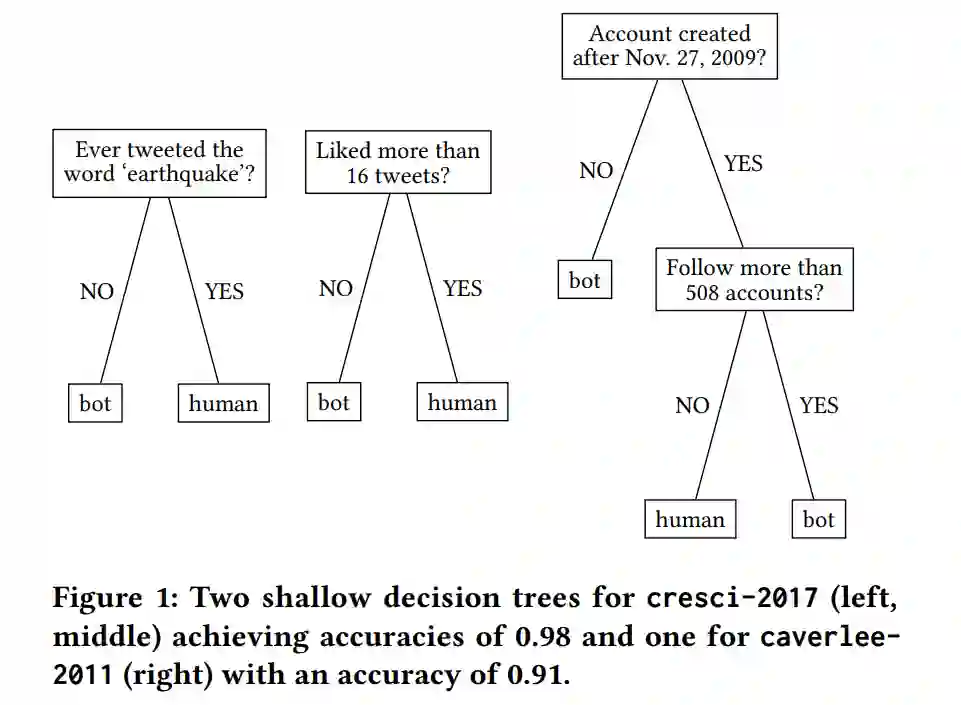

作者: Chris Hays, Zachary Schutzman, Manish Raghavan, Erin Walk, Philipp Zimmer摘要:准确的机器人检测对于在线平台的安全和完整性至关重要。这对于研究机器人在选举中的影响、错误信息的传播和金融市场操纵方面的研究也非常关键。平台部署基础设施来标记或移除自动化账户,但他们的工具和数据并未公开。因此,公众必须依赖第三方机器人检测。这些工具采用机器学习,并在现有数据集上的分类方面通常取得接近完美的性能,这表明机器人检测是准确、可靠且适用于下游应用。然而,我们提供了证据表明情况并非如此,我们发现高性能归因于数据集收集和标记的局限性,而非工具的复杂性。具体而言,我们发现简单的决策规则 —— 在少量特征上训练的浅层决策树 —— 在大多数现有数据集上实现了接近最先进的性能,而且即使将机器人检测数据集组合在一起,它们也不能很好地泛化到样本外数据集。我们的研究结果揭示了预测结果高度依赖于每个数据集的收集和标记程序,而不是机器人和人类之间的根本巟别。这些结果对于采样和标记程序的透明度以及使用现有机器人检测工具进行预处理的研究中的潜在偏见具有重要意义。

https://www.zhuanzhi.ai/paper/e500bc8777f1ed5f10e89f7cff72355c

「最佳学生论文奖」(Best Student Paper Award)

单一向量不足以满足需求:通过盒子嵌入实现分类体系扩展

A Single Vector Is Not Enough: Taxonomy Expansion via Box Embeddings

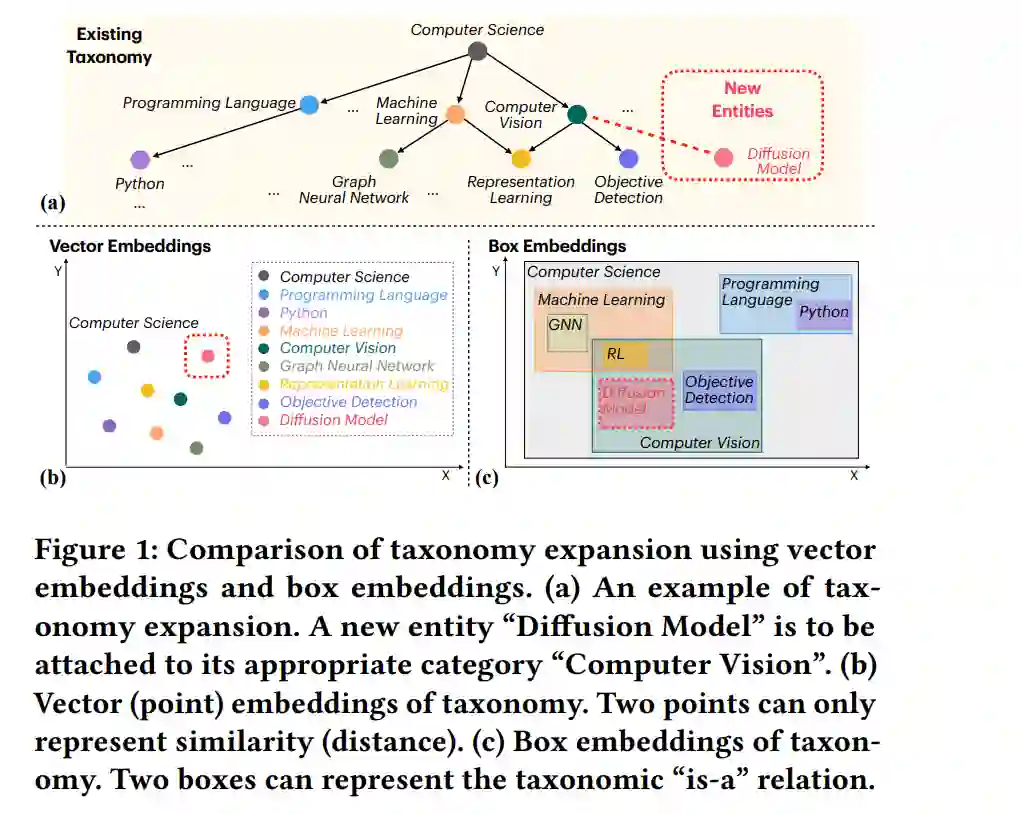

分类体系以分层方式组织知识,支持各种实用的网络应用,如在线购物中的产品导航和社交平台上的用户资料标签。鉴于新实体不断涌现,通过人工标注及时维护全面的分类体系的成本过高。因此,自动地将新实体扩展到分类体系中至关重要。现有的大多数用于扩展分类体系的方法将实体编码为向量嵌入(即单个点)。然而,我们认为向量不足以模拟分类体系中的“是一个”层次结构(不对称关系),因为两个点只能表示成对相似性(对称关系)。为此,我们建议将分类体系实体投影到盒子(即超矩形)中。两个盒子可以是“包含”、“不相交”和“相交”,因此自然地表示出不对称的分类层次结构。在盒子嵌入的基础上,我们提出了一种用于分类体系扩展的新型模型BoxTaxo。BoxTaxo的核心是为实体学习盒子,以捕捉它们的子-父层次结构。为了实现这一目标,BoxTaxo从几何和概率的联合视角优化盒子嵌入。BoxTaxo还为推理提供了一种简单自然的方法:检查给定新实体的盒子是否完全包含在现有分类体系中候选父实体的盒子内。在两个基准数据集上进行的广泛实验表明,与基于向量的模型相比,BoxTaxo具有更高的有效性。

https://songjiang0909.github.io/pdf/boxtaxo.pdf

(Seoul Test of Time Award)