人工智能安全

·

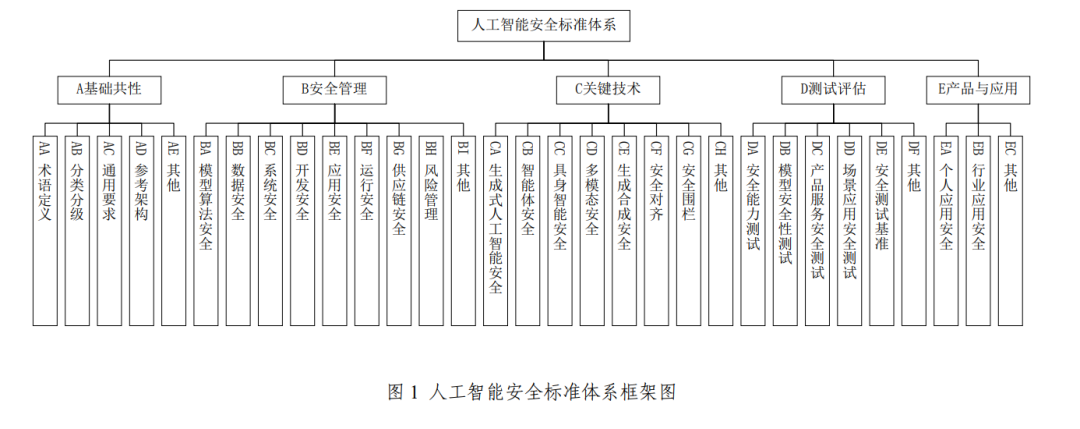

人工智能安全标准体系旨在支撑落实《人工智能安全治 理框架》(以下简称“《框架》”),围绕《框架》中明确 的模型算法安全、数据安全、系统安全三类内生安全风险, 以及网络域、现实域、认知域、伦理域四类应用安全风险, 系统梳理了可帮助防范化解相关人工智能安全风险的重点 标准,同时与网络安全国家标准体系进行有效衔接,加强人 工智能安全标准工作顶层设计,以科学、合理的标准布局前 瞻应对各类风险挑战,促进人工智能技术及应用健康发展。 体系内各项标准与《框架》中各类风险的映射关系见附件 1。 人工智能安全标准体系主要由基础共性、安全管理、关 键技术、测试评估、产品与应用等 5 个部分组成,体系框架 如图 1 所示。 1、基础共性类标准是以标准工作支撑落实《框架》的 重要保障,主要规范了人工智能安全术语定义、分类分级、 通用要求、参考架构等方面内容,是人工智能安全的基础性、 总体性标准。 2、安全管理类标准围绕《框架》中明确的模型算法安 全、数据安全、系统安全三类内生安全风险,以及在人工智 能系统开发、应用、运行、维护等生命周期各环节面临的安 全风险,提供了覆盖全过程全要素的安全管理标准。 3、关键技术类标准紧扣人工智能相关技术发展情况, 主要规范了生成式人工智能安全、智能体安全、具身智能安全、多模态安全、生成合成安全、安全对齐、安全围栏等方 面内容,为人工智能技术健康发展保驾护航。 4、测试评估类标准主要规范人工智能安全能力测试、 模型安全性测试、产品服务安全测试、场景应用安全测试、 安全测试基准等方面内容,以测试评估工作帮助提升人工智 能安全水平。 5、产品与应用类标准主要规范个人应用、重点行业应 用等方面内容,保障人工智能技术在各行业、各领域的安全 应用。

成为VIP会员查看完整内容

相关内容

Arxiv

152+阅读 · 2023年3月29日